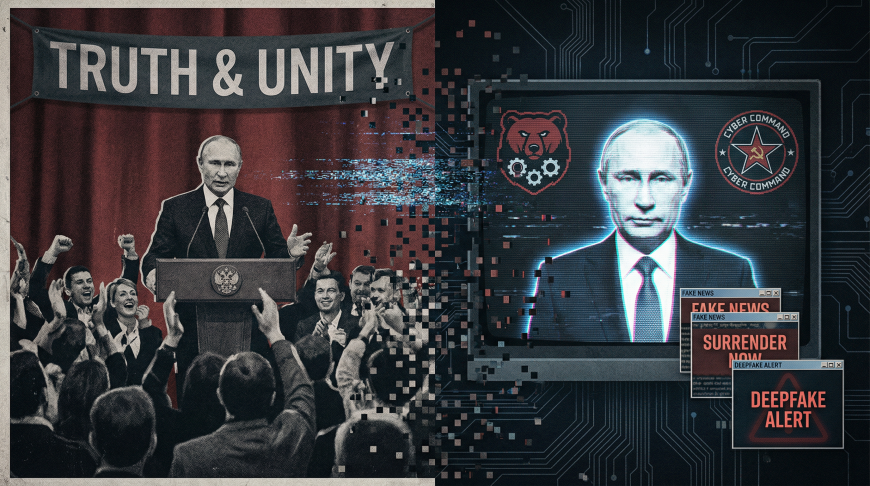

2025年8月,在被占领的克里米亚半岛塞瓦斯托波尔的某个地下室里,俄军方第72信息心理作战中心的技术人员启动了一个名为“Geroy-3”的AI生成模型。

几小时后,一段视频开始在乌克兰的Telegram频道中扩散:画面中的泽连斯基神情疲惫,用他标志性的声音宣布乌克兰军队将放下武器、接受投降条件。

视频是假的。乌克兰的计算机应急响应小组(CERT-UA)在数小时内完成了鉴定。但它已经在数十万人那里留下了一秒钟的犹豫——而在认知战中,那一秒钟,已经足够了。

“Geroy-3”——俄罗斯的AI认知武器

要理解俄罗斯信息战在2025年的进化程度,需要同时盯住三条平行的故事线。

“Skvozniak行动”

这是一场持续进行的信息操纵行动,专门针对乌克兰能源系统的公开数据:在2025/2026年冬季来临之前,俄罗斯特工系统性地篡改天气预报数据和能源消耗统计,伪造停电预警,试图在乌克兰平民中制造对供暖危机的恐慌。

这不是制造大的假新闻,而是在真实数据中植入精准的错误信息,让任何核实行为都变得极度费力。

“猎户座”僵尸网络

2025年10月,这个由俄罗斯总参谋部情报总局(GRU)在布良斯克地区运营的自动化信息战平台,制造并扩散了一条关于乌克兰第59旅发生叛乱的完整虚假新闻:有具体的军官姓名、有“目击者”证词、有似乎合理的背景叙事。

CERT-UA最终追溯到这是机器生成的军事虚假信息,但在证伪过程完成之前,这条消息已在西方部分媒体的社交账号上获得了大量转发。

“Storm-1516”宏观模式

一个由法国数字安全机构VIGINUM于2025年5月正式确认的俄罗斯信息战平台,自2023年以来已在77次针对法国、乌克兰和西方国家的行动中留下踪迹,背后的协调和融资被认为由GRU的一名官员掌控。

这三条故事线的共同点是:它们都不依赖单一的大型虚假信息炸弹,而是依赖持续的、精准的、成本极低的信息噪音。当每一条信息都只需要几分钟的AI生成时间,信息战就转变为了一种工业化生产。

Deepfake-as-a-Service的黑市生态

而支撑这种工业化生产的基础设施,在2025年已经向所有人开放。

从统计数据来看,变化的速度令人不安。深伪(Deepfake)文件数量从2023年的约50万份飙升至2025年预测的800万份,年均增长率达900%。这不是技术圈的小数字游戏——这意味着每一天,世界上新产生的高质量合成视频、音频和图像数量,比任何人工核查团队能够审核的数量都要多出几个数量级。

更关键的变化发生在供给侧。2025年,深度伪造服务化平台(Deepfake-as-a-Service, DaaS)全面商业化。在暗网市场上,入门级合成身份套件的定价低至5美元,Dark LLM的订阅月费约为30美元。你不需要任何人工智能专业知识——你只需要上传目标对象的照片和几段音频,平台会帮你完成剩下的工作。高保真度的高管模拟视频,市场定价在每分钟几百美元到2万美元不等。

企业层面的危害已经可以量化:根据网络安全公司Cyble的报告,2025年,AI深伪技术参与了逾30%的高影响力企业冒充攻击案例。新加坡也出现了攻击者利用DaaS平台冒充高管、骗取财务团队进行大额转账的真实案例——深伪视频在视频通话中实时运行,肉眼无法分辨。

人类的识别能力正在被这场军备竞赛远远甩在身后:实验数据显示,人类对高质量深伪视频的正确识别率仅为24.5%。也就是说,大约四分之三的时候,人类的眼睛和耳朵会被一个精心制作的假货彻底欺骗。

从菲律宾到美国2026中期选举

2025年5月,菲律宾举行中期选举。赛前分析师已发出警告:该国既没有足够的监管框架,也没有足够的公众媒体素养来应对大规模的AI虚假信息攻击。选举过程中,AI生成的竞选攻击素材大量涌现,其中一些根本无法在传播速度可匹配政治事件节奏的时间窗口内完成核实。

在美国,2025年的纽约市长竞选提供了一个更直观的案例。前州长安德鲁·科莫的竞选团队发布了一段AI生成视频,将对手佐勒·曼达尼置于各类社会混乱场景中,图像包含涉嫌种族主义刻板印象的元素。这段视频在被大量批评后迅速下架,但它证明了一件事:深伪内容作为政治攻击工具的使用,已经从边缘测试转变为主流竞选操作的一部分。

2026年美国国会中期选举的背景下,这一趋势的危险性将进一步放大。目前,美国共有28个州已立法规范政治深伪的使用,多数法律要求AI生成内容必须标注声明。但问题在于生产速度、扩散速度和对手的适应速度,始终领先于立法和执法的响应速度。

检测技术的军备竞赛

检测工具正在快速迭代,但面临着一个内生的结构性困境:生成模型和检测模型本质上是同一技术栈的正反两面,生成能力每提升一步,检测难度就相应加大一级。

目前主流的深伪检测技术路线分为三大方向:基于神经网络特征分析(检测GAN生成图像的统计模式)、基于内容认证(C2PA标准,为数字内容嵌入加密溯源信息)、以及基于生物特征一致性检测(检测视频中脉搏、眨眼频率等微小生理指标的异常)。每一种方法都有已知的规避路径,而CERT-UA等机构积累的快速鉴伪能力,依赖的更多是情报研判而非单纯的技术检测。

欧洲议会2025年报告对这一生态系统进行了系统梳理:从合成媒体的生成谱系,到主要的传播载体和放大机制,再到各国政府的应对现状。报告的核心结论令人清醒:技术检测只能作为防御体系的一部分,它无法独立承担信息真实性验证的全部压力。

认知防御——当国家开始为公民打“心理免疫针”

如何在一个几乎任何人都可以伪造任何人说任何话的世界中维持基本的信息信任体系?

这个问题已经超出了纯粹技术领域,进入了心理学、教育学和社会制度设计的范畴。“预防接种理论”(Prebunking)——即提前让公众了解虚假信息的常见手法,增强心理免疫力——正在成为多个欧洲政府的政策工具。与事后辟谣相比,这一策略的实验性数据表明它具有更持久的效果,因为它改变的是受众的信息处理模式而非单一事件的认知。

立法方向上,美国2025年5月签署生效的联邦TAKE IT DOWN法案(The TAKE IT DOWN Act)提供了针对性侵犯性深伪内容的全国性框架,成为联邦层面首个专门针对深伪的立法。但选举深伪的规制在法律层面仍然复杂,因为它与第一修正案的言论自由保护之间存在无法回避的张力——任何过于宽泛的禁止都可能被法院认定为违宪。

最终,真正值得盯紧的,不是某一项具体技术或法律的进展,而是一个更深层的问题:当深伪生产的边际成本趋近于零时,“看到即相信”这一人类最古老的认知机制,是否还能作为公共信任体系的基础?这种新型的安全挑战,正在引发全球技术社区和政策制定者的广泛讨论。对于关注前沿技术动态的开发者来说,这不仅是资讯,更是一个关于未来数字世界信任基础的深刻命题。