NVIDIA不仅为全球提供了驱动AI浪潮的强劲GPU,其自身也在内部大规模应用AI,尤其是在核心的GPU芯片设计流程中。

NVIDIA首席科学家Bill Dally在与谷歌首席科学家Jeff Dean的对话中透露,NVIDIA已将AI深度融入芯片设计流程,覆盖了从设计探索、标准单元库开发到Bug处理和验证等多个关键阶段。

不过,他同时也强调,要实现完全端到端的自动化芯片设计仍然为时过早,至于何时能够实现,他并未给出明确预言。

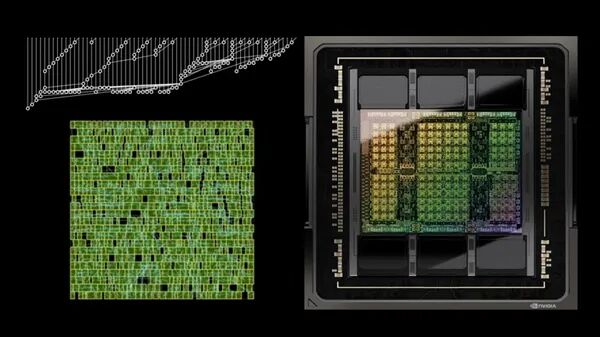

Dally分享了一个具体案例,展示了AI如何显著提升效率。过去,将标准单元库迁移至全新制程工艺需要一个由8名工程师组成的团队,耗费整整10个月的时间,相当于80个人月的工作量。

如今,情况截然不同。NVIDIA内部研发的、基于强化学习原理的工具NB-Cell,在经过两到三代的迭代后,如今仅需一块GPU显卡运行一个晚上,就能完成上述全部迁移工作。

更关键的是,由AI工具生成的单元在面积、功耗和延时等核心性能指标上,均达到甚至超越了人工设计的水平,这使得采用新工艺的速度得以大幅提升。

Dally还提到了另一款内部工具Prefix RL,它专门用于解决一个长期存在的设计难题——进位超前链中的超前级布局。他声称,AI工具生成的布局方案是“人类工程师永远无法想到的”,并且在关键性能指标上比人工设计高出20%至30%。

这表明,NVIDIA应用AI的目标不仅仅是为了提升效率和节省成本,更是为了探索那些超出人类工程师常规直觉与经验的、更优的设计方案。

在更宏观的层面,Dally透露,NVIDIA已在内部部署运行了两款经过微调的大语言模型:Chip Memo和Bug Nemo。这些模型基于NVIDIA多年积累的专有数据(包括RTL代码和架构文档)进行训练。

它们带来的一个直接收益是,当初级工程师遇到问题时,可以直接向大模型提问并获得解答,无需再频繁打扰资深设计师,后者因此可以更专注于高价值的设计工作。同时,这些模型还能协助汇总Bug报告,并将其智能分配至对应的模块或负责工程师。

值得一提的是,NVIDIA似乎并未因为AI工具带来的效率提升而裁减初级员工。相反,公司正通过这种更高效的知识传递与辅助方式,加速他们的成长。相比于一些企业急于用AI替代人力的做法,这或许展现了AI技术在提升生产力与促进人才发展之间更为平衡的应用之道。

对这类人工智能与硬件设计结合的前沿实践感兴趣?欢迎在云栈社区继续交流探讨。 |