我相信很多人是这两年才开始频繁听到嵌入式AI、边缘AI、边缘计算、TinyML 等词汇,于是容易产生一种错觉:这是不是一个刚出现的新方向?

其实不是。TinyML 的底层基础几年前就已经具备了。

2018年,ARM就发布了面向Cortex-M的CMSIS-NN;

2021年,TensorFlow已经在讲TFLM与CMSIS-NN 的结合;

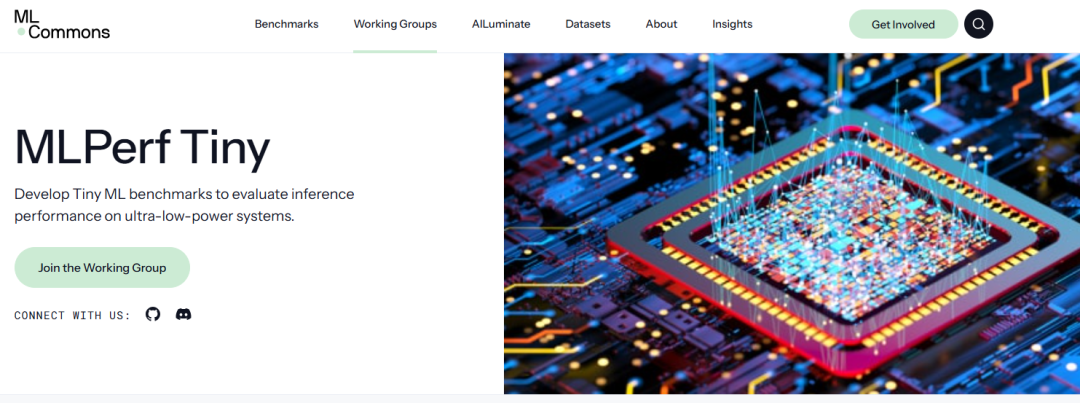

同一年,MLCommons 还推出了专门面向超低功耗嵌入式设备的 MLPerf Tiny 基准测试。

也就是说,TinyML 不是现在才有,而是现在才真正进入“从小圈子技术到产品级话题”的阶段。真正的原因,不是 TinyML 这几个字突然变热了,而是它背后的几件事,最近两年同时成熟了。

1. 以前是“能跑一个 Demo”,现在是“产品真的需要它”

前几年,大家讨论TinyML,更多是在证明一件事:模型能不能塞进 MCU,能不能本地跑起来。

但现在,产品端问的问题已经变了。不是“能不能跑”,而是“能不能在本地低时延、低功耗、低带宽成本地跑”。

Google 现在把 LiteRT定位为面向边缘设备的高性能本地 ML 与 GenAI 部署框架,强调低时延和高隐私;

NXP 在 2024 年发布 i.MX RT700 时,也直接把需求写得很明确:边缘 AI 设备一边需要更多算力,一边又大量是电池供电,必须降低功耗。这说明 TinyML 现在爆火,首先不是因为概念更新,而是因为产品约束终于逼着大家认真做端侧智能。

说得更直白一点:以前做 MCU+AI,很多时候是加分项;现在做很多边缘产品,本地智能已经开始变成基本能力。语音唤醒、异常检测、人体存在检测、简单视觉触发,这些都不再适合把原始数据全扔到云端再说。

2. 真正把 TinyML 推热的,不是论文,而是AI MCU和NPU开始集体落地

TinyML 早就有,但过去很长一段时间里,它更像“在资源边缘挣扎地跑小模型”。而最近两年,情况明显变了:芯片厂商开始把 AI 加速能力真正做进 MCU 产品线。

- ST 的 STM32N6 已经把“在 MCU 上运行更复杂神经网络、支持实时处理”写成产品主卖点;

- NXP 的 i.MX RT700 则把 eIQ Neutron NPU 直接集成进 crossover MCU,官方给出的数据是最高可实现 172 倍 AI 加速、最高 119 倍单次推理能效提升,并且把片上超低功耗 SRAM 提到 7.5MB。

- 瑞萨电子推出无缝AI和Tiny ML应用设计解决方案

有兴趣的同学可以看一下下面新浪财经头条的新闻:【巨头涌入TinyML赛道:边缘AI即将迎来新爆发】

这个变化其实非常关键,因为这意味着 TinyML 不再只适合关键词唤醒这类极小任务,而是开始具备承载更复杂端侧模型的硬件基础。这个趋势正是 云原生 与底层硬件能力协同演进的体现,更多关于 IaaS 与边缘计算的深度讨论,可以在 云原生/IaaS 板块找到。

所以,现在这波热度,本质上是 硬件跨过了一道门槛。

以前大家讨论 TinyML,常常是在“极限压缩”;

现在大家讨论 TinyML,开始进入“怎么把它做成真正可卖的产品”。

3. 工具链成熟,才是它从研究话题变成工程话题的关键

一个技术能不能火,光有芯片还不够。还得看普通工程师能不能做。这一点,最近两年变化也很明显。

- Google 的 LiteRT for Microcontrollers 明确说明,核心运行时可以压到 16KB,且不依赖操作系统、标准 C/C++ 库和动态内存分配;

- Arm 也持续把 CMSIS-NN 定位成面向 Cortex-M 的高效神经网络内核,用来提升性能并降低内存占用。

也就是说,TinyML 现在不再只是“理论可部署”,而是已经有了一套可复用、可移植、可工程化的基础软件栈。更重要的是,厂商和平台开始把门槛继续往下压。

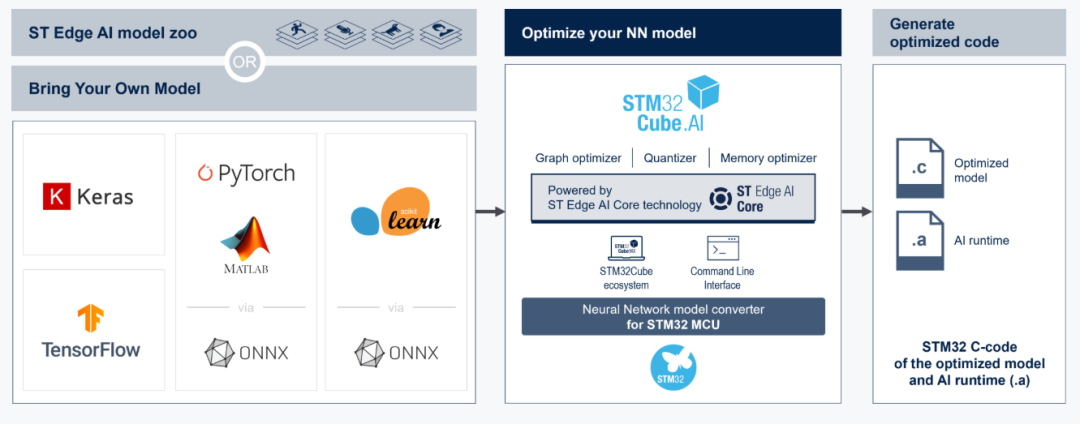

- ST 提供免费的 ST Edge AI Developer Cloud,直接支持模型创建、优化和 benchmark;

- Edge Impulse 的 EON Compiler 能把模型编译成硬件优化过的 C++ 源码,并宣称最高可节省 65% RAM。

对嵌入式工程师来说,这种变化非常重要:过去你得先是算法工程师,才能玩 TinyML;现在你更像是在学一套新的嵌入式工具链。 要深入理解这套工具链背后的原理,掌握 计算机基础 知识至关重要,比如编译器和系统层面的优化,欢迎到 计算机基础 板块交流学习。

这也是为什么现在开始“爆火”。不是因为技术突然变简单了,而是因为它第一次变得足够可用、足够可学、足够可复制。

4. 有了基准,行业才会认真投入

技术圈常有一个规律:没有基准的时候,大家都说自己能跑;有了基准之后,行业才开始真正比较、采购、投入。

MLCommons 在 2021 年推出 MLPerf Tiny 时,就已经把它定义为首个面向嵌入式设备的 ML 推理基准;到了 2025 年发布 v1.3 结果时,已经有 70 个测试结果、27 个功耗结果,并首次覆盖了 5 个新硬件平台。

这个信号非常明确:TinyML 已经不只是“有人在玩”,而是开始进入可衡量、可比较、可竞争的阶段。

一旦进入这个阶段,厂商、平台、开发者社区都会加速。因为大家终于可以围绕同一套语言说话:延迟多少,功耗多少,模型多大,平台表现如何。

这才是一个方向真正出圈的前提。

5. AI 大热只是导火索,但它确实把 TinyML 推出了小圈子

还有一个不能忽略的现实:这两年整个 人工智能 话题本身就在升温,而这股热度也直接外溢到了端侧和边缘侧。关于大模型、Agent等前沿 AI 技术的探讨,可以参考 人工智能 板块。一个很明显的信号:

- tinyML Foundation 现在已经更名为 Edge AI Foundation;它不仅公开把“从 tinyML 走向 Edge AI”写在首页,还专门成立了 Generative Edge AI Working Group,明确讨论生成式模型如何在资源受限、低功耗、分布式环境下落地。

- Qualcomm 在 2025 年宣布收购 Edge Impulse,也说明端侧 AI 工具链已经不再只是小众开发平台,而是大厂 IoT 与 AI 战略的一部分。

这意味着什么?意味着 TinyML 的热度,确实吃到了这轮 AI 大趋势的红利。但它不是单纯蹭热点。

真正让它站住的,仍然是前面那几件事:硬件能承载了,工具够成熟了,产品真需要了,行业也能衡量了。

6. 结尾

所以,TinyML 这波爆火,不是因为它突然诞生了。而是因为它终于完成了从“技术可行性验证”到“产品化基础设施”的跨越。

几年前:TinyML 解决的是一个问题:MCU 上到底能不能跑机器学习。

现在:TinyML 解决的是另外一个问题:在功耗、成本、隐私、时延都很敏感的边缘产品里,AI 到底该怎么真正落地。

这就是它为什么是“老方向”,却在现在突然变得这么热。对这类技术趋势的讨论和分析,欢迎来 云栈社区 与更多开发者交流。