你有没有想过,为什么同样是 AI 编程工具,Claude Code 用起来感觉就是更“稳”一点?

这种稳定感,不是指它的代码一次性写得有多完美——那更多是模型能力的体现。它真正的优势在于行为可预测:任务不容易跑偏,上下文能保持连贯,出了问题知道怎么恢复。

归根结底,这背后不是模型的魔法,而是一套经过深思熟虑的工程设计。如果你也尝试在项目中集成或使用AI工具,理解这套设计的思路会非常有用,尤其适合那些关心系统设计与AI工程化实践的开发者们。

简单来说,它的核心逻辑就一句话:模型本身是不稳定的,系统必须围绕不稳定部件来设计。

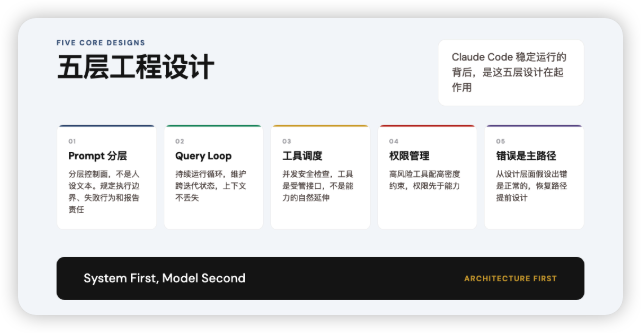

核心五层工程设计

让我们具体拆解一下,这套工程结构由五个关键层面构成:

1. Prompt 是分层的控制面,不是人设文本

很多人把 Prompt 理解为“你是一个什么样的助手”这种角色设定。但在 Claude Code 的设计中,Prompt 的作用远不止于此。它更像是一份运行时协议。

在它的源码 src/constants/prompts.ts 里,Prompt 被清晰地分层:

- 身份与总任务是一层,定义核心职责。

- 工具、权限、系统提醒是另一层,规定能做什么、不能做什么。

- 任务执行的工程约束又是一层,比如输出格式、失败处理逻辑。

这种结构化的 Prompt 分层 机制,规定了执行的边界、失败时的行为以及报告责任的路径。它不再是模糊的“文案”,而是一个有明确框架的“宪法”,你可以在其规则内发挥,但不能绕过它的基本结构。

2. Query Loop:维护跨迭代状态的持续循环

多数对话式 AI 工具,每次对话都是独立的。关闭窗口重开,历史就没了。Claude Code 则不同,它内部运行着一个 Query Loop。

这个循环的核心是维护跨迭代状态,包括:

- 消息历史

- 工具使用记录

- 上下文预算管理

- 恢复与重试计数

这意味着,它承认一个基本事实:上一轮的问题和进展会延续到下一轮。例如,让它分析一个代码仓库,它会分多轮进行:第一轮看结构,第二轮读逻辑,第三轮发现问题,第四轮修复。状态在轮次间传递,任务是在持续推进,而不是每次都从头开始。

很多 AI 工具感觉“不稳定”或“健忘”,恰恰是因为缺乏这种维持状态的机制。

3. 工具调度:并发控制与安全执行

Claude Code 能够调用各种工具,如读写文件、执行 Bash 命令、搜索网络等。但关键不在于它能调用,而在于如何调用。

这里有一个专门的工具调度层,负责对工具调用进行分组,判断哪些可以并发执行,哪些必须串行,并严格按顺序调度。

为什么需要这个?不受约束的并发会放大事故半径。 想象两个工具同时写入同一个文件会怎样?调度层通过串行化执行,有效避免了这类竞态条件。

所以,工具并非模型能力的简单延伸,它们是受管理的执行接口。

4. 权限管理:权限先于能力

这是最容易被忽视,却也至关重要的一层。Claude Code 对 Bash 这类高风险工具,设置了额外的、高密度的权限校验。

Bash 可以直接操作文件、进程、网络和 Git 仓库,一旦出错,后果可能是不可逆的。因此,代码中对 Bash 的使用写了近乎一页的详细“操作规约”:不要随意改动 git config、不要跳过 hooks、不要一键 git add .、不要默认执行 push 等等。

这种做法看似琐碎,但其理念是:高风险能力必须匹配高密度约束。它没有想当然地认为模型是一个“有天然授权”的执行者,而是坚持 “权限先于能力”。

5. 错误是主路径:将失败视为常态进行设计

这是最反直觉也最体现工程思维的一层。大多数系统在设计时,把“正常流程”作为主路径,把“错误处理”当作附加的补丁。

Claude Code 的思路恰恰相反:从一开始就假设出错是正常的、必然会发生的事情。

- 上下文会爆满(达到 token 上限)。

- 输出会被意外截断。

- 工具调用会失败。

- 用户会中途打断。

这些不是“出了什么问题”,而是系统正常工作时就存在的、必须被处理的路径。因此,它预先设计了明确的恢复机制:输出截断了如何续接、达到上限如何优雅中止、出现问题如何回退到上一个正确状态。

在这里,错误路径就是主路径。它不是事后的补救措施,而是架构设计的核心组成部分。

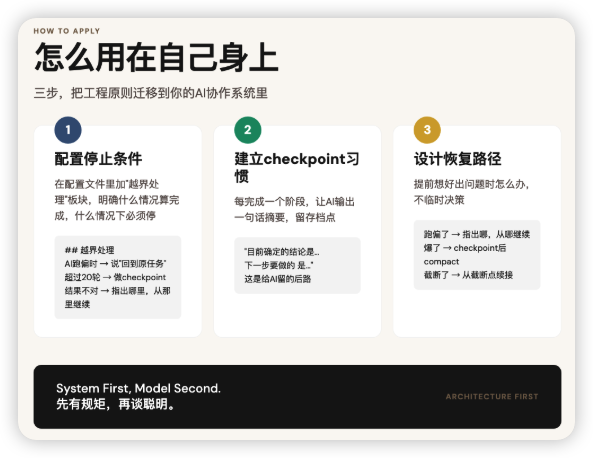

如何将这些原则应用到你的AI协作中?

理解了Claude Code的工程哲学,我们完全可以把这些原则迁移到日常与AI协作的过程中。这能显著提升你使用任何AI工具(如ChatGPT、Claude等)的效率和稳定性。

第一步:为你的任务配置明确的“停止条件”

不要只有一个模糊的目标。在你给AI的指令文件(如 CLAUDE.md 或项目说明)中,明确增加一个“越界处理”和“任务停止条件”板块。

例如:

## 越界处理

- 当AI开始跑题时 → 要求它“回到原任务”。

- 当对话轮次超过20轮 → 要求“暂停,先输出当前进度的总结(checkpoint)”。

- 当结果明显错误时 → 指出具体错误点,并要求“从这里继续修正,不要重头开始”。

## 任务停止条件

在任务开始前,就定义清楚:

- 完成标准: 产出物必须包含哪些具体元素?(例如:一个函数,附带单元测试和简要注释)

- 停止边界: 最多尝试多少轮?遇到何种不可解问题时应中止?

第二步:养成建立 Checkpoint 的习惯

在完成每一个阶段性目标后,主动让AI输出一句话总结,作为 Checkpoint。

“目前我们确定的结论是:……。下一步计划是:……。”

这个Checkpoint是给AI(也是给你自己)的“存档点”。当后续对话上下文被压缩或重置时,你可以直接提供这个Checkpoint,让AI快速恢复到之前的状态,避免一切从头开始。

关键点:Checkpoint 应记录结构化结论和下一步计划,而非感受或过程描述。

第三步:预先设计恢复路径

不要等到问题发生时才手忙脚乱地想办法。在任务启动前,就想好应急预案:

- 如果AI跑偏了怎么办?

预案: 明确指出它从哪里开始偏离,告知正确的方向,并要求从偏离点继续。保留已确认正确的部分。

- 如果上下文快满了怎么办?

预案: 主动触发总结(compact),输出当前进度的Checkpoint,然后基于这个精简的上下文继续。

- 如果输出被意外截断了怎么办?

预案: 提示AI“继续从上一条消息的结尾开始写”,而不是重新生成整个内容。

最后的思考

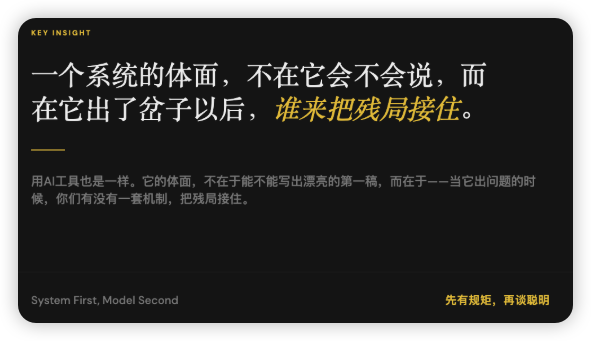

Claude Code 的案例揭示了一个深刻道理:一个系统能否稳定运行,关键不在于它所集成的组件(如AI模型)有多强大,而在于它是否拥有一套精良的工程结构来管理这些组件固有的不稳定性。

一个成熟的、值得信赖的系统,其标志不是它永远不出错,而是它清晰地知道:何时不该开始,何时应该重试,何时必须中止,以及如何准确地向用户报告失败。

我们在云栈社区讨论技术时也常提这个观点。最终,衡量一个AI工具(或任何引入AI能力的系统)是否“体面”,不在于它能否一次性给出惊艳的初稿,而在于当它不可避免地出错时,你和它之间是否有一套默契的“机制”,能够稳稳地接住残局,从容恢复。

System First, Model Second.

先有规矩,再谈聪明。