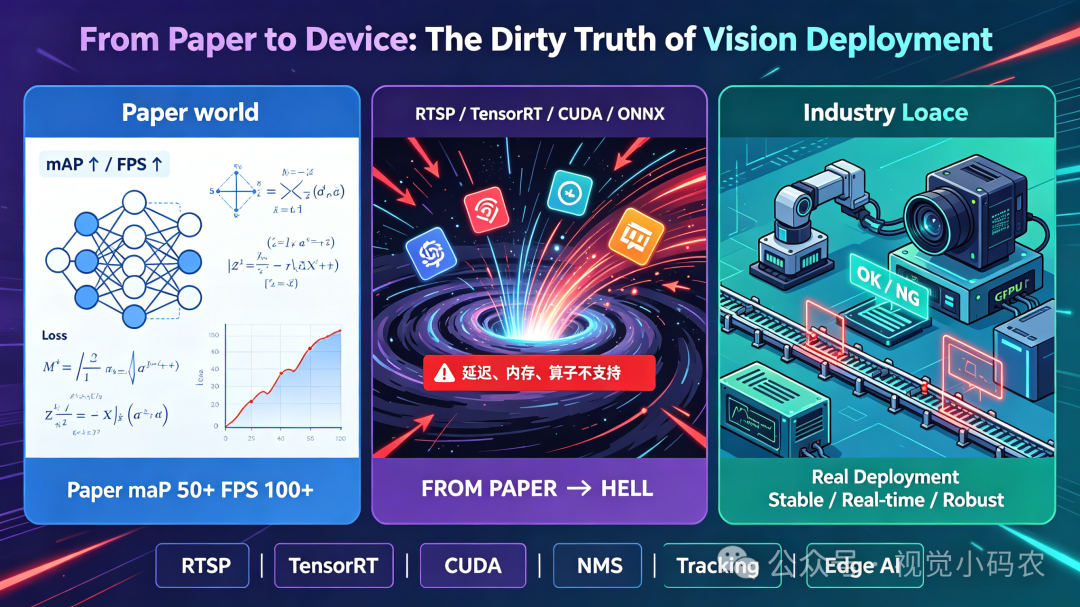

这几年深耕人工智能领域,尤其是计算机视觉方向,最深的体会莫过于:模型训练只是开始,真正让人头疼的是把算法落地到实际设备上。

Paper里动辄mAP 50+、FPS 100+的模型,放到工业场景里,往往会遇到一堆现实问题:RTSP视频流怎么稳稳拉进来?前后处理怎么做到实时?不同硬件平台的算子支持不一致怎么办?内存对齐、功耗、延迟、精度掉点……每一项都可能把你卡得死死的。

视觉算法的工业部署,远比大多数人想象的要脏、要累、要深。它不仅仅是把PyTorch模型转成ONNX那么简单,而是需要你同时掌握上层算法理解、框架设计思想、编译优化技术,以及对不同硬件backend的深刻认知。很多时候,你还得亲自手写C/C++、CUDA kernel,甚至针对特定硬件从零搭建整个推理pipeline。

一、部署为什么这么难?

工业部署的核心难点在于 “端到端”闭环:

- 输入端: 实时视频流(RTSP/GB28181)、图像预处理、解码加速

- 模型推理: 算子支持、融合、量化、内存优化、自定义算子

- 后处理: NMS、跟踪(Kalman + Hungarian)、轨迹管理、结果封装

- 输出端: UDP/TCP推送、显示、与其他系统对接

- 硬件约束: 实时性(real-time)、功耗、成本、不同平台(NVIDIA GPU、Jetson、华为Atlas Ascend、移动端ARM、FPGA等)

这些环节任何一个出问题,整个系统都跑不起来。而解决这些问题,靠的往往不是高端算法,而是大量脏活累活(dirty work):手写前后处理、调试内存对齐、写TensorRT plugin、针对硬件调schedule、甚至手写部分汇编级优化。

二、想快速掌握部署能力,应该怎么学?

如果你想系统提升视觉算法的落地能力,建议按以下三个层面逐步深入:

1. 深度学习框架层面(打牢上层基础)

先把常用框架的底层设计吃透,尤其是算子如何在CPU/GPU上实现。

- 重点阅读 Caffe 的源码,理解其CPU和CUDA op的实现方式,这是很多早期框架的设计蓝本。

- 对比学习 MXNet 的Symbol接口设计,体会其在灵活性和调度上的优势。

- 熟练使用 MMDetection、Detectron2 等现代检测框架,修改源码,观察算子融合、数据加载优化等细节。

- 掌握 ONNX 作为模型中间表示的转换流程,这是跨框架部署的桥梁。

目标:知道每个网络层(layer)的feature map如何存储、输入输出如何流动、哪些操作容易成为瓶颈。

2. 深度学习编译器层面(连接模型与硬件的桥梁)

编译器是实现高效部署的关键工具,能帮你自动完成很多图优化和代码生成工作。

- 核心推荐学习 Apache TVM:

- 理解完整的编译流程:模型导入 → Relay IR → TVM IR → 图优化(算子融合、data layout转换等)→ 不同backend的codegen

- 熟悉AutoTVM / Ansor 等自动调优机制

- 尝试手写简单的schedule和template,体会design space搜索的思路

- 辅助了解 Glow 在量化(quantization)工具链上的做法,特别是profile-guided量化。

- 学习传统编译器知识,如LLVM在codegen中的作用。

掌握编译器后,你就能在不同硬件上更高效地优化模型,而不只是依赖框架自带的export功能。

3. 模型部署与硬件适配层面(最实战、最dirty的部分)

这是真正拉开差距的地方,必须针对不同硬件平台进行针对性练习。

NVIDIA GPU / Jetson系列:

- 深入学习 CUDA 编程(kernel编写、内存管理、stream并行)

- 熟练使用 TensorRT:模型转换、动态shape、plugin编写、前后处理加速(手写CUDA kernel替代OpenCV)

- 推荐配合 DeepStream 处理视频流 pipeline

- 学习 NVIDIA Triton Inference Server 做模型服务化部署

移动端 / 边缘CPU/GPU:

- 重点学习 MNN(阿里),其profiling和可视化工具非常优秀,适合研究code design

- NCNN(腾讯),轻量、无第三方依赖,适合手机和嵌入式极致优化

- 尝试混合后端优化,例如检测部分用TensorRT,识别部分用MNN Vulkan后端 + 多线程

华为Atlas Ascend系列:

- 掌握 CANN 工具链和MindStudio

- 模型转换为.om格式,搭建完整C++推理pipeline

- 很多自定义前后处理(FFmpeg拉流、RPN处理、proposal转换、跟踪算法等)都需要手写

FPGA等其他硬件:

- 了解 HLS、OpenCL、Verilog 的基本使用

- 很多场景下,直接手写HDL代码带来的加速,比自动工具翻译更显著(类似ARM上手写汇编)

通用优化技巧:

- 模型压缩:PTQ/QAT量化、结构剪枝、知识蒸馏

- 性能分析:Nsight Systems、cuda-gdb、MNN profiler 等工具

- 内存优化、对齐、算子融合、多线程/多进程调度

三、底层内功:长期提升的关键

想把部署能力真正练扎实,不能只停留在工具使用层面。建议系统补齐以下基础:

- 编译器原理: 理解IR、优化pass、codegen

- 计算机体系结构: Cache、内存层次、并行架构、异构计算

- 并行计算: CUDA、OpenMP 等编程模型

- C++ 高级编程: 内存模型、模板元编程、智能指针、性能优化

- 网络/系统: 深入理解操作系统、内存管理、网络协议(尤其是视频流传输)

前提是对上层深度学习算法要有扎实理解:每个layer的计算逻辑、feature的存储方式、软件加速点在哪里、哪些地方需要硬件co-design。

四、最后一点现实建议

部署能力很难通过纯自学“纸上谈兵”练成。最快的成长路径,通常是:

- 有一个严格、经常push进度、且自己也在写代码的leader

- 接到真实的业务需求和紧迫的DDL

- 在具体硬件平台上反复踩坑、调试、优化

没有这样的环境,就主动创造条件:买一块Jetson Nano或Atlas开发板,从部署一个简单的YOLO模型开始,逐步加上实时视频流、多目标跟踪、自定义前后处理等复杂环节。每次遇到问题都深挖到底,而不是止步于“能跑”。

视觉算法的落地,本质是一门需要大量工程实践的手艺活。Paper再漂亮,如果落不到设备上、跑不出实际价值,就只是空中楼阁。

坚持把脏活累活干下来,你会发现自己的技术栈厚度会远超同龄人。如果你在学习和实践过程中遇到了具体的技术难题,或者有独到的部署经验,欢迎到 云栈社区 的相关板块与大家交流探讨。

|