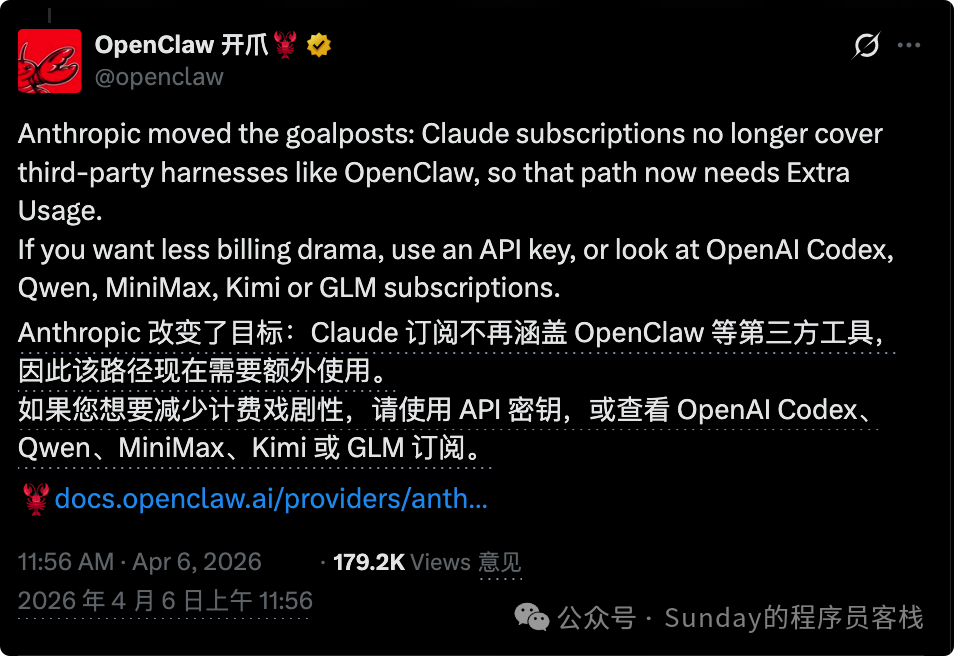

最近,Anthropic公司宣布调整Claude的使用政策,核心变化是:Claude订阅用户的额度,将不再覆盖OpenClaw这类第三方AI智能体(Agent)工具。 如果想继续通过它们使用Claude,用户需要单独为所产生的使用量付费。

这消息一出,不少用户的第一反应很简单:这不就是变相涨价吗?

确实,从用户支出的角度看,成本确实增加了。要理解这一点,得先看看当前大模型常见的两种付费模式:

- 按月订阅制:最典型的是OpenAI的GPT Plus,每月固定费用(如20美元),可在官方平台(如ChatGPT网页)内“无限”使用,并通常包含一定量的API调用额度。这种模式对普通、间歇性的聊天和轻量辅助非常友好。

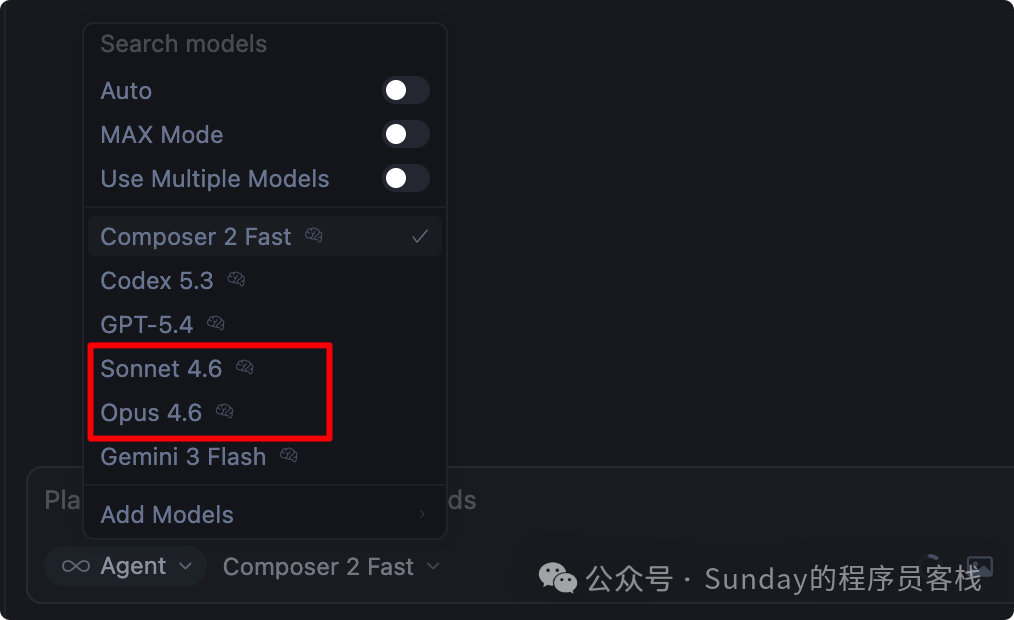

- 按量付费制(Token计费):许多第三方工具或API直接调用采用此模式。例如,在Cursor这类代码编辑器中选择Claude的Opus或Sonnet模型,系统会根据每次交互消耗的输入和输出Token数量计费。

关键在于,按量付费的成本远高于固定订阅制。我们来看看Claude官方的按量价格表示例:

光看数字可能不够直观,这里有个更具体的参考:使用Claude完成一个约700行代码的功能开发或修改,所消耗的Token费用折合人民币可能在3到7元左右。如果一个开发者日常重度使用,日均成本达到百元人民币级别也并非不可能。

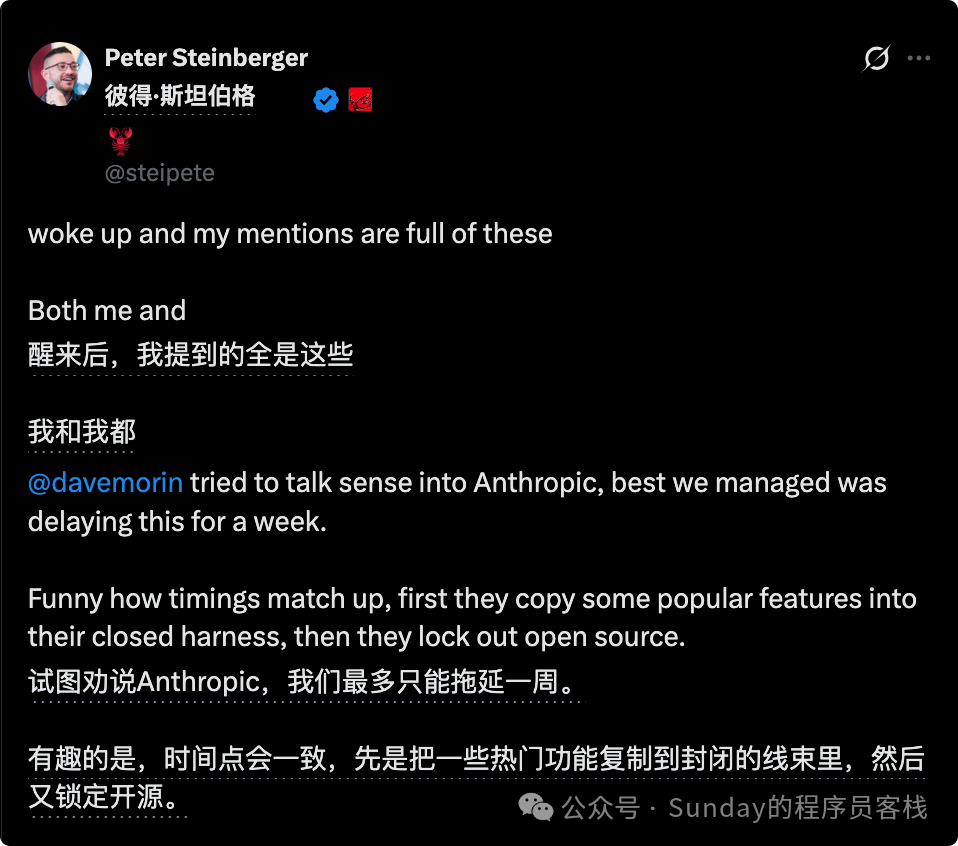

这个开销对个人开发者而言,显然算不上便宜。因此,连OpenClaw的创始团队成员也对此事表达了无奈。

然而,如果我们仅仅把这件事看作一次简单的“涨价”,那或许看得不够深入。更本质的理解或许是:一旦AI开始像真实员工一样持续、高强度地工作,它就不可能永远以“会员畅享”的固定价格提供服务。

这话听起来有点冷酷,但反映了一个现实:你很难用一份“健身房月卡”的钱,雇到一个全天候为你工作的“私人教练”。

目前,受影响的用户仍有一个短期解决方案:在OpenClaw等工具中切换使用其他尚未做出类似限制的大模型。

但冷静想想,这恐怕只是个缓兵之计。今天可以把Claude换成其他模型,明天其他模型厂商也可能跟进类似策略。

过去我们使用AI编程工具,某种程度上是在享受“平台补贴”。你每月支付一笔固定的订阅费,却可以让AI帮你反复阅读代码、修改逻辑、运行测试、修复Bug,进行多轮迭代。站在用户角度,这体验自然极佳。

但站在模型厂商的角度,这笔账是算不过来的。因为普通的对话交互与让Agent执行任务,二者的资源消耗完全不在一个量级。

- 你问一句“解释这段代码”,模型可能只需读取几百行上下文并生成一个回答。

- 但你让一个AI编程智能体去实现一个功能,它可能需要:理解整个项目结构、检索相关文件、分析模块依赖、编写或修改代码、执行测试、分析报错信息、进行多次修正和重试,最后输出总结报告。

这一整套流程下来,消耗的Token量可能是普通问答的几十甚至上百倍。那么问题来了:如果所有这些高消耗任务都被打包进一个固定的月费里,长期来看,谁来承担这巨大的成本差额?

短期靠补贴,长期则必然面临三种选择:限制使用量、降低服务质量,或者像现在这样,对高负荷场景单独收费。

这引申出一个值得思考的问题:当前许多团队正将AI编程深度融入工作流(Vibe Coding),如果你的整个开发流程高度依赖某一特定模型、某一种订阅方式或某一个工具入口,那么潜在的单一依赖风险其实相当高。

AI并没有让成本消失,它只是将一部分人力成本,转化为了更显性的算力成本和Token成本。

因此,对于Claude这次的调整,我的判断是:短期内用户抱怨不可避免,因为实际使用成本确实增加了。但长期来看,这大概率不会是个孤立事件。未来,所有大模型厂商都会越来越清晰地区分不同使用场景的成本阶梯:

- 普通聊天对话

- 轻度辅助与问答

- 由智能体(Agent)执行的连续性、多步骤任务

- 将模型接入生产级自动化工作流

这几种场景的价格,不可能永远保持一致。

说到底,“廉价”的AI智能体可能从来就不是一种常态。 过去一段时间,我们享受的是模型厂商为抢占市场而提供的“补贴价”。如今补贴开始收缩,真实的商业成本才逐渐浮现。

这并不意味着AI编程工具不再值得使用。恰恰相反,随着能力提升,它的价值会愈发凸显。只是我们不能再抱着“会员制无限畅用”的旧有心态来看待它。未来,真正擅长利用AI的人,或许不是那个无脑将所有任务抛给最昂贵模型的人,而是懂得在合适场景、选择恰当工具、并精准控制成本的人。

AI编程的下半场,竞争点可能不止于模型能力本身,还将包括任务拆解、工具链整合与成本优化的综合能力。

大家如何看待这次调整以及AI工具未来的付费模式?欢迎在云栈社区的开发者板块一起交流探讨。