在当前 AI 智能体技术快速演进的背景下,越来越多团队开始构建具备自主决策、多步骤协作能力的 AI 系统。然而,框架选型往往成为项目早期的关键瓶颈。

我们团队曾评估并实践过 AutoGen、MetaGPT、Coze、Dify 等主流方案,也尝试过基于 LLM API 自研流程引擎。最终,在多个生产级项目落地后,我们将技术栈统一至 LangGraph。

本文不谈概念炒作,只从工程落地角度,分享我们选择 LangGraph 的核心考量。

一、主流智能体开发路径的实践反思

这类框架以“多智能体协作”为卖点,通过角色定义实现任务分工,在原型验证阶段效率较高。

但我们在实际使用中发现其局限性:

- 状态管理缺失:会话状态分散在各 Agent 实例中,难以统一追踪与恢复。

- 执行流程不可控:对话式交互依赖

initiate_chat,缺乏显式流程控制,无法支持复杂分支或并行。

- 调试困难:运行过程缺乏结构化日志,问题排查依赖 print 和重试。

- 扩展性差:新增节点或修改流程需重构大量代码,不符合模块化设计原则。

结论:适合研究验证,难以支撑长期迭代的生产系统。

2. 可视化低代码平台:Coze / Dify

此类平台通过图形化界面降低使用门槛,适用于标准化场景如客服问答、知识库检索。

但我们评估后认为其不适合企业级应用:

- 功能边界受限:仅支持平台预置的组件与插件,自定义能力弱。

- 集成成本高:与企业内部系统(如 ERP、CRM)对接需额外开发中间层。

- 数据合规风险:敏感业务数据需上传至第三方服务,不符合安全审计要求。

- 可观测性不足:缺乏细粒度的执行追踪与性能分析工具。

结论:适用于轻量级应用或外部服务集成,不适合核心业务系统。

3. 编程辅助工具:Cursor / Claude Code

这类工具聚焦于代码生成与重构,在开发效率提升上有显著价值。

但它们的本质是“增强型IDE助手”,而非“智能体运行时”。其局限在于:

- 不提供流程编排能力;

- 无法管理长期运行的状态;

- 缺乏多智能体协同机制。

因此,它属于开发工具链的一环,而非系统架构选型的候选。

二、LangGraph 的核心优势:面向生产的设计哲学

LangGraph 并非一个“智能体框架”,而是一个基于图的状态机运行时。它的设计目标明确:支撑复杂、可靠、可维护的 AI 驱动工作流。

我们选择它的主要原因如下:

1. 显式的流程建模能力

LangGraph 采用有向图(Directed Graph)描述智能体行为,节点代表处理单元,边代表状态转移。

from langgraph.graph import StateGraph, END

class AgentState(TypedDict):

messages: Annotated[list, add_messages]

current_task: str

context: dict

graph = StateGraph(AgentState)

graph.add_node(“planning”, planning_node)

graph.add_node(“execution”, execution_node)

graph.add_node(“review”, review_node)

graph.set_entry_point(“planning”)

graph.add_edge(“planning”, “execution”)

graph.add_conditional_edges(“execution”, should_review, {True: “review”, False: END})

graph.add_edge(“review”, END)

这种设计带来的优势:

- 流程逻辑清晰,新人可快速理解系统架构;

- 支持条件跳转、循环、并行等复杂控制流;

- 易于做流程变更与功能扩展。

2. 强大的状态管理机制

LangGraph 将整个执行过程的状态集中管理,支持:

- 状态持久化:通过 Checkpointer(如 PostgreSQL、Redis)保存执行快照,支持断点续跑。

- 会话隔离:每个会话(thread)独立存储,避免状态污染。

- 状态合并策略:通过 Annotated 定义字段更新规则。这使得系统具备了处理长时间运行任务的能力,例如跨天的任务审批、多轮调研报告生成等。

3. 内建的生产级能力

LangGraph 在设计上充分考虑了企业环境的需求:

▶ 并发与异步支持

async def batch_invoke(inputs):

return await asyncio.gather(*[app.ainvoke(inp) for inp in inputs])

▶ 错误处理与重试

支持配置重试策略、超时控制、人工干预中断:

app = graph.compile(

checkpointer=PostgresSaver(...),

interrupt_before=[“manual_approval”]

)

▶ 可观测性

与 LangSmith 深度集成,提供:

- 全链路追踪(Trace);

- 节点级耗时、Token 消耗统计;

- 错误堆栈与输入输出快照;

- A/B 测试与评估指标管理。

- 这些能力在故障排查、性能优化、合规审计中至关重要。

4. 架构开放,易于集成

LangGraph 不绑定特定模型或工具,支持:

- 多模型供应商(OpenAI、Anthropic、本地部署模型);

- 自定义工具调用(Tool Calling);

- 外部系统集成(数据库、API、消息队列);

- MCP(Model Context Protocol)扩展。

三、适用场景建议

在AI迅猛发展的今天,选择合适的开发框架,本质上是在选择一条技术成长的路径。

- 如果只是想快速体验AI智能体,轻松上手:

Coze、Diffy 就已足够。

- 如果希望构建稍具灵活性的智能体,并快速验证想法:

AutoGen 或 Coze 是不错的选择。

- 如果专注于编程辅助场景:

Cursor 也许就能满足需求。

然而,如果你的目标是:

✅ 打造真正可落地的企业级AI应用

✅ 掌握深层次的AI系统开发能力

✅ 在AI浪潮中抢占技术先机

✅ 为未来的职业发展构筑核心竞争力

那么,LangGraph 几乎是不可替代的终极选择。

是的,它的学习曲线陡峭。

是的,它对初学者并不友好。

是的,许多机制初看如同“黑盒”。

当人人都在追逐热点、依赖封装好的工具时,选择 LangGraph 意味着你选择了一条更难,但更具远见的路。当别人被框架局限时,你已拥有构建任意复杂智能系统的底气。

这,就是我为何坚定选择 LangGraph 作为技术底座的原因。这种对工程细节的掌控力,也是我们在 云栈社区 中与开发者们分享和交流的核心价值之一。

四、完整代码参考

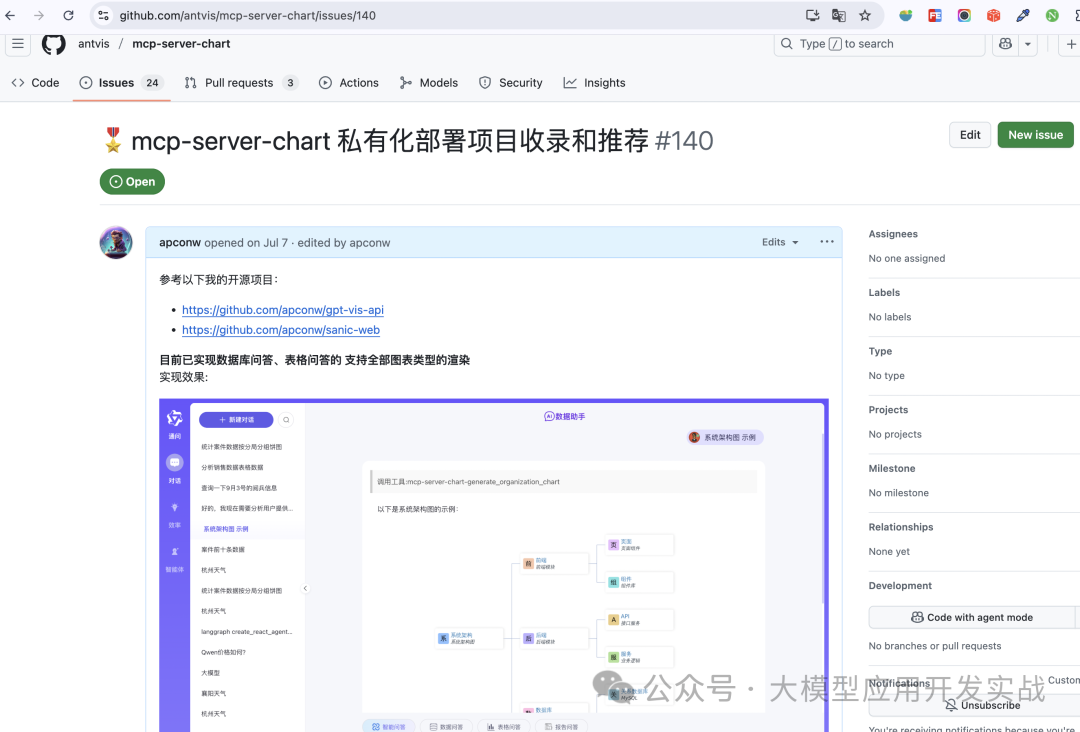

参考我的开源项目: git@github.com:apconw/sanic-web.git

项目亮点

- ✅ 集成 MCP 多智能体架构

- ✅ 支持 Dify / LangChain / LlamaIndex / Ollama / vLLM / Neo4j

- ✅ 前端采用 Vue3 + TypeScript + Vite5,现代化交互体验

- ✅ 内置 ECharts / AntV 图表问答 + CSV 表格问答

- ✅ 支持对接主流 RAG 系统 与 Text2SQL 引擎

- ✅ 轻量级 Sanic 后端,适合快速部署与二次开发

- ✅ 项目已被蚂蚁官方推荐收录

运行效果: