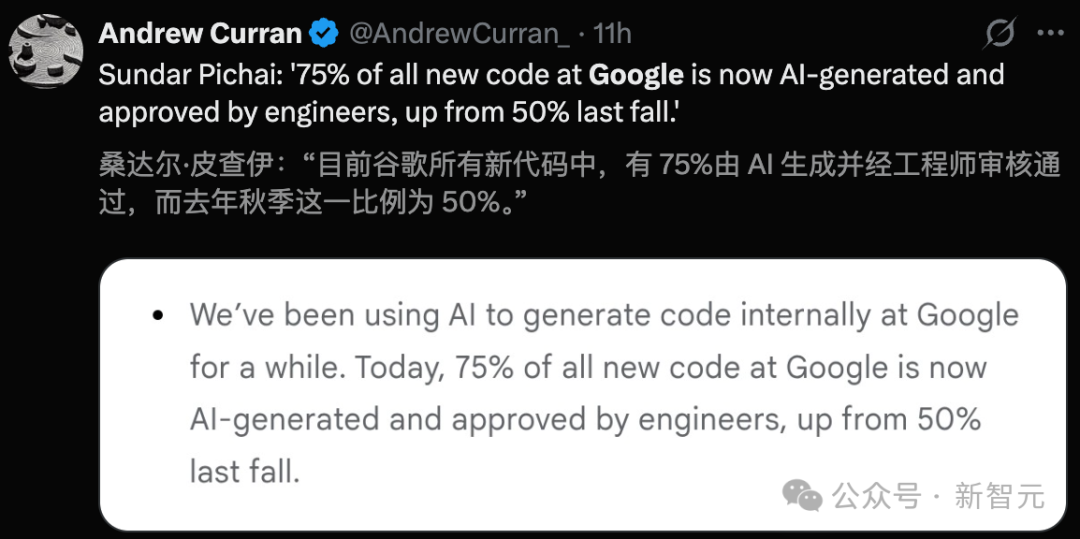

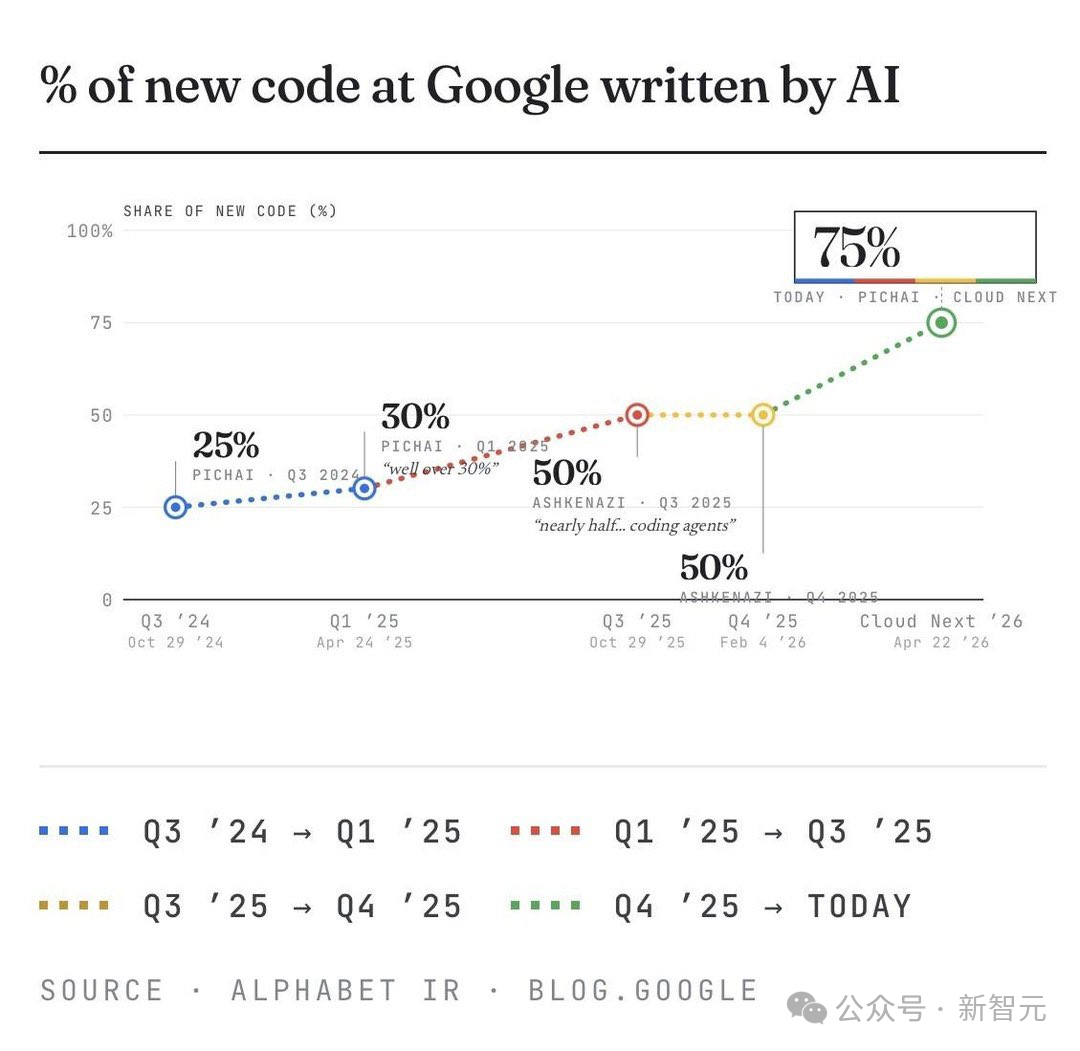

2026年的谷歌Cloud Next大会如期而至,云栈社区关注的焦点,落在了Google CEO Sundar Pichai放出的一组令人咋舌的数据上:谷歌内部75%的新代码,现在完全由AI生成,且经过工程师审核通过。

这个半年前还是50%的数字,以一种近乎激进的速度,宣告了软件开发模式的彻底变革。Pichai更是直言:我们已正式跨入Gemini智能体时代。

如果说75%的代码占比是软件层面的“脑力革命”,那本次大会的真正“重头戏”——第八代TPU的亮剑,就是谷歌在硬件算力上的“肌肉秀”。

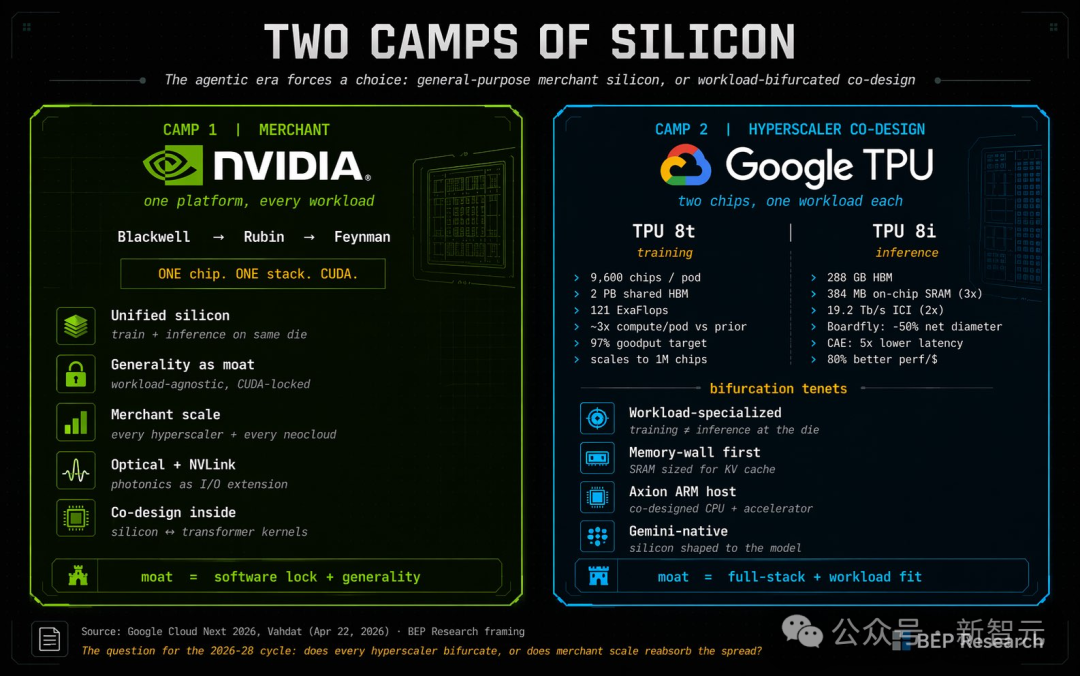

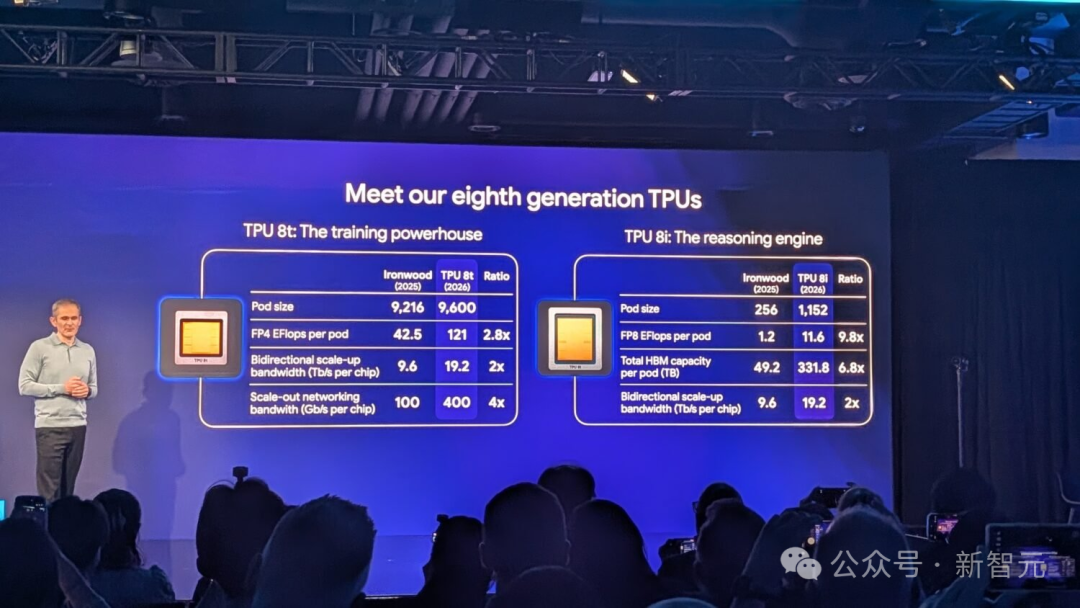

这次,谷歌一改以往设计,首次将TPU明确地一分为二:TPU 8t专攻模型训练,TPU 8i则死磕推理。 这种全栈自研的思路,未尝不是对由英伟达GPU主导的通用生态的一种挑战。

第八代TPU:训练+推理双线出击

第十年的自研成果,是两款为Agent时代定制的芯片。在云计算的算力博弈中,谷歌正在寻求通过工作负载专属设计来开辟新战场。

这代TPU的诞生,训练+推理双线出击,直指英伟达腹地。

行业分析师甚至为此梳理了一张“硅谷两大阵营”的全景对比图,清晰勾勒出了英伟达“一枚芯片通吃所有”的通用护城河,与谷歌“将训练和推理拆分至不同芯片实现全栈协同”的策略路线。

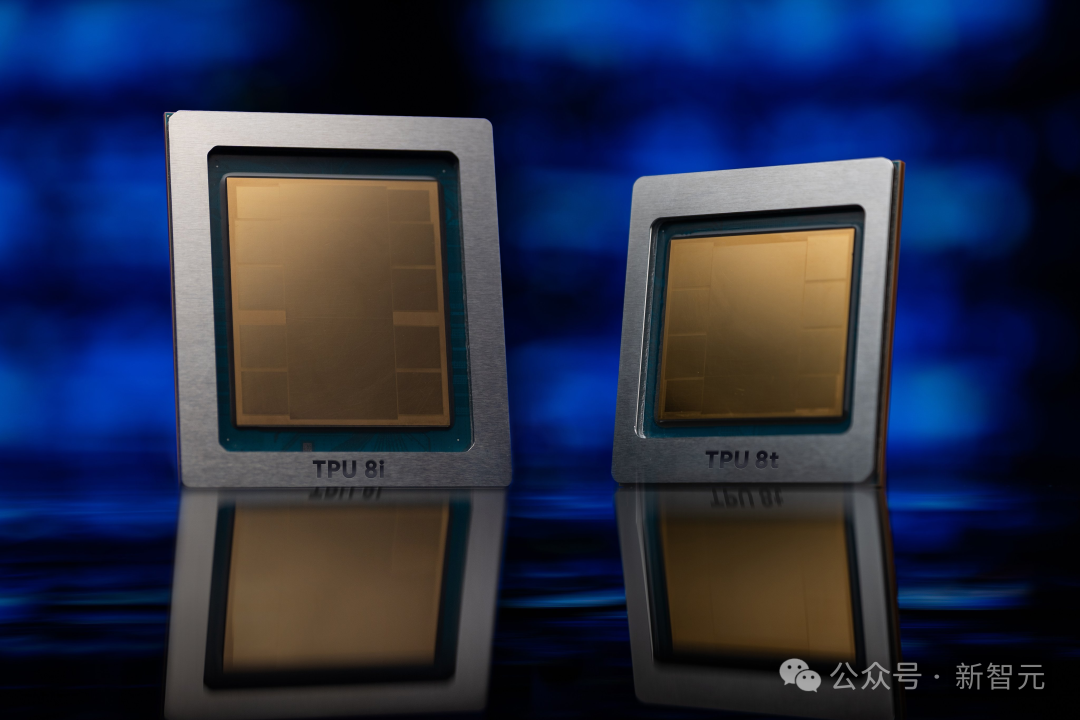

TPU 8t:训练野兽

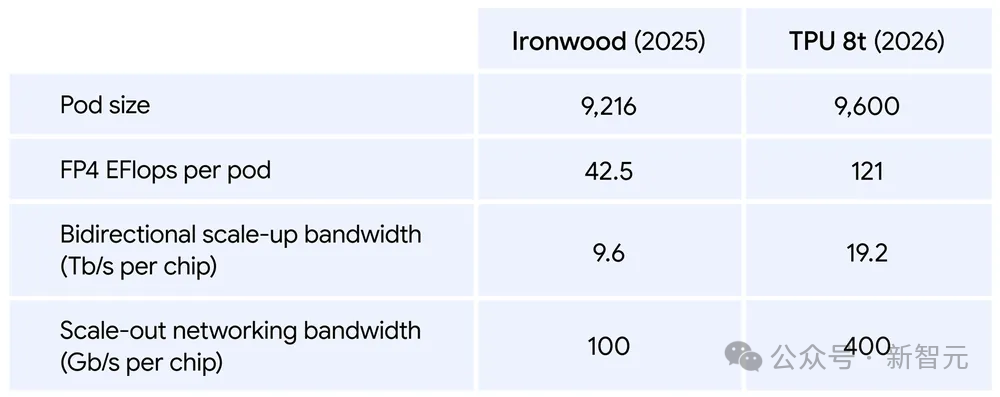

TPU 8t 在吞吐量和扩展性上进行了疯狂的「堆料」,可以将大语言模型的开发时间,从数月缩短至数周!它在每个Pod的计算性能,几乎是上一代Ironwood的近3倍。

单个TPU 8t Superpod可扩展至9600个芯片,提供高达121 ExaFlops的算力。通过全新的Virgo网络架构,搭配JAX和Pathways软件栈,它甚至能实现“百万级”TPU集群的近线性扩展。

更值得注意的是,谷歌还将其“有效算力时间”优化至97%以上,确保昂贵的算力不会白白浪费在系统故障或重启中。

TPU 8i:推理引擎

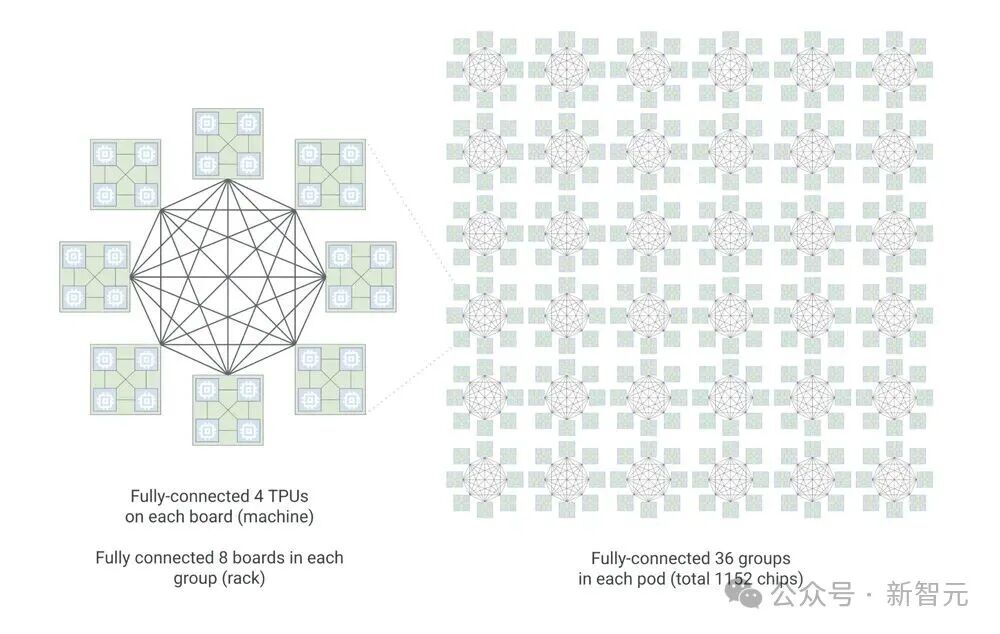

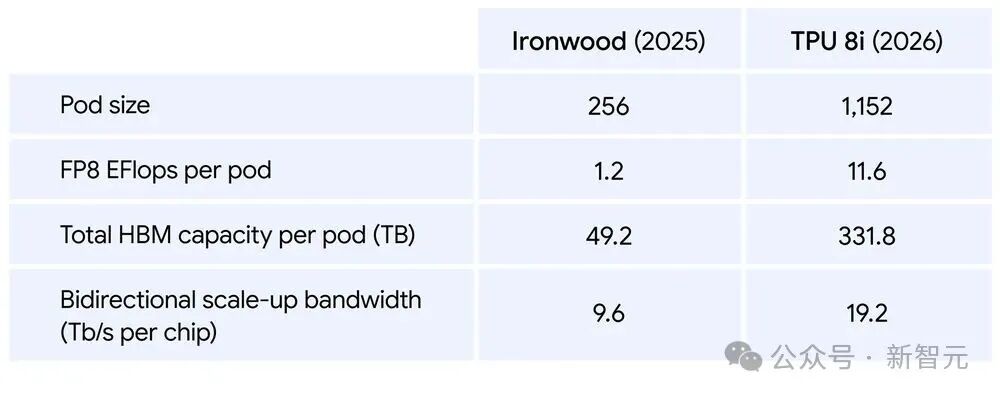

另一款TPU 8i,专为处理多个专业Agent之间复杂协同的迭代工作而设计。它可在单个Pod中连接1,152个TPU,实现巨大吞吐量和极低延迟。为彻底消除多Agent“排队等待”效应,这款芯片带来了四项关键创新:打破「内存墙」、扩展MoE模型、由Axion驱动的高效能以及消除延迟。

在拓扑结构上,TPU 8i采用分层的 Boardfly 设计,由全连接芯片构成基础块,向上扩展为全连接组,最后再全连接成一个Pod。

针对延迟极其敏感的推理场景,它重点突破了「内存墙」限制。TPU 8i配备288GB高带宽内存,以及3倍于前代的片上SRAM,足以让模型的工作集完全驻留。这使得它完美契合多Agent协同、复杂逻辑推理的需求,每美元性能提升了高达80%。

整体来看,第八代TPU全面整合了Axion Arm CPU,通过“芯片+主机+液冷+网络”的全栈垂直整合,实现了每瓦性能翻倍。

75%新代码由AI生成:工程师变身“指挥官”

芯片是物理底座,Pichai甩出的另一个数字,则彻底刷新了人们的认知。

去年秋天这个占比还是50%,如今暴涨至75%。虽然比起Anthropic宣称的100%还有些距离,但谷歌并不满足于“AI辅助写代码”。其内部已开始推行全自主的Agent工作流——工程师的角色不再是单纯的代码产出者,而是“指挥Agent军团”的人。

一个典型的内部案例是:一个非常复杂的代码迁移项目,由Agent与工程师协作完成的速度,是一年前纯人工模式的6倍。更有趣的是,Gemini Mac版应用的初始版本,就是用谷歌内部的Antigravity平台搭建的,从idea到原生Swift原型,仅用了几天。

然而,一片高歌猛进之下,谷歌内部也出现了一种新的“阶层分化”:能用Claude的人,和不能用Claude的人。受制于安全政策,多数谷歌员工严禁使用非自研工具,但DeepMind的部分员工却被“开绿灯”允许用Claude编程。

这一反常举动引发了内部调试:不少工程师私下承认,在部分编程任务上,Gemini的表现的确逊色于Claude。而此时,谷歌正将AI工具的日常应用与员工KPI深度挂勾,全力推进全员AI化。

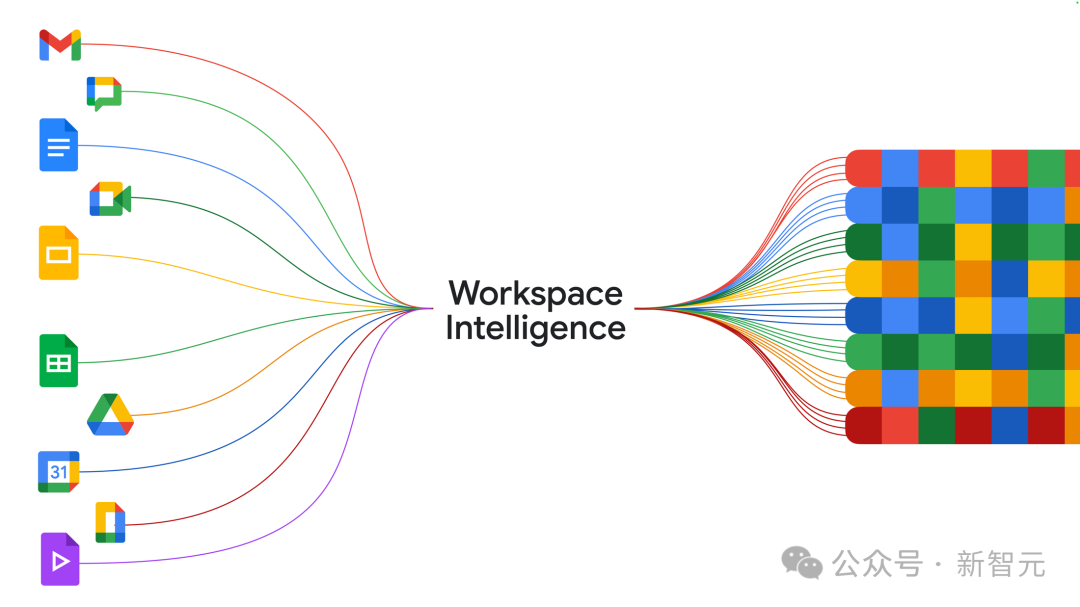

Workspace Intelligence:打工人解放方案

在办公侧,谷歌正式发布了Workspace Intelligence,一个横跨Gmail、Docs、Sheets、Slides、Drive、Chat全线产品的AI“超级大脑”。

Chat成指挥中心:一句话调度全局

最亮眼的功能当属Ask Gemini in Chat。谷歌将Google Chat重新定义为“工作的统一命令行”。你无需在十个标签页间反复跳转,只需在Chat中用自然语言说出目标,Gemini就可跨应用在后台调度,直接把结果推送回来。

每天早上打开Chat,AI会为你播报今日要务、关键未读消息和待办事项;它还能帮你定位文件、生成文档和PPT。

办公全家桶全面赋能

在Excel的战场上,Gemini in Sheets 已能仅凭自然语言描述需求,从邮件、聊天、文件乃至网页抓取数据,端到端完成复杂电子表格的全自动构建。

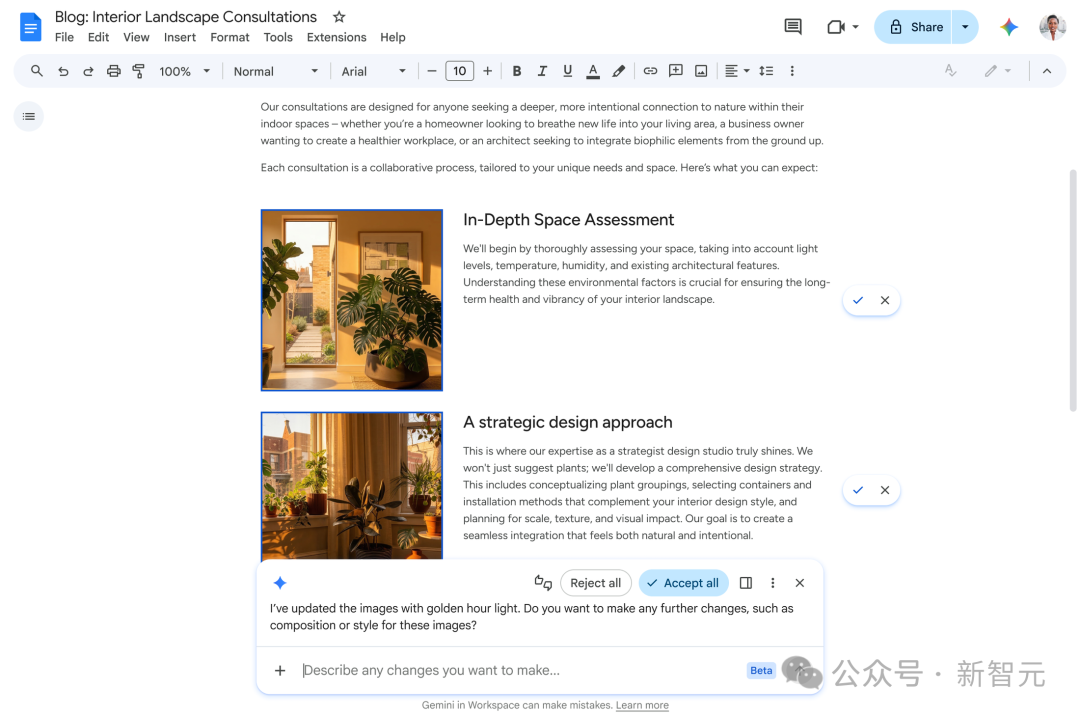

在文档处理上,Gemini in Docs 不仅能写作,还能自动处理同事反馈并直接修改文档。更重磅的是,它支持基于业务数据生成信息图,并能在多张图片编辑中保持视觉统一。

至于让人头疼的幻灯片,Gemini in Slides 则利用上下文严格遵循模板和视觉风格,一次性生成完整、可编辑的PPT,将“做PPT”的痛苦指数砍掉了绝大多数。

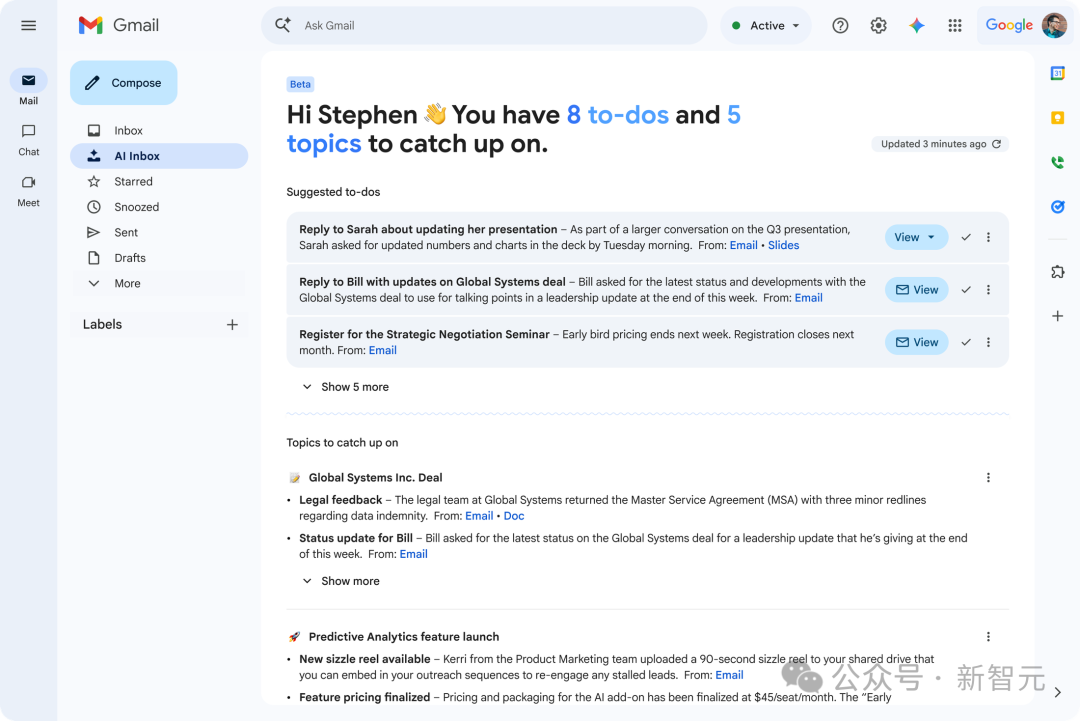

此外,Gmail迎来了“AI收件箱”,能自动提炼邮件重点;Drive Projects则终结了“找文件”的噩梦,将知识库盘活。

| AI收件箱界面 |

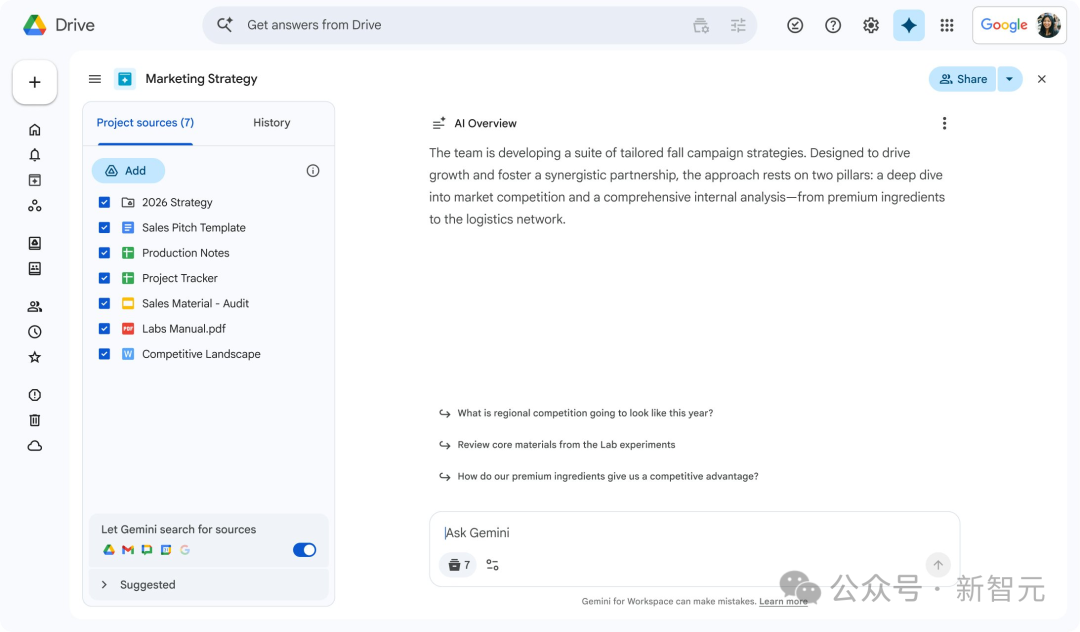

Drive AI项目概览 |

|

|

Gemini企业级Agent平台与疯狂的增长曲线

大会公布的另一组数据同样展现了惊人的增长势能:Gemini Enterprise的付费月活季度环比增长40%,自有模型通过API每分钟处理的Token数已从上季度的100亿狂飙至160亿。近75%的Google Cloud客户,正在使用其AI产品驱动业务转型。

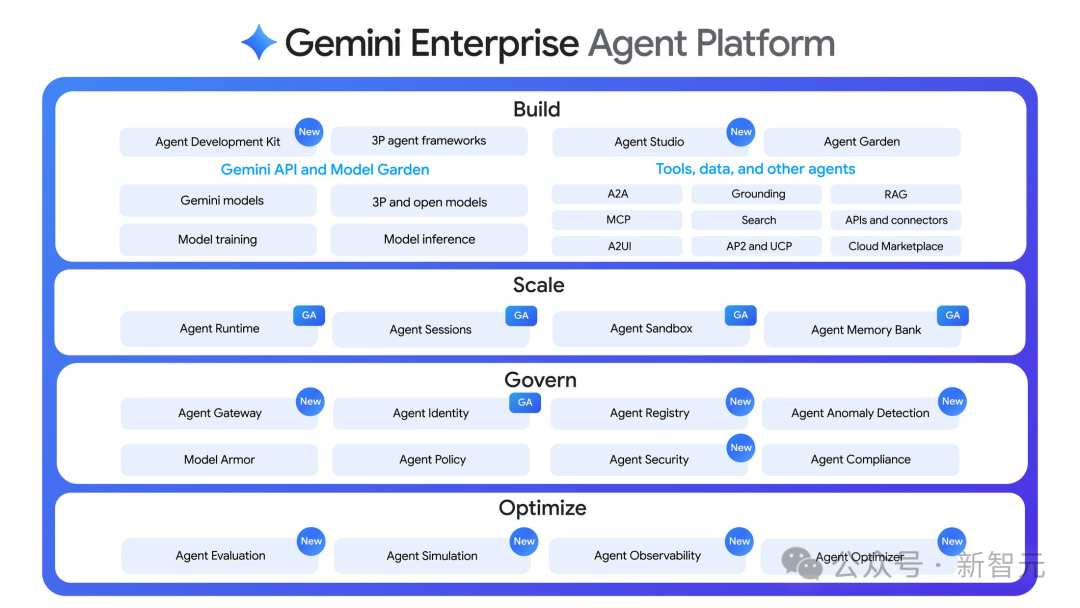

会上重磅亮相的Gemini Enterprise Agent Platform,本质上是一个管理成千上万Agent的“企业级任务控制中心”。这被视为Vertex AI的重大进化,提供了一整套构建、扩展、治理与优化AI Agent的方案。该平台集成了全球超过200个顶尖AI模型,并引入了Memory Bank,让Agent拥有持久化长效记忆,可跨越数天处理复杂工作流而不丢失上下文。

硅谷的牌桌上,底牌正被一张张摊开。OpenAI手握ChatGPT的亿级用户池向企业端渗透;Anthropic凭借Claude的代码能力蚕食开发者心智。而谷歌选择的是一条最重、最慢、却也大概率最难被复制的一条路:从底层芯片到上层模型,从办公套件到Agent平台,全栈自研,垂直整合。这场由人工智能驱动的全栈竞速,其实才刚刚开始。

参考资料: