贝叶斯优化(Bayesian Optimization, BO)是超参数调优的强大工具,但在实际应用中常面临收敛慢、计算成本高等问题。直接使用标准库的BO,效果有时甚至不如多次随机搜索。要真正释放BO的潜力,必须在搜索策略、先验知识注入和成本控制上下功夫。本文分享十个经过实战检验的技巧,旨在让你的优化器更“聪明”,加速收敛,显著提升模型迭代效率。

1、像贝叶斯专家一样引入先验(Priors)

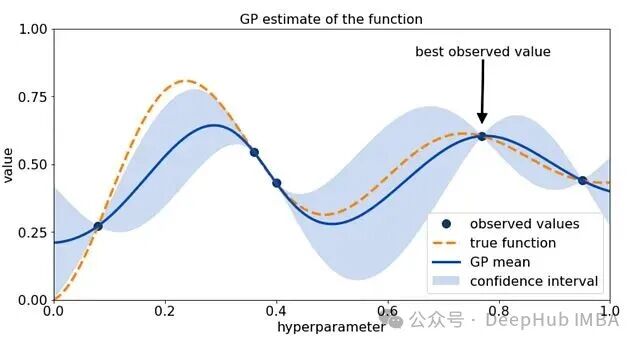

切勿让优化器在“一无所知”的状态下启动,否则它将浪费大量算力在无边界的探索上。我们通常对超参数的合理范围有领域认知,或拥有类似任务的实验数据,这些都应充分利用。弱先验会导致搜索在空间中盲目游荡,而强先验能迅速聚焦到有希望的区域。在昂贵的机器学习模型训练循环中,先验的质量直接决定了能节省多少GPU时间。一个实用的方法是先运行一个小规模的网格搜索或随机搜索(例如5-10次试验),将表现最佳的几组参数作为先验,来初始化高斯过程(Gaussian Process)。

import numpy as np

from sklearn.gaussian_process import GaussianProcessRegressor

from sklearn.gaussian_process.kernels import Matern

from skopt import Optimizer

# 第一步:快速廉价搜索以构建先验

def objective(params):

lr, depth = params

return train_model(lr, depth) # 你的训练循环,返回验证损失

search_space = [

(1e-4, 1e-1), # learning rate

(2, 10) # depth

]

# 快速进行8次网格/随机搜索

initial_points = [

(1e-4, 4), (1e-3, 4), (1e-2, 4),

(1e-4, 8), (1e-3, 8), (1e-2, 8),

(5e-3, 6), (8e-3, 10)

]

initial_results = [objective(p) for p in initial_points]

# 第二步:为贝叶斯优化构建先验

kernel = Matern(nu=2.5)

gp = GaussianProcessRegressor(kernel=kernel, normalize_y=True)

# 第三步:用先验初始化优化器

opt = Optimizer(

dimensions=search_space,

base_estimator=gp,

initial_point_generator="sobol",

)

# 输入先验观察结果

for p, r in zip(initial_points, initial_results):

opt.tell(p, r)

# 第四步:基于信息先验进行贝叶斯优化

for _ in range(30):

next_params = opt.ask()

score = objective(next_params)

opt.tell(next_params, score)

best_params = opt.get_result().x

print("Best Params:", best_params)

2、动态调整采集函数(Acquisition Function)

期望提升(Expected Improvement, EI)是最常用的采集函数,因其在“探索”和“利用”间取得了良好平衡。但在搜索后期,EI可能变得过于保守,导致收敛停滞。搜索策略不应一成不变。当发现搜索陷入平台期时,可尝试动态切换采集函数:需要激进逼近最优解时切换到UCB(Upper Confidence Bound);在搜索初期或目标函数噪声较大、需要跳出局部最优时,切换到PI(Probability of Improvement)。动态调整策略能有效打破后期平台期,减少无效的搜索时间。以下示例展示如何使用scikit-optimize根据收敛情况动态切换。

import numpy as np

from skopt import Optimizer

# 模拟一个昂贵的评估函数

def objective(params):

lr, depth = params

return train_model(lr, depth) # 替换为你的实际训练循环

space = [(1e-4, 1e-1), (2, 10)]

opt = Optimizer(

dimensions=space,

base_estimator="GP",

acq_func="EI" # 初始采集函数

)

def should_switch(iteration, recent_scores):

# 简单启发式:如果最近5步的分数没有改善,则切换模式

if iteration > 10 and np.std(recent_scores[-5:]) < 1e-4:

return True

return False

scores = []

for i in range(40):

# 动态选择采集函数

if should_switch(i, scores):

# 接近收敛时选UCB,需要冒险探索时选PI

opt.acq_func = "UCB" if scores[-1] < np.median(scores) else "PI"

x = opt.ask()

y = objective(x)

scores.append(y)

opt.tell(x, y)

best_params = opt.get_result().x

print("Best Params:", best_params)

许多超参数(如学习率、正则化强度、批量大小)在数值上跨越多个数量级,呈现指数分布。这种分布对假设空间平滑均匀的高斯过程(GP)极不友好。直接在原始空间搜索,优化器会浪费大量时间拟合陡峭的“悬崖”。对这些参数进行对数变换(Log Transform),将指数空间拉伸为线性空间,能让优化器在一个“平坦”的区域运行。这不仅稳定了GP的核函数,还大幅降低了曲率,在实践中常能将收敛时间减半。

import numpy as np

from skopt import Optimizer

from skopt.space import Real

# 昂贵的训练函数

def objective(params):

log_lr, log_reg = params

lr = 10 ** log_lr # 逆对数变换

reg = 10 ** log_reg

return train_model(lr, reg) # 替换为你的实际训练循环

# 第一步:在对数尺度上定义搜索空间

space = [

Real(-5, -1, name="log_lr"), # lr 在 [1e-5, 1e-1] 范围内

Real(-6, -2, name="log_reg") # reg 在 [1e-6, 1e-2] 范围内

]

# 第二步:创建使用对数变换空间的优化器

opt = Optimizer(

dimensions=space,

base_estimator="GP",

acq_func="EI"

)

# 第三步:完全在对数空间运行贝叶斯优化

n_iters = 40

scores = []

for _ in range(n_iters):

x = opt.ask() # 在对数空间提议

y = objective(x) # 在真实空间评估

opt.tell(x, y)

scores.append(y)

best_log_params = opt.get_result().x

best_params = {

"lr": 10 ** best_log_params[0],

"reg": 10 ** best_log_params[1]

}

print("Best Params:", best_params)

4、别让 BO 陷入“套娃”陷阱(Hyper-hypers)

贝叶斯优化自身也有超参数:核长度尺度、噪声项、先验方差等。若试图去优化这些参数,便会陷入“为调参而调参”的无限递归。BO内部的超参数优化非常敏感,易导致代理模型过拟合或噪声估计错误。对于工业级应用,更稳健的做法是对GP的内部优化器进行早停(Early Stopping),或直接使用通过元学习(Meta-Learning)获得的经验值来初始化这些超-超参数。这能使代理模型更稳定、更新成本更低,也是许多AutoML系统采用的策略。

import numpy as np

from skopt import Optimizer

from sklearn.gaussian_process import GaussianProcessRegressor

from sklearn.gaussian_process.kernels import Matern, WhiteKernel

# 从以往类似任务中元学习得到的先验

meta_length_scale = 0.3

meta_noise_level = 1e-3

kernel = (

Matern(length_scale=meta_length_scale, nu=2.5) +

WhiteKernel(noise_level=meta_noise_level)

)

# 早停BO自身的超参数调优

gp = GaussianProcessRegressor(

kernel=kernel,

optimizer="fmin_l_bfgs_b",

n_restarts_optimizer=0, # 关键:防止昂贵的超-超参数循环

normalize_y=True

)

# 使用稳定、元初始化的GP进行BO

opt = Optimizer(

dimensions=[(1e-4, 1e-1), (2, 12)],

base_estimator=gp,

acq_func="EI"

)

def objective(params):

lr, depth = params

return train_model(lr, depth) # 你的模型的验证损失

scores = []

for _ in range(40):

x = opt.ask()

y = objective(x)

opt.tell(x, y)

scores.append(y)

best_params = opt.get_result().x

print("Best Params:", best_params)

5、惩罚高成本区域

标准的BO只关注准确率,不关心计算成本。某些参数组合(如超大批量大小、极深的网络层数)可能仅带来微小的性能提升,计算成本却呈指数级增长。若不加以管控,BO极易陷入“高分低能”的窘境。我们可以修改采集函数,引入成本惩罚项,转而关注单位成本的性能收益。研究表明,忽略成本感知可能导致预算超支37%以上。

import numpy as np

from skopt import Optimizer

from skopt.acquisition import gaussian_ei

# 目标函数返回验证损失和估计的训练成本

def objective(params):

lr, depth = params

val_loss = train_model(lr, depth)

cost = estimate_cost(lr, depth) # 例如,GPU小时数或FLOPs代理

return val_loss, cost

# 自定义成本感知EI:最大化 EI / 成本

def cost_aware_ei(model, X, y_min, costs):

raw_ei = gaussian_ei(X, model, y_min=y_min)

normalized_costs = costs / np.max(costs)

penalty = 1.0 / (1e-6 + normalized_costs)

return raw_ei * penalty

# 搜索空间

opt = Optimizer(

dimensions=[(1e-4, 1e-1), (2, 20)],

base_estimator="GP"

)

observed_losses = []

observed_costs = []

for _ in range(40):

# 获取一批候选点

candidates = opt.ask(n_points=20)

# 为每个候选点计算成本感知EI

y_min = np.min(observed_losses) if observed_losses else np.inf

cost_scores = cost_aware_ei(

opt.base_estimator_,

np.array(candidates),

y_min=y_min,

costs=np.array(observed_costs[-len(candidates):] + [1]*len(candidates)) # 后备成本=1

)

# 在成本感知下选择最佳候选点

next_x = candidates[np.argmax(cost_scores)]

(loss, cost) = objective(next_x)

observed_losses.append(loss)

observed_costs.append(cost)

opt.tell(next_x, loss)

best_params = opt.get_result().x

print("Best Params (Cost-Aware):", best_params)

6、混合策略:BO + 随机搜索

在噪声较大的任务(如强化学习或深度学习训练)中,BO并非无懈可击。GP代理模型有时会被噪声误导,对错误区域过度自信,陷入局部最优。此时引入一些“随机性”反而效果显著。在BO循环中混入约10%的随机搜索,能有效打破代理模型的“固执”,增加全局覆盖率。这是一种用随机性的多样性来弥补BO确定性缺陷的混合策略。

import numpy as np

from skopt import Optimizer

from skopt.space import Real, Integer

# 定义搜索空间

space = [

Real(1e-4, 1e-1, name="lr"),

Integer(2, 12, name="depth")

]

# 昂贵的训练循环

def objective(params):

lr, depth = params

return train_model(lr, depth) # 你的模型的验证损失

# BO优化器

opt = Optimizer(

dimensions=space,

base_estimator="GP",

acq_func="EI"

)

n_total = 50

n_random = int(0.20 * n_total) # 前20% = 随机探索

results = []

for i in range(n_total):

if i < n_random:

# ----- 阶段1:纯随机搜索 -----

x = [

np.random.uniform(1e-4, 1e-1),

np.random.randint(2, 13)

]

else:

# ----- 阶段2:贝叶斯优化 -----

x = opt.ask()

y = objective(x)

results.append((x, y))

# 仅在评估后告知BO(保持历史一致性)

opt.tell(x, y)

best_params = opt.get_result().x

print("Best Params (Hybrid):", best_params)

7、并行化:伪装成并行计算

BO本质上是串行的,因为每一步都依赖于上一步更新的后验分布。这在多GPU环境下是劣势。但我们可以模拟并行性。启动多个独立的BO实例,赋予它们不同的随机种子或先验,让它们独立运行,然后将结果汇总到一个主GP模型中进行重新训练。这样既利用了并行计算资源,又通过多样化探索增强了最终代理模型的适应性。该方法在神经网络架构搜索(NAS)中非常普遍。

import numpy as np

from skopt import Optimizer

from multiprocessing import Pool

# 搜索空间

space = [(1e-4, 1e-1), (2, 10)]

# 昂贵的评估函数

def objective(params):

lr, depth = params

return train_model(lr, depth)

# 创建具有不同先验/核的BO实例

def make_optimizer(seed):

return Optimizer(

dimensions=space,

base_estimator="GP",

acq_func="EI",

random_state=seed

)

optimizers = [make_optimizer(seed) for seed in [0, 1, 2, 3]] # 4条BO轨迹

# 为单个优化器评估一步BO

def bo_step(opt):

x = opt.ask()

y = objective(x)

opt.tell(x, y)

return (x, y)

# 运行伪并行BO N步

def run_parallel_steps(optimizers, steps=10):

pool = Pool(len(optimizers))

results = []

for _ in range(steps):

async_calls = [pool.apply_async(bo_step, (opt,)) for opt in optimizers]

for res, opt in zip(async_calls, optimizers):

x, y = res.get()

results.append((x, y))

pool.close()

pool.join()

return results

# 第一步:并行探索

parallel_results = run_parallel_steps(optimizers, steps=15)

# 第二步:将结果合并到主BO中

master = make_optimizer(seed=99)

for x, y in parallel_results:

master.tell(x, y)

# 第三步:用统一的BO进行精炼

for _ in range(30):

x = master.ask()

y = objective(x)

master.tell(x, y)

print("Best Params:", master.get_result().x)

8、非数值输入的处理技巧

高斯过程偏好连续平滑的空间,但现实中的超参数常包含类别型变量(如优化器类型:Adam vs SGD,激活函数类型等)。这些离散的“跳跃”会破坏GP的核函数假设。直接将它们作为类别ID输入给GP是错误的。正确做法是使用独热编码或嵌入技术,将类别变量映射到连续的数值空间,使BO能理解类别间的“距离”,从而恢复搜索空间的平滑性。

import numpy as np

from skopt import Optimizer

from sklearn.preprocessing import OneHotEncoder

# --- 第一步:准备类别编码器 ---

optimizers = np.array([["adam"], ["sgd"], ["adamw"]])

enc = OneHotEncoder(sparse_output=False).fit(optimizers)

def encode_category(cat_name):

return enc.transform([[cat_name]])[0] # 返回连续的3维向量

# --- 第二步:组合数值与类别搜索空间 ---

# 连续参数:lr, dropout

# 编码后的类别参数:optimizer

space_dims = [

(1e-5, 1e-2), # learning rate

(0.0, 0.5), # dropout

(0.0, 1.0), # optimizer_onehot_dim1

(0.0, 1.0), # optimizer_onehot_dim2

(0.0, 1.0) # optimizer_onehot_dim3

]

opt = Optimizer(

dimensions=space_dims,

base_estimator="GP",

acq_func="EI"

)

# --- 第三步:将嵌入解码回类别的目标函数 ---

def decode_optimizer(vec):

idx = np.argmax(vec)

return ["adam", "sgd", "adamw"][idx]

def objective(params):

lr, dropout, *opt_vec = params

opt_name = decode_optimizer(opt_vec)

return train_model(lr, dropout, optimizer=opt_name)

# --- 第四步:混合类别-连续BO循环 ---

for _ in range(40):

x = opt.ask()

# 将编码的优化器向量捕捉到最近的有效独热编码

opt_vec = np.array(x[2:])

snapped_vec = np.zeros_like(opt_vec)

snapped_vec[np.argmax(opt_vec)] = 1.0

clean_x = [x[0], x[1], *snapped_vec]

y = objective(clean_x)

opt.tell(clean_x, y)

best_params = opt.get_result().x

print("Best Params:", best_params)

9、约束不可探索区域

许多超参数组合理论上存在,但工程上不可行。例如batch_size大于数据集大小,或num_layers < num_heads等逻辑矛盾。若不加以约束,BO将浪费大量时间尝试这些必然失败或无效的组合。通过显式定义约束条件,或在目标函数中对无效区域返回一个极大的损失值,可以迫使BO避开这些“雷区”。这能显著减少失败的试验次数。

from skopt import gp_minimize

from skopt.space import Integer, Real

import numpy as np

# 超参数搜索空间

space = [

Integer(8, 512, name="batch_size"),

Integer(1, 12, name="num_layers"),

Integer(1, 12, name="num_heads"),

Real(1e-5, 1e-2, name="learning_rate", prior="log-uniform"),

]

# 定义约束

def valid_config(params):

batch_size, num_layers, num_heads, _ = params

return (batch_size <= 12800) and (num_layers >= num_heads)

# 强制执行约束的包装目标函数

def objective(params):

if not valid_config(params):

# 惩罚无效区域,使BO学会避开它们

return 10.0 # 巨大的合成损失

# 模拟昂贵的训练循环

batch_size, num_layers, num_heads, lr = params

loss = (

(num_layers - num_heads) * 0.1

+ np.log(batch_size) * 0.05

+ np.random.normal(0, 0.01)

+ lr * 5

)

return loss

# 运行约束感知的BO

result = gp_minimize(

func=objective,

dimensions=space,

n_calls=40,

n_initial_points=8,

noise=1e-5

)

print("Best hyperparameters:", result.x)

10、集成代理模型(Ensemble Surrogate Models)

单一的高斯过程模型并不总是可靠。面对高维空间或稀疏数据时,GP容易产生“幻觉”,给出错误的置信度估计。更稳健的做法是集成多个代理模型。可以同时维护GP、随机森林和梯度提升树,甚至简单的MLP。通过投票或加权平均来决定下一步的搜索方向。这利用了集成学习的优势,显著降低了预测方差。在Optuna等成熟框架中,这种思想已被广泛应用。

import optuna

from sklearn.gaussian_process import GaussianProcessRegressor

from sklearn.ensemble import RandomForestRegressor, GradientBoostingRegressor

import numpy as np

# 构建代理模型集成

def build_surrogates():

return [

GaussianProcessRegressor(normalize_y=True),

RandomForestRegressor(n_estimators=200),

GradientBoostingRegressor()

]

# 用历史试验训练所有代理模型

def train_surrogates(surrogates, X, y):

for s in surrogates:

s.fit(X, y)

# 使用不确定性感知加权进行聚合预测

def ensemble_predict(surrogates, X):

preds = []

for s in surrogates:

p = s.predict(X, return_std=False)

preds.append(p)

return np.mean(preds, axis=0)

def objective(trial):

# 超参数

lr = trial.suggest_loguniform("lr", 1e-5, 1e-2)

depth = trial.suggest_int("depth", 2, 8)

# 模拟昂贵的评估

loss = (depth * 0.1) + (np.log1p(1/lr) * 0.05) + np.random.normal(0, 0.02)

return loss

# 集成代理模型预测的自定义采样策略

class EnsembleSampler(optuna.samplers.BaseSampler):

def __init__(self):

self.surrogates = build_surrogates()

def infer_relative_search_space(self, study, trial):

return None # 使用独立采样

def sample_relative(self, study, trial, search_space):

return {}

def sample_independent(self, study, trial, param_name, distribution):

trials = study.get_trials(deepcopy=False)

# 热身阶段:随机采样

if len(trials) < 15:

return optuna.samplers.RandomSampler().sample_independent(

study, trial, param_name, distribution

)

# 收集训练数据

X = []

y = []

for t in trials:

if t.values:

X.append([t.params["lr"], t.params["depth"]])

y.append(t.values[0])

X = np.array(X)

y = np.array(y)

train_surrogates(self.surrogates, X, y)

# 生成候选点

candidates = np.random.uniform(

low=distribution.low, high=distribution.high, size=64

)

# 预测代理损失

if param_name == "lr":

Xcand = np.column_stack([candidates, np.full_like(candidates, trial.params.get("depth", 5))])

else:

Xcand = np.column_stack([np.full_like(candidates, trial.params.get("lr", 1e-3)), candidates])

preds = ensemble_predict(self.surrogates, Xcand)

# 选择预测最佳的候选点

return float(candidates[np.argmin(preds)])

# 运行集成驱动的BO

study = optuna.create_study(sampler=EnsembleSampler(), direction="minimize")

study.optimize(objective, n_trials=40)

print("Best:", study.best_params)

总结

直接调用现成的库往往难以解决复杂的工业级问题。上述十个技巧,本质上是在弥合理论假设(如平滑性、无限算力、同质噪声)与工程现实(如预算限制、离散参数、失败试验)之间的鸿沟。在实践中,不应将贝叶斯优化视为不可干预的黑盒。它应该是一个可深度定制的组件。只有根据具体问题特性,精心设计搜索空间、调整采集策略并引入必要约束时,贝叶斯优化才能真正成为提升模型性能的加速器,而非消耗资源的无底洞。通过Python的scikit-optimize库实践这些技巧,能有效优化你的工作流。