AI竞争的逻辑正在被彻底改写:模型参数不再是唯一的战场,电力供应成了新的制高点。

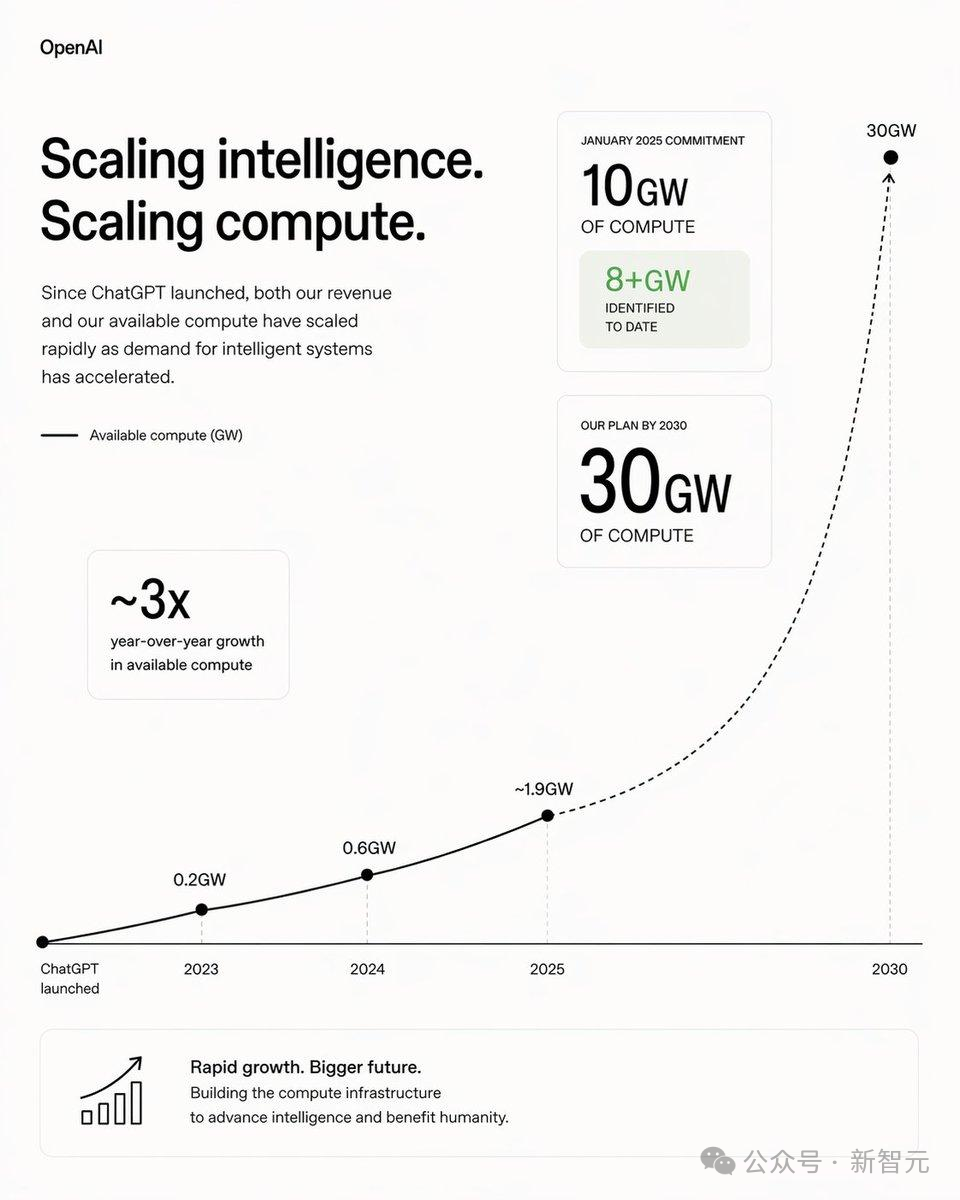

4月9日,据Bloomberg援引OpenAI向投资人提供的一份备忘录显示,其算力野心已膨胀到一个惊人尺度——到2030年,规划算力容量达到30GW。

昨天,OpenAI官方也再次提起了这一计划,声称要以30GW的算力满足智能系统需求的迅猛增长。

OpenAI还不忘用自家Image 2.0,将ChatGPT发布以来的算力狂飙生成一张图表:到2030年,其算力规模将是2025年的约15-16倍。这张图彻底暴露了它的底层逻辑——用疯狂堆叠计算资源的方式推进AI能力提升。

我们越来越清晰地看到:OpenAI早已不再只关注模型参数与跑分,而是将AI竞争拽入了一个新的角力场——电力竞争。

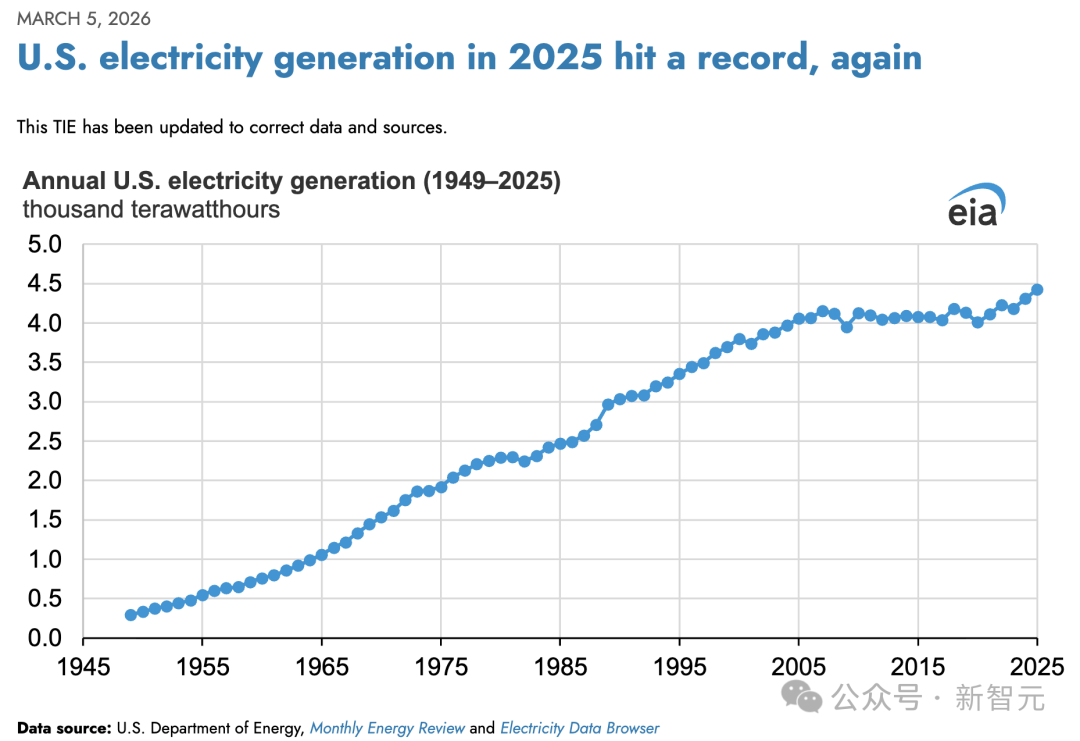

30GW是个什么概念?按照美国能源信息署(EIA)的数据,2025年全美发电量创下历史新高,达到4.43千TWh。如果这30GW算力持续满载一整年,大约会消耗掉262.8TWh的电力。这意味着,仅OpenAI一家的远期算力规划,理论上就要吞噬掉2025年全美发电量的近6%。

EIA美国2025年发电量数据:https://www.eia.gov/todayinenergy/detail.php?id=67284

算力已经成了产品增长的瓶颈! 这是在竞争对手Anthropic发布Mythos之后,OpenAI在备忘录里向投资人解释自己结构性优势时的原话。他们没有去长篇大论地对比算法与模型架构,只是甩出了一条简单粗暴的逻辑:看谁手里握着的电更多,就用这个来定高下。

从5000亿到8GW:Stargate的算力爬坡

这30GW并非一张空头支票。如果你把Stargate计划过去15个月的公开数字拉成一条曲线,就能清晰地看到一家模型公司是如何一路进化成重资产电力玩家的。

Stargate计划最早始于2025年1月,OpenAI联合软银、Oracle与MGX正式发布,喊出了未来四年砸下5000亿美元的口号,起步就承诺了10GW。

2025年1月21日,美国政府对外宣布:OpenAI、甲骨文和软银将共同成立一家名为「星门」的合资企业,孙正义出任董事长,软银管钱,OpenAI负责运营。背后还站着英伟达、Arm、微软、甲骨文等一众技术巨头。当时业内很多人觉得这不过是一场大型公关秀。

但仅过了6个月,OpenAI便高调宣布与Oracle敲定了4.5GW的新增合作,加上德州阿比林的Stargate I,总盘子一下子突破了5GW,未来五年合作规模直指3000亿美元。与此同时,Oracle确认已开始向Stargate I交付首批Nvidia GB200机架,并跑起了早期训练与推理负载。

3个月后的10月,扩张狂潮再度升级。他们在密歇根州萨林镇拿下了一个超过1GW的新园区,紧接着又一口气公布了德州沙克尔福德县、新墨西哥州多娜安娜县等五个新站点,规划容量跃升至「接近7GW」,对应投资额超过4000亿美元。

同月下旬,密歇根萨林镇项目宣布并入Stargate的4.5GW合作盘子,规划总容量突破8GW。官方说法是「提前推进到10GW承诺」。为了拿下这些地盘,他们和合作伙伴审阅了来自全美30多个州的300多份提案,从中筛选出第一批试点。

到2026年4月,媒体披露了那份面向投资人的备忘录:公司将2030年的算力目标上调至约30GW。5GW、8GW、30GW……这条曲线的斜率一次比一次陡峭。从0到8GW的规划容量,落地只用了不到一年时间。这架势早已不是在“做项目”,更像是在“打仗”。同一时期,Stargate在多州同步推进站点建设,OpenAI正在把Stargate打造成横跨地产、能源、芯片与施工调度的重资产基础设施机器,以此为自身构建最坚固的壁垒。

算力即武器:OpenAI计划用电力压制Anthropic

在OpenAI高层的眼中,算力是极其重要的战略资源。囤积算力并非一场疯狂的烧钱游戏,而是他们用来压制死敌Anthropic的重磅战略武器。

在那份泄露的备忘录里,OpenAI向投资人披露:2025年自己实际可用的算力容量已达1.9GW,是上一年的整整3倍。他们同时预估,Anthropic同期的算力最多只有1.4GW。而且,这个0.5GW的鸿沟会逐年急剧放大——OpenAI预计明年就能飙升至十几GW的低位区间,而Anthropic即使砸锅卖铁熬到2027年底,算力顶峰也只能维持在7到8GW之间。

OpenAI还引用了Stratechery作者Ben Thompson的分析,直指Mythos发布后只对少数伙伴开放,很可能就是因为算力限制倒逼出来的无奈选择。潜台词很直白:你的模型再强,没电也铺不开。

事实的确严峻。Mythos发布后的几个月里,Anthropic一度难以维持服务稳定在线。The New Stack曾在3月28日的报道中回顾Anthropic「疯狂的三月」——一个月内推出超过14项更新,同时发生了至少5次宕机,Opus 4.6也频繁出现高错误率。

回想Amodei去年曾讽刺某些竞争对手在搞「YOLO」式的不计后果盲目扩张,标榜自己财务极度克制。如今OpenAI在备忘录里毫不客气地反击:事后看,这种与其说是纪律性,不如说是严重低估了市场需求的爆发有多猛烈。算力短缺,已经成了产品增长的核心瓶颈。

当然,Anthropic也并未坐以待毙。其CFO Krishna Rao曾在交易声明中表态:「为了跟上这种前所未有的增长,我们正在做出迄今为止最大规模的算力投入承诺。」500亿美元在美国建数据中心的承诺已经官宣,与博通、Google的合作到2027年起能多出约3.5GW容量。但即便如此,在算力布局上仍难逃被OpenAI压制。

目前,双方已在企业市场与编码等生产力场景刺刀见红。OpenAI高管甚至将Anthropic的崛起形容为「一次警钟」。双方的竞争已不看谁的模型更聪明,而是看谁有更多的电,谁能在未来三到五年把模型铺到更广的地方去。当算力容量被当作护城河写进投资人备忘录,无疑释放了一个明确信号:硅谷AI巨头之间的下一轮战争,已经烧到了发电厂与能源层。

迎面而来的电力墙

一家AI公司要吃掉全美发电量的近6%,如果单纯从数量级看,这个推演完全成立。但现实是,没有任何数据中心能永远满载,行业平均负载率通常在60%到70%之间。更何况,这是拿2030年的远景去硬套2025年的电网产能。

这虽然只是一种理论推演,却直观地揭露了一个残酷的真相:「电力墙」正在成为AI竞赛的关键变量。

突破电力墙的第一重考验,是能不能把电造出来。OpenAI官方高调宣扬的8GW仅仅是规划容量,而在备忘录里向投资人交底的2025年实际可用容量,只有1.9GW,差了整整4倍多。至于那个30GW的惊人数字,目前只停留在与投资人沟通的远期规划阶段。

要把PPT上的GW变成现实中跑的GW,还要跨越无数道现实考验。从「规划容量」到「实际点亮」,中间还隔着土建进度、设备交付、电网接入、地方政府审批这四道关。你以为拿到地就能建机房?实际情况是,北美高压变压器的交货周期已经排到了几年以后。一位电力工程师算了笔账:美国过去十年大型高压变压器供应链一直是短板,单台订货周期常拖到两年以上;核电站从选址到并网平均要12到15年;要在五年内额外消化30GW新增负荷,输电线路走廊的审批节奏根本跟不上。

即使是在密歇根这样的重工业老区,OpenAI也得小心翼翼地承诺使用现有的剩余输电能力,绝不敢让当地居民的电费账单上涨哪怕一点。就在前段时间,OpenAI已默默暂停了英国的一个大型基础设施项目,原因无它:当地电费实在太贵了。

再回头看奥特曼要求的「每年新增100GW」,就像一个地狱级的挑战,大致相当于在全美每年新增一个完整加州规模的电力消费。如果靠天然气补缺口,碳排放账单先爆;如果押注核电与可再生,等审批就要数年。

这还不只是OpenAI一家的困境。过去两年,Google、Meta、Amazon都踩过「数据中心建好却通不上电」的大坑;老对手Anthropic砸下500亿美元,也得苦等到2027年才能兑现3.5GW的容量。

这就引出了这场算力豪赌下一个有趣的悖论:越是接近AGI的宏大叙事,你越会发现自己受制于最传统的泥瓦匠和电工。OpenAI与Anthropic现在最大的工程挑战,早已不在代码仓库里,而是每天一睁眼最头疼的问题——怎么给几百万张嗷嗷待哺的GPU接上稳定且便宜的交流电。

而且,数据已经报警了。EIA最新数据显示,2025年美国零售电力销售额全面上涨,其中商业部门涨了2.9%,工业部门涨了0.7%。EIA将商业用电的暴增明确归因于数据中心的扩张。

AI负载已经在快速拉高美国的电网曲线,而这还仅仅是30GW规划目标下一小部分存量的威力。所以备忘录里的那个30GW,听上去像一张路线图,更像是一份针对美国基础设施的极限压力测试表。OpenAI给自己画的这条算力曲线能不能走完,一半捏在奥特曼手里,另一半还要看美国电网的脸色。

参与这场算力与能源博弈讨论,欢迎访问云栈社区与更多技术从业者交流行业趋势。