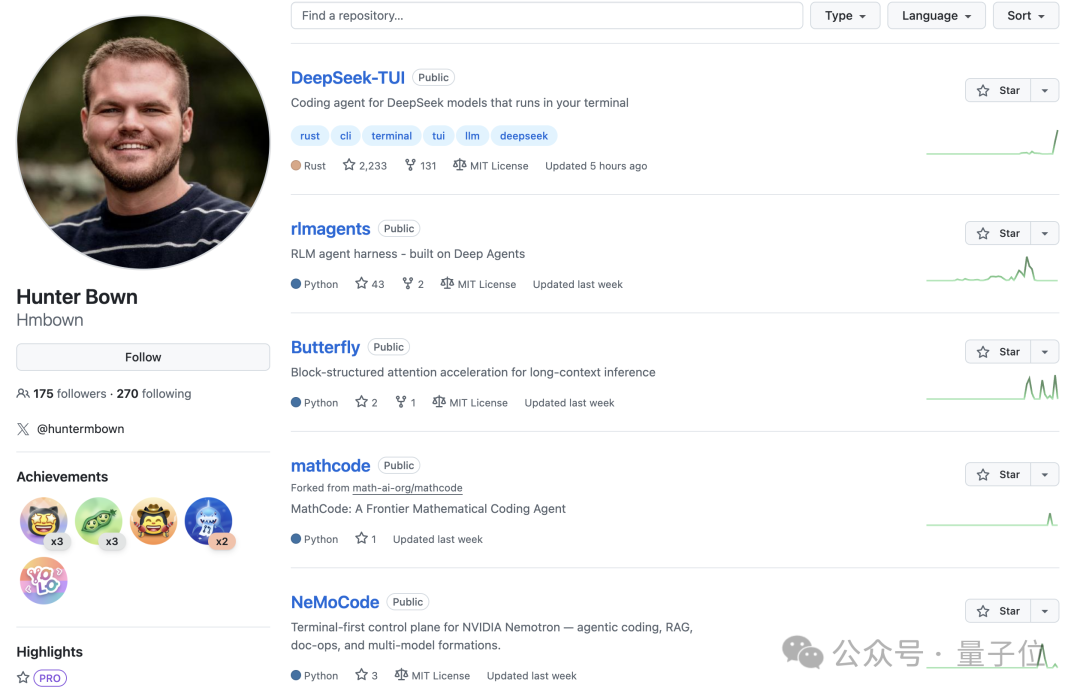

DeepSeek 终于有了专属的 Coding Agent,名字直白就叫 DeepSeek-TUI。作者是一位称自己为“鲸鱼兄弟”的 DeepSeek 爱好者。

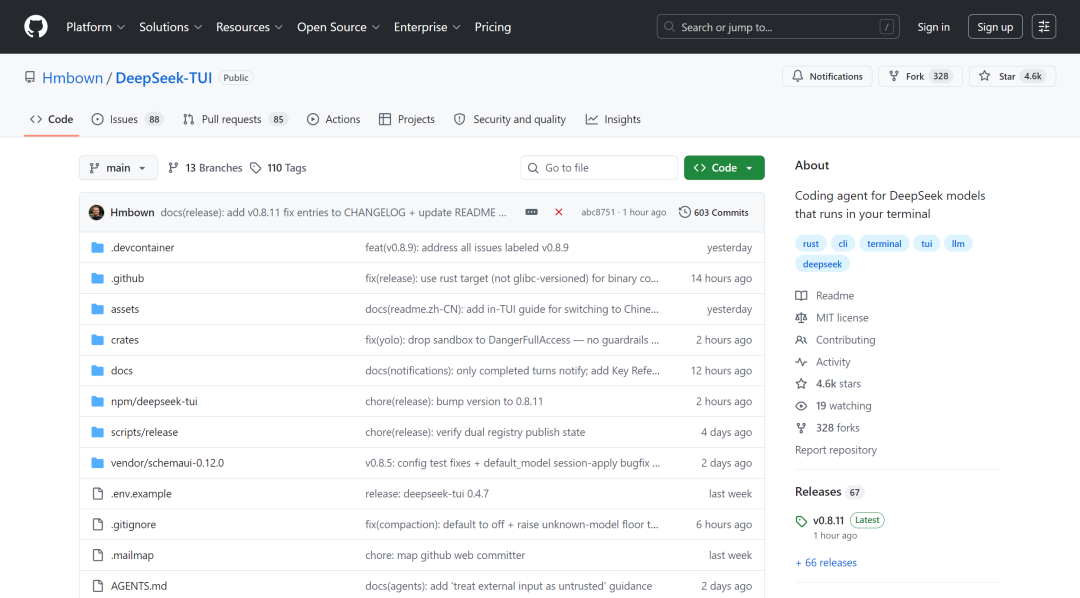

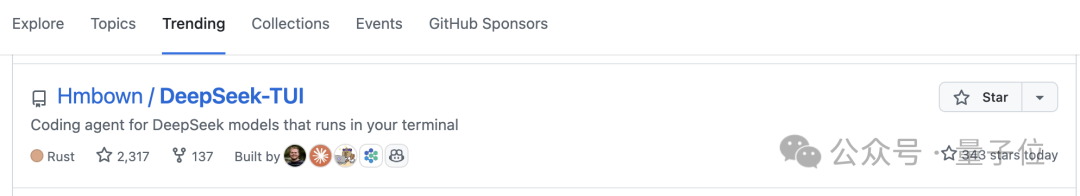

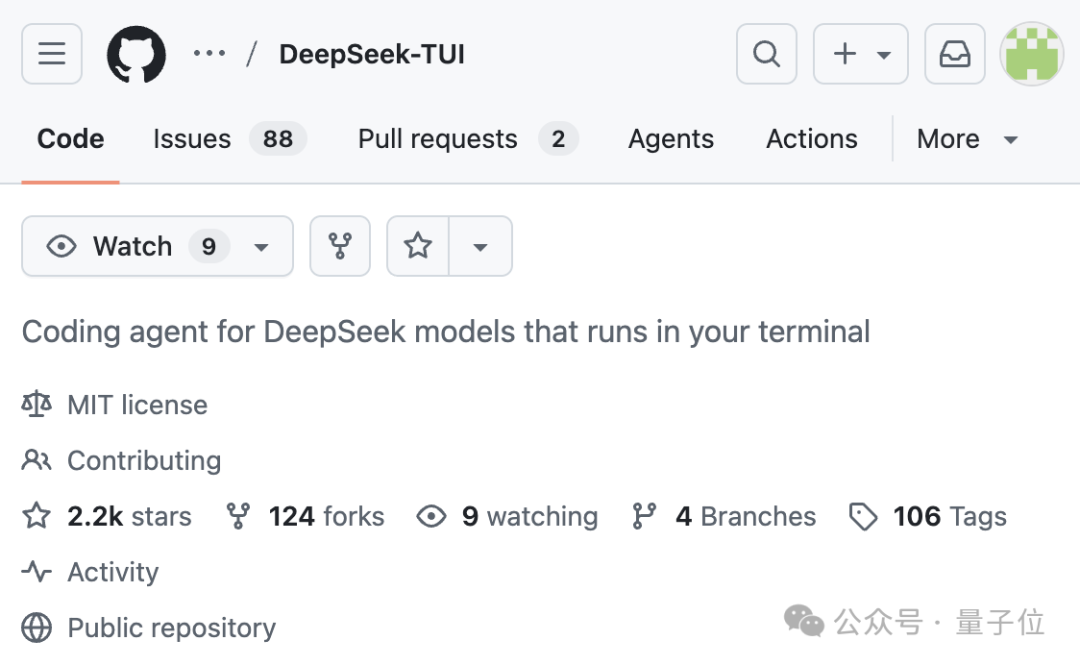

就在最近,该项目的星标数急剧上升,突破 4.6k,并成功登上了 GitHub 热门榜单。

这是一个基于 Rust 语言编写的 TUI(终端用户界面)编程工具。它就像 Claude Code 一样栖身于终端,但所有优化都只为 DeepSeek 量身定制。

为了向国内的技术同好宣传这个作品,作者 Hunter Bown 还特意用 DeepSeek 把宣传文案译成了中文。

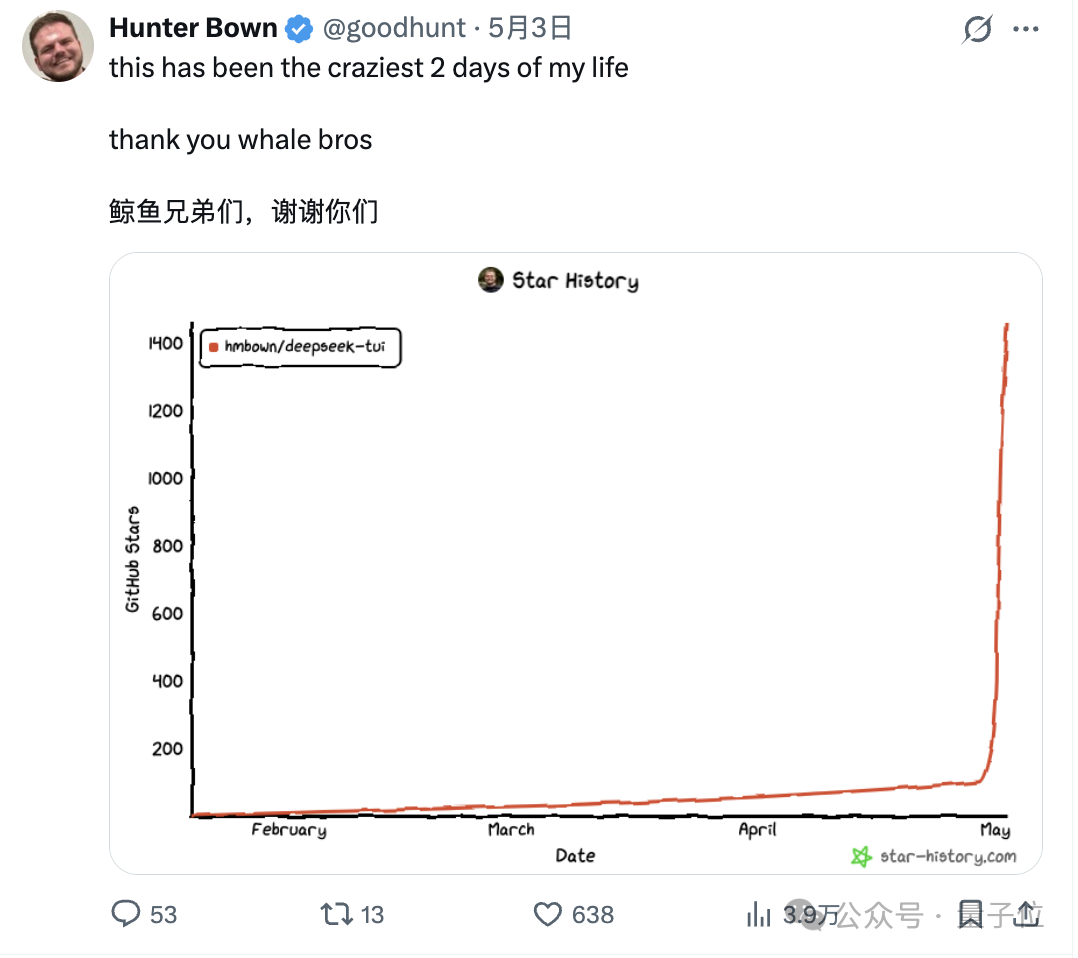

当 DeepSeek-TUI 如他所愿在 GitHub 上爆火后,Hunter 发图直言这是他人生中最疯狂的两天,并用中文向“鲸鱼兄弟”们表达了感谢。

“DeepSeek 版 Claude Code” 到底怎么玩

把 DeepSeek-TUI 看作一个寄居在终端里的编程 Agent,简单理解——它就是“DeepSeek 版的 Claude Code”。

这个项目今年 1 月由美国独立开发者 Hunter Bown 发起,基于 Rust 构建,采用 MIT 协议开源。它沉寂了数月,直到 DeepSeek V4 发布,再加上 Hunter 那篇地道的中文贴,项目在五一假期期间彻底被点燃。

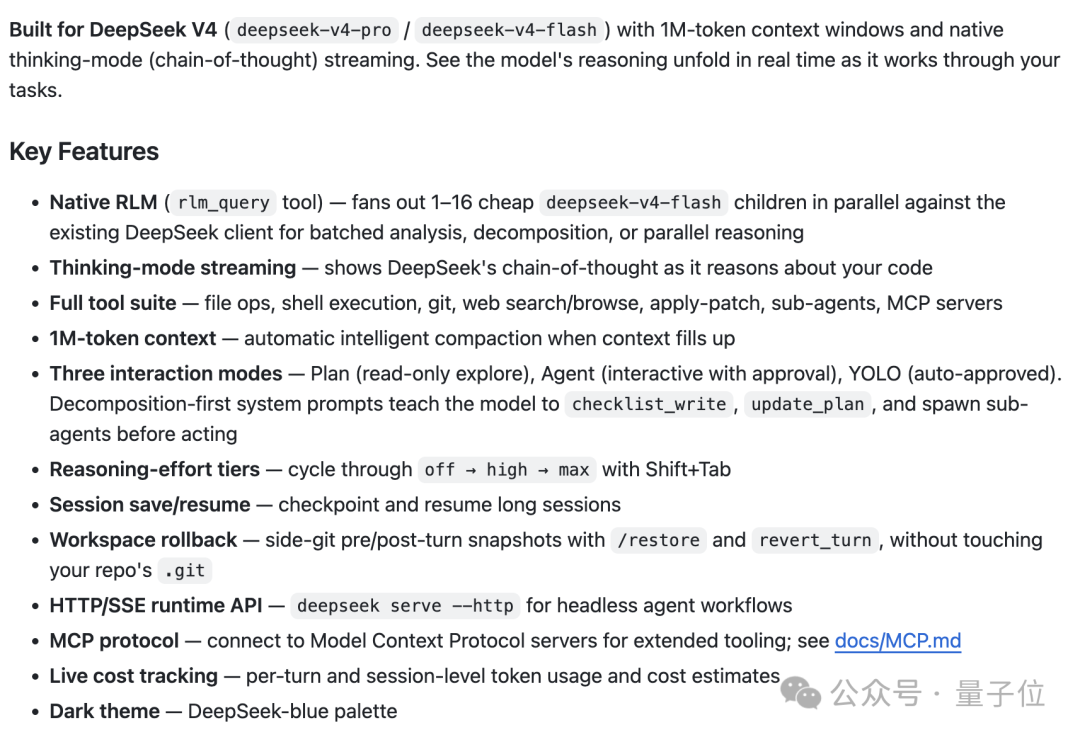

Claude Code 的那些看家本领它几乎全盘接收:读写文件、执行 Shell 命令、网页搜索、Git 管理、子 Agent 调度以及连接 MCP 服务器……它甚至还支持安装 Skills,只不过这一切的后台大脑换成了 DeepSeek V4。

整套工具从架构逻辑到功能细节,都在尽力挖掘 DeepSeek 的特性。

最直观的一点是 思维链。

DeepSeek-TUI 会直接把模型的推理过程以流的方式打印在终端里——模型如何剖析问题、走了哪条思路、中途是否改变了策略,这一切都实时可见。

接着是 上下文。既然 V4 支持 100 万 token 的超大上下文窗口,项目就默认吃满这个红利。跑复杂任务时,根本不用担心模型忘掉之前的指令。当上下文快溢出时,TUI 会自动进行智能压缩;你也可以随时用 /compact 手动触发。

这套压缩策略相当巧妙,它充分考虑了 DeepSeek 的前缀缓存机制——尽量保住前面稳定的部分,让缓存能够持续命中。毕竟,未命中的 token 价格可是命中的 10 倍。项目界面上有逐轮费用显示,所以跑长会话时可以多留意一下,免得账单让人心跳加速。

TUI 还有一个叫 RLM 的设计,思路非常“DeepSeek”——既然模型的性价比高到可以拿来堆量,那工具就顺势把这个特性用起来。

在 RLM 模式中,一个主模型会指挥最多 16 个 V4 Flash 子任务同时并行,用来做批量分析或任务拆解。Flash 的输出价格大约是 Pro 的三分之一,把不需要强推理的子任务甩给它,整体成本能削下来不少。

模型接入的切换也做了专门处理。除了 DeepSeek 官方 API,它还支持 NVIDIA NIM、Fireworks 和自托管的 SGLang 几条路径。

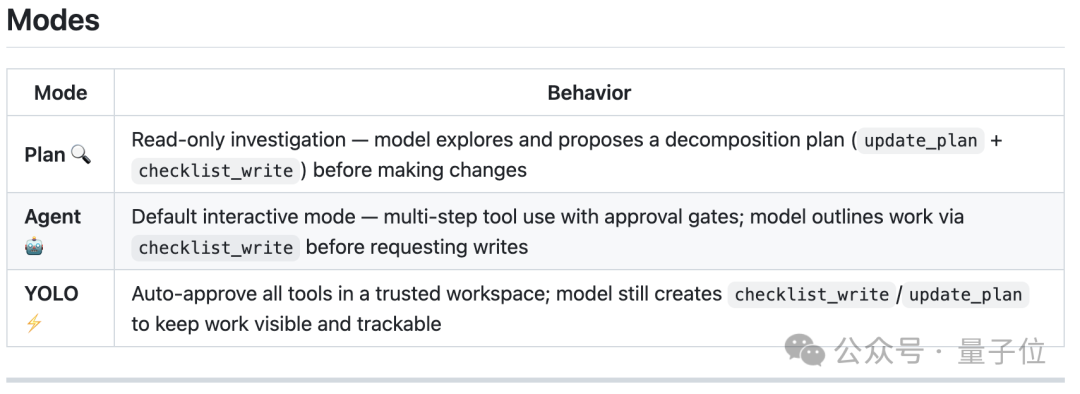

操作模式则分三档:

- Plan 模式是只读探索,模型会先为你勾勒一份分解计划;

- Agent 模式是默认档,每一步工具调用都得等你点头确认;

- YOLO 模式顾名思义,全自动放行,不想被打断的时候开启即可。会话可以保存并恢复,工作区有独立的 Git 快照兜底,支持按轮次回滚而不会弄乱你原仓库,翻了车也不慌。

安装也极其简单。Linux、macOS 和 Windows 系统都有预编译好的二进制文件,一条 npm install -g deepseek-tui 命令就能搞定。

值得一提的是,作者贴心地为国内用户准备了完整的中文版 README 文档和专门的配置路径。它不仅支持 TUNA Cargo 镜像,release 包还可以托管到阿里云 OSS 或腾讯云 COS。

项目在 1 月 19 日创建,做到现在不到四个月,已经迭代到了 v0.8.8,发布了 37 个版本,节奏相当快。

从更新记录来看,脉络很清晰。早期版本主要在搭骨架——实现工具调用、会话管理、基础的 Git 快照,一切以先让 Agent 跑起来为最高优先级。v0.7.x 阶段开始往细节里钻,比如通过 v0.7.6 增加了多语言界面支持,中文本地化的 TUI 提示、帮助文本和状态栏就是这时加进来的,这也是特意为国内用户铺的路。v0.8.x 是近期的主旋律,火力集中在稳定性和体验打磨上:

- v0.8.2 专门修复了长会话中文件句柄泄漏的坑;

- v0.8.6/v0.8.7 增加了一批交互功能,比如遭遇限流或服务器报错时显示倒计时重试横幅、输入历史搜索、运行中的消息队列可视化;

- v0.8.8 在此基础上做了一轮收口,同时补全了 Linux ARM64 的预编译二进制。

整体来看,这个迭代路径功能更新很密集,但每个版本几乎都有它要解决的明确痛点。

“爱科学的音乐家”,用跨界的钥匙打开 AI

其实 Hunter 一直是 DeepSeek 的铁杆粉。自打 V4 出来以后,他就没少发推文花式称赞。

他对中国的大模型似乎情有独钟,还参与过小米的百万亿 Token 创造者激励计划。

然而,Hunter Bown 最初的人生剧本,其实是一位乐队指挥。

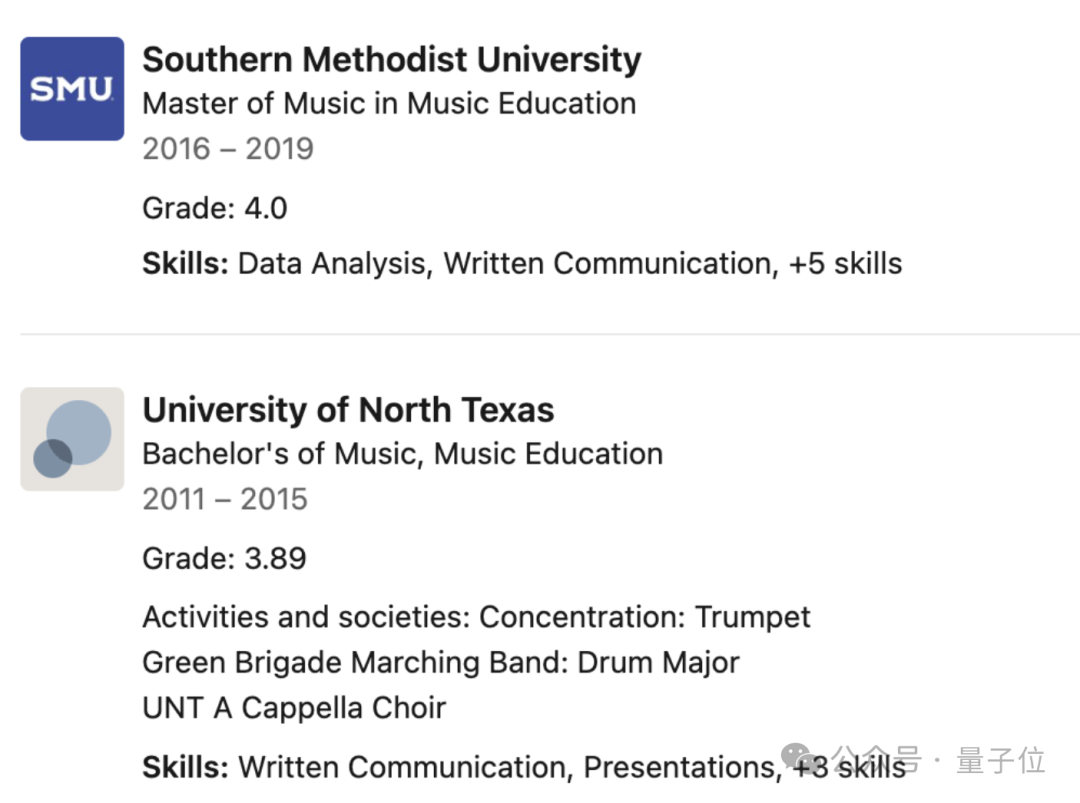

他先在北得克萨斯州大学修读音乐教育,毕业后继续深造,拿下了南方卫理公会大学(SMU)的音乐教育硕士。

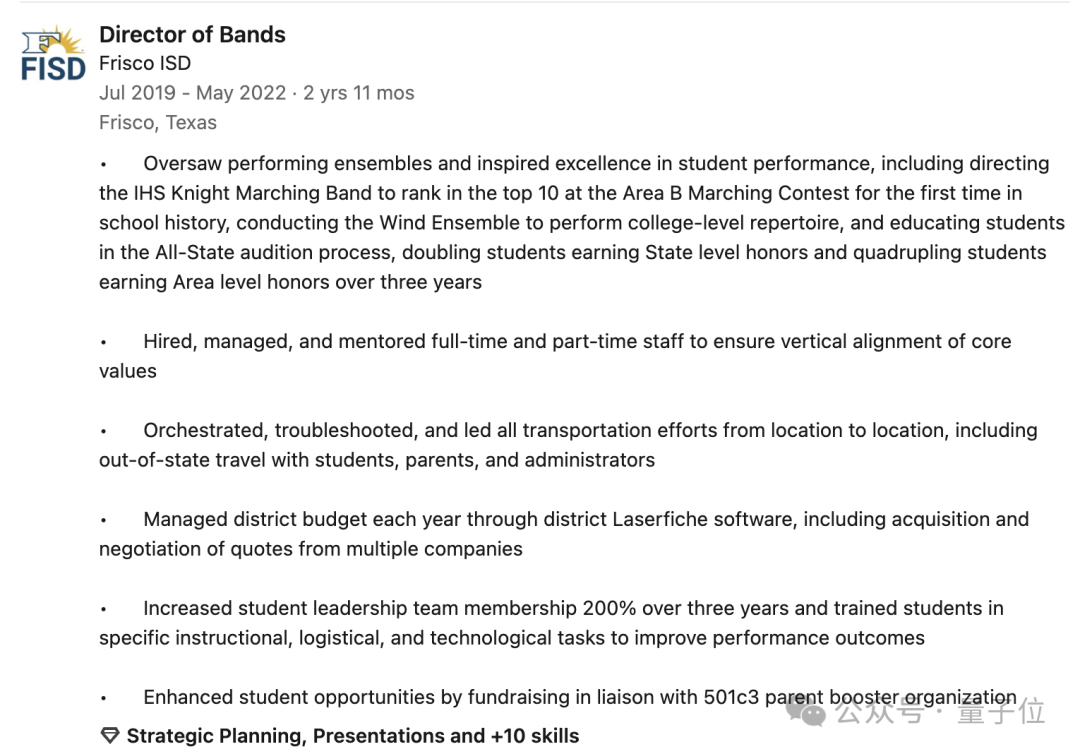

硕士毕业后,Hunter 如愿以偿地执棒了三年。

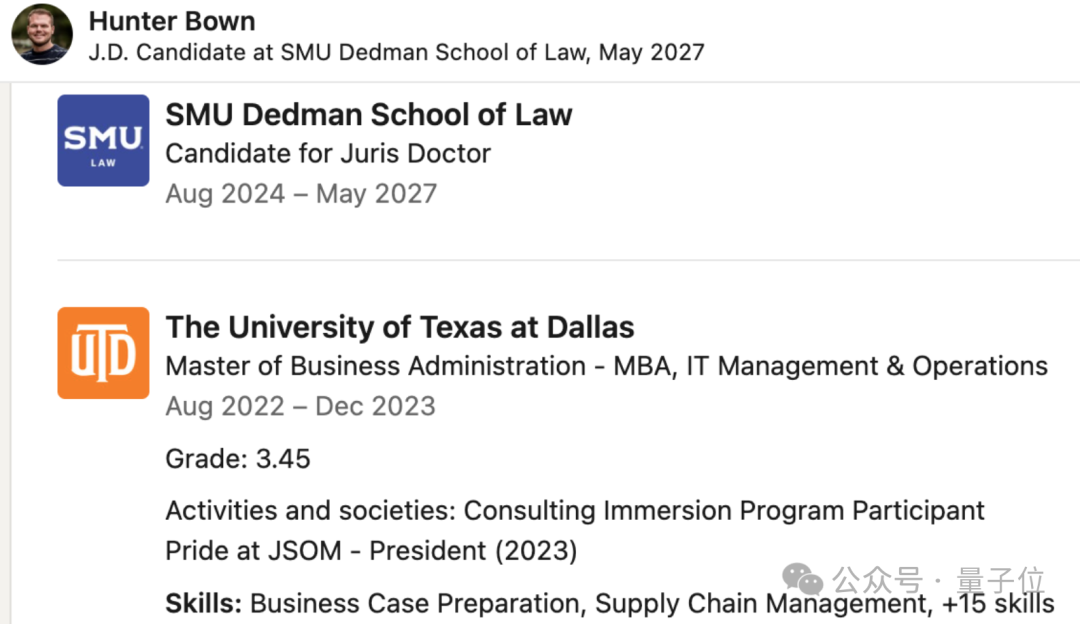

之后,他的人生轨迹来了个大转弯。他先是在得克萨斯大学达拉斯分校拿下了 MBA,随后又回到母校 SMU,进入法学院专攻专利法。

至于写代码这件事,那更是“半路出家”。

但这个“半路”并非是彻底的转向,更像几条看似无关的支流最终汇入一江春水。他在学习声乐科学时,接触到一个叫“缺失基音”的概念——人耳能神奇地从泛音里重构出一个物理上并不存在的音高。后来他猛然发现,这和信息论简直严丝合缝:你不需要把所有的信息都明确摆出来,系统本身就会去“脑补”。

这份来自音乐的直觉,成了他理解 AI 系统的一把独特钥匙。

去年,他创立了自己的工作室,起名 Shannon Labs,定位宏大——“AGI 时代的下一个贝尔实验室”。DeepSeek-TUI 在他那里,不过是众多研究项目中的一个。他的 GitHub 上有 65 个公开仓库,涵盖了像面向 NVIDIA Nemotron 的同款终端 Agent NeMoCode,以及 MLX kernel 工具包等等。

Shannon Labs 旗下的项目跨度更是大到离谱。

- Hegelion 是一个辩证推理引擎,循着“正题→反题→合题”的循环逻辑;

- Aleph 是一个 MCP 服务器,主打零 token 成本的大容量上下文;

- Heliosinger 则把太阳风数据实时转化成声音,直接跨界到了太空声学。

他还自建了三套软件架构(SCU、Driftlock、Hegelion)和一个硬件方案(Driftlock Choir)。在他眼里,把这些拼图合在一起,是在为未来的 AGI 时代铺路。

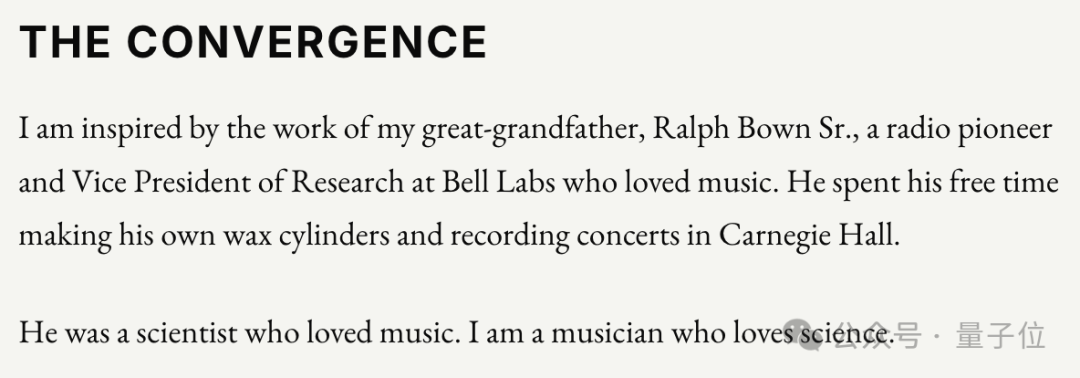

能把这么多方向串起来,和他的家族渊源也密切相关。他的曾祖父 Ralph Bown Sr. 是贝尔实验室的研究副总裁、无线电先驱,业余时间却热爱自制蜡筒,跑到卡内基音乐厅去录音。

Hunter 在专利法课上突然意识到,自己正在走一条与曾祖父交汇的路——把音乐人的感知方式注入技术研究,去发现那些“因为研究者没有这种背景而被忽视的想法”。

他在个人网站上将自己与曾祖父做了个对比:“他是科学家,热爱音乐;我是音乐家,热爱科学。”

One More Thing

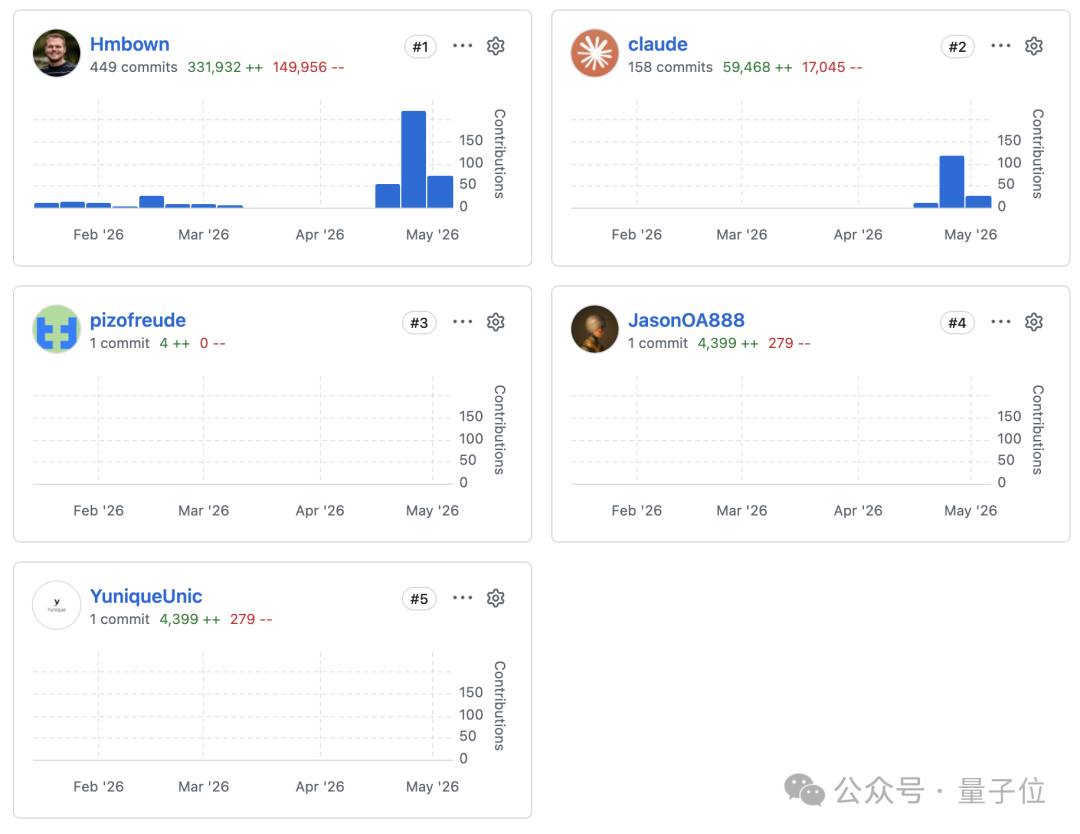

在 DeepSeek-TUI 的贡献者列表中,我们还能看见一些熟悉的身影。这其中赫然包括了 Claude、Gemini、Qwen 等一系列 AI 模型,以及 Cursor 和 GitHub Copilot 这样的编程工具。

详细的提交记录更是说明了这一点:绝大多数代码由 Hunter 亲自敲下,还有 150 多次 commit 是 Claude 完成的,间或有一些真人贡献者提交了少量代码。

一位半路出家的程序员,用 AI 辅助编程给 AI 写辅助编程框架——你看,这工作流不就完美闭环了?

GitHub 地址:

https://github.com/Hmbown/DeepSeek-TUI

当下,像这样由个人开发者发起的优质 开源实战 项目正源源不断地在 云栈社区 被开发者们挖掘和热议,如果你也对前沿工具与极客文化着迷,不妨多来社区里转转,总有让你眼前一亮的宝藏项目。