最近,开源AI助手项目Clawdbot(现已更名为OpenClaw)引起了广泛关注。我利用周末时间,成功在一台Linux服务器上完成了它的部署,并接入了飞书,让它成为了一个随时在线的智能助理。

过程虽然遇到了一些小波折,但最终顺利解决。下面就把详细的步骤和遇到的问题分享出来,希望能帮你绕过我踩过的坑。

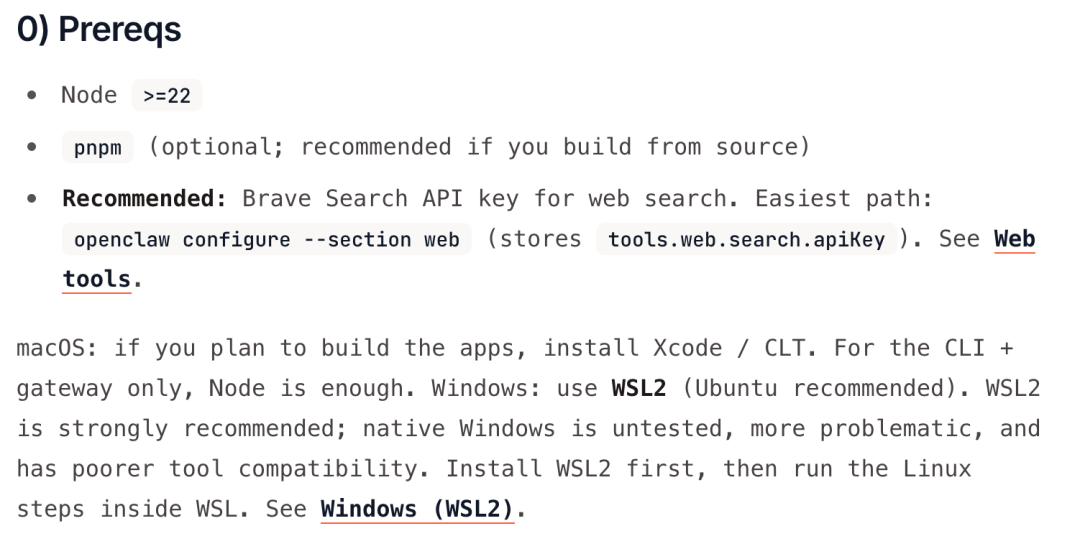

安装准备与环境要求

根据官方文档的说明,安装OpenClaw有一些前提条件。

核心要求是 Node.js版本需大于等于22。其他如使用pnpm包管理器、配置Brave搜索API密钥等都是可选的。对于新手,我建议先专注于核心安装,不必一开始就配置复杂的搜索功能。

主要安装过程

安装主要通过官方的一键脚本完成。在Linux终端中执行以下命令:

curl -fsSL https://openclaw.bot/install.sh | bash

如果你使用的是Windows系统,对应的PowerShell命令是:

iwr -useb https://openclaw.ai/install.ps1 | iex

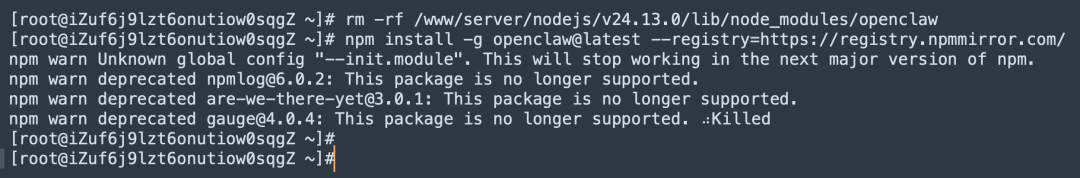

问题一:服务器内存不足

我使用的是一台配置较低的服务器(2核2G),在安装过程中出现了内存不足导致进程被终止的情况。

如果你也遇到了类似问题,可以改用--method git参数进行安装,这种方式对内存的需求相对小一些:

curl -fsSL https://openclaw.bot/install.sh | bash -s -- --method git

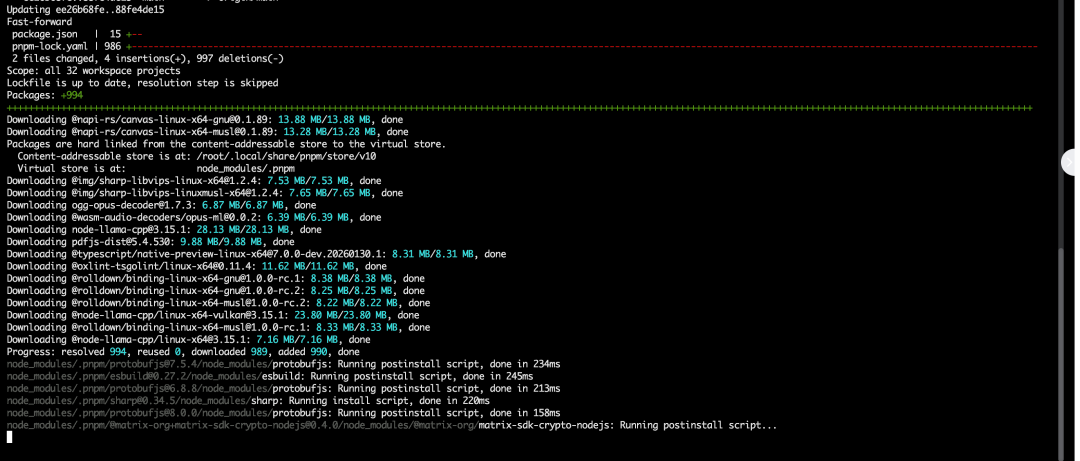

问题二:安装过程耗时较长

安装时需要下载和编译大量依赖,过程可能会比较慢,尤其在网络或性能一般的机器上。期间终端会滚动大量日志,请耐心等待。

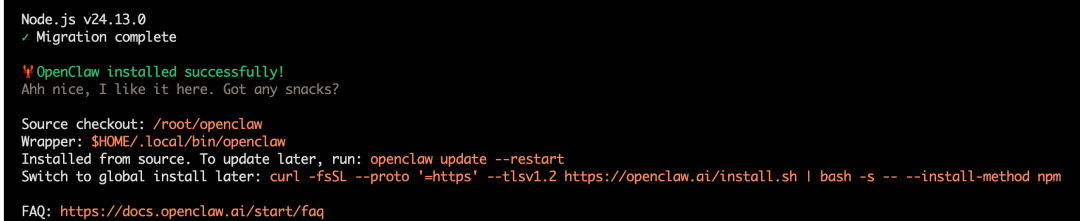

最终,如果看到类似下面的输出,就说明安装成功了。

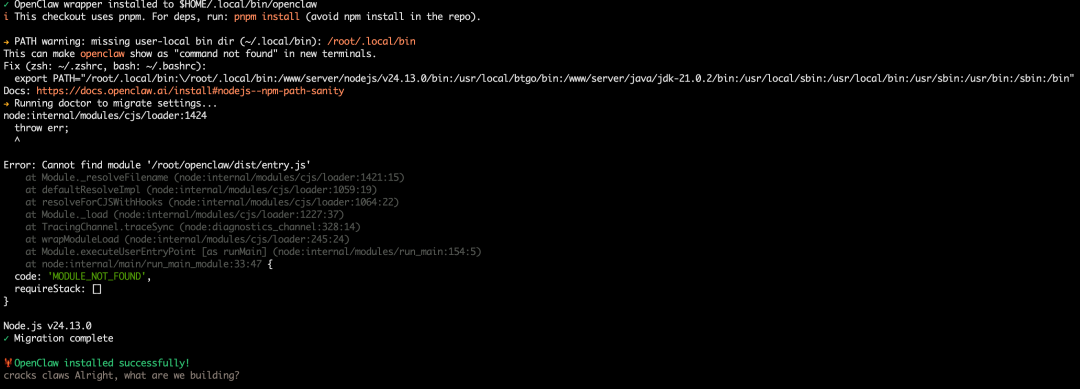

问题三:入口文件路径错误

在某些情况下,你可能会遇到一个关于找不到entry.js模块的报错。

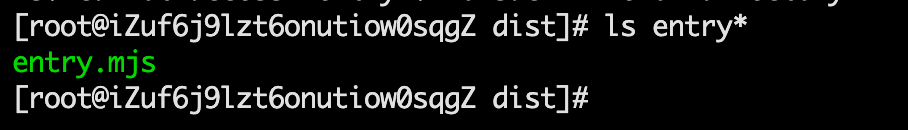

这是因为安装脚本可能较旧,它默认寻找dist/entry.js文件,但新版本构建出的入口文件是dist/entry.mjs。你可以通过ls命令确认一下。

解决方法很简单,手动创建或修正启动包装器,指向正确的.mjs文件:

cat > /usr/local/bin/openclaw <<EOF

#!/bin/bash

# 注意这里指向的是 .mjs 文件

exec node “/root/openclaw/dist/entry.mjs” “\$@”

EOF

然后赋予执行权限:

chmod +x /usr/local/bin/openclaw

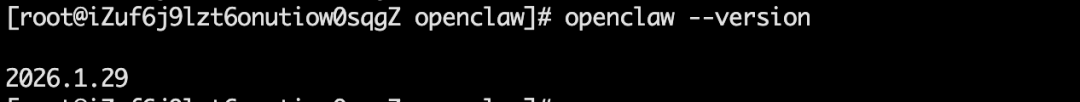

修复后,执行openclaw --version应该能正常显示版本号。

初始化配置与接入飞书

基础安装完成后,需要进行初始配置。执行以下命令开始:

openclaw onboard --install-daemon

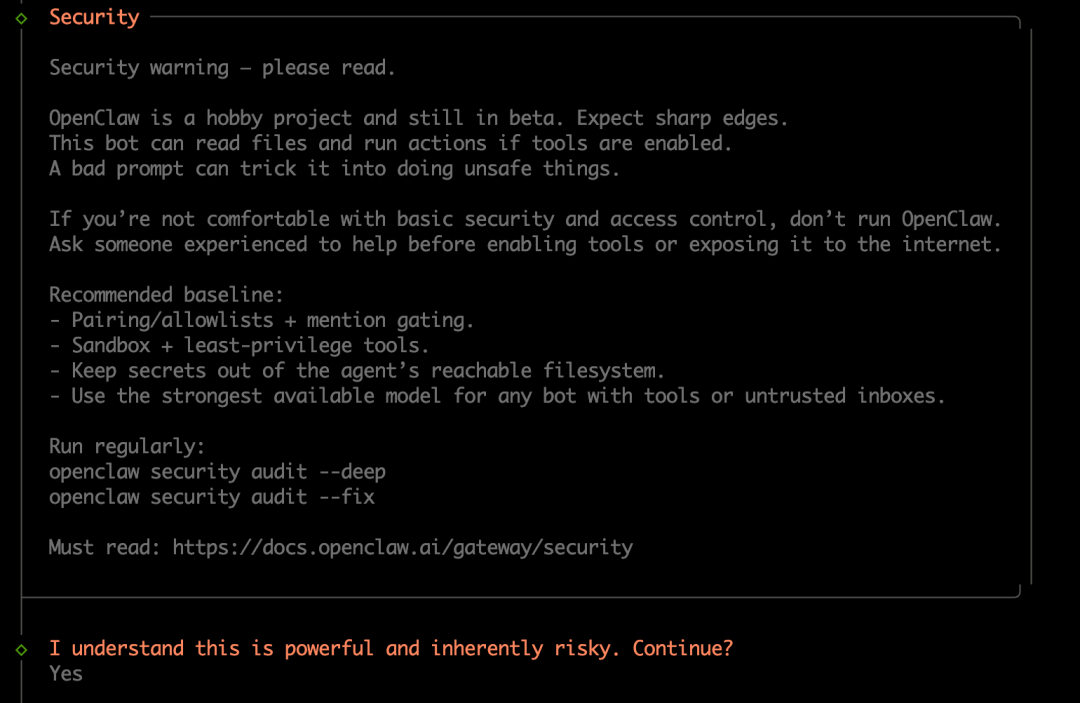

1. 确认安全警告

首先会出现安全警告,你必须阅读并同意才能继续。

2. 选择AI模型

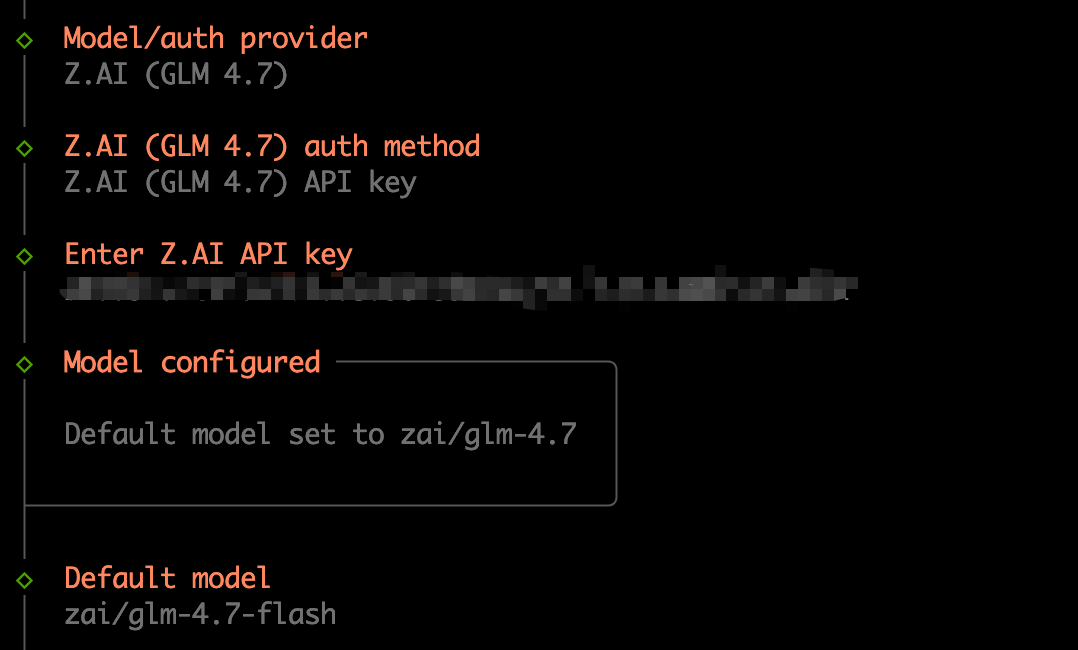

在初始化向导中,选择QuickStart模式。接着需要配置AI模型,OpenClaw支持多种主流模型,如OpenAI、Anthropic、智谱AI等。我这里以智谱AI(GLM)为例进行配置。

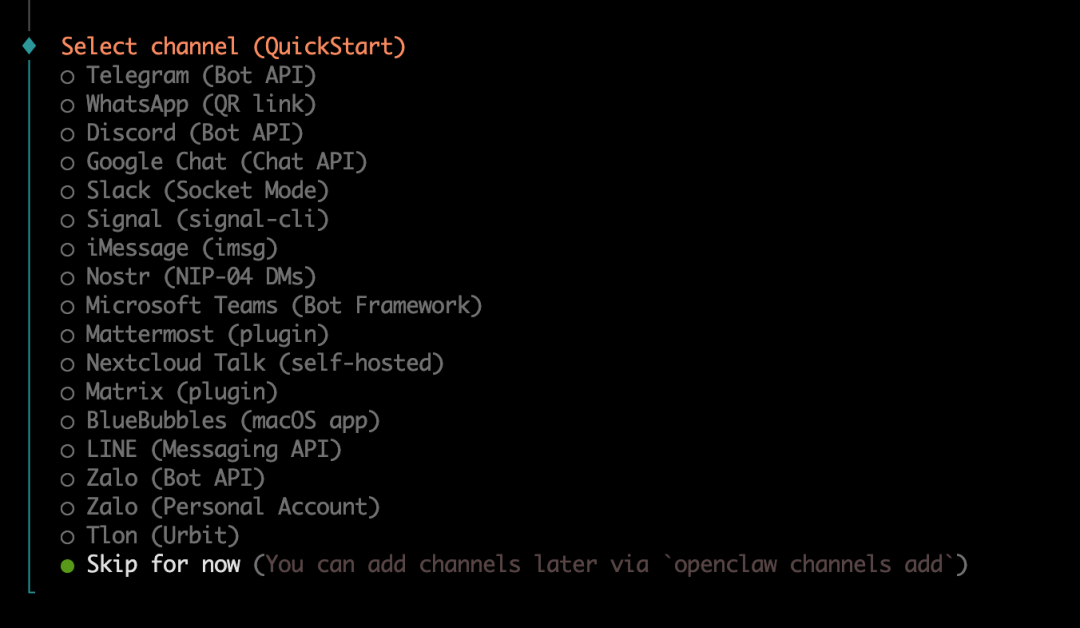

3. 跳过默认频道配置

在配置通讯渠道时,官方列表可能不包含国内常用的应用。这里我们选择Skip for now,稍后手动接入飞书。

后续的初始化步骤可能会输出一些警告或报错信息(例如健康检查失败),这通常不影响核心功能,可以暂时忽略。

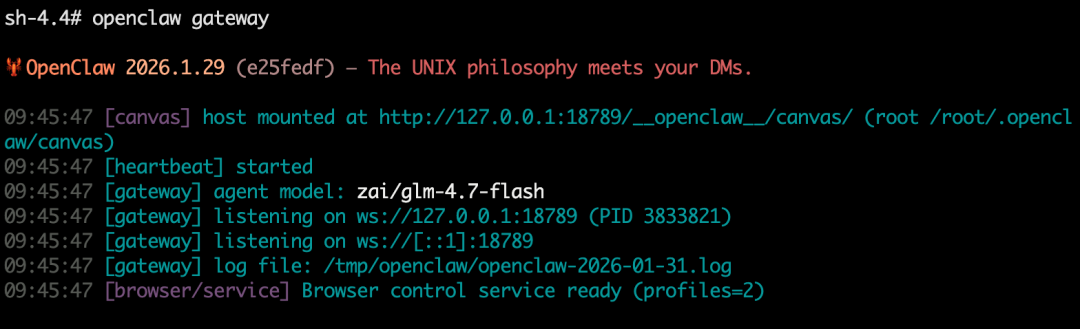

4. 启动网关服务

配置完成后,需要让OpenClaw的网关服务在后台持续运行。这里使用screen工具来管理会话:

screen -S claw

openclaw gateway

如果系统未安装screen,可以使用yum install screen -y或apt install screen先行安装。

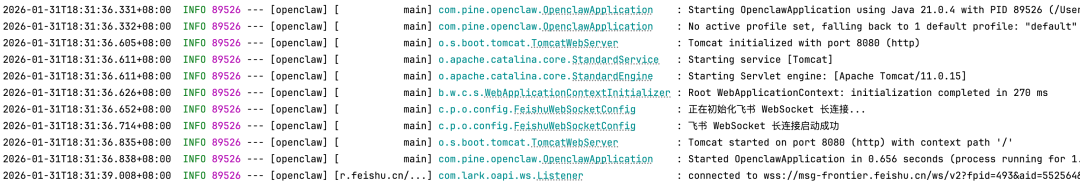

当看到服务成功监听端口的日志时,说明网关已启动。

此时,按下 Ctrl + A,然后按 D 键,可以暂时退出这个screen会话(服务仍在后台运行)。

5. 配置飞书长连接

将OpenClaw接入飞书,需要借助第三方开源项目,例如 m1heng/clawdbot-feishu。其文档提供了详细的配置指南,你需要按照步骤在飞书开放平台创建应用、获取凭证。

关键点:在配置事件订阅时,飞书要求你提供一个能接收事件的服务地址。这里推荐使用 “长连接” 模式,这通常比配置公网回调URL更简单。你需要按照飞书官方SDK的指引,在本地或一个临时环境启动一个客户端来建立长连接,以完成事件订阅的配置。

可以参考以下提示词向AI助手寻求配置帮助:

请帮我配置飞书开放平台的长连接(WebSocket)事件订阅。

参考飞书官方文档:

- 请求地址配置案例:https://open.feishu.cn/document/server-docs/event-subscription-guide/event-subscription-configure-/request-url-configuration-case

- 服务端SDK:https://open.feishu.cn/document/server-docs/server-side-sdk

成功建立连接后,平台会显示连接状态。

6. 服务器端配置飞书频道

获取到飞书应用的App ID和App Secret后,回到你的Linux服务器,执行以下命令进行配置:

# 1. 设置飞书 App ID

openclaw config set channels.feishu.appId “你的AppId”

# 2. 设置飞书 App Secret

openclaw config set channels.feishu.appSecret “你的AppSecret”

# 3. 指定使用WebSocket模式

openclaw config set channels.feishu.mode “websocket”

7. 重启服务并验证

配置完成后,需要重启OpenClaw网关服务以使配置生效。

screen -r claw # 回到之前名为‘claw’的screen会话

# 在会话中按 Ctrl+C 停止当前运行的网关

openclaw gateway # 重新启动网关

等待服务启动完毕。现在,你可以在飞书中与你创建的应用机器人对话,OpenClaw应该能够正常响应了,就像一个随时待命的AI助手。关于更复杂的技能配置和运维管理,可以参考更深入的技术文档。

整个部署过程涉及从环境准备、软件安装、故障排查到第三方服务集成的完整链路,是学习现代Node.js应用部署和AI工具实践的很好案例。如果在尝试中遇到其他问题,欢迎在技术社区交流探讨。