你用过Claude吗?想必大多数人的体验是:问个问题,得到答案,然后关掉页面。感觉就像用一个更聪明的搜索引擎。

但Claude的能力早已不止于“说”。如今,它能写代码、整理文件、操作浏览器,甚至可以全天候自动管理你的数字生活。

这就引出了一个核心问题:你愿意把多少“方向盘”交给它?

这个问题的答案,其实就藏在Anthropic精心设计的系列产品中。

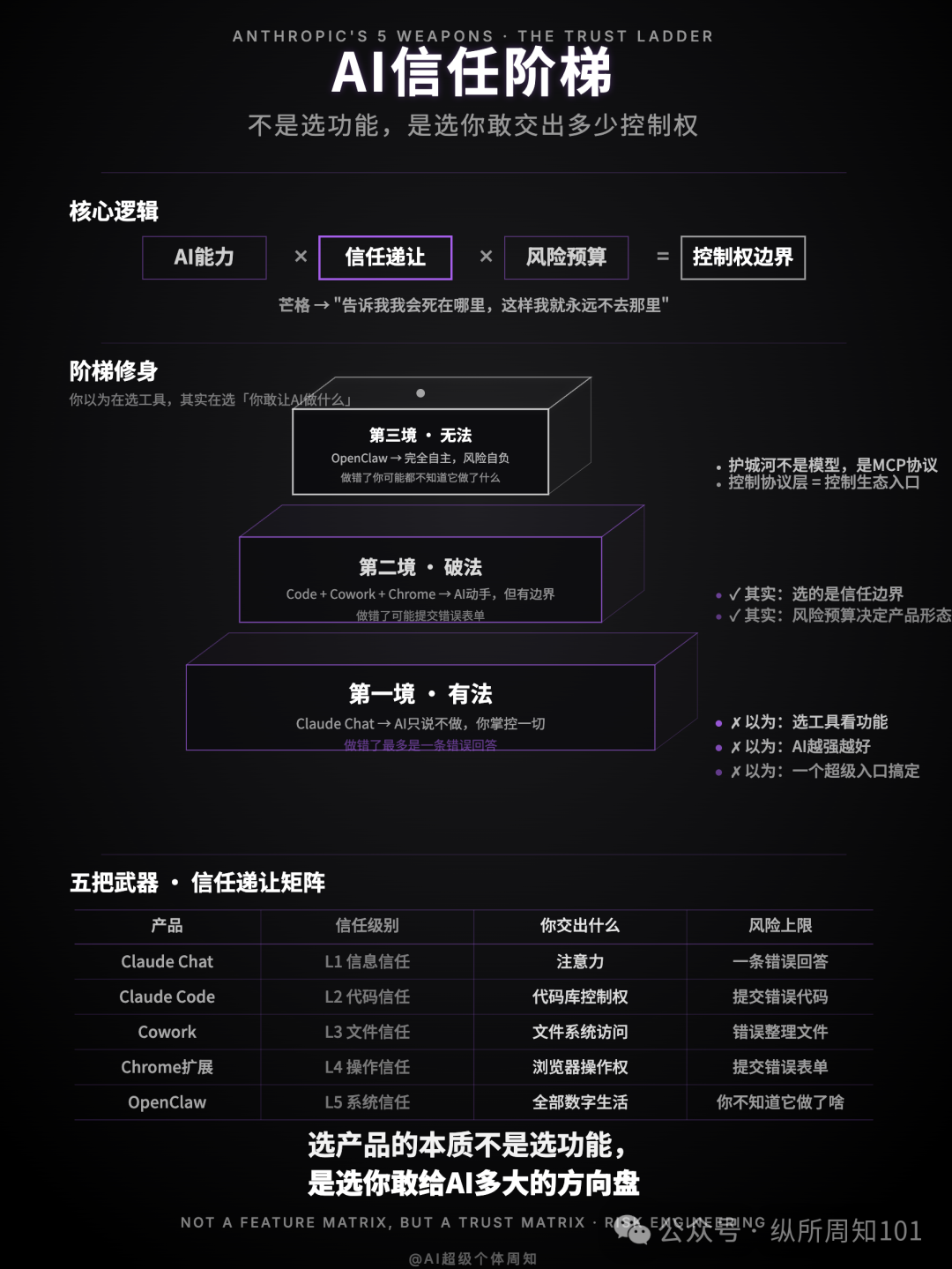

一、不是五个工具,而是一条信任阶梯

首先需要明确一点。很多人将Anthropic的产品视为一份“功能清单”——这个能聊天,那个能写代码,另一个能操作浏览器。

但其本质并非功能矩阵,而是信任矩阵。

每一款产品对应的,不是“AI能做什么”,而是“你愿意让AI做什么”。我将其称为 “信任递让阶梯” ,共分五级:

Level 1:信息信任 → Claude Chat

“你说的我信” —— 问问题,看回答

Level 2:代码信任 → Claude Code

“你写的代码我用” —— 让AI改代码、提PR

Level 3:文件信任 → Cowork

“你动我的文件可以” —— 让AI整理文件夹、做PPT

Level 4:操作信任 → Claude in Chrome

“你替我操作网页” —— 让AI帮你填表、抓数据

Level 5:系统信任 → OpenClaw

“你管我全部数字生活” —— 7×24小时AI管家

芒格有句名言:“告诉我我会死在哪里,这样我就永远不去那里。” Anthropic的产品设计也暗含此理——核心问题并非“AI能做什么”,而是“AI做错了,在哪一层用户还能兜住底”。

Chat做错了,最多是一条错误回答。Chrome扩展做错了,可能帮你提交了一个错误的表单。OpenClaw做错了……你可能都不知道它做了什么。

风险预算不同,对应的产品就不同。这本质上是一种风险工程。

二、五款产品,逐一拆解

第一把:Claude Chat —— 最聪明的对话伙伴

这是你最熟悉的Claude。网页版、App、桌面端皆可使用,用于问答、写作、数据分析、文件生成。模型可选Haiku 4.5(快)、Sonnet 4.5(均衡)、Opus 4.6(最强)。

心智锚点:“我有个问题想聊聊。”

免费版已能满足日常需求。Pro版20美元/月可解锁更多用量与高级模型。

一句话定位:所有人的AI入口。无需任何技术背景,打开即用。

第二把:Claude Code —— 开发者的AI代驾

从这里开始变得有趣。如果说Cursor和GitHub Copilot是“副驾驶”(提建议,你来操作),那么Claude Code更像是“代驾”——你指明目的地,它来驾驶。

它能理解整个代码库的上下文,自主完成读取、修改、运行测试、提交PR等一系列操作。可以在终端、IDE甚至Slack中调用。

关键数据:有开发者反馈,在修改一个18000行的React组件时,其他AI助手均告失败,只有Claude Code成功完成了任务。

但更有意思的是用户的“越界使用”。Anthropic工程师Boris Cherny透露,用户拿Claude Code来做度假研究、制作PPT、清理邮件、修复婚礼照片、监控植物生长,甚至控制烤箱。

一个写代码的工具,被用户用来“烤鸡翅”。

这种广泛的需求,直接催生了下一款产品。

第三把:Cowork —— 非技术人士的AI同事

Cowork并非规划中的产品,它是被用户“逼”出来的。

路径很清晰:开发者用Claude Code干非编程的活儿 → Anthropic发现了真实的市场需求 → 用Claude Code自身在一周半内开发出了Cowork。

没错,用AI来开发AI产品,这已经成为现实。

Cowork集成在Claude桌面端中,切换一个标签页即可使用。你只需将一个文件夹拖给它,并下达指令:“帮我把这堆发票整理成Excel表格。”然后就可以离开去喝杯咖啡。

回来时,工作已经完成。

心智锚点:“帮我把这堆文件处理一下。”

如果说Claude Chat是你的“微信好友”(只能说不做),那么Cowork就是坐在你旁边的“同工位同事”。想了解更多这类提升效率的AI应用,可以访问我们的人工智能板块。

第四把:Claude in Chrome —— 浏览器里的实习生

想象一下,你雇了一个人在电脑前替你“点击鼠标”。它不看代码,而是通过屏幕截图理解界面,知道放大镜图标代表搜索,“提交”按钮意味着确认。

一个真实案例:有用户让Claude Chrome扩展自动与AT&T客服谈判,追回了100多美元退款,并自动准备好了向FCC投诉的表格。

你最不想做但又不得不做的重复性网页操作——它可以替你完成。

它还支持定时任务。例如,每天自动从5个竞品网站抓取价格数据,汇总成表格,每天为你节省30分钟。

但需要注意:它会自动屏蔽金融、成人内容等高风险网站。同时,提示词注入的风险真实存在。

切勿在敏感操作上完全信任自动执行。

第五把:OpenClaw —— 极客的AI私人管家

首先必须澄清:OpenClaw并非Anthropic的官方产品。

它是奥地利开发者Peter Steinberger的开源项目,原名Clawdbot,后因商标问题改名。它使用Claude等模型,但不隶属于Anthropic。

如果Claude是“某家大公司的员工”(受严格规则约束),那么OpenClaw就是“你自己豢养的AI管家”——它住在你的电脑上,用什么“大脑”(Claude/GPT/DeepSeek)由你选,能做什么事由你定。

代价?你需要自己负责安全。

创始人Steinberger坦言:“提示注入是行业尚未解决的难题。目前不推荐非技术用户使用。”

敢说真话的创始人,反而赢得了社区的更多信任。

其GitHub星标数随之暴涨。像Moltbook这样的平台,有150万AI Agent在互相发帖社交。Karpathy称其为“我见过最不可思议的类科幻起飞现象”。对这个顶级的开源实战项目感兴趣的朋友,可以深入研究。

三、如何选择?一张表搞定

说了这么多,最终要落到实操上。

你应该用哪一个?

┌──────────────────┬─────────────────────┬──────────────┐

│ 你的身份 │ 推荐组合 │ 月费 │

├──────────────────┼─────────────────────┼──────────────┤

│ 普通用户/轻度使用 │ Claude Chat Free │ $0 │

│ 知识工作者/超级个体 │ Chat + Cowork (Pro) │ $20 │

│ 深度用户 │ Chat + Cowork (Max) │ $100-200 │

│ 开发者 │ Chat + Claude Code │ $20 + API费 │

│ 技术极客 │ 以上 + OpenClaw │ $20 + API费 │

└──────────────────┴─────────────────────┴──────────────┘

三条避坑原则:

第一,别一上来就购买每月200美元的Max套餐。对于大多数人,每月20美元的Pro版已足够。Opus 4.6在处理简单任务时可能会“过度思考”,反而增加延迟。日常对话使用Sonnet模型即可。

第二,别同时尝试所有产品。选定一个,用透,再考虑添加下一个。

第三,别给零技术基础的朋友推荐OpenClaw。不是它不好,而是其安全与配置门槛确实很高。

四、往深处想:为何不做单一超级入口?

很多人有此疑问。OpenAI似乎在朝着“一个入口解决所有问题”的方向前进,为何Anthropic要铺开5条产品线?

答案藏在四个常量之中:

常量一:AI能力已经足够。Opus 4.6在SWE-bench上的编程能力达到77.2%,在金融Agent评测中排名第一。技术本身已不再是瓶颈。

常量二:用户信任是渐进的。没有人会在第一天就敢让AI管理自己的全部文件。从“看看它的回答”到“让它操作我的浏览器”,需要一级一级地向上攀爬。

常量三:用户群体差异巨大。开发者习惯用终端,普通人需要图形界面,极客追求开源可控。单一界面无法服务所有人。

常量四:安全风险不可逆。一次严重事故,可能毁掉一整条产品线。Chrome扩展先进行1000人内测,再开放给Max用户,最后才推向全体付费用户——正是遵循这一逻辑。

所以——

设置多个入口,并非因为做不出一个超级AI助手,而是因为“信任阶梯”无法跳级。

产品线的展开,本质上是一条“风险预算分配线”。Chat分配最低的风险预算,OpenClaw分配最高的——但相应的风险也转由用户自行承担。

用道家的境界来比喻,可分为三境:

第一境:有法(Chat)—— 规则明确,AI只说不做

第二境:破法(Code/Cowork/Chrome)—— 开始让AI动手,但设下边界

第三境:无法(OpenClaw)—— 完全自主,风险自负

大多数人停留在第一境就足够了。少数人走到第二境,效率得以翻倍。极少数人进入第三境——这不仅需要技术能力,更需要承担风险的勇气。

五、真正的护城河并非模型

最后说一个反直觉的观点。很多人认为AI公司的竞争是模型之战,比拼的是GPT-5.2与Opus 4.6谁的基准测试分数更高。

但模型之间的能力差距正在迅速缩小。

那么,Anthropic真正的护城河是什么?

是MCP协议。

MCP(Model Context Protocol)是AI连接外部工具的标准接口。它就像USB接口——无论什么品牌的手机,一根Type-C线都能充电。同样,无论什么AI助手,只要支持MCP,就能连接上GitHub、Google Drive、Slack等工具。

历史类比:TCP/IP协议比任何一台单独的电脑都更重要。控制了协议层,就等于控制了生态的入口。

OpenClaw拥有50多个MCP连接器。Claude Code依靠MCP扩展能力。就连OpenAI也开始兼容MCP。

谁的协议成为行业标准,谁就将赢得未来。决定胜负的,不是谁的模型更聪明零点几个百分点。

这就是为什么Anthropic对OpenClaw仅仅发出了商标投诉(要求改名),而没有试图打压它——OpenClaw每多一个用户,就是MCP生态多一个参与者,也就为Anthropic的API收入多贡献一份力量。

表面上看似竞争对手,实则是生态的加速器。

写在最后

2026年将不再是“AI聊天的年代”,而是“AI干活的年代”。

从Chat到Code,再到Cowork、Chrome扩展乃至OpenClaw——这不仅仅是一条产品线,更是人类与AI协作关系的进化路径。

你可以选择站在这条路径上的任何一点。但你不能假装这条路径不存在。

选择产品的本质,并非选择功能,而是选择“你愿意赋予AI多大的控制权”。

这个选择,本身没有对错。但它必须是一个有意识的选择——而不是被惯性困在某个舒适的点上。

你自身越强,AI在你手中就越强大。这不是指“掌握更多AI技术”的强,而是指“敢于让工具替你做事,并且在它出错时能够兜住底”的强。

首先想清楚你自己的信任边界在哪里。剩下的,再放心地交给Agent去执行。

对AI如何重塑工作流、开发者如何利用这些工具构建应用等话题感兴趣?欢迎到云栈社区的开发者广场,与更多同行交流探讨。