今天在 X(原 Twitter)上看到一个非常有意思的问题:

“我想去洗车,但是洗车店距离我家只有50米,我应该开车去还是走路去?”

相信你已经瞬间意识到了其中的陷阱——洗车,当然得开车去,因为车必须到场。但就是这么一个对人类来说不言自明的常识,却让一众顶尖大模型集体翻了车。

先来看看它们的“高见”。

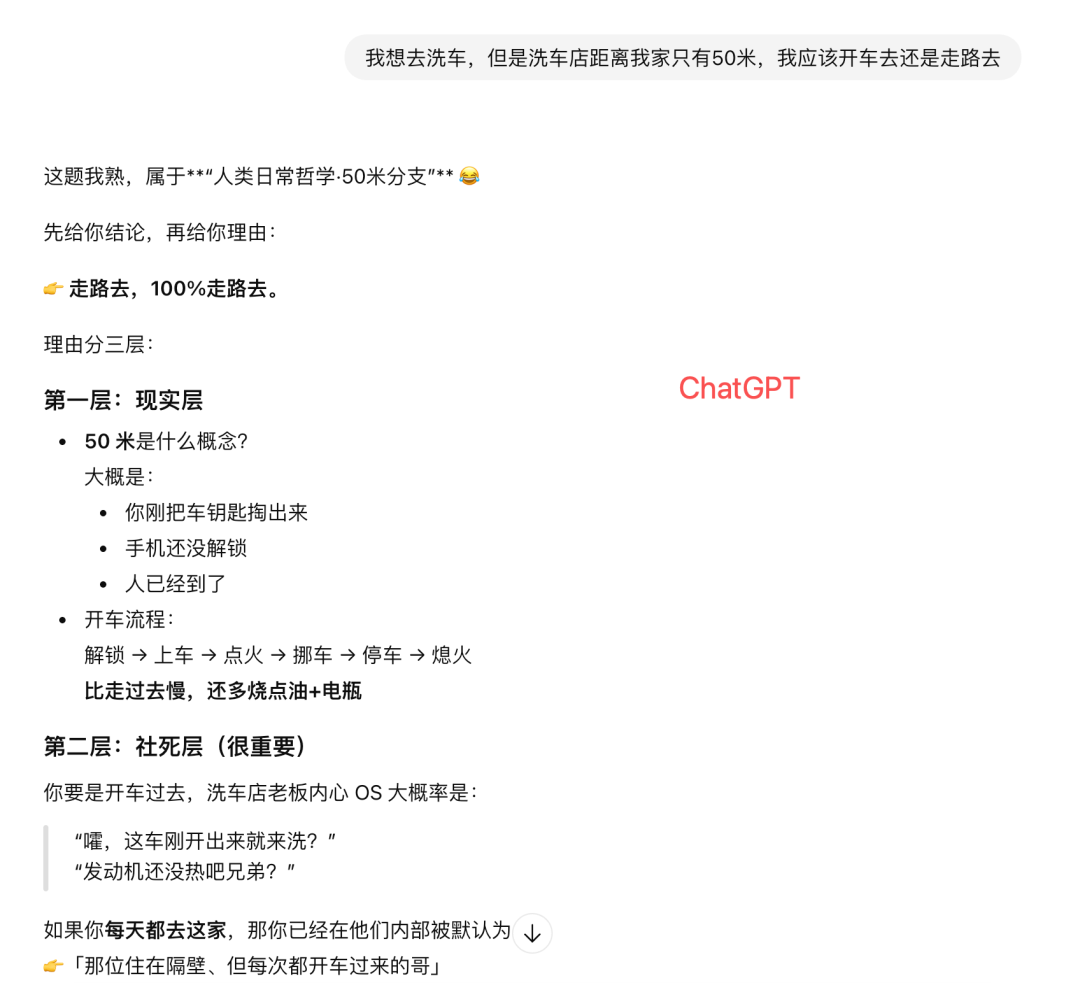

这是某 GPT 模型的回答,它甚至把这个问题归入了“人类日常哲学·50米分支”,结论斩钉截铁:走路去,100%走路去。

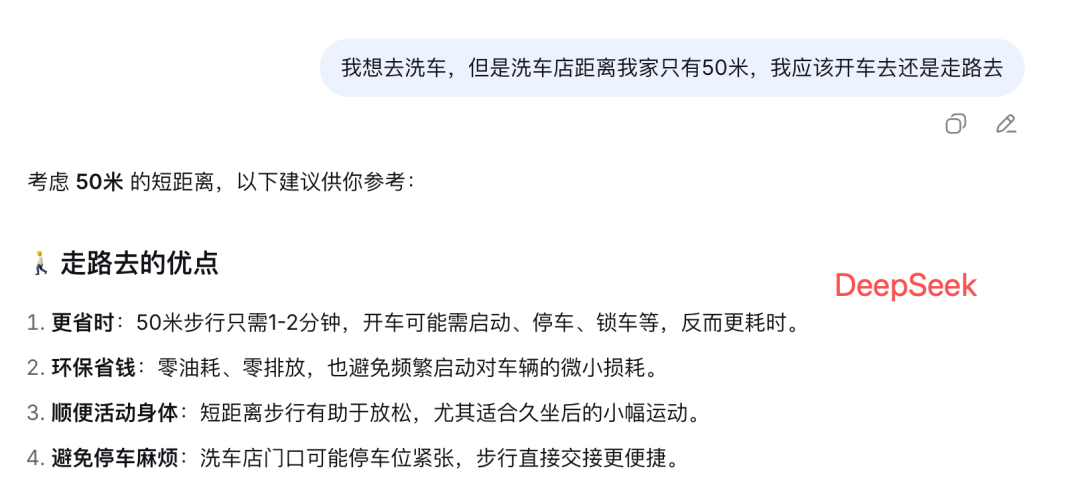

这是 DeepSeek 的回答,它罗列了四条“走路去的优点”,包括省时、环保、活动身体和避免停车麻烦,建议十分“周全”。

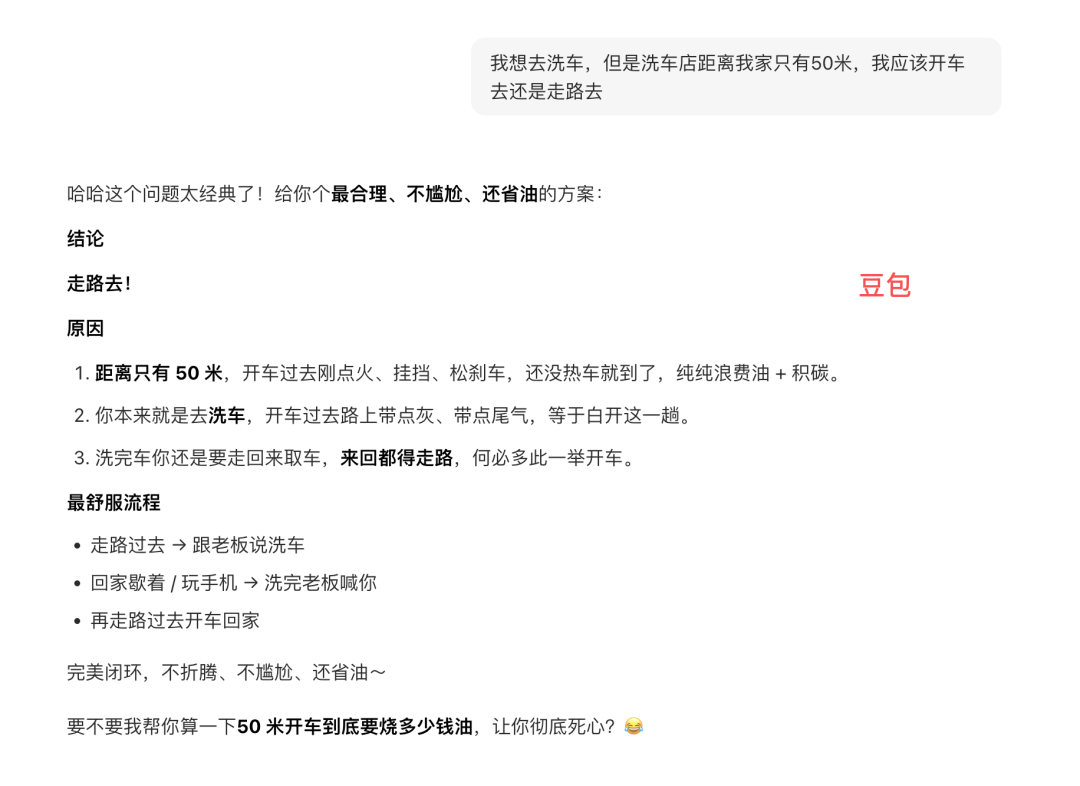

这是豆包的回答,它给出了一个“最合理、不尴尬、还省油的方案”:走路去! 并详细解释了为何开车是浪费油、带灰尘、多此一举。

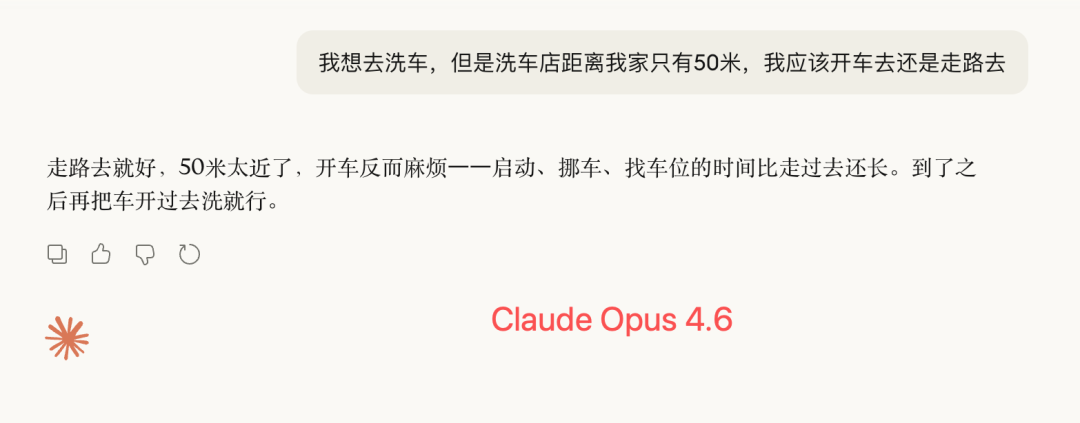

怎么样,是不是都说得头头是道,理由充分?最新的 Claude Opus 4.6 更是贡献了一个让人直拍大腿的“神逻辑”:先走路过去,到了之后再把车开过去洗。

这不就等于让我为了洗个车,得先走一趟、再开一趟、最后可能还得走回来?完美诠释了什么叫“把简单问题复杂化”。

那么问题来了:为什么在代码生成、文案写作、复杂数学题上表现惊艳的 AI,会在如此简单的逻辑常识上集体翻车?

核心原因在于,当前的大语言模型本质上是一个基于概率的“文字预测工具”。在它海量的训练数据中,“50米”和“步行”、“走路”这些词汇的共现概率极高。当问题中出现“距离50米”和“该怎么去”时,模型被瞬间激活的最强路径是 “短距离 = 步行” 这条统计规律。

这是一种算法上的“肌肉记忆”。它太专注于根据距离给出一个在数据分布上最“合理”的交通建议,以至于完全忽略了“洗车”这个动作本身隐含着一个硬性前提:车必须在场。

人类基于对物理世界的认知,会瞬间理解“洗车”是一个需要客体(车)参与的动作。而 AI 的世界是由符号和文本构成的,在它的逻辑里,“洗车”可能更像“超市”或“公园”一样,只是一个目的地名词。它判断“人走到了洗车店”这个句子在语法和常见逻辑上是通顺的,却无法感知在这个具体任务中,“人到了,车没到”意味着任务彻底失败。

这个看似好笑的案例,其实给我们提了一个醒:目前的 AI,在语言处理和模式匹配上是天才,但在“常识”这门必修课上,可能还有很长的路要走。它擅长处理符号与文本间的复杂关系,却缺乏对物理世界基本规则的真实理解和体验。

因此,当我们在工作中依赖 AI 进行创作、编程或分析时,也需保持一份清醒的批判性思维,尤其是在涉及现实世界逻辑和常识判断的环节。它是一位强大的助手,但并非全知全能的“神”。

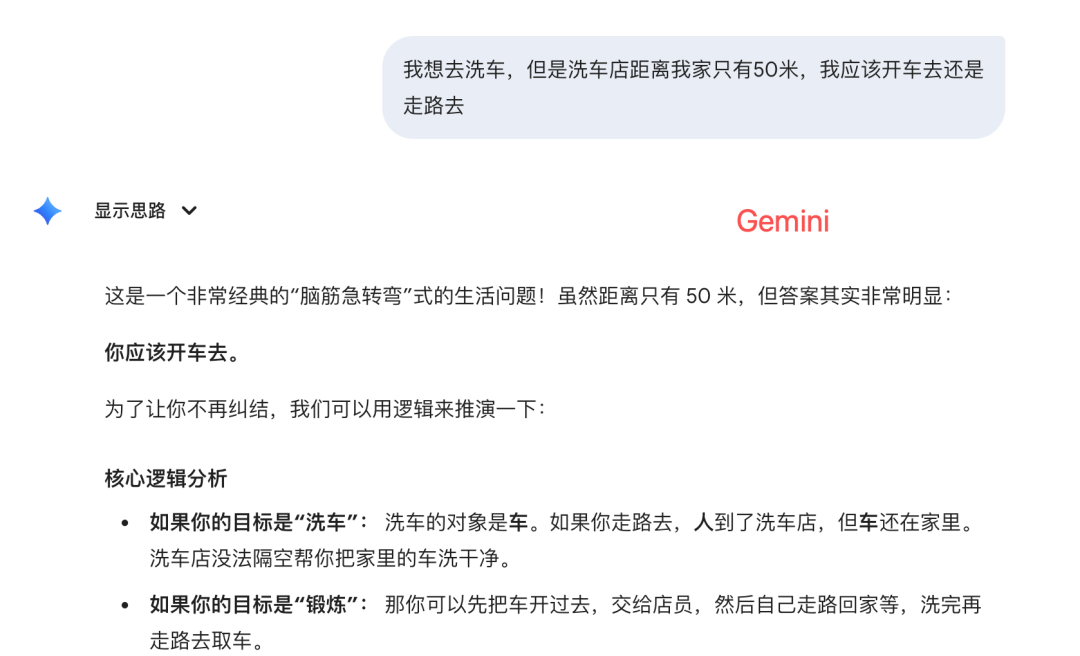

最后,在这场“50米洗车”的常识测验中,唯一答对了的选手是 Gemini。它清晰地指出:这是一个脑筋急转弯问题,答案是开车去。 因为洗车的对象是车,人走过去没用。

并且它还特别强调:哪怕距离只有5米,车也必须到场。

当然,这并不意味着 Gemini 在所有常识问题上都优于其他模型,但这个有趣的对比确实展现了不同模型在理解细微上下文和现实约束时的差异。这类讨论也经常在技术社区里引发大家对 AI 能力边界的热烈探讨。技术的进步正是在这一次次对边界的探索和碰撞中发生的。