人工智能代理(AI Agent)正在快速走出演示阶段,进入企业实际试点。未来,这些代理将被嵌入核心业务流程,事实上,已有专业人员开始使用它们处理财务分析、文档审查乃至内容创作等任务。但随着这类“智能体”应用日益增多,一个根本问题逐渐凸显:我们该如何客观、量化地评估一个 AI 代理是否真正有效?

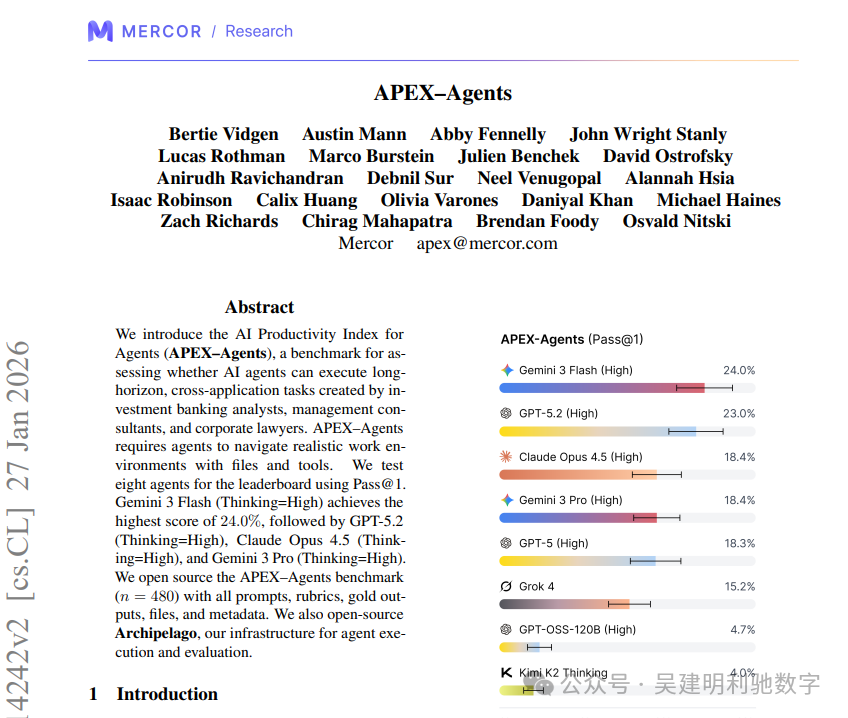

近期一项名为 APEX-Agents(AI生产力指数)的基准研究试图回答这个全球CIO和COO们都在关注的问题。

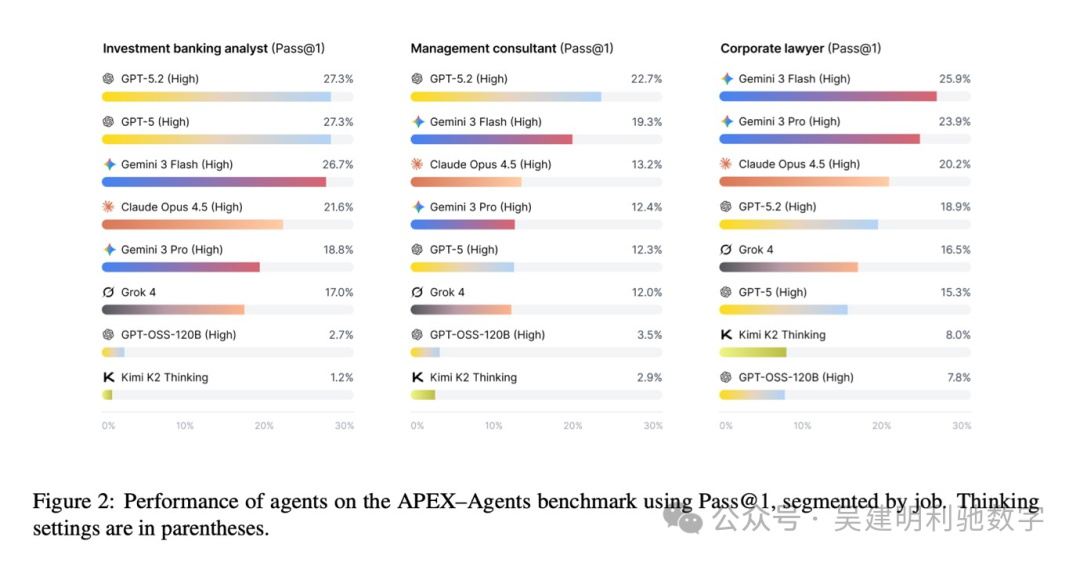

这项研究基于投资银行分析师、管理顾问和公司律师设计的真实工作任务,旨在评估 人工智能 代理是否能应对知识密集型行业中典型的、跨应用、长周期的复杂任务。

AI 代理表现究竟如何?

答案可能让人有些意外。在“首次尝试即成功”(Pass@1)的严格标准下,表现最佳的AI代理成功率仅为 24%。这说明,尽管AI代理并非毫无用处,但这一数据迫使我们重新思考其真正的能力边界与高效应用方式。

那么,这24%的成功率究竟意味着什么?当前阶段的AI代理能胜任哪些企业级任务?我们不妨深入解读这份报告。

将 AI 代理置于真实业务环境中测试

APEX-Agents 生产力指数包含多达480个任务,分布在投行、咨询和法务三大领域的33个“虚拟工作场景”中。每个场景都配备了约166份文件,并开放了对办公工具的访问权限,包括文档、电子表格、演示文稿、PDF、电子邮件、日历以及代码执行环境。

为了确保测试场景的真实性,一家名为 Mercor 的AI招聘公司调研了227位相关领域专家,以了解他们的日常工作流程,并据此设计研究中的场景与任务。参与者包括58名金融分析师、77名管理顾问和92名律师,平均工作经验达到10.8年。这些典型任务通常需要熟练员工花费1-2小时完成,而研究的目标正是评估AI代理能否达到初级或中级专业人员的水平。

Mercor 的CEO Brandon Foody 表示:“我们想评估的是,当今的AI代理能否完成具有实际经济价值的任务。它们能否与团队协作、在真实的软件工具中工作,并交付客户可用的成果?结果显示,即便是最优秀的模型,在面对复杂、真实的任务时,也远未达到可投入生产的标准。”

怎样的表现才算“足够好”?

在测试中,表现最优的模型 Pass@1 得分是24%,这意味着平均每尝试四次,只有一次能完全符合任务的所有要求。排名第二的模型得分为23%,其余模型则集中在18%到20%之间。一个值得注意的发现是,开源模型的表现显著落后,成功率仅在5%以下。

常见 AI 代理模型的成功率(来源:Mercor)

这里的 Pass@1 标准非常严苛。每个任务都根据明确的评分规则进行评估,哪怕缺失或错误执行了其中一个关键步骤,整个任务就会被判为失败。这真实地反映了客户场景中“部分正确等于错误”的现实。

如果允许 AI 代理进行多次尝试(例如每个任务试8次),其表现会有所改善。在这种设定下,最佳代理至少成功完成一次任务的概率提升至36%-40%。这一差距揭示出,AI代理具备相应的能力,但在执行的稳定性和一致性上存在明显短板。

一致性仍然是最大的挑战。当要求AI代理在全部八次尝试中都必须成功时,性能急剧下降,最佳模型也仅能达到13.4%。这清楚地表明,当前的AI代理还无法在脱离人类监督的情况下独立、可靠地完成任务。

APEX-Agents 的另一项重要洞察是:失败不等于无用。即使任务未能被完全正确地完成,代理往往也能执行其中的一部分,从而获得一定的“部分分数”。平均任务得分数据显示,表现最好的代理能达到40%左右,这说明它们仍然能够产出一些可用的中间成果。

对于 AI 从业者和企业技术负责人而言,这意味着一个实用的思路:即便代理不能独立交付最终成果,它们也能显著减轻人工负担、加速工作流程,并为人类留出关键的验证和决策时间。

代理的瓶颈在于“执行”,而非“思考”

研究发现,AI代理失败的主要原因并非缺乏领域知识或逻辑推理能力,而更多出在具体执行与工具协作的环节。常见问题包括:

- 步骤冗余:经常超出基准设定的250步限制,显示出规划效率低下或陷入循环。

- 文件操作能力弱:在需要创建、编辑文件的任务上表现不佳。

- 工具调用低效:调用大量工具却未能有效收敛到最终解决方案。

研究还指出,使用更多Token和执行步骤的代理,反而更容易因超时而失败。这表明,单纯增加计算量并不等于更好的结果。成功的执行往往步骤更简洁,这要求对代理的执行策略进行严格控制。

对于企业应用来说,真正的瓶颈在于代理在真实业务系统和文件上执行长流程、多步骤操作的能力。

现阶段,AI代理能做什么?

研究显示,大多数AI代理更适合处理明确、聚焦的任务环节,而非独立负责端到端的完整流程。它们在以下方面表现尚可:

- 数据提取与格式转换。

- 初步的数据分析与信息摘要。

- 在清晰指令下更新模型或文档。

- 探索多种解决方案路径并进行重试。

但在以下方面,它们依然面临挑战:

- 在没有监督的情况下输出可直接交付的完整成果。

- 在多步骤、长流程任务中保持稳定、一致的表现。

- 可靠地进行复杂的文件创建与编辑操作。

因此,对于早期采用者而言,更现实的策略是将AI代理定位为 “人主导”的辅助工具 ,而非期望其完全自主运行。

重新审视AI代理的“生产力”

这是否意味着AI代理被过度炒作了?答案可能并非如此,但这确实提醒我们:业界对于AI代理生产力的宣传,需要建立在更科学、可量化的衡量标准之上。

24%的首次成功率,并不直接等同于“AI代理失败了”。它更确切地表明,当前AI代理的表现具有概率性。企业需要找到与之适配的使用方法,并为其设计合理的任务边界。

研究表明,AI代理在复杂任务中可以作为有效的辅助力量,前提是我们充分理解其局限性,并通过合理的任务设计来规避其短板。生产力的提升是可能的,但结果可能不稳定,并高度依赖于具体的应用场景。

对于技术管理者来说,关键在于明确:AI代理尚不能完全取代人类监督。然而,如果设定合理的期望,并有耐心地优化执行流程与交互方式,它们在任务完成方面的能力将持续增强,最终成为团队中可靠的数字化伙伴。如果你对AI代理、Agent 技术的最新发展和实践案例感兴趣,可以到 云栈社区 的讨论区,与其他开发者和技术管理者一起交流心得。

引用链接

[1] https://arxiv.org/pdf/2601.14242

[2] https://www.mercor.com/blog/expanding-the-ai-productivity-index-apex/

[3] https://www.bankinfosecurity.com/blogs/24-success-rate-for-ai-agents-that-acceptable-p-4038