从应用架构视角系统分析了AI(尤其是大语言模型LLM)在实际业务中落地的现状与挑战,以“退小宝AI助手”为典型案例,深入探讨传统Web应用与AI原生应用在响应时间、输入灵活性、准确性、可用性、成本及嵌入适配性等方面的本质差异。文章指出,简单在旧系统中嵌入AI模块存在诸多局限,而构建AI原生应用才是更可持续的发展路径。

进一步梳理了AI应用的典型架构演进路线:从最初的直接调用模型API,发展到ReAct Agent范式,再到当前主流的以Workflow(工作流)为核心的低代码图结构实现方式。并对LLM、Message、Tool、RAG、上下文(State)、MCP、微调、可观测性(Trace)和评测等核心概念进行了深入解析,结合工程实践提出了关键实施要点。

现在AI非常火,我也做了一些尝试,今天想从应用架构的视角回头总结下我认知下的落地实际使用的产品到底是什么样的,看看两种业务架构紧密结合的一些可能性:

- Web 业务架构作为主体,其中嵌入 AI 应用作为节点

- 对客 api 要求的时延、准确性无解。适配性、可用性可通过编程做出一定解决

- 批量任务和异步任务在一些业务场景能够解决时延、和准确性的问题(比如下文提到的退货宝产品的日报产出 case)

- AI 应用作为主体,其中嵌入业务 Web 应用作为节点

- 目前 AI 应用大部分就是这么做的,业务 Web 应用接口作为工具概念,但是一般需要改造适配成AI友好型的接口设计。

金融部门还有一个很好的例子是《工单自动处理》,这是在原阿里工单系统里走异步监听去交给AI处理,是一个Web应用里嵌入AI应用的比较好例子,不过AI处理过程本身就是完整且闭环的,下文《AI应用的重要补充概念》章节继续探讨。

以退小宝AI助手为例看架构

退小宝以低代码workflow为主要架构,经过多次迭代,达到了业务人员日常依赖使用的程度。结合其它目前见到的日常使用的AI落地产品来看:

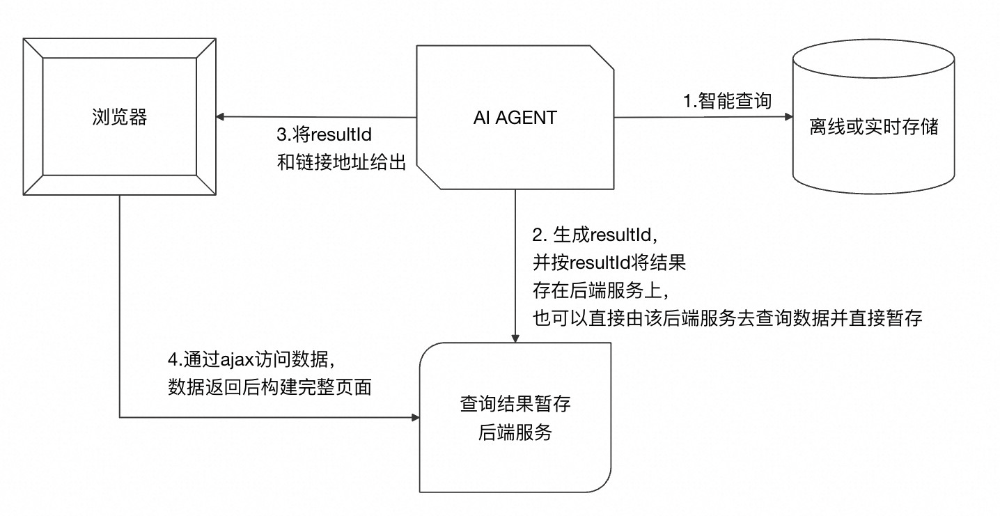

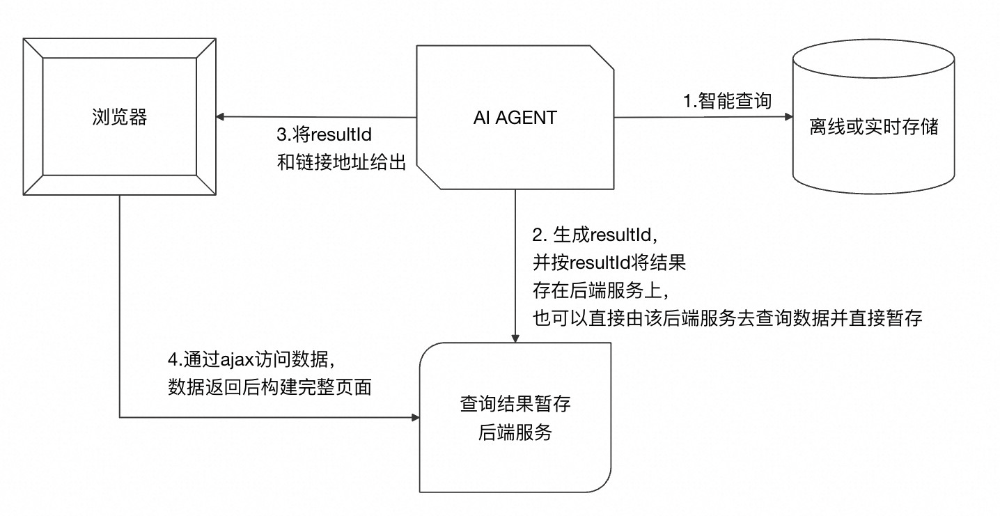

初期版本通过URL转码将数据直接从http的get方式传入

长期方案:

退小宝没有做什么?

- 退小宝没有采用plan agent+ sub agent的架构,原因只是因为退小宝起步较早,但multi-agent其实是可行的架构。退小宝基本模式是常见问答,回答还是比较快的,multi-agent需要用户等待,应用场景略有不同。

- 退小宝没有做过重的意图识别,因为在早期在意图识别上有过多次碰壁,现在LLM本身发展了很多,通过上文的积累,可以尝试做5个以上多意图的识别逻辑了,不能单纯依赖提示词工程,分支路径错误会累积结果误差影响。

- 长记忆、自定义向量存储,退货宝专注于一次回答解决用户的问题,但在日常人之间的沟通工作中经常会不得不多轮对话才能明确的问题。

AI应用的重要补充概念

MCP(Model Context Protocol)

MCP协议中有三个角色:MCP Client、MCP Server、Host程序。Server和Client因有传统C/S架构参考较易理解,但Host作为与LLM沟通的重要桥梁却常被误解。

尽管MCP全称为Model Context Protocol,且官方定义提及用于AI,但它也可用于非AI程序。例如使用Python等语言,借助官方库实现MCP Client和Server,将MCP Server提供的工具当作一般程序使用,而不涉及任何LLM逻辑。此时MCP与Function Calling无直接关联,体现了其作为“协议”的真正价值——标准化工具的注册和发现。

Function Calling必然与LLM相关,是定义在LLM接口标准中的机制。当调用LLM时若启用此功能,必须传入可用工具列表。由于MCP最初由Claude模型使用,且LLM与MCP结合细节闭源,导致实践中存在多种形式和误解。

目前非Claude的LLM与MCP结合通常采用Tool Calling方式:LLM API允许传入tool的描述schema,返回文本结果或调用指示。主流模型均支持传入Tool schema辅助决策。Host程序(即我们开发的AI应用)将MCP提供的工具与LLM的Tool Calling API结合,构成具备LLM能力和MCP生态的应用。

若LLM不支持传入Tool怎么办?是否Claude使用不同方式?另一种方法是将Tool Schema+特殊标签作为普通文本传给LLM,期望其能理解并输出相应工具选择。因此Host程序的实现逻辑至关重要。Claude Desktop(注意不是Claude LLM而是App)这类host程序包含了这些关键逻辑,而Claude LLM模型接口本身并不处理MCP的Client、Service等概念。

LLM决策出要调用某个工具后,并不会自行调用,而是由Host程序检测到该决策后负责调用工具获取结果,并将结果加入message列表(上下文)中,以便后续LLM调用时能感知工具结果并做出新决策。

退小宝目前主要是通过AiStudio(IdeaLab)实现。

评测

现在很多AGENT的落地成果上少提或不提结果的准确率,因为这确实是一个比较难衡量的问题。退小宝的准确率主要来源于人工评测,目前的用户就是产品相关的小二,人数不多,易于统计。

为什么不能像算法那样有更专业的评测呢?因为AI应用的效果评估往往依赖于复杂的人机交互和主观判断,难以完全量化。然而,建立科学的评测体系对于推动AI应用持续优化至关重要。

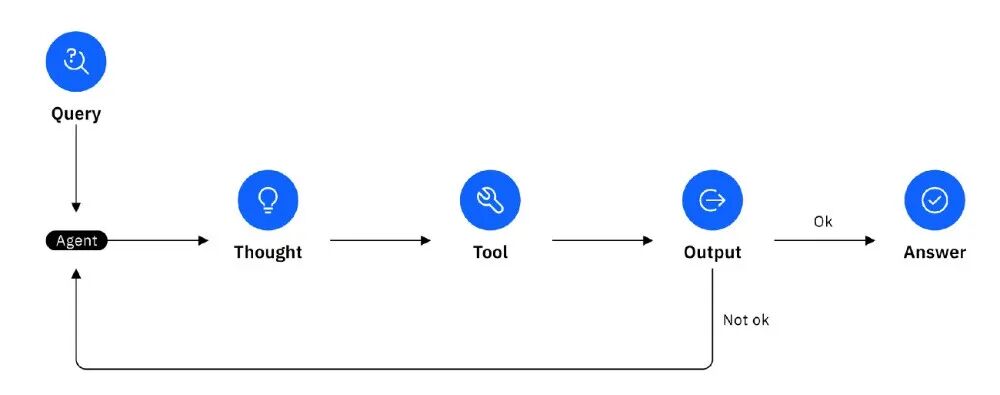

该图为典型的ReAct Agent工作流:输入Query后进入Agent循环,经历Thought→Action→Observation过程,最终输出Answer。若判断结果为Not ok则返回Agent重新处理,形成闭环反馈机制。

如n8n这样的开源平台,正体现了“原生AI能力”的趋势,支持将AI模型无缝集成到可视化工作流中,实现复杂的自动化任务编排,是未来AI应用架构的重要方向之一。