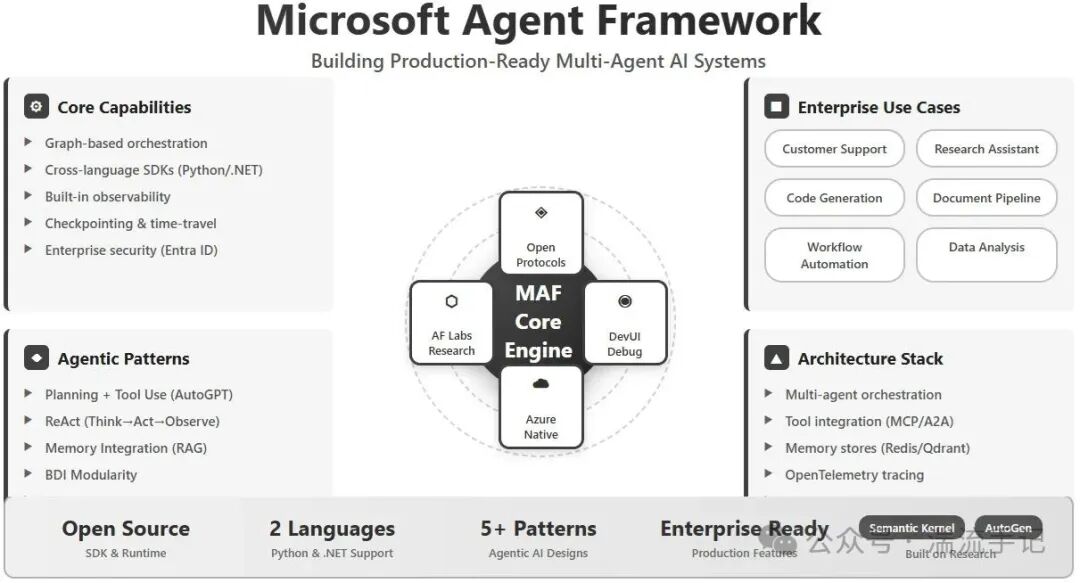

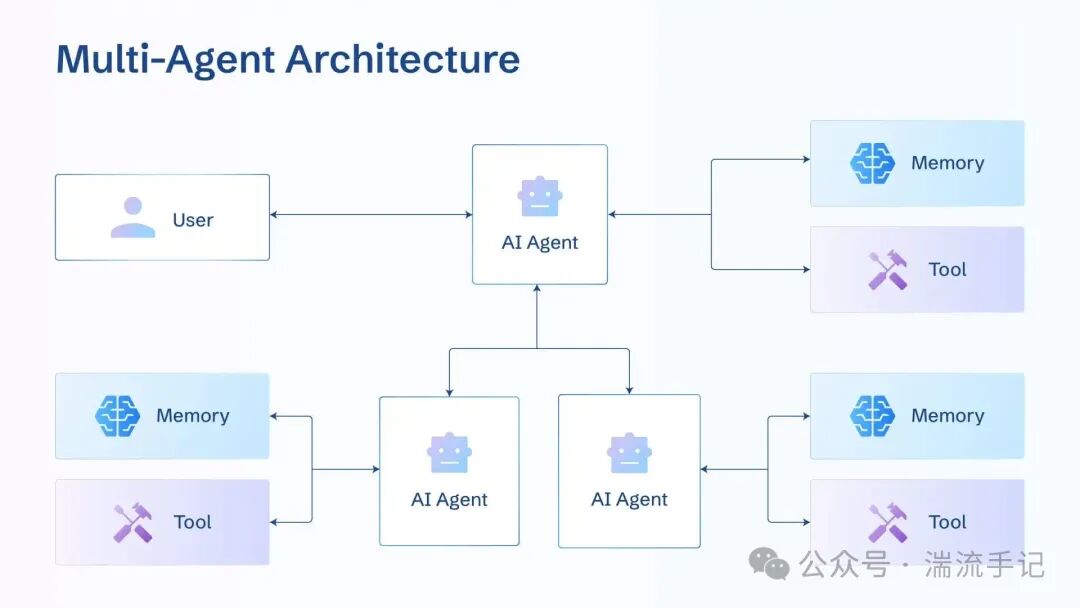

这张架构图展示了 AI Agent 如何从单纯的“模型”进化为复杂的“操作系统”。而在 OpenClaw 的语境下,每一个 Channel Adapter(比如 WeCom 插件)都是通往人类混乱世界的昂贵桥梁。

1. 沉默的“最后一公里”

2026 年初春,当我们谈论 AI 时,我们通常在谈论什么?是千亿参数的模型迭代,还是那些在发布会上光鲜亮丽、在实际业务中却经常“幻觉”的 Demo?

其实,真正的极客们早就对那些 Web UI 里的对话框感到厌倦了。AI 如果不能在周五下午 5 点的钉钉或企业微信群里,替你挡住那个突如其来的需求,那它就一文不值。

这两天,我在 GitHub 上翻到了一个名为 @sunnoy/wecom 的 OpenClaw 插件。乍一看,它只是个普通的连接器,把 OpenClaw 这个“本地优先”的 AI Agent 操作系统接入了企业微信。但细读代码和文档,我闻到了一股久违的“烟火气”。

这哪里是写代码,这分明是在教 AI 如何在职场混社会。

我们总以为 AI 缺的是智商,其实在企业落地这事儿上,AI 缺的是情商。这个插件解决的核心痛点,不是让 AI 变得更聪明,而是让它学会如何在一个充满了加密图片、语音方言和断断续续打字习惯的“人类群聊”里,像个正常员工一样生存下来。

2. 精神分裂的终结:动态 Agent 路由

如果你玩过早期的企业 Bot,你一定经历过这种尴尬:你在问代码 bug,隔壁同事在问食堂菜单,结果 Bot 把你的 Bug 报告和红烧肉做法混在一起吐了出来。

大多数简易 Bot 是“单线程”的傻白甜,它们共享同一个 Context(上下文)。

openclaw-plugin-wecom 这个插件最让我惊喜的,是它引入了 “Dynamic Agent Routing”(动态 Agent 路由)。

“The plugin implements per-user/per-group agent isolation... OpenClaw automatically creates/reuses the corresponding agent workspace.”

这几行文档背后,隐藏着一个巨大的架构变革。它不再是一个 AI 对抗全公司,而是为每一个私聊你的用户、每一个被 @ 的群聊,瞬间克隆出一个独立的、拥有专属记忆的平行宇宙。

这就像是给 AI 开了“多重影分身”。当产品经理在群里发飙时,AI 调用的是 wecom-group-product 的记忆库,保持冷静克制;而当你在私聊里吐槽老板时,AI 切换到 wecom-dm-developer,瞬间化身你的心理按摩师。

这种“老死不相往来”的数据隔离,才是企业级 AI 的底裤。 没了这个,所谓的“智能助手”不过是一个时刻准备泄露机密的定时炸弹。

3. 甚至学会了“让子弹飞一会儿”

有时候我不禁猜测,在这个插件的开发者 @sunnoy 心里,人类一定是一种极其麻烦的生物。

看看这个功能:Message Debounce(消息防抖)。

技术文档里写得冷冰冰:“Rapid consecutive messages from the same user are merged into a single AI request.”(来自同一用户的快速连续消息将被合并为单个 AI 请求。)

翻译成人话就是:它预判了你的预判。

你知道那种领导吗? “在吗?”(回车) “有个事。”(回车) “关于那个 PPT。”(回车) “第三页。”(回车)

如果是个愣头青 AI,早就被这四条消息炸得触发了四次推理,不仅浪费 Token,还会吐出四段驴唇不对马嘴的废话。

但这个插件加了“防抖”。它就像一个有经验的秘书,看着老板在键盘上抽搐,心里默念“再等等,他还没说完”。直到两秒钟的沉默后,它才优雅地把这堆碎片拼接成一个完整的逻辑,递给后台的 LLM。

这不叫技术,这叫“懂事”。 在流式输出(Streaming Output)已经被做烂的今天,这种逆向的“延迟满足”,反而体现了开发者对真实沟通场景的毒辣洞察。

再说那个 AES-256 图片解密。 企业微信为了安全,把所有图片都加了密。大多数 Bot 遇到图片只能装瞎:“抱歉,我无法查看此消息。” 而这个插件直接内置了 crypto.js,自动下载、解密、把图片喂给 AI 的视觉模型。

这就像是给蒙着眼的 AI 递了一把手术刀, 粗暴地划开了企业安全的黑箱,让 AI 终于能看懂那张写满报错信息的屏幕截图。

从单点交互到多 Agent 协作,OpenClaw 的野心在于把这种复杂的拓扑结构,塞进企业微信那个小小的对话框里。

4. 谁才是真正的管理员?

更有意思的,是它对 Admin Users(管理员用户) 的定义。

在配置里,你可以设置几个 ID,这些 ID 发出的指令可以“Bypass”(绕过)白名单,甚至跳过动态路由,直接操作主 Agent。

这是一个非常危险但也非常迷人的设计。

这就好比在一家等级森严的大公司里,给清洁工留了一把通往 CEO 办公室的后门钥匙。在 channels.wecom.adminUsers 这一行代码里,技术权力和行政权力发生了微妙的倒置。

试想一下,当公司的 IT 部门还在走流程审批 AI 采购时,某个懂技术的员工已经在自己的本地服务器上跑起了 OpenClaw,并通过这个插件把一个全能 AI 拉进了部门群。他只要在 adminUsers 里填上自己的名字,他就是这个数字王国的神。

这会不会引发新一轮的 “Shadow AI”(影子 AI) 危机? 如果未来的企业架构里,官方的系统僵化迟缓,而员工私下部署的 Bot 却能高效地处理一切——从解密文档到自动化审批——那么,谁才是这家公司真正的运转核心?

OpenClaw 这种“本地优先、插件即插即用”的特性,正在模糊“企业级软件”和“黑客工具”的界限。你可以在开源实战板块找到更多关于这类项目边界的探讨。

5. 致敬代码里的泥瓦匠

最后,我想聊聊这种“轮子”的意义。

在 2026 年,我们见过太多宏大的叙事。某大厂发布了万亿模型,某巨头推出了全家桶 Copilot。但当我们把视线从云端拉回地面,你会发现,真正阻碍 AI 普及的,往往是那些不起眼的脏活累活。

是企业微信那个该死的 AES-256 加密; 是群聊里嘈杂的 @ 消息; 是用户那毫无逻辑的碎片化输入。

openclaw-plugin-wecom 并没有发明什么惊天动地的算法。它所做的,不过是在 OpenClaw 这个极其现代化的 AI 大脑,和企业微信这个略显陈旧的通讯躯壳之间,搭了一根神经。

它负责翻译、负责过滤、负责等待、负责忍受人类的混乱。

它是 AI 时代的泥瓦匠。 正是因为有了这些在 webhook.js 和 stream-manager.js 里死磕细节的代码,那些高大上的大模型,才终于有机会从云端的神坛走下来,真正变成我们工位旁那个“已读秒回”的靠谱伙伴。

这事儿其实挺浪漫的,不是吗?如果你也对这种连接 AI 与现实的“桥梁”技术感兴趣,欢迎来云栈社区的开发者广场,一起聊聊那些正在发生的、有趣的实践。