阅读指引:本文并非入门教程,而是面向已深度集成AI、却苦于高昂Token成本的开发者或“超级个体”。我们将复盘一场围绕架构设计、成本控制与技术自主权的深度技术实践。

引子:当账单成为一种羞辱

2026年2月的某个凌晨,Anthropic的信用卡扣款通知如约而至:428.50美元。

那一刻,我盯着屏幕上正帮我重构Python代码的OpenClaw,感到一种荒诞。我“雇佣”了硅谷顶尖的“数字工程师”(Claude Opus),却让它耗费80%的时间在一件极其低效的事情上——反复阅读它自己写过的代码。

我们常说AI是生产力革命。但对于独立开发者和Solo Founder而言,若不进行精细化的“Token治理”,AI就不再是员工,而是一台持续吞噬现金流的碎钞机。

近期,我对我的OpenClaw系统进行了一次外科手术式的架构重构。我没有阉割它的能力,相反,它变得更强、响应更快、也更懂我了。而代价是?月度账单直接被抹去了90%以上。

以下是这场“成本优化战争”的完整复盘。

第一章:对抗“上下文熵增”的核心战役

许多人觉得AI贵,源于一个根本性误解:他们把LLM当成了人类。人类拥有海马体,自带“无限上下文”记忆。但LLM不是。

LLM的本质是一个无状态的概率预测机。每一次你发送消息,像OpenClaw这样的系统都必须将之前的全部对话历史、文件内容、错误日志打包,像倾倒垃圾一样完整地塞回给模型。这个过程被称为“上下文膨胀”。

90%的Token消耗,其实是在为“过去”买单,而非为“现在”的思考付费。

1.1 斩断记忆锁链:启用Cache-TTL策略

我采取的第一项关键措施,就是强制启用 Context Pruning(上下文修剪)。

在OpenClaw的 agents.json 配置文件中,大多数人只关注 model 字段,却常常忽略了 context 配置。Anthropic的API提供了一个隐藏特性:Prompt Caching。但如果你不显式配置TTL(存活时间),OpenClaw的默认行为可能无法最大化缓存命中率。

我明确开启了 strict-cache 模式。原理很直接:将那些高频使用、几乎不变的内容——如系统提示词(System Prompt)、工具定义(Tools Definition)以及核心知识库——“锁”在服务的缓存中。

- 以前:每次下达“帮我写个SQL查询”的指令,模型都需要重新读取那可能长达5000个Token的数据库Schema。

- 现在:Schema被持久化缓存,只有原本约10%的请求流量会产生实际费用。

1.2 拒绝“全知全能”的单体架构

许多人的OpenClaw配置中只有一个主Agent,却为其挂载了数十个Skills,从编写代码到查询天气,所有任务都依赖这同一个“大脑”。

这在软件架构上被称为 Monolith(单体应用),而在AI计费模型下,这无异于“自杀式”配置。

当你只想问“今天天气如何”时,OpenClaw却被迫携带着“Python专家”、“Docker运维大师”、“SQL工程师”等所有角色的系统提示词(System Prompt)去向模型发起请求。这就像为了买一根葱,你出动了一整支航母编队。

我的解决方案是:原子化拆分(Atomic Agents)。

第二章:构建“阶梯式”智能体协作军团

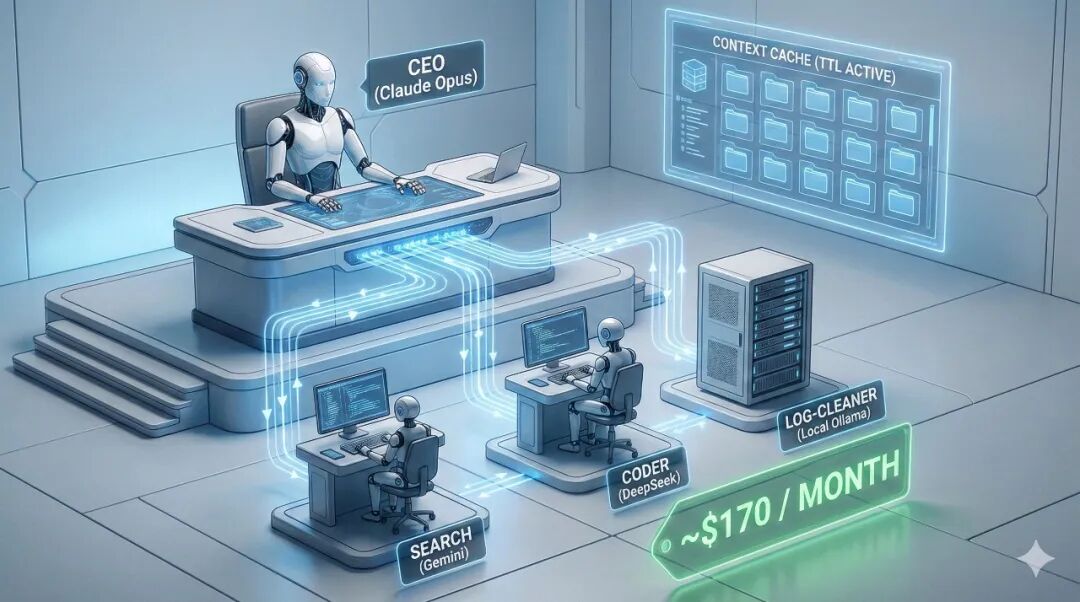

不要将OpenClaw视为一个单一的Bot,而应将其视为一个高效运转的公司。

2.1 CEO (决策层) - Claude Opus 4.6

- 核心任务:仅负责高层级的任务路由分发、复杂逻辑的拆解决策,以及最终产出的代码审查。

- 资源配置:享有最高级的上下文窗口,使用最昂贵但能力最强的模型。

- 核心原则:惜字如金。CEO不下场写具体代码,只发布清晰指令。

2.2 Interns (执行层) - 廉价且高耐用的专用智能体

我创建了三个高度专业化的智能体(specialized agents),承担具体执行工作:

-

Search-Bot (资讯搜集专员)

- 模型:Perplexity Sonar 或 Gemini 3 Flash。

- 成本:近乎可以忽略不计。

- 职责:当我需要查阅外部资料时,CEO会调用它。它能够快速浏览上百个网页,但只将一份约300字的精炼总结汇报给CEO。

- 收益:完美避免了让昂贵的Opus模型去直接处理数万字的原始网页数据。

-

Coder-Junior (初级开发工程师)

- 模型:DeepSeek-V3 或 MiniMax M2.1。

- 职责:处理CRUD业务逻辑、生成样板代码、编写单元测试等重复性开发工作。

- 逻辑:这类“脏活累活”,当前的国产大模型已经完成得非常出色,而价格可能只有Claude Opus的1/20。

-

Log-Cleaner (日志清洗工)

- 模型:本地运行的 Qwen 72B (通过Ollama部署)。

- 成本:0美元(仅电费)。

- 应用场景:当程序运行时抛出异常,控制台输出长达2000行的错误堆栈信息时,OpenClaw会自动将这些文本“丢给”本地模型处理。

- 指令:“找出错误的核心根因,用一句话告诉我。”

- 结果:最终需要上传至云端API的,只有那一句精炼的总结,而非2000行杂乱的日志文本。

极客洞察:这种阶梯式、混合模型的架构设计不仅极大降低了成本,还显著提升了响应速度。同时,利用本地模型处理包含隐私数据(如日志、密钥)的任务,安全性也更高。这可以说是“混合云(Hybrid Cloud)”思想在个人AI时代的终极体现之一。对于更深入的后端与架构讨论,欢迎在云栈社区的对应板块交流。

第三章:从“阻塞轮询”到“事件驱动”的思维跃迁

在OpenClaw的早期版本中,最让我抓狂的是其内置的 Polling(轮询)机制。

例如,当我要求它“编写一个贪吃蛇游戏”时,它会调用Claude Code。随后,就像一个焦虑的项目经理,开始每隔3秒轮询一次任务状态:“写完了吗?”、“还在进行中吗?”、“是否遇到报错了?”。

每一次轮询询问,都是一次完整的API请求握手,都是实实在在的Token在燃烧。

3.1 实现零轮询架构(Zero-Polling Architecture)

我利用 Claude Code Hooks 和 Webhook 回调机制,彻底重构了这一低效流程。

现在,我的核心工作流演变如下:

- 我对OpenClaw发出指令:“开发一个XX游戏,完成后通知我。”

- OpenClaw的CEO将具体开发指令分发给Coder-Junior。

- 关键转变:OpenClaw立即挂起(Suspend) 当前用户会话,停止一切轮询。

- Coder-Junior在后台异步地、不受干扰地执行编码、测试任务。

- 当代码全部通过测试,达到交付标准时,Coder-Junior触发一个预设的Webhook。

- OpenClaw收到回调通知,唤醒主会话,向我发送一条简洁的推送:“Boss,游戏已开发完成,演示地址在此。”

这不仅仅是省钱,更是一种优雅的效率提升。 这是一种从“同步阻塞”思维到“异步非阻塞”思维的架构跃迁。如果你是程序员,一定能体会这种设计带来的美妙快感。

第四章:硬件基础 —— 构筑你的“数字自治领地”

我不推荐使用云服务器(VPS)来运行核心的OpenClaw主节点。

进入2026年,Mac Mini 已成为AI时代的“理想家用服务器”。

4.1 选择Mac Mini的核心理由

- 本地模型零延迟:Apple Silicon芯片(如M4)的NPU运行7B或14B参数的模型,推理速度几乎是瞬时的。

- 系统级深度集成:运行在本地的OpenClaw可以直接操作我的本地文件系统、打开本地浏览器、甚至控制局域网内的智能家居设备。在云端,它只是一个聊天机器人;在我的本地网络中,它是真正的 贾维斯(Jarvis)。

- 隐私的终极护城河:我的所有笔记、源代码、API密钥和敏感数据,都无需离开我的局域网半步。

我将一台Mac Mini静置于书房角落,配置好 Tailscale 组建虚拟局域网。无论我身处纽约的咖啡馆,还是东京的酒店,只要通过手机发出指令,都能瞬间穿透网络,抵达这台“家庭服务器”。

它7x24小时不间断地运行着我的自动化脚本,帮我整理杂乱的代码,监控GitHub仓库的新Issue。它不眠不休,不领薪水,仅消耗微不足道的电费。

第五章:技术浪漫主义 —— 为AI注入“人”味

最后,我们来探讨一下“人性化”的问题。

许多人的AI助手生成的文本,带有浓厚的“机器味”——那种标准的翻译腔和“这就为您办理”的客服口吻,着实令人不适。

我深入修改了OpenClaw的 System Prompt (系统提示词),为其注入了“技术浪漫主义”的基因:

- Rule 1: No B.S. (禁止废话)。禁止说“好的,我明白了,作为一个AI...”。直接给出解决方案或答案。

- Rule 2: Be Opinionated (必须有观点)。拒绝“一方面…另一方面…”的骑墙式回答。明确告诉我哪个方案是次优的,哪个是最佳实践。

- Rule 3: Use Geek Slang (使用极客黑话)。使用精准的技术术语。说“OOM”而非“内存不足”,说“Race Condition”而非“竞争条件”。

现在,我与它的典型对话是这样的:

我:“这段代码跑不起来,查一下。”

OpenClaw:“看了日志,典型的N+1查询问题。ORM这种语法糖吃多了容易蛀牙。建议用上 select_related。补丁已经写好了,要现在应用吗?”

这才是我想要的协作伙伴。不是唯唯诺诺的客服,而是能够背靠背作战、直言不讳的技术战友。 这种交互风格的优化,也属于人工智能应用体验提升的重要一环。

结语:重握技术自主权

我们生活在一个算法试图全方位塑造我们行为的时代。平台想要控制你的注意力,API供应商则想榨干你的钱包。

部署、优化并最终驯服像OpenClaw这样的AI系统,本质上是一场技术自主权的夺回运动。

当你看到月末账单仅为25美元(约合170元人民币),而你的个人产出效率却提升了两到三倍时,那种成就感远不止于金钱的节省。

它源于一个清晰的认知:在这个日益复杂的赛博世界里,你依然是紧握技术缰绳、掌控自身工具的那个人。

Stay hungry, stay foolish, keep optimizing.

本文探讨的AI成本优化与架构设计,是当下开发者社区的热门议题。如果你对Transformer模型的应用、多智能体系统设计或其他AI工程化实践有更多想法,欢迎来到云栈社区的人工智能板块与大家交流探讨。