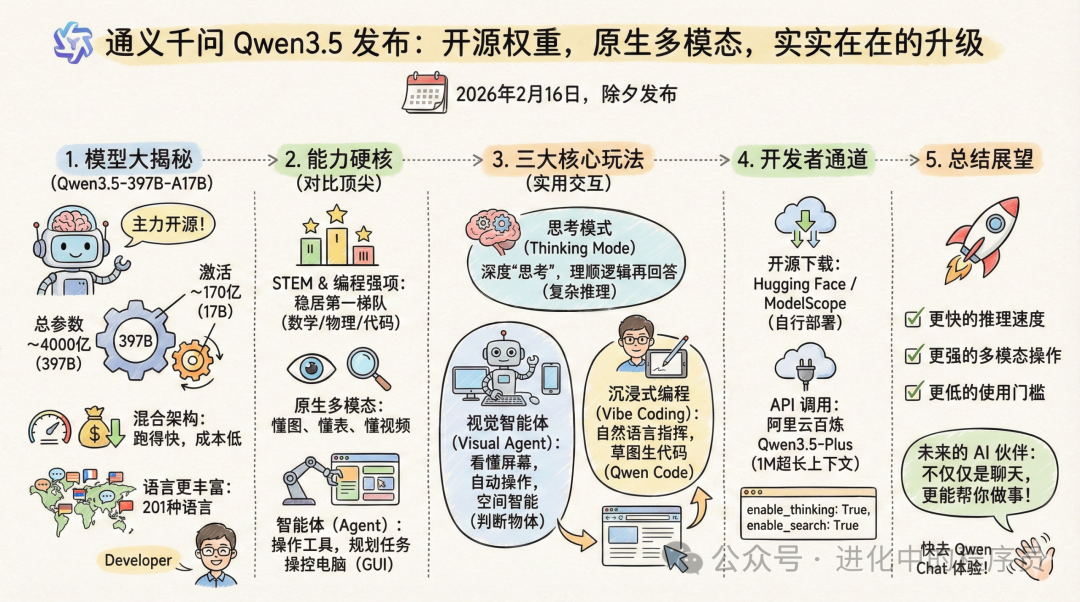

在2026年的除夕夜,当很多人都在庆祝新年时,Qwen团队正式推出了Qwen3.5系列模型。这次发布不仅开源了重量级模型的权重,更是标志着通义千问向着 “原生多模态智能体” 的方向迈出了坚实的一步。简单来说,未来的AI将不再只是一个对话窗口,而是能够看懂屏幕、操作电脑、帮你解决复杂任务的伙伴。

这是一个什么样的模型?

本次发布的开源核心是 Qwen3.5-397B-A17B。光看名字你可能觉得参数巨大,但它的设计巧妙之处恰恰在于“大而高效”。

- 参数虽大,跑得飞快:模型总参数量接近4000亿(397B),但它采用了创新的混合架构(线性注意力 + 稀疏混合专家,即 MoE)。这意味着在实际推理时,每次只会激活约170亿(17B)参数。

- 效果:这种设计让它在保持超大模型强大认知能力的同时,显著提升了推理速度,并有效降低了部署与使用的成本。

- 语言更丰富:模型支持的语言和方言从上一代的119种大幅扩展至201种,让全球更广泛的用户能够使用母语与其顺畅交流。

能力究竟如何?(与顶尖模型对比)

Qwen团队将Qwen3.5与当前市场上公认的顶尖模型(如GPT-5.2、Claude 4.5 Opus、Gemini-3 Pro等)进行了全面对比。从公开的评测数据来看,其表现相当亮眼:

- 理科与编程强项:在数学、物理等STEM学科以及代码生成任务上,Qwen3.5的表现稳健,稳居第一梯队。在部分特定榜单(如HMMT、LiveCodeBench)上,甚至超过了某些闭源模型。

- 多模态理解:作为一款“原生”视觉语言模型,它在处理图表、理解视频内容等任务上的准确率有显著提升,这意味着它能更好地“看懂”世界。

- 智能体(Agent)能力:在操作工具、规划任务乃至理解并操控电脑图形界面(GUI)方面,Qwen3.5相比前代模型实现了大幅进步,使其更接近一个能独立完成任务的 AI Agent。

三大核心玩法:不止于聊天

Qwen3.5带来了几种极具实用价值的交互模式,真正展现了“智能体”的潜力。

思考模式(Thinking Mode)

当遇到复杂难题时,模型可以开启深度“思考”过程。它会先将问题拆解、理顺逻辑链条,再给出最终答案。这对于解决复杂的数学证明、逻辑推理或需要多步规划的问题尤其有帮助。

视觉智能体(Visual Agent)

这个能力超越了简单的“看图说话”。它能让AI“看懂并用好”屏幕信息:

- 操作电脑/手机:它可以像真人一样理解软件界面,帮你整理Excel表格、自动化操作各类应用,充当你的数字助手。

- 空间智能:在机器人或自动驾驶场景中,它能准确判断物体的空间位置关系(例如估算路口红绿灯与停车线之间的距离),即使视角存在部分遮挡,也能做出准确推断。

沉浸式编程(Vibe Coding)

对于开发者而言,这是一项生产力利器。结合Qwen Code等工具,你可以直接用自然语言描述需求来生成或修改代码。它能边写边调试,甚至可以根据手绘的草图快速生成对应的网页前端代码,极大地提升了开发效率。这种体验让代码编写过程变得更加直观和高效,无疑是对传统开发流程的一次革新,值得在开源实战社区中深入探讨其实现与应用。

开发者如何使用?

对于想要尝鲜或集成的开发者,Qwen团队提供了灵活的使用路径。

开源下载:你可以通过 Hugging Face 或 ModelScope 平台下载 Qwen3.5-397B-A17B 的完整模型权重,进行本地部署和研究。

API 调用:如果不想处理复杂的部署工作,可以直接使用阿里云百炼平台提供的 Qwen3.5-Plus API服务。该服务支持高达1M(100万)token的超长上下文,足以应对绝大多数复杂场景。

调用方式非常简洁,通过设置参数即可轻松开启高级功能,例如思考模式或联网搜索:

# 简单的调用示例

extra_body = {

"enable_thinking": True, # 开启推理思考

"enable_search": True # 开启联网搜索

}

总结:朝着实用化AI伙伴迈进

Qwen3.5的这次迭代,目标显然不仅仅是“刷榜”。它更专注于解决实际应用中的痛点:更快的推理速度、更强的多模态交互与操作能力、以及更低的使用门槛。

它向我们描绘了一个更近的未来:AI助手将逐渐融入我们的数字工作流,成为一个能主动理解意图、操作工具、并解决问题的智能伙伴。对于关注人工智能前沿动态的开发者和技术爱好者来说,Qwen3.5的发布无疑是一个重要的风向标。

感兴趣的朋友,可以前往 Qwen Chat 亲自体验,官方提供了自动、思考和快速三种响应模式供你选择。

参考资料

|