如果你尝试过用神经网络去“记忆”一张图片或一个3D模型,那么对隐式神经表示 (Implicit Neural Representation, INR) 这个概念一定不会陌生。简单来说,就是训练一个小型网络,输入一个坐标(比如像素的 x, y 位置),让它直接输出该坐标的颜色或属性值。听起来很巧妙,不是吗?

然而,这份“巧妙”的背后,是令研究者和开发者头疼不已的训练速度问题。主流的INR大多基于多层感知机 (MLP),为了让它能“学会”图像中的高频细节,你需要精心设计激活函数、调整初始学习率,并加入各种位置编码 (Positional Encoding, PE)。整个过程不仅缓慢,还容易对训练数据中的噪声过拟合,导致模型在未见过的任务(例如图像超分辨率)上表现不佳。

现在,来自根特大学和布鲁塞尔自由大学的研究人员提出了一种全新的思路:“与其费力调教复杂的MLP,不如从根本上换一种更高效的表示方法。” 于是,FUTON 应运而生。

FUTON,全称 FOUrier Tensor Network(傅里叶张量网络),其核心思想直截了当:抛弃传统的MLP架构,转而采用一种结合了广义傅里叶级数和低秩张量分解的数学结构来直接建模信号。实验表明,这种新方法不仅在重建质量上超越了现有技术,其训练速度更是快了2到5倍,在图像超分、去噪、CT重建等逆问题上也展现出更优的泛化能力。

下面,我们就来深入剖析FUTON的工作原理,看看这个“数学沙发”是如何优雅地承载起复杂信号的。

核心揭秘:广义傅里叶级数遇上低秩分解

第一步:用傅里叶级数“翻译”信号

我们知道,任何复杂的信号都可以分解为一系列不同频率、不同振幅的简单周期函数(如正弦波)的叠加。傅里叶级数正是这一思想的数学表述。FUTON采用了一种更通用的形式——广义傅里叶级数 (Generalized Fourier Series, GFS),它不限于正弦余弦,任何能构成正交归一基 (Orthonormal Basis, ONB) 的函数族都可以使用。在论文中,作者选择了简单高效的余弦函数作为基。

这里,φₖ(x) 就是第k个基函数。当 k=0 时为常数1,k≥1 时为归一化后的余弦波。K 代表我们使用前K个基函数来近似原始信号。

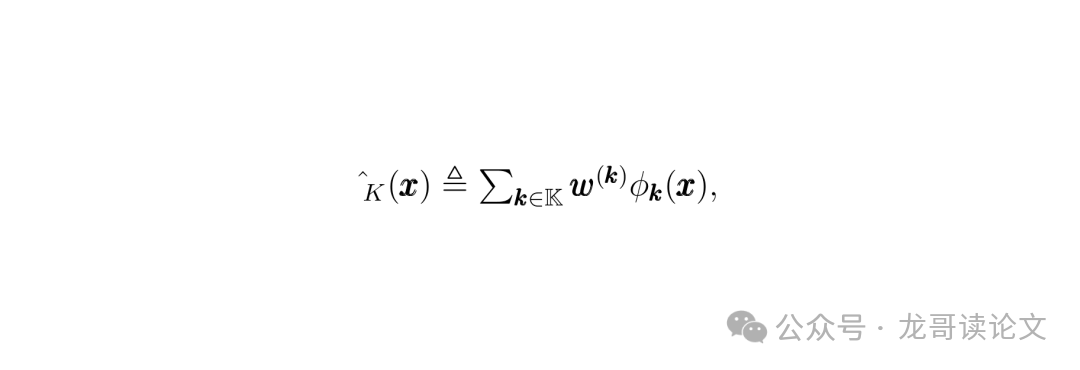

对于一张二维图像(坐标 x, y),我们可以构造一个可分基:将x方向和y方向的基函数相乘。这样,整幅图像的近似就变成了所有可能基函数组合的加权和:

这里的 w⁽ᵏ⁾ 就是系数向量(对于RGB图像,它就是3维的)。理论上,只要 K 足够大,我们就能以任意精度表示图像。

但问题也随之而来:如果每个维度取 K 个基函数,那么总的基函数组合数量将是 Kᶜ(C 是坐标维度)。对于二维图像(C=2),有 K² 个组合;对于三维体积(C=3),则激增到 K³ 个。系数 w 的数量也呈指数级增长,无论是计算还是存储都是不可行的。

第二步:引入“低秩”假设,化指数为线性

这就是FUTON第二个核心思想登场的时候:低秩张量分解。

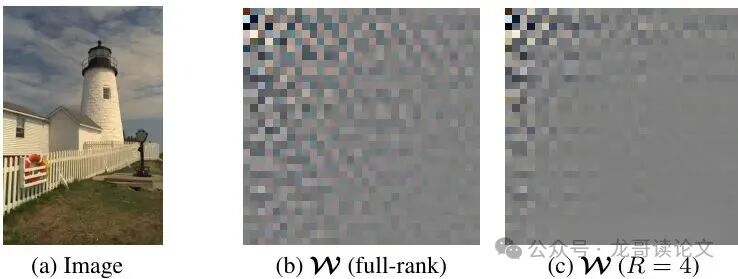

我们将所有系数 w⁽ᵏ⁾ 按照其多维索引 k 和输出通道 d,排列成一个巨大的张量 𝒲。例如,对于一个使用 K=32 个基函数来近似的RGB图像(C=2, D=3),𝒲 就是一个 32 x 32 x 3 的三阶张量。下图将这个张量的三个通道可视化为RGB图像,有趣的是,它看起来并非完全随机,而是具有一定的结构!

图1:FUTON权重张量可视化。(a) Kodak数据集中的原始图像 (C=2, D=3)。FUTON模型每个维度使用 K=32 个余弦基函数,产生一个权重张量 𝒲 ∈ R^{32×32×3}。(b) 全秩和 (c) 低秩 (R=4) 下 𝒲 可视化为RGB图像。低秩表示抓住了主导的谱结构。

关键的洞察在于:自然信号的频谱(即这个系数张量 𝒲)通常具有内在的低维结构,可以被一个低秩的张量很好地近似。图1(c)展示了当对这个张量进行低秩分解(这里使用了CP分解,Canonical Polyadic Decomposition,秩 R=4)后的结果,它依然保留了主要的谱信息。

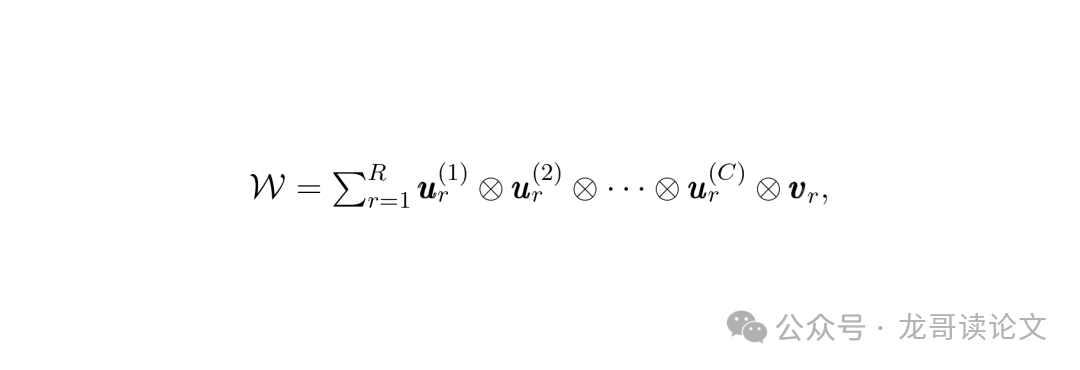

CP分解将一个大张量 𝒲 表示为 R 个秩一张量的和:

这里的 uᵣ⁽ᶜ⁾ 是第 c 个坐标维度、第 r 个组分对应的 K 维向量,vᵣ 是第 r 个组分对应的 D 维(输出通道)向量。符号 ⊗ 表示张量积。

这意味着,我们不再需要存储整个庞大的 Kᶜ × D 张量,而只需要存储 C 个大小为 K × R 的矩阵 U⁽ᶜ⁾(其每一列是一个 uᵣ⁽ᶜ⁾),以及一个大小为 D × R 的矩阵 V(其每一列是一个 vᵣ)。参数量从可怕的指数级 O(Kᶜ D) 降到了温和的线性级:C·K·R + D·R。

这正是FUTON的精髓所在:使用一组经典的正交基(傅里叶)来提供平滑性和周期性等归纳偏置,同时用一个低秩参数化(张量网络)来捕捉并强制信号在频谱域具有低维结构。 两者结合,既拥有了强大的表示能力,又规避了MLP那种黑箱式、难以优化的行为。

线性复杂度实现:图解FUTON高效前向传播

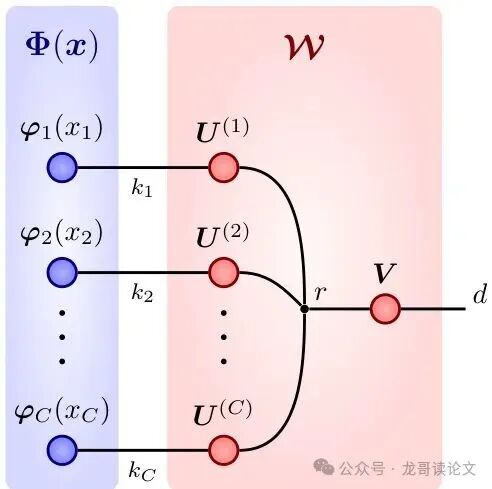

得益于低秩分解,FUTON的前向传播计算也变得异常高效。我们可以通过一种最优的“收缩”顺序来计算输出,其复杂度是线性的 O(C K R + C R + D R),而不再是可怕的指数级 O(Kᶜ D)。

图3:FUTON前向传播的最优收缩顺序。计算具有线性复杂度 O(C K R + C R + D R),分三步进行,其中黄色框表示每个步骤正在收缩的张量。

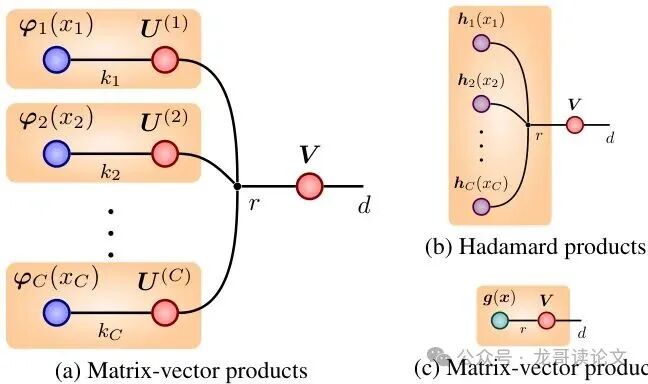

结合下面的张量图可以更直观地理解这个过程。张量图是一种用图形表示张量运算的可视化语言,节点代表张量,连接的边代表要被求和(收缩)的索引。

图2:FUTON前向传播的张量图。节点代表张量,连接的边代表被收缩的索引(被求和),悬垂的边对应于开放的索引。

整个过程对应图3,可以分为三步:

- 基投影:对于每个坐标维度

c,计算一个 R 维向量 h_c(x_c) = U⁽ᶜ⁾ᵀ φ(x_c)。这相当于把该坐标下的所有 K 个基函数值,通过矩阵 U⁽ᶜ⁾ 线性组合成 R 个特征。复杂度为 O(C·K·R)。

- 特征组合:将所有

C 个 R 维向量按元素相乘(哈达玛积),得到一个 R 维向量 g(x) = h₁(x₁) ⊙ h₂(x₂) ⊙ ... ⊙ h_C(x_C)。复杂度为 O(C·R)。

- 输出映射:最后,将

g(x) 乘以矩阵 V,得到最终的 D 维输出 s(x) = V g(x)。复杂度为 O(D·R)。

可以看出,整个前向传播就是一系列简洁的矩阵-向量乘法和元素乘法,没有复杂的非线性激活函数堆叠(最后可选择性加一个 tanh 用于输出约束),计算非常规整、高效。这既是它训练飞快的原因,也使得推理速度极具优势。

全面碾压实验:图像、3D到逆问题均表现优异

理论优美,实际效果如何?论文在信号表示和逆问题两大类任务上进行了全面测试,对比了包括 ReLU+PE、SIREN、Gauss 以及当前最强的 WIRE 在内的多种SOTA MLP-based INR方法。

图像表示:质量与速度的双重胜利

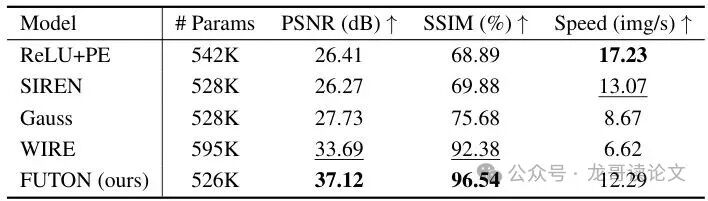

在Kodak数据集上的结果令人印象深刻。在参数量基本相当的情况下(约526K),FUTON在PSNR(峰值信噪比)和SSIM(结构相似性)两个核心指标上全面领先。

表1:Kodak数据集上的图像表示结果。最佳结果加粗,次佳结果加下划线。

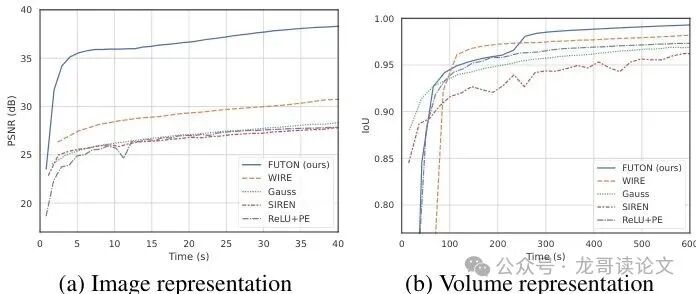

更重要的是训练速度。图5(a)显示,FUTON在极短时间内就达到了接近最终的高质量,而其他方法还在缓慢爬升。视觉对比(图4)也清晰显示,FUTON的重建结果更锐利,细节保持更好,而SIREN、WIRE等方法则出现了明显的周期性伪影或模糊。

图4:图像表示效果对比。FUTON产生了比基线方法更清晰、细节保留更好的重建结果。

图5:信号表示任务上的学习速度。图像(kodim17)和占用体积(Thai Statue)表示任务的PSNR和IoU随训练时间的变化。

3D占用体积表示:更平滑的表面

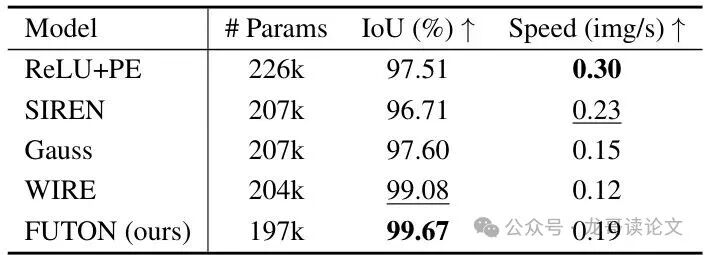

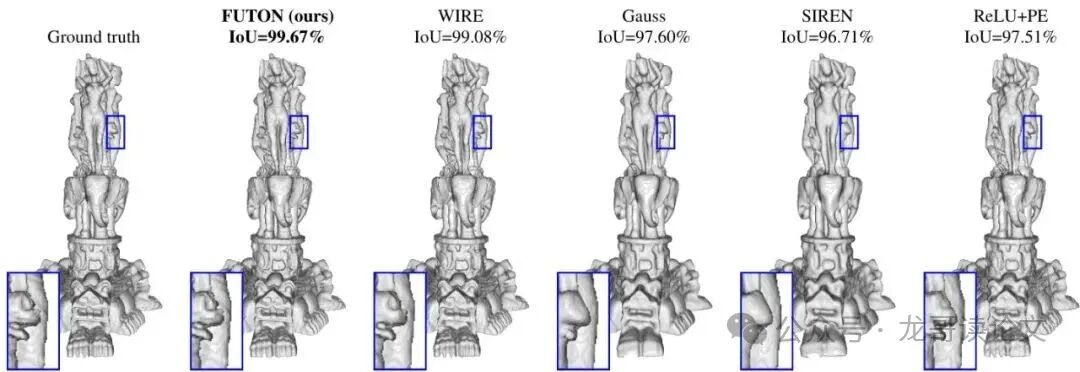

对于3D的Thai Statue模型(任务为判断一个3D点是否在物体内部),FUTON同样取得了最高的IoU(交并比),并且收敛速度也快于WIRE和Gauss(图5b)。从图6的渲染结果看,FUTON重建的表面是最光滑、最接近真实扫描结果的。

表2:Thai Statue数据上的占用体积表示结果。最佳结果加粗,次佳结果加下划线。

图6:占用体积表示效果对比。FUTON对Thai Statue占用体积实现了最高保真度的重建,与基线方法相比表面更平滑、伪影更少。

逆问题:卓越的泛化能力

逆问题(如超分辨率、去噪、CT重建)对INR的泛化能力提出了更高要求,因为需要在观测数据不完整或有噪声的情况下,“推理”出完整的信号。这正是FUTON低秩先验大显身手的地方。

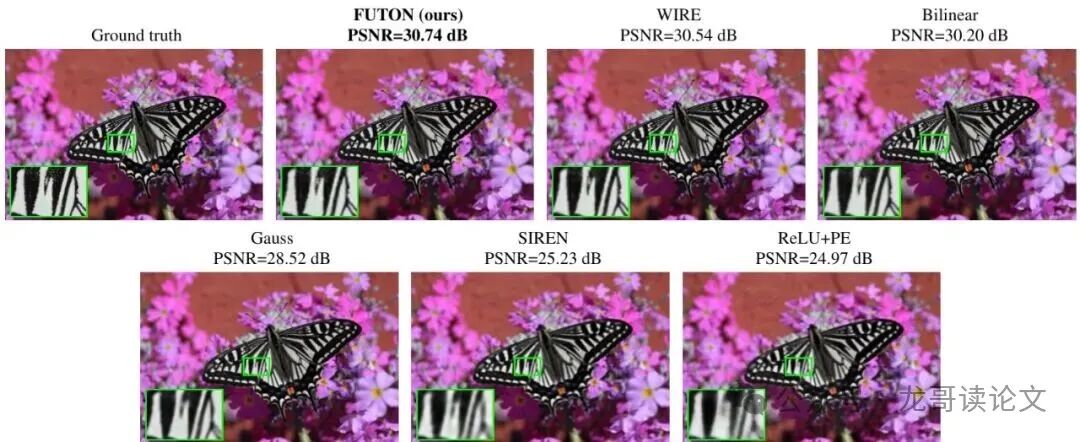

- 图像超分辨率(4x):FUTON恢复的高频细节最准确,其效果甚至超过了利用了下采样算子先验的双线性插值方法(图7)。

图7:4倍图像超分辨率效果对比。FUTON比基线方法更准确地恢复高频细节,产生了更清晰的重建结果。

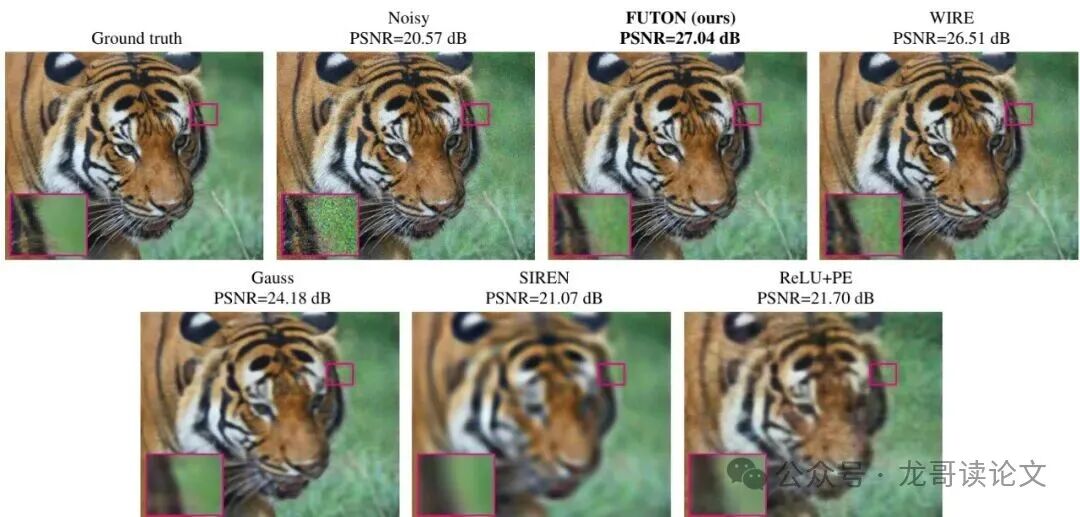

- 图像去噪:在模拟的传感器噪声上,FUTON在有效去噪的同时,最好地保留了图像的结构和细节,PSNR提升最大(图8)。

图8:图像去噪效果对比。FUTON有效降低了传感器噪声,同时保留了图像结构和细节,实现了最高的重建质量。

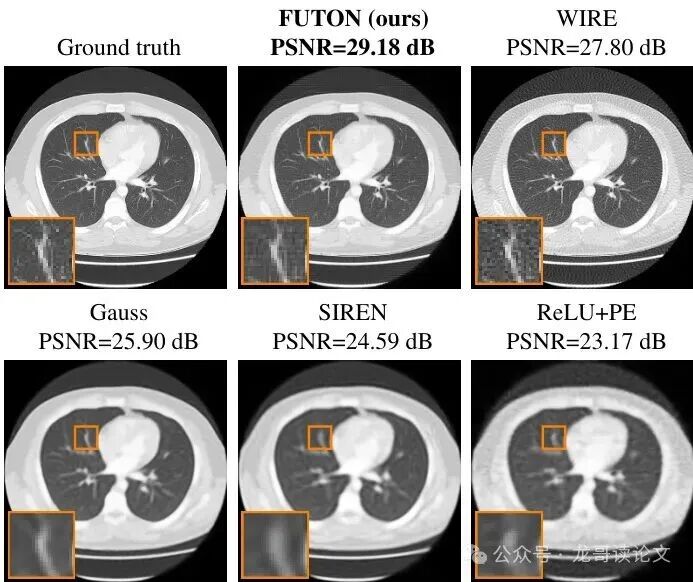

- 稀疏视图CT重建:这是医学成像中的一个经典难题。FUTON重建的CT切片(图9)解剖结构最清晰,由投影数据不足引起的条纹伪影也最少,展现了其在科学计算与医学影像分析领域的巨大应用潜力。

图9:稀疏视图CT重建效果对比。FUTON从150个投影角度产生了更清晰的解剖结构,并减少了条纹伪影。

消融与展望:参数选择与未来潜力

FUTON主要有两个关键超参数:基函数数量 K 和CP分解的秩 R。

论文的消融实验表明:

K(分辨率):增大 K 能提升模型的表示能力(PSNR/SSIM),但超过一定值(如512)后收益递减,同时推理速度会下降。K 本质上决定了模型能表示的最高频率。R(秩):增大 R 能更好地近似系数张量,提升重建质量,但同样存在收益递减。R 决定了模型捕捉信号频谱复杂度的能力。论文发现一个简单的启发式设置 R = K 在实践中效果就很好。

此外,论文还尝试了不同的基函数(余弦、勒让德多项式、切比雪夫多项式),发现余弦基的收敛速度和最终性能都是最好的,这与信号处理中离散余弦变换(DCT)的良好性质相符。

展望未来,FUTON这种将经典谐波分析与现代张量网络结合的思路,为隐式神经表示研究开辟了一条清晰的新路径。它理论清晰、计算高效、泛化性强,非常适合于需要快速、高质量信号表示与重建的场景,特别是在科学计算(如物理场模拟)、医学成像和实时图形学等领域潜力巨大。一个自然的延伸是探索更复杂的张量网络结构(如TT/TR分解)或自适应选择基函数,以进一步提升其能力。

常见问题解答

1. FUTON这个名字是什么意思?

FUTON是 FOUrier Tensor Network(傅里叶张量网络)的缩写。作者巧妙地借用了“Futon”(日式床垫/沙发床)一词的意象,来隐喻其方法是一种紧凑、可灵活“折叠”(分解) 的信号表示结构。

2. FUTON和传统MLP-based INR根本区别在哪?

最根本的区别在于建模范式。MLP是学习一个从坐标到信号值的复杂非线性映射,其归纳偏倚来自网络结构(深度、宽度)和激活函数。FUTON则是显式地将信号建模为一个广义傅里叶级数,并通过低秩张量分解来参数化其频谱系数,其归纳偏倚直接来自谱域的光滑性和低维结构性。这使得FUTON训练更快、更稳定,泛化更好。

3. 文中的“张量网络”是什么?

张量网络是一种用于表示和操作高维张量(多维数组)的数学框架和图形化语言。它的核心思想是通过将一个大张量分解为许多通过特定模式连接起来的小张量(“网络”),来高效表示高维数据中存在的低秩或纠缠结构。CP分解就是其中一种最简单的张量网络。张量网络在物理、化学和近年来的机器学习中都有广泛应用。

主要参考文献

[1] Ashtari, P., Behmandpoor, P., Deligiannis, N., & Pizurica, A. (2026). FUTON: Fourier Tensor Network for Implicit Neural Representations. arXiv preprint arXiv:2602.13414.

本文内容基于对原论文的解读与梳理,旨在进行技术交流。更多关于人工智能与前沿算法的深度讨论,欢迎访问云栈社区与广大开发者共同探讨。