调试摄像头时,你是否经常遇到设备打不开、CPU占用率飙升或者帧率始终上不去的困扰?

如果答案是肯定的,那么请停止盲目使用 cv2.VideoCapture(0)!本文基于真实的设备调试日志,为你揭示Linux下摄像头工作的底层逻辑,并手把手教你如何正确、高效地与OpenCV、FFmpeg、GStreamer这三大主流框架进行集成。掌握这些,你就能轻松驾驭视频捕获任务。

为什么你的简单命令总是失败?

不少开发者都经历过类似的场景:一个看似简单的命令,执行后却莫名其妙地报错。

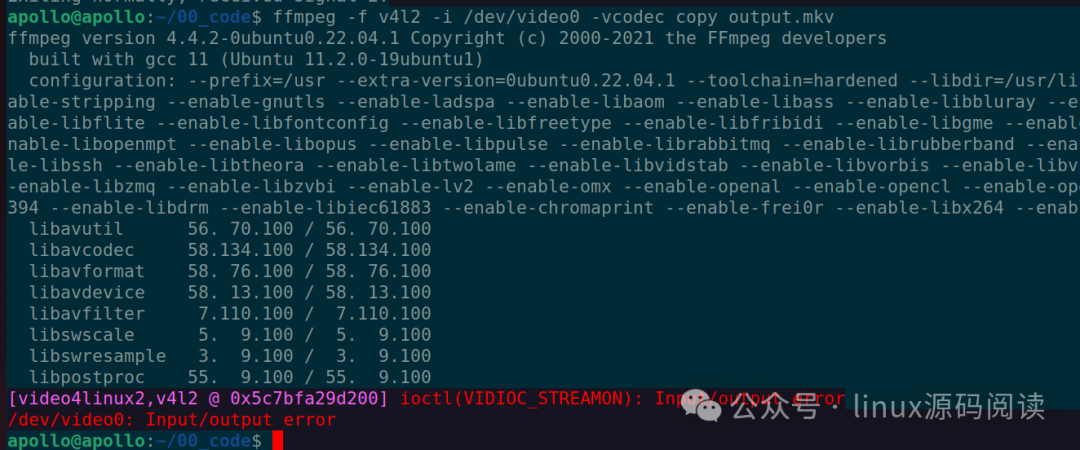

# FFmpeg 报错

ffmpeg -f v4l2 -i /dev/video0 ...

# → ioctl(VIDIOC_STREAMON): Input/output error

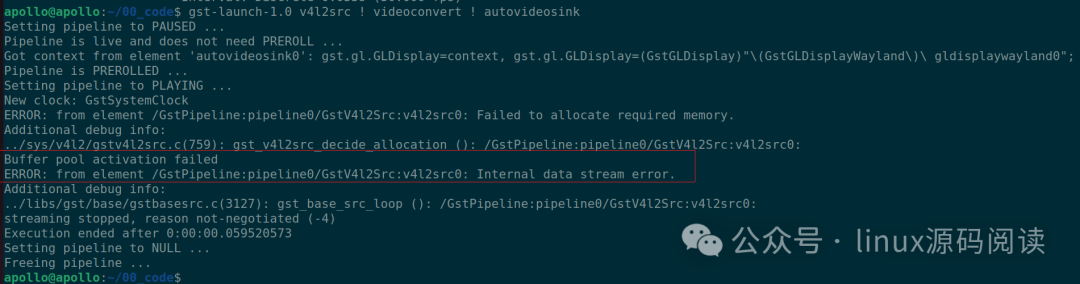

# GStreamer 崩溃

gst-launch-1.0 v4l2src ! videoconvert ! autovideosink

# → Failed to allocate required memory

然而,有时候换一条命令却能成功运行:

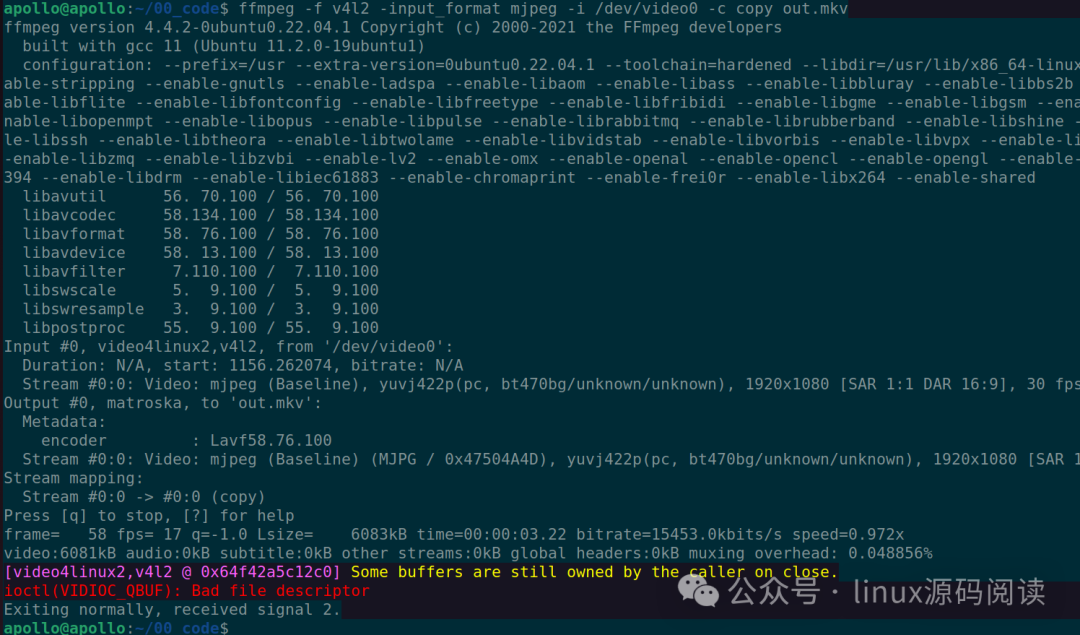

ffmpeg -f v4l2 -input_format mjpeg -i /dev/video0 -c copy out.mkv # 成功

这究竟是为什么?问题的答案,其实就隐藏在摄像头设备通过 V4L2(Video for Linux 2)接口所暴露的能力描述中。

第一步:务必先检查摄像头支持什么!

在编写任何代码或命令之前,请养成一个关键习惯:先查询你的摄像头设备支持哪些格式和分辨率。

执行以下命令:

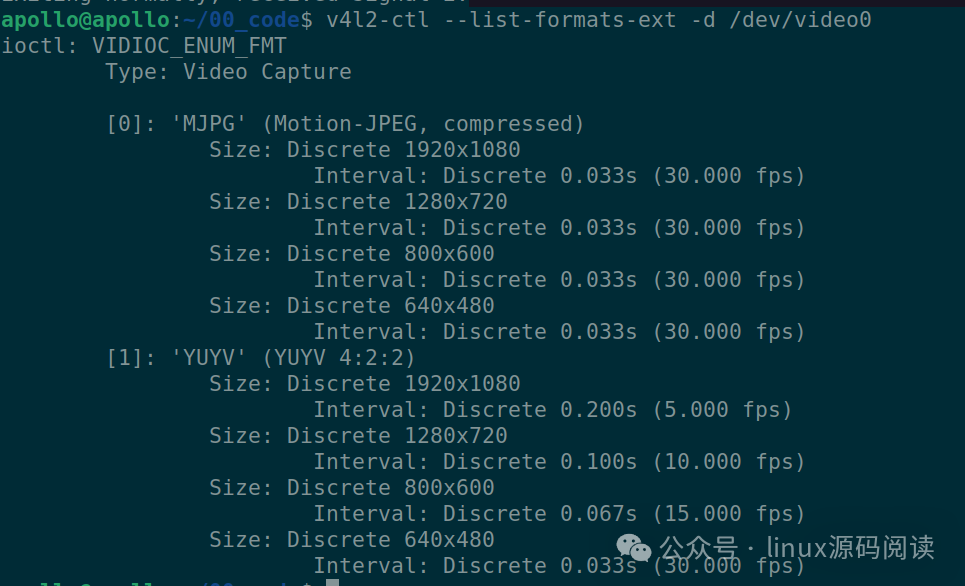

v4l2-ctl --list-formats-ext -d /dev/video0

以一台常见的USB摄像头为例,输出可能如下:

ioctl: VIDIOC_ENUM_FMT

Type: Video Capture

[0]: ‘MJPG’ (Motion-JPEG, compressed)

Size: Discrete 1920x1080

Interval: Discrete 0.033s (30.000 fps)

Size: Discrete 1280x720

Interval: Discrete 0.033s (30.000 fps)

Size: Discrete 800x600

Interval: Discrete 0.033s (30.000 fps)

Size: Discrete 640x480

Interval: Discrete 0.033s (30.000 fps)

[1]: ‘YUYV’ (YUYV 4:2:2)

Size: Discrete 1920x1080

Interval: Discrete 0.200s (5.000 fps)

Size: Discrete 1280x720

Interval: Discrete 0.100s (10.000 fps)

Size: Discrete 800x600

Interval: Discrete 0.067s (15.000 fps)

Size: Discrete 640x480

Interval: Discrete 0.033s (30.000 fps)

从输出中可以发现两个关键点:

- MJPG (MJPEG):这是一种压缩格式。可以看到,它支持1080p@30fps,性能表现良好。

- YUYV:这是一种未经压缩的原始格式(YUV 4:2:2)。在1080p分辨率下,它仅支持5fps,而且数据带宽极高(估算约1920*1080*2 bytes/pixel * 5 fps ≈ 20 MB/s)。对于高清视频流来说,这个带宽压力是巨大的。

很多框架(如OpenCV、FFmpeg的默认模式)会优先尝试使用YUYV格式并以最高分辨率打开设备。结果就是——驱动可能因无法处理高带宽而崩溃,或者性能表现极差,最终导致命令失败。理解这一点,是成功进行视频捕获的第一步。

三大框架的正确配置与用法

了解了设备的“能力”后,我们就可以针对性地配置各个上层框架了。

FFmpeg:录制与推流的首选工具

错误示范(使用默认模式,可能触发YUYV):

ffmpeg -f v4l2 -i /dev/video0 -c:v libx264 out.mkv

# → 可能自动选择YUYV@1080p,导致I/O error或性能低下

正确做法:显式指定MJPEG格式并使用流复制

对于单纯的录制或推流任务,最佳实践是让摄像头输出其原生支持的压缩格式(如MJPEG),然后直接封装,避免不必要的解码和重新编码。

ffmpeg -f v4l2 \

-input_format mjpeg \

-video_size 1920x1080 \

-framerate 30 \

-i /dev/video0 \

-c:v copy \ # 关键!不解码,直接复制编码流

output.mkv

这种方式的优势非常明显:CPU占用率通常低于5%,实时性高,并且生成的文件体积小。

GStreamer:功能强大但需要谨慎配置

错误示范(未指定格式,默认可能尝试原始格式):

gst-launch-1.0 v4l2src ! videoconvert ! autovideosink

# → Buffer pool activation failed

正确做法A:仅采集MJPEG流(用于存储或推流)

如果目的只是保存原始流或进行网络推流,可以像FFmpeg一样直接处理MJPEG数据。

gst-launch-1.0 v4l2src device=/dev/video0 \

! image/jpeg,width=1920,height=1080,framerate=30/1 \

! filesink location=camera.mjpeg

正确做法B:预览时主动降低解码负载

如果需要在屏幕上实时预览,软件解码1080p的MJPEG流对CPU压力很大。一个有效的策略是降低预览分辨率以减轻负担。

# 使用720p分辨率减轻CPU解码压力

gst-launch-1.0 v4l2src device=/dev/video0 \

! image/jpeg,width=1280,height=720,framerate=30/1 \

! jpegparse ! jpegdec \

! videoconvert ! autovideosink

重要提示:在软件解码模式下,1080p的MJPEG流极易导致GStreamer管道丢帧(日志中会出现“A lot of buffers are being dropped”的警告)。除非你的系统有硬件加速解码支持(如Intel VAAPI、NVIDIA NVDEC),否则建议在预览时使用较低分辨率。

OpenCV:快速开发,但需手动干预

Python开发者最常见的误区就是直接使用默认参数打开摄像头:

cap = cv2.VideoCapture(0) # 默认行为可能选择了低效的YUYV格式!

正确初始化(设置顺序很重要!)

为了确保OpenCV使用高效的MJPEG格式,你必须在打开设备后立即进行一系列属性设置。

import cv2

cap = cv2.VideoCapture(0)

# 关键步骤:在open后立即设置FOURCC编码为MJPG

cap.set(cv2.CAP_PROP_FOURCC, cv2.VideoWriter_fourcc('M','J','P','G'))

cap.set(cv2.CAP_PROP_FRAME_WIDTH, 1920)

cap.set(cv2.CAP_PROP_FRAME_HEIGHT, 1080)

cap.set(cv2.CAP_PROP_FPS, 30)

cap.set(cv2.CAP_PROP_BUFFERSIZE, 1) # 可选:设置为1可以减少缓冲延迟

ret, frame = cap.read()

if ret:

print("成功读取高清帧!")

总结:理解底层,方能驾驭上层

Linux下的摄像头看似“即插即用”,但其底层驱动(V4L2)与上层应用框架之间存在着需要开发者主动协调的细节。作为所有视频应用框架的基石,V4L2 的正确理解至关重要。

记住以下三条实践法则,能帮你避开大多数坑:

- 先调查:动手前,务必使用

v4l2-ctl --list-formats-ext 查看设备能力。

- 选对格式:优先使用摄像头硬件支持的压缩格式(如MJPEG、H.264),避免使用原始格式(如YUYV)。

- 避免无谓转换:在录制、推流等场景下,尽量使用“流复制”(如FFmpeg的

-c copy),避免进行高消耗的软件解码和再编码操作。

下次当你习惯性地写下 VideoCapture(0) 时,不妨先停下来思考一下:我的摄像头,真的准备好以这种模式工作了吗?希望这篇从真实调试经验中总结的指南,能帮助你在 云栈社区 的开发者之路上走得更稳。如果你在实践中遇到其他有趣的问题或解决方案,也欢迎分享交流。