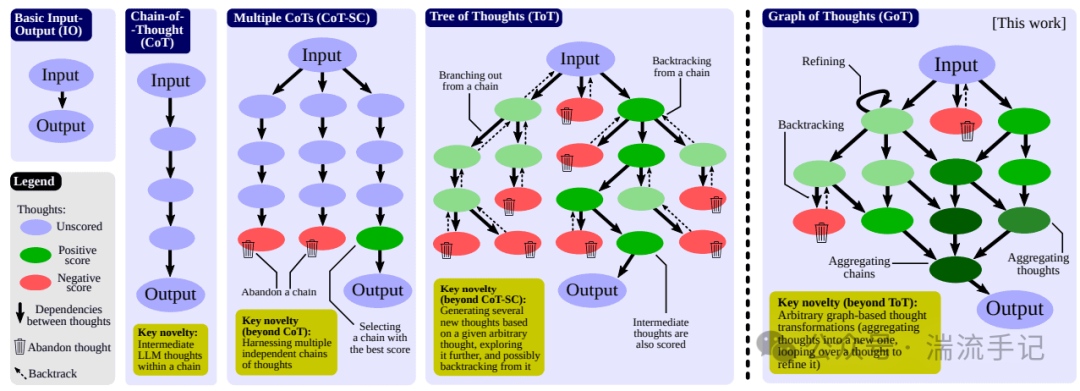

别盯着单一的节点看了,思维的本质其实是这张错综复杂的拓扑网。

揭开幻觉的遮羞布:长链条推理的“迷失”

过去两年,整个业界都在试图教会大模型完成复杂的数学题和长篇代码编写。为了让模型在多步推理中保持正确轨迹,普遍的做法是大量投喂高质量数据,并让小模型逐字模仿大模型的解题步骤。

结果呢?许多小模型变成了只会背诵标准答案的“差生”。面对熟悉的题型,它能写出逻辑严密的推导过程;可一旦边界条件稍有变化,模型便会立刻“理直气壮”地产生幻觉。所谓的长链条推理(Long CoT),在很多场景下演变成了一场漫长且容易脱轨的胡言乱语。

问题的根源在于,我们一直将大模型的推理过程视为一种高级的“文字接龙”。我们天真地认为,只要在提示词中加入“让我们一步步思考”,或者强制模型输出大量连接词,它就是在进行真正的思考。

直到近期,字节跳动研究团队(ByteDance Research)发表了一项名为 MOLE-SYN 的新研究。这篇论文如同一把精准的手术刀,直接划开了AI伪装思考的表象。研究发现,真正高质量的深度推理过程,其核心并非那些浮于表面的漂亮词汇,而是一种类似“分子结构”的拓扑形状。

这揭示了一个颇具讽刺意味的现实:我们一直在用文科生背诵课文的方法训练AI,但AI真正能够记住并复用的,却是理科生眼中的化学键连接方式。

算力池里的“化学键”:被忽视的几何美学

如果我们把大模型一段精彩的推理过程放在“显微镜”下观察,MOLE-SYN 的研究告诉我们,里面维持逻辑稳定的“化学键”主要有三种:

- 深层推理 就像是共价键,强劲且具有明确的方向性,紧密地推动着核心逻辑的演算。

- 自我反思 扮演着氢键的角色,它可能不直接产生新答案,但能让整个思维结构紧凑折叠,避免在生成长文本后彻底散架。

- 自我探索 则如同范德华力,虽然微弱但普遍存在,松散地拓展着寻找答案的边界。

将冰冷的算力与矩阵运算比作分子间的相互作用,这种视角本身就像是在冗长的底层代码中绽放出一朵理性之花。

以往,一些厂商为了提升小模型能力,会直接将强大模型的输出文本拿来对小模型进行微调。这好比你想学习米其林大厨的厨艺,不去理解他对火候与食材间化学反应的掌控逻辑,反而逐帧模仿他颠勺时的手部动作——最终只能是形似而神散。

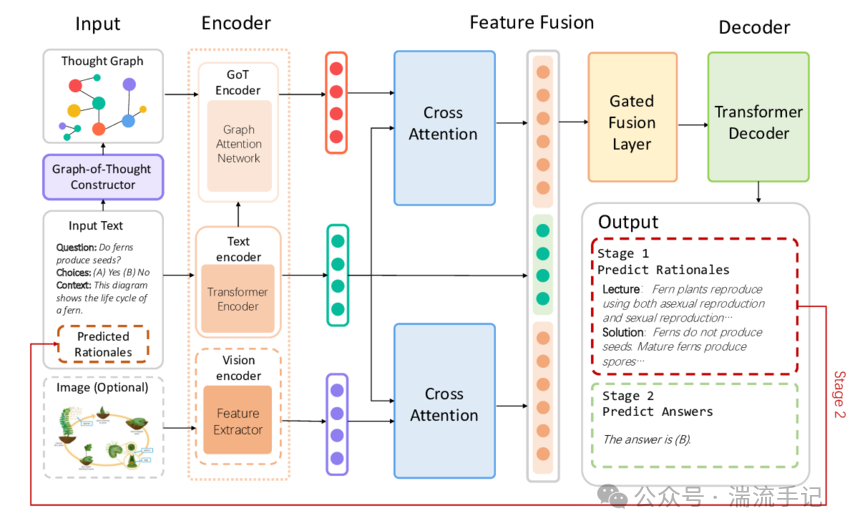

MOLE-SYN 的巧妙之处在于,它构建了一个“分布转移图”。它不复制文字,而是复制那个“大厨”脑中的“行为拓扑”。研究人员通过估算强模型的行为转移概率图,再用它来指导一个纯粹的指令微调大模型去合成属于自己的长推理轨迹。这样一来,小模型学会了在何时该用“共价键”强力突进,在何时该用“氢键”进行自我纠错。

这也从侧面解释了,为何某些闭源厂商对其内部模型的推理思考过程讳莫如深。他们害怕的或许不是你抄袭文案,而是你通过技术手段,将他们耗费千万美元算力才炼化出的“思维拓扑图”给逆向映射出来。

就像化学键连接着原子,这些分布转移图正悄悄将巨头们的“智力结构”迁移给小模型。

丢掉抄写本,拿上“拓扑图”

将“拓扑图”注入小模型,究竟能带来多大收益?让我们看看硬核的数据。

传统的模仿学习方法成本高昂,且面临严重的收益递减问题。那些依靠堆砌无效提示词强行让模型思考的架构,一旦结合强化学习进行训练,其效果曲线往往像心电图一样剧烈波动。这是因为模型只记住了表象,并未内化逻辑的结构稳定性。

然而,在GSM8K、MATH-500乃至OlymBench这类专攻复杂问题的基准测试中,采用MOLE-SYN方法的纯粹指令模型(例如基于Qwen-2.5进行知识蒸馏的模型),表现出了惊人的稳定性。实验数据表明,使用MOLE-SYN合成的轨迹进行蒸馏,其效果甚至逼近了直接从高成本的专精模型进行蒸馏的水平。

研究中还提出了一个有趣的概念:“有效语义同分异构体”。研究表明,并非所有的推理结构都能有效促进学习。只有那些能够推动“快速熵收敛”的拓扑结构(即“化学键”),才能让强化学习训练真正稳固下来。如果强行组合一些结构冲突的推理路径,这种“结构竞争”反而会严重损耗训练效果。

说得更直白一些——即使你给予模型再高的算力预算,如果其底层的逻辑拓扑是一盘散沙,那感觉就像是用圆珠笔在水面上刻字,无论多用力、喂多少数据,最终都可能是一场空。

这原本是生物学中描述DNA复性的曲线,但用来隐喻AI强化学习中的“熵收敛”过程,竟有种奇妙的和谐感。

当思维变成可计算的几何体

如果推理的本质真的是一张张复杂的“分子拓扑图”,这是否意味着,那些被我们视为“灵光一闪”的创造性思维,在未来也可能只是一组可以被精确降维、被数学模型复刻的几何参数?

如果“自我反思”只是氢键的作用,“自我探索”只是范德华力的拉扯……那么,会不会有一天,当大模型的思维拓扑图复杂到突破某个临界点时,它会自行合成出我们人类大脑受限于生物结构而永远无法理解的“新型化学键”?

甚至,我们常常抱怨的大模型“幻觉”,从拓扑学的视角来看,或许根本不是因为它“变笨了”,而仅仅是在某次状态跃迁中,一个本应牢固连接的“共价键”突然断裂,导致整个逻辑图谱瞬间坍塌成一团无意义的乱码?

当我们在为AI能够完美映射并生成强模型的逻辑结构而欢呼时,是否也在亲手将人类最后一点“不可解释的直觉”,稳稳地关进了数学的牢笼?这确实是一个值得商榷的深刻问题。

逻辑的尽头是诗意

在这个所有厂商都热衷于吹嘘参数量、将算力堆叠视为唯一解药的喧嚣时代,能看到有研究团队愿意沉下心来,剥离表象的文字噪音,去探寻逻辑底层的分子拓扑结构,这本身就令人振奋。

我们常觉得机器冰冷,代码枯燥。但当你透过那些复杂的分布转移图,看到庞大的数据流在多维空间里,像原子一样通过Transformer等结构紧密相连、折叠、延展,最终凝结成一个优雅答案时,那种锐利的智力美感,确实令人着迷。

或许,这才是技术世界最迷人的反差:在最严密的逻辑尽头,我们依然能窥见宇宙运行的诗意。

参考资料:

- Forget Keyword Imitation: ByteDance AI Maps Molecular Bonds in AI Reasoning

- The Molecular Structure of Thought: Mapping the Topology of Long Chain-of-Thought Reasoning

- Mapping the Topology of Long Chain-of-Thought Reasoning - arXiv

本文由技术社区编辑基于公开研究进行解读,更多关于AI推理优化与前沿架构的深度讨论,欢迎访问云栈社区进行交流。