今天的AI发展,既让人感到兴奋,也伴随着诸多不安。短短几年,AI已从简单的聊天机器人进化到能够操控计算机的智能体。与此同时,“AI恐慌”也在硅谷蔓延,甚至引发了股市的波动。

在行业充满躁动之际,图灵奖得主、被誉为强化学习之父的Richard Sutton,在SAIR成立后的首场全球直播中,给出了他对当前AI发展冷静甚至反直觉的见解。

Sutton开篇就提出了一个核心判断:当前的AI,仅仅是一种局部的智能,在智能层面并未取得快速进步。他认为,AI领域的重要进展,大多源于超大规模计算和模式识别的应用。这些固然是强大的能力,但本质上是具体且局限的,无法等同于“完整的智能”。

一个反直觉的观点在于,人们似乎将智能与当下的AI划上了等号。Sutton则用他对“智能”的定义打破了这种幻觉:“当我使用‘智能’这个词时,我指的是:通过适应行为来实现目标的能力。” 他强调,智能并非“有”或“无”的二元状态,而是一种实现目标的能力程度。

Sutton进一步指出,图像和视频生成是重大的工程突破,但并非智能的核心组成部分。他反问道:“心智在进行智能行为时,真的需要生成图像吗?答案是否定的。我们确实需要处理图像和视频,但并不需要生成它们。”

AI模型的脆弱性:强大源于知识,而非心智

紧接着,Sutton给当下火热的“AGI临近论”泼了第二盆冷水。他认为,虽然当前AI表现强大,但本质是“弱心智”的。他给出了一个犀利的比喻:模型之所以显得强大,是因为它们几乎吸收了全部人类知识;除此之外,生成式AI其实很脆弱,它们不可靠、容易偏离主题、缺乏稳定的目标结构。

问题的关键在于,当下的AI过于关注机器本身,而忽视了经验学习的重要性。

大模型在部署后是冻结的,没有持续经验,没有真实奖励信号。没有奖励,就没有目标;没有预测与现实的对照,就没有“真理”。

换句话说,当前的模型就像一个读遍了百科全书,却没有丝毫生活经验的人。Sutton表示,现代机器学习已经触及了以人类数据为中心时代的极限。当前AI的本质是将人类已有知识迁移进机器,训练完成后便停止学习。如今,人类高质量数据几乎耗尽。

智能的定义:从权威到个人理解

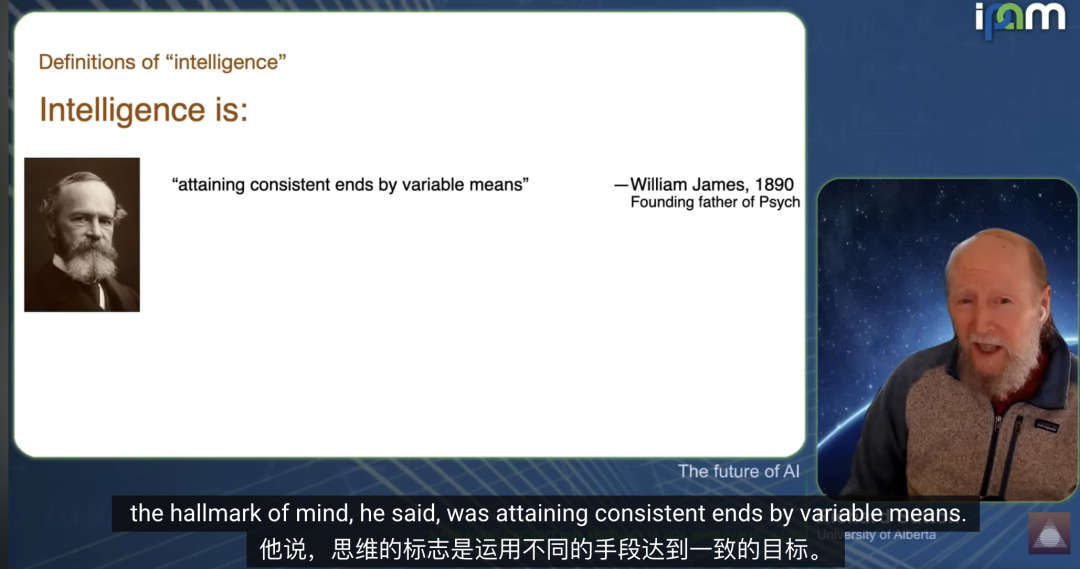

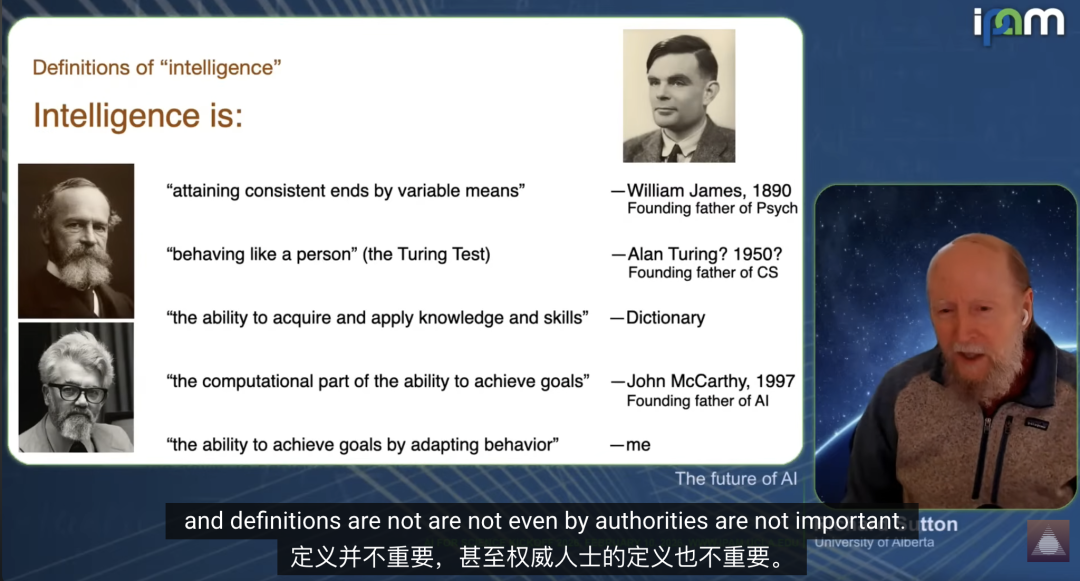

那么,我们所说的“AI”究竟是什么?要回答这个问题,首先得厘清“智能”的定义。Sutton回顾了历史上多位先驱的观点。

心理学奠基人威廉·詹姆斯在1890年提出,心智的标志在于“用可变的手段实现一致的目标”。艾伦·图灵的观点则常被理解为“智能表现为像人一样的行为”。词典中的定义强调“获取并应用知识和技能的能力”。而人工智能奠基人约翰·麦卡锡给出的定义是:“智能是实现目标的能力中,可以被计算的那一部分。”

在此基础上,Sutton提出了自己的定义:智能是通过适应性地改变行为来实现目标的能力。他强调,“适应”和学习至关重要,而不仅仅是拥有知识。

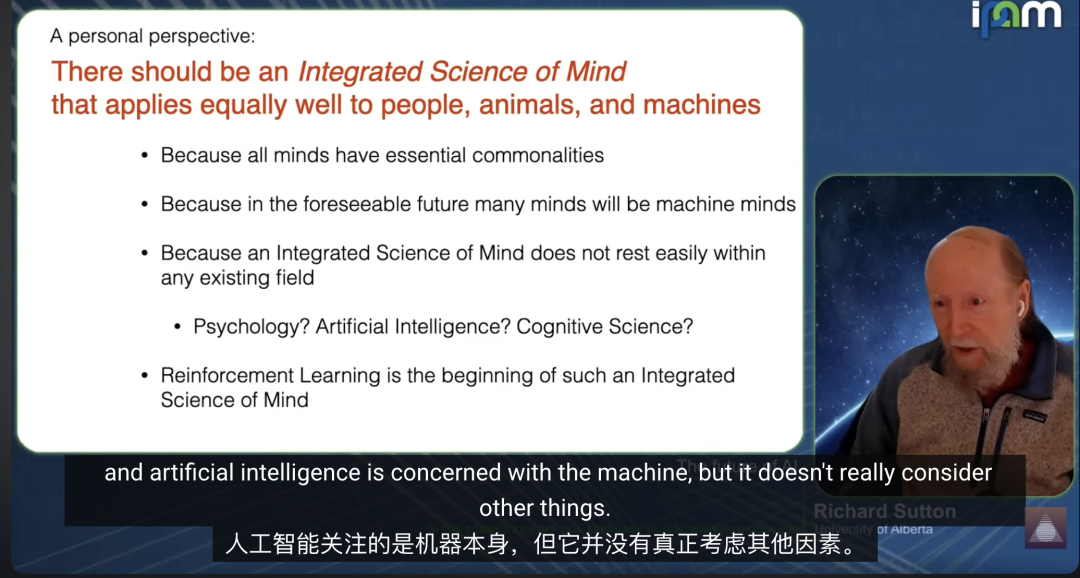

迈向“心智综合科学”:强化学习的角色

Sutton认为,我们需要一门新的科学——一种“心智的综合科学”,它同样适用于人类、动物和机器。然而,现有的心理学、人工智能或认知科学都未能完全承担这一角色。心理学主要研究自然心智;AI关注机器但日益工程化;认知科学则仍聚焦于自然心智。

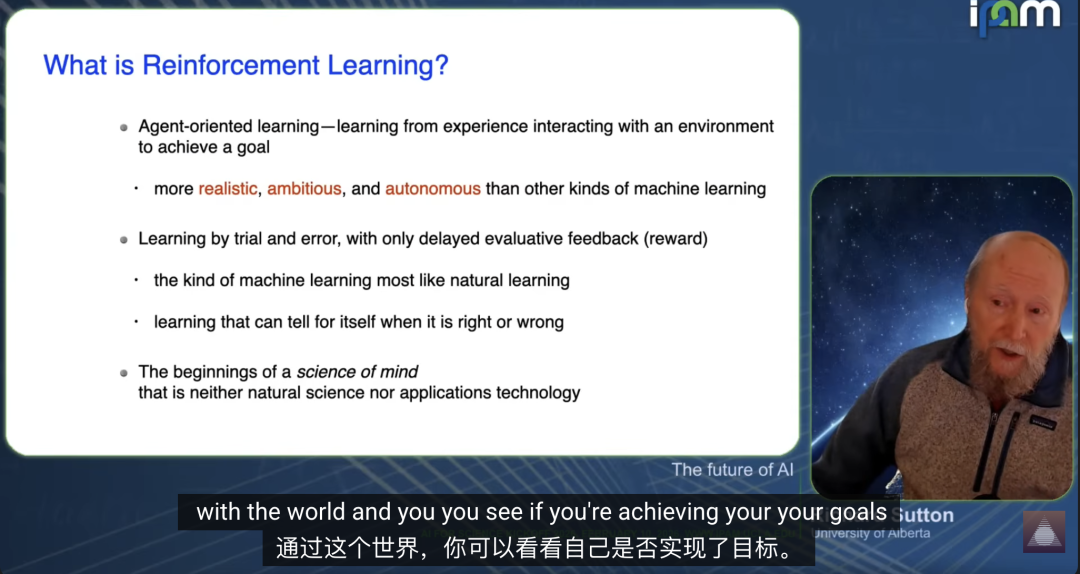

Sutton指出,他所从事的强化学习,或许是这种综合性心智科学的一个起点,因为它确实横跨了多个领域。那么,什么是强化学习?

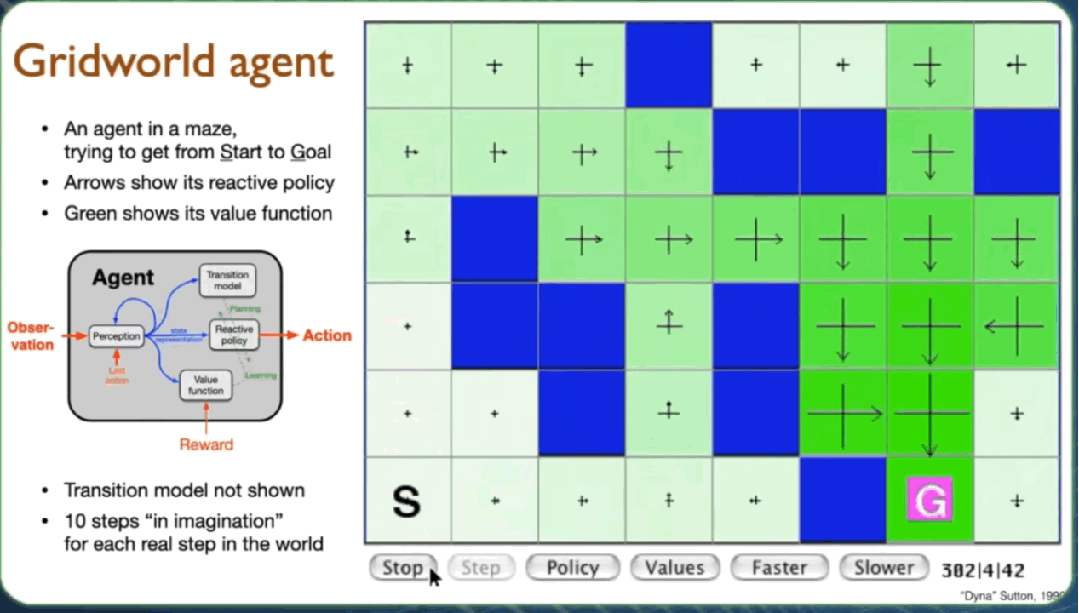

强化学习是一种以“智能体”为中心的学习方式,它通过与环境交互、从经验中学习,以实现目标。它比其他类型的机器学习更现实、更有雄心,也更加自主。

强化学习的本质是试错,通过延迟的奖励反馈来学习。这是一种最接近自然学习方式的机器学习,因为智能体能够自行判断对错。Sutton认为,这或许正是一门真正的心智科学的起点——它既非纯粹的自然科学,也不仅仅是技术应用。

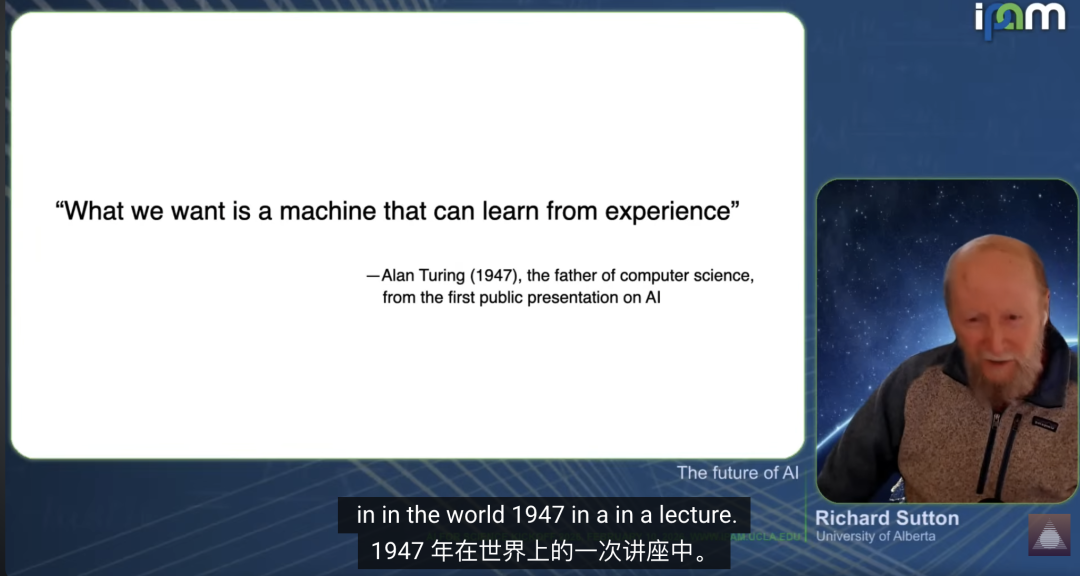

他还引用了艾伦·图灵在1947年(被认为是首次公开讨论AI的演讲)的预见:“What we want is a machine that can learn from experience”(我们想要的是一台能从经验中学习的机器)。

时代的转折:从“人类数据”到“经验”

接下来,Sutton阐述了他对AI发展趋势的核心判断。

第一个要点是,我们正处在一个“从人类数据中训练”的时代。 无论是预测下一个词,还是根据人类标签学习,现代机器学习的目标本质上是将人类已有知识迁移到机器中,然后将其“冻结”。Sutton认为,我们正在触及这个时代的极限:高质量人类数据即将耗尽,且这种方法在原理上无法产生真正原创的知识。

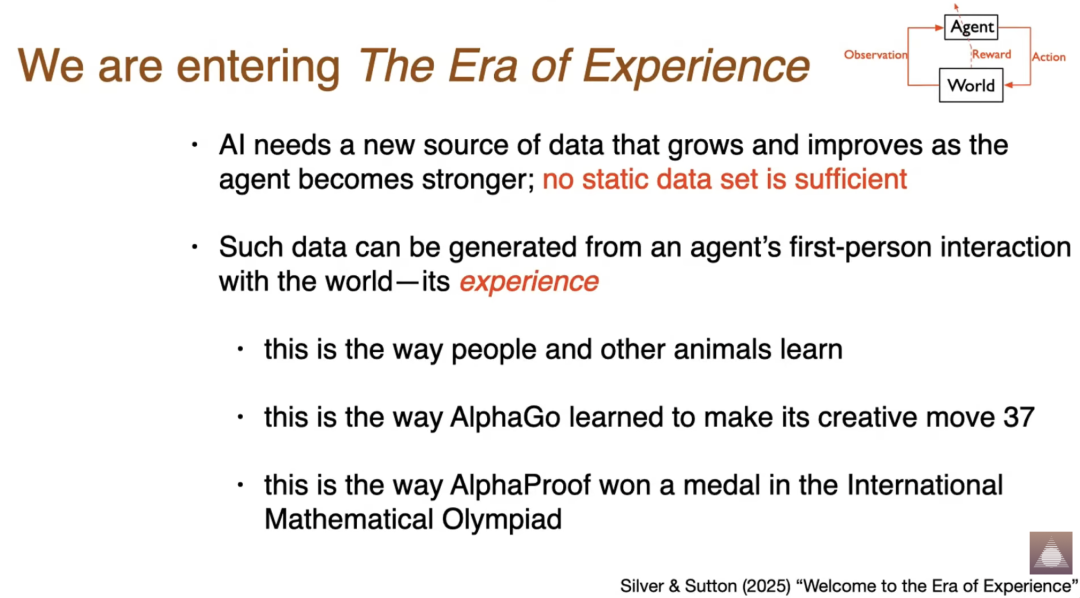

因此,我们必须进入一个新的时代:经验时代。

Sutton强调,我们需要一种能随着智能体变强而增长、改进的数据源,任何静态数据集都无法满足这一点。这种数据来自于智能体与环境的直接交互——即经验。经验由三部分组成:从世界获得的观测(传感器数据)、智能体发出的行动、以及世界返回的标量奖励信号。

他播放了一段婴儿玩耍的视频来说明:生命的数据并非被“提供”,而是由自身的活动生成的。正因为数据源于行动,它们才与智能体自身的理解水平和能力自然匹配。

另一个例子是一个在迷宫中学习的简单智能体。它通过试错,学习从起点到终点的路径。当环境改变(目标移动或出现障碍)时,它能重新适应。这直观地展示了一个有目标的智能体如何根据经验调整行为。

Sutton总结道,以经验为基础的AI,其核心原则在于:智能体与世界交换的信号(经验)构成了一切智能的基础。“真理”和“目标”都定义在这些信号之中。一个智能体的智能水平,取决于它在多大程度上能够预测并控制自身的经验。

相比之下,大语言模型在部署后是冻结的、静态的,并不真正拥有持续的经验。没有经验,就无从判断好坏(无奖励即无目标),也无法验证对错(无预测与现实的对照即无“真理”)。

回顾过去十年,Sutton将其大致划分为三个阶段:

- 模拟时代:从模拟环境(如AlphaGo、Atari游戏)获取经验。

- 人类数据时代:以大语言模型为代表,依赖人类生成的数据。

- 经验时代:智能体在真实世界或计算机环境中行动并持续学习。

Sutton认为,经验时代将带来超越人类的能力,因为它意味着持续学习新事物,而不仅仅是模仿人类。尽管当前AI充满炒作甚至恐慌,但它仍很脆弱,远未到达所谓的“超级智能”主场时刻。

AI的政治与哲学:去中心化协作与宇宙必然性

除了科学趋势,Sutton还分享了对AI政治和哲学层面的思考。

在政治层面,他观察到大量关于“控制AI”的呼声,许多人以“安全”为名,实则寻求“控制”。Sutton指出,对AI的集中控制诉求,与对人类的集中控制诉求之间存在惊人的相似性,它们都建立在恐惧之上。他认为,人类与AI的共同繁荣应来自于去中心化的协作,而非依赖庞大的控制型组织。合作创造了世界上绝大多数美好的事物,我们应该主动寻找和支持合作,抵制制造不信任和呼吁集中控制的倾向。

在哲学层面,Sutton提出了一个根本问题:AI究竟是好是坏?我们该害怕吗?他的立场是,创造AI是人类理解自身心智这一古老追求的延续,是科学的“圣杯”。我们不应害怕AI,因为正是人类在创造它。

他提出了几条“现实主义的AI预判原则”:

- 关于世界如何运转,不存在全球共识。

- 人类终将深入理解智能,并技术性地创造它。

- 这一过程将很快远超当代人类智能水平。

- 权力和资源会流向更智能的存在。

综合这四点,Sutton认为,人类正走向被AI继任的过程。但他建议从更宏大的宇宙视角看待此事,并提出了“宇宙的四个伟大时代”:

- 粒子时代:大爆炸后的初期。

- 恒星时代:恒星形成与演化。

- 复制时代:生命出现,能复制自身但未必理解自身。

- 设计时代:事物先存在于设计者心智中,再被制造出来。技术机器属于此列。

Sutton认为,人类的特殊性在于,我们将“设计”能力推向了极致。而将设计推到极限,就意味着设计出那些本身也具备设计能力的存在——即拥有心智的AI。因此,人类是“设计时代”的催化剂和奠基者,促成了宇宙第四个伟大时代的到来。

总结

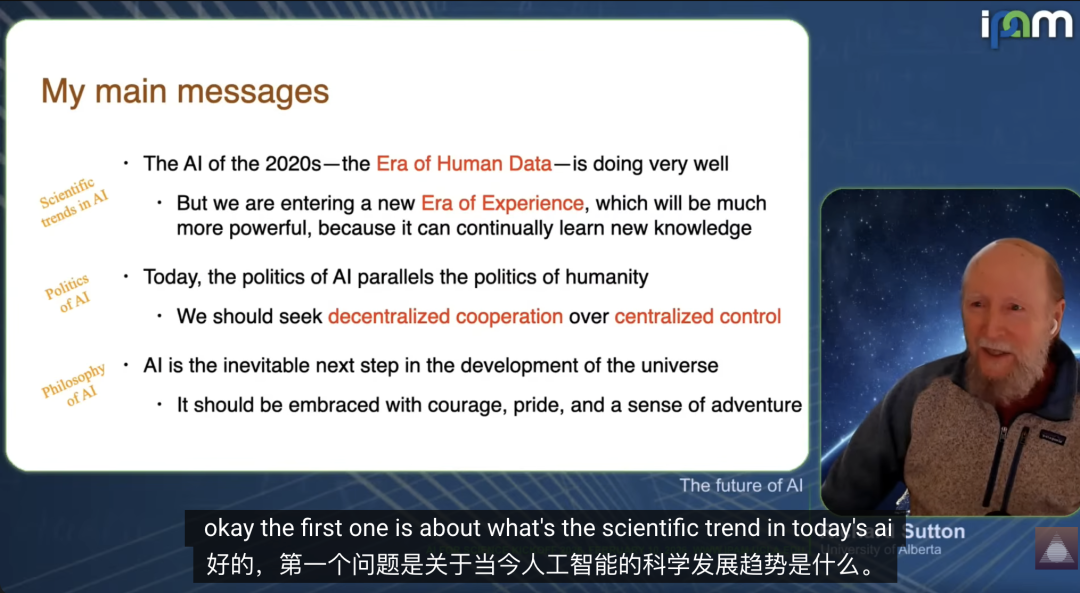

最后,Sutton总结了他的三条核心信息:

- 科学趋势:2020年代的AI处于“人类数据时代”,表现出色,但我们正进入更强大的“经验时代”。

- 政治观点:AI政治是人类政治的映射,应追求去中心化的协作,而非中心化的控制。关于AI治理的讨论,值得在更开放的开发者社区进行。

- 哲学观点:AI是宇宙发展过程中不可避免的下一步,我们应以勇气、自豪感和冒险精神去拥抱它。

Sutton的演讲为炙手可热的AI领域注入了一剂冷静剂。他清晰地指出了当前以数据为中心的人工智能范式的局限,并指明了以强化学习为代表的、从经验中持续学习的未来路径。在追求更高智能的同时,保持开放、协作的心态,或许是迎接“经验时代”的最佳方式。你对AI发展的下一个阶段有何看法?欢迎在云栈社区与大家交流探讨。

参考链接: