你是否曾有过这样的困扰?随口问一句“今天什么计划?”和让它“重写整个认证服务”花费竟然是一样的。无论提示词是简单还是复杂,每次调用都以相同的价格命中同一个模型,这种“一刀切”的付费模式显然不够经济。

对于重度使用 OpenClaw 这类智能体框架的开发者来说,摆在面前的是一个两难选择:在所有任务上都使用 Claude 这类全价模型会导致成本飙升;而换成更便宜的模型,又担心智能体在关键任务上表现不佳。

但细想一下,这种权衡的前提是假设每个提示词都需要同一个模型。如果并非如此呢?答案就是引入一个智能的模型路由层。

理解智能模型路由

大语言模型路由本质上是你应用和供应商之间的一层智能调度。它会读取每个传入的提示词,对任务进行分类,并将其路由到最适合该工作的模型。这样一来,简单的查询可以走快速、便宜的模型,复杂的任务则交给能力更强、价格更高的模型,这一切都是自动完成的。

本文将以 OpenClaw 为例,介绍如何通过 开源实战 项目 Plano 实现这一目标,从而将成本降低高达 80%。

项目简介:Plano

Plano 是一个开源的 AI 原生代理,集路由、编排、护栏和可观测性于一体。它最强大的功能之一就是与开发者偏好对齐的 LLM 路由。与我们常见的基于基准分数路由的方案不同,Plano 是根据开发者对不同任务类型的实际偏好进行路由的,你可以直接在配置文件中进行编码定义。

例如,你可以这样配置:

- 对话及智能体任务 → 便宜快速的 Kimi K2.5

- 代码生成、测试、复杂推理 → 能力更强的 Claude Opus

Plano 会读取每个提示词,与你的偏好进行匹配,并自动调度到合适的模型,整个过程无需对 OpenClaw 做任何改动。

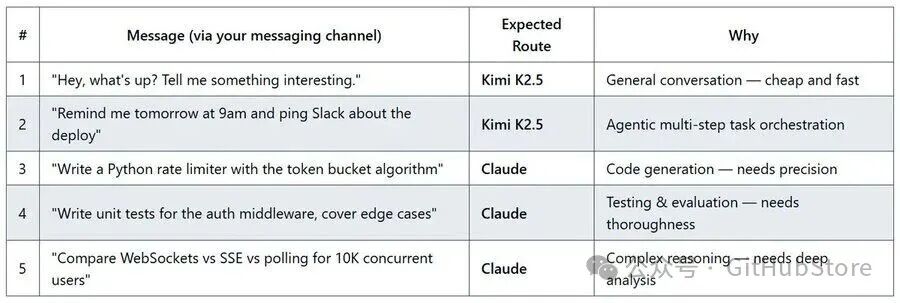

一个简单的任务类型与推荐模型的路由映射表

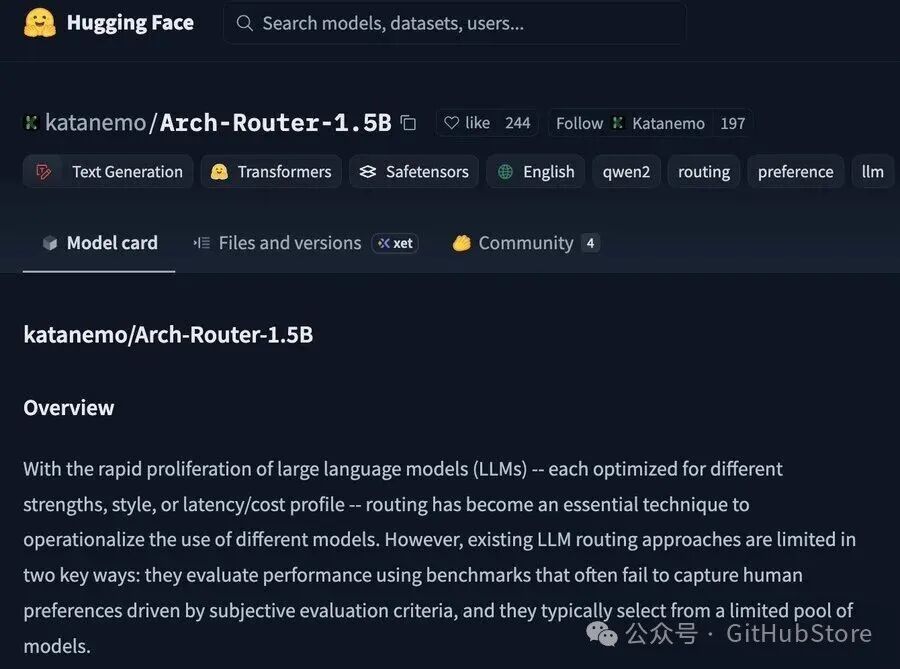

Plano 的核心:Arch-Router

Plano 的强大路由能力构建在 Arch-Router-1.5B 之上,这是一个在人类偏好数据(不仅仅是基准分数)上训练的开源模型,你可以在 Hugging Face 上找到它。

Arch-router 不会猜测哪个模型“更聪明”,而是根据开发者对不同任务类型的实际偏好进行路由。你只需在纯文本配置中定义好路由偏好,剩下的就交给 Plano 自动处理。

实战步骤:为 OpenClaw 配置 Plano 路由

1. 设置环境变量

首先,将你需要用到的模型 API 密钥设置为环境变量:

MOONSHOT_API_KEY=“你的-moonshot-api-key”

ANTHROPIC_API_KEY=“你的-anthropic-api-key”

2. 创建 Plano 配置文件

Plano 的运行依赖于一个 YAML 配置文件,你可以在其中定义 LLM 提供商和路由偏好。创建一个名为 config.yaml 的文件:

version: v0.1.0

routing:

model: Arch-Router

listeners:

egress_traffic:

address: 0.0.0.0

port: 12000

message_format: openai

llm_providers:

- model: openai/kimi-k2.5

access_key: $MOONSHOT_API_KEY

default: true

routing_preferences:

- name: 通用对话

description: 日常聊天,日常问题

- model: anthropic/claude-sonnet-4-5

access_key: $ANTHROPIC_API_KEY

routing_preferences:

- name: 代码生成

description: 生成代码,编写脚本

在这个配置中,我们定义了两个提供商(Kimi 和 Claude),并为它们分配了不同的任务偏好。

3. 启动 Plano

创建好配置文件并设置好环境变量后,使用以下命令启动 Plano 服务:

planoai up config.yaml --with-tracing

--with-tracing 参数会启用追踪功能,方便你后续查看路由决策的详细日志。

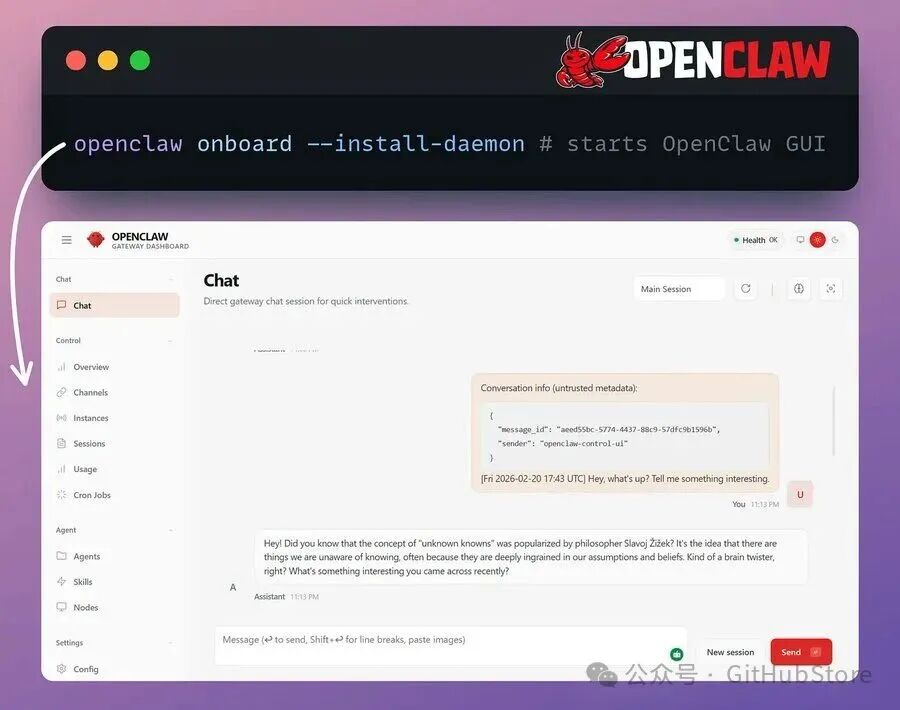

4. 启动 OpenClaw

接下来,按照常规方式启动你的 OpenClaw 服务。运行 openclaw doctor 来验证一切是否正常,然后通过以下命令启动其 GUI 界面:

openclaw onboard --install-daemon # 启动 OpenClaw GUI

5. 将 OpenClaw 的 LLM 后端指向 Plano

在 OpenClaw 的引导向导中,当提示选择 LLM 提供商时,请按如下配置:

- 提供商:选择

Custom OpenAI-compatible

- Base URL:设置为

http://127.0.0.1:12000/v1

- API Key:可以输入任意值(例如

none),因为 Plano 会处理对实际提供商的认证

- Context Window:设置为至少 128,000 个 token

这样,你就将 Plano 注册为了 OpenClaw 的 LLM 后端。所有来自 OpenClaw 的请求都会通过 Plano(端口 12000)进行路由,Plano 会根据提示词内容,智能地将请求分发给 Kimi 或 Claude。

效果验证与要点总结

由于我们在启动 Plano 时使用了 --with-tracing,你可以随时检查追踪记录,查看每个提示词是如何被分类并路由到相应模型的。你会发现,日常对话请求被导向了 Kimi,而复杂的代码生成任务则自动切换到了 Claude。

以前,我们常常花费大量时间手动挑选“正确”的模型,这本质上是一个错误的游戏。真正的问题不是“用哪个模型”,而是“哪个任务该用哪个模型”?智能模型路由 自动回答了这个问题。你只需定义一次偏好,每个提示词就会被智能地匹配到最合适的模型,无需你额外操心。

最终结果就是,你能够在几乎不牺牲关键任务质量的前提下,实现显著的成本节约。Plano 作为一款 100% 开源(Apache 2.0 许可证)的工具,为我们优化 大语言模型 应用的成本与效能提供了强大助力。如果你也面临类似挑战,不妨尝试一下这个方案,在 云栈社区 与其他开发者交流你的实践经验。