在进行大模型Agent开发、网络爬虫项目或是内容存档时,我们经常需要将一个URL地址转化为清晰的网页截图与纯净的HTML源码。如果每次都需要手动启动浏览器并控制其生命周期,虽然能用Playwright或Selenium实现,但这过程不免有些繁琐。

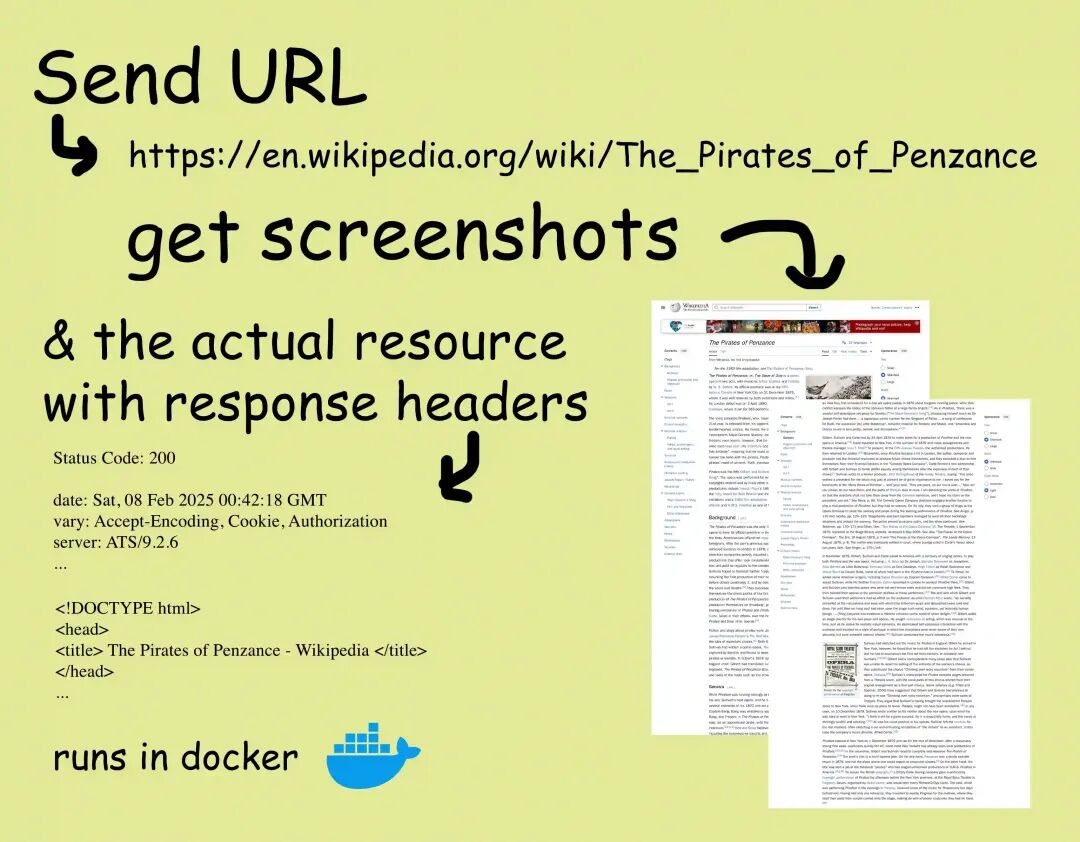

现在,我们可以借助一个开箱即用的开源微服务项目来简化这一流程:ScrapeServ。这个由goodreasonai团队开源的自托管API服务,最初是为了支持其AI平台“Abbey”而开发的,核心功能非常明确:你发送一个URL,它就返回该网站的数据文件以及浏览器渲染后的截图。

该项目采用MIT许可证,目前在GitHub上获得了超过1.1k颗星 (Stars),表明了其活跃度和社区认可度。如果你想了解更多此类开源实战项目的最佳实践与避坑指南,可以前往相关技术社区进行交流。

1. 核心功能

- 高质量浏览器渲染:底层抓取工具是 Playwright,每次任务都会启动一个全新的 Firefox 浏览器上下文,可以稳定地执行页面上的JavaScript代码,确保截图与真人访问看到的完全一致。

- 智能截图机制:它不会只截取首屏内容,而是会自动在页面中滚动,并截取不同部分的屏幕截图,确保长页面内容也能被完整捕获。

- 多截图支持:单次请求最多可返回5张截图,并支持JPEG、PNG或WebP格式的输出。

- 处理复杂网页行为:能够自动跟随HTTP重定向,并正确处理可能导致下载的链接,避免抓取流程意外中断。

- 详细请求数据透出:除了截图和页面HTML源码,服务还会返回首次请求的真实HTTP状态码和响应头信息,这对于调试和数据分析很有帮助。

- 极简架构与队列:采用阻塞式API设计,服务本身具备零状态等低复杂度特性。所有抓取任务都会进入一个配置好内存分配的队列中依次处理,确保了服务稳定性。

2. API接口与调用细节

整个服务只提供了两个主要的端点(Endpoint):

/ (根路径):返回 200 状态码和一些文本,是一个简单的健康检查接口,可用于在浏览器中确认服务器正在运行。/scrape (抓取路径):接收 JSON格式的POST请求,这是核心功能接口。

- 必填参数:

url(要抓取的网址)。

- 可选参数:

browser_dim(设定浏览器窗口长宽的数组)、wait(页面滚动后等待截图的时间,以毫秒为单位,强烈建议设置为 >= 1000)、max_screenshots(希望返回截图的最大数量)。

- 图像格式定制:客户端可以通过HTTP的

Accept 请求头来指定输出的图片格式,支持 image/webp、image/png、image/jpeg(默认格式为 JPEG)。

- 响应格式设计:

- 如果请求出错,服务端会返回一个包含错误信息的JSON响应。

- 如果成功(状态码为

200),服务端会返回一个 multipart/mixed 类型的响应体。这个响应体包含三个主要部分:

- 请求的元信息(JSON格式,包含HTTP状态码、响应头等)。

- 网站数据(通常是

text/html 格式的源码)。

- 最多5张截图(二进制图像数据)。

提示:项目官方提供了Python的客户端参考实现。此外,在Mac/Linux命令行中,你甚至可以结合 cURL 和 ripmime 工具来直接发起请求并保存提取出的各部分文件。

3. 部署方式

由于需要运行无头浏览器,该项目必须完全在Docker容器中运行,因此前置条件是已安装Docker和Docker Compose。

- 简易部署:直接使用官方预构建的Docker镜像

usaiinc/scraper,编写一个简单的 docker-compose.yml 文件,将宿主机的某个端口(例如5006)映射到容器内部即可一键启动。

- 自定义构建(源码部署):克隆代码仓库并执行

docker-compose up。服务将默认运行在 http://localhost:5006。从源码构建的优势在于,你可以直接修改 scraper/worker.py 文件顶部的硬编码配置项,这对于运维和性能调优很有帮助,可调整的限制包括:

- 内存限制(默认

4GB)。

- 最大并发任务数(默认

3)。

- 截图数量限制(默认

5 张,用户通过参数最多可要求 10 张)。

- 浏览器窗口尺寸及自定义的

USER_AGENT(默认为 Mozilla/5.0 (compatible; Abbey/1.0; ...))。

4. 注意事项与潜在风险

在享受便利的同时,我们也需要注意以下几个关键点,尤其是在生产环境部署时:

- 接口裸奔风险:默认启动的服务没有任何身份验证机制。如果你的服务器暴露在公网上,务必在

/scraper 目录下的 .env 文件中设置API密钥进行保护。密钥的环境变量名必须以 SCRAPER_API_KEY 开头,客户端在请求时需要通过 Authorization: Bearer <your_api_key> 方案在HTTP Header中发送该密钥。

- 响应体解析:成功返回值是

multipart/mixed 格式而非纯JSON。这意味着你在客户端业务代码中拿到HTTP响应后,不能简单地调用 JSON.parse(),而是需要自己编写逻辑,将混合内容中的JSON元数据、HTML文本和图片二进制流正确地解析和拆分出来。

- 并发吞吐量限制:这是一个阻塞式设计、基于内存后端 & 架构队列的服务,默认最大并发数仅为3。如果你的需求是每秒同时抓取成百上千个页面,该服务的队列会迅速饱和导致卡死。它并非为工业级高并发爬虫场景设计。

- 安全沙箱与SSRF防护:抓取未知的第三方网站存在被利用进行内网探测(SSRF)的风险。尽管项目本身在容器层面做了进程隔离,并会检查URL以拦截环回地址、本地网络地址和非HTTP(S)链接,但最稳妥的做法仍然是:将运行此Docker服务的主机与你核心的生产环境网络进行物理或VLAN隔离。

项目GitHub地址:

https://github.com/goodreasonai/ScrapeServ

如果你在部署或使用过程中遇到了技术难题,或者想分享自己的配置心得,欢迎在像云栈社区这样的开发者平台上与其他同行交流探讨,共同寻找更优的解决方案。 |