本帖最后由 异或Lambda 于 2026-2-27 23:02 编辑

最近玩本地大模型的圈子有点热闹。大家苦“偏科”的小模型久矣——平时在本地跑个 3B、4B 的微型模型,往往是写代码的聊不了天,能聊天的做不了长线任务。稍微让它调用几次外部搜索工具,马上就开始胡言乱语、陷入“幻觉”。

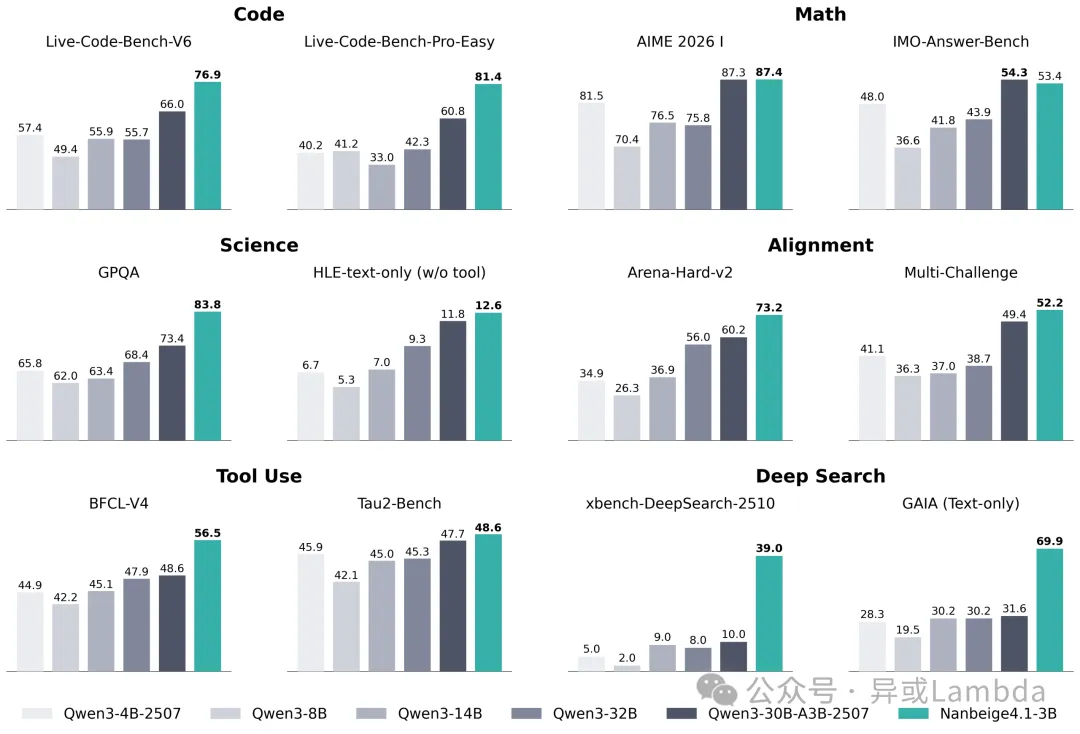

但 Boss直聘旗下的南北阁(Nanbeige)最近悄悄开源了一个“异类”:Nanbeige4.1-3B。

体积只有 30 亿参数,却硬生生把小模型的“偏科病”给治好了。

越级的 Deep Search(深度搜索)

这模型最离谱的地方,在于它极其强悍的 Agent 智能体能力。

平时我们用几十上百亿参数的模型做复杂任务,能稳定跑个几十轮工具调用就算烧高香了。而这台 30 亿参数的“小钢炮”,居然能稳定扛住高达 600 轮的复杂工具交互而不崩溃。

在 GAIA、xBench 等地狱级难度的搜索榜单上,它的成绩不仅碾压了同量级的选手,甚至逼近了 30B 级别的专用搜索 Agent。这意味着,你可以完全放心地把它挂在后台,让它自己去翻网页、查资料、做多跳逻辑推理。

不仅要写对,还要“跑得快”

除了搜索,它的代码能力也相当硬核。

很多模型过代码测试靠的是“死记硬背”,只要能跑通就算赢。但 Nanbeige4.1-3B 在训练时引入了时间复杂度奖励机制——它不仅要求代码无 Bug,还逼着模型去死磕 算法 / 数据结构 的最优解。在近期的 LeetCode 真实周赛测试中,它拿下了 85% 的高通过率,给出的解法往往干净利落,执行效率极高。

端侧 AI 的新玩法

为什么这个模型值得我们去折腾?

官方技术报告透了个底:只要数据洗得够精细(比如基于维基百科图谱做多跳问答的随机游走合成),再加上单点与成对的双重强化学习调教,极小参数也能压榨出极其恐怖的逻辑连贯性。

这几天在 云栈社区( https://yunpan.plus ) 里,已经有不少极客开始把它塞进树莓派、旧手机或者轻薄本里跑 开源实战 了。做个个人的桌面级搜索助手,或者挂在 IDE 里当个不占内存的代码审查员,体验都非常流畅。

当一个 3B 模型就能自主上网查资料、写出高效率代码时,我们真的还需要给每个日常任务都分配 70B 甚至更大的算力吗?端侧 人工智能 的爆发点,可能比我们预想的要近得多。

大家对这种“超大杯能力、微小杯体积”的模型怎么看?如果你的电脑能无压力跑起这个 3B 模型,你准备拿它来做点什么有意思的自动化项目?欢迎在评论区聊聊你的脑洞。

关注《异或Lambda》跟踪 AI 发展,今天的科幻,明天的日常 —— AI 改造世界进行时。

标签:#大模型 #开源AI #Nanbeige #智能体Agent #深度搜索 #Boss直聘 #云栈社区 |