本帖最后由 云栈大前端 于 2026-2-28 21:32 编辑

做过移动端或前端 E2E 测试的兄弟们肯定懂,维护那些又长又脆的 XPath 和控件 ID 有多折磨人。UI 稍微改点样式,或者加个弹窗,测试脚本直接跑挂,天天都在修 Bug 的路上。

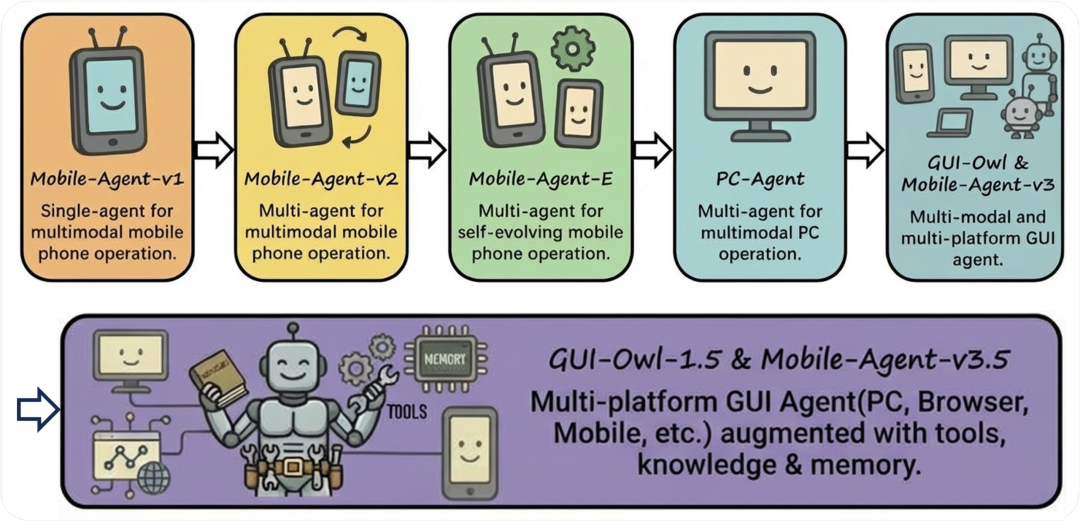

最近阿里通义实验室开源了一个狠活儿——MobileAgent,直接在 GitHub 上狂揽 7.4k Stars。它不按套路出牌,完全抛弃了底层 DOM 树或控件树解析,直接让 AI 像真人一样“看”屏幕、做点击。

简单来说,这是一个纯视觉驱动的跨平台 GUI 智能体框架。你只要给它发一句大白话,比如“帮我在小红书搜一下济南旅游攻略,把收藏最多的一篇存下来”,它就能自己打开 App,一顿操作猛如虎,直接把事儿办了。这不仅是个好玩的黑科技,更是彻底重塑了前端与移动开发的交互边界。

全栈视角的架构拆解

站在咱们全栈的视角来看,它的底层设计非常有意思,主要分三层:

- 端到端视觉大模型(GUI-Owl):

底层基于 Qwen2.5-VL 微调,把感知、定位、推理和执行全塞进了一个网络里。它输出的不是一堆代码,而是精准的屏幕点击坐标。

- 多智能体协作框架(Mobile-Agent-v3):

长链路任务最怕大模型产生“幻觉”或者卡死。所以它搞了个多 Agent 架构:Manager 负责任务拆解和路由,Worker 负责具体执行;Reflector 充当 Error Boundary(错误边界),专门处理突然弹出的广告等异常情况;而 Notetaker 就像个全局的 Redux,负责跨 App 的状态记录和共享。

- 设备通信层:

通过 ADB (Android) 或 HDC (HarmonyOS) 直接驱动底层硬件,把 AI 的意图转化为真实的物理交互。

我们的饭碗会被抢吗?

在云栈社区最近的讨论中,很多大佬都在感慨:前端的尽头难道真的是 AI 吗?

其实换个角度想,这反而释放了巨大的业务价值。对于工程化而言,这意味着几乎零成本的跨端 UI 自动化测试。用自然语言写用例,AI 自己去跑,这绝对是前端框架与工程化领域的一大杀器。

更深远的影响在于,当 AI 逐渐变成你系统最大的“隐形用户”时,前端界面的语义化和无障碍访问 (Accessibility) 将不再是边缘需求,而会成为核心 KPI。因为只有规范的 UI,AI 才能“看”得更准。

想在本地跑起来也不难,装好 qwen_agent 等依赖,手机连上电脑开启 ADB 调试,跑个 Python 脚本就能看 AI 自己“点点点”了。如果你在部署时遇到坑,或者想深入研究它的源码,欢迎来云栈社区的开源实战专区摇人一起填坑。

大家觉得,这种纯视觉的 GUI Agent,会是前端自动化测试的最终形态吗?欢迎在评论区聊聊你的看法。

项目与资源传送门:

- GitHub 地址:

X-PLUG/MobileAgent

- 官方论文:

arxiv.org/abs/2508.15144

- 前端与移动:

https://yunpan.plus/f/13

- 人工智能课程:

https://yunpan.plus/f/29

《云栈大前端》 | 关注我,获取前端、移动、全栈领域最新开源项目盘点。每天 3 分钟,以就业为导向带你掌握前沿技术栈!

标签:#MobileAgent #GitHub #前端工程化 #自动化测试 #人工智能 #跨平台开发 #大模型应用 #云栈社区 #GUI自动化 |