在构建分布式系统时,定时任务调度是一个高频出现却又颇具挑战的难题。你是否还在使用Spring Task或Quartz,却为它们在分布式环境下的种种局限而头疼?单点故障、任务重复执行、节点负载不均等问题,在业务规模扩大后尤为凸显。

ElasticJob正是为解决这些痛点而生的分布式调度解决方案。它最初由当当网开源,现已作为子项目加入Apache ShardingSphere生态,其稳定性和成熟度经过大量生产环境验证。本文将带你从核心概念入手,深入剖析其分片机制与架构设计,并最终通过一个高并发电商订单取消的实战案例,展示如何将其应用于真实业务场景。

一、ElasticJob概述

1.1 什么是ElasticJob

ElasticJob提供了一套完整的分布式调度能力,主要由两个子项目构成:

- ElasticJob-Lite:轻量级无中心化方案,通过引入jar包即可接入,是本文重点。

- ElasticJob-Cloud:基于Mesos的资源调度方案。

1.2 核心特性

- 弹性伸缩:业务高峰期,增加应用实例即可自动重新分配任务分片,无需停机。

- 高可用:无中心化设计,任意节点宕机,其任务会被其他存活节点自动接管。

- 丰富的作业类型:支持简单作业、流式作业、脚本作业和HTTP作业。

- 可视化运维:提供独立的控制台,方便作业管理和监控。

1.3 典型应用场景

- 电商订单超时未支付自动取消

- 定时同步数据至数据仓库或分析库

- 凌晨生成业务报表

- 定期清理历史日志与归档数据

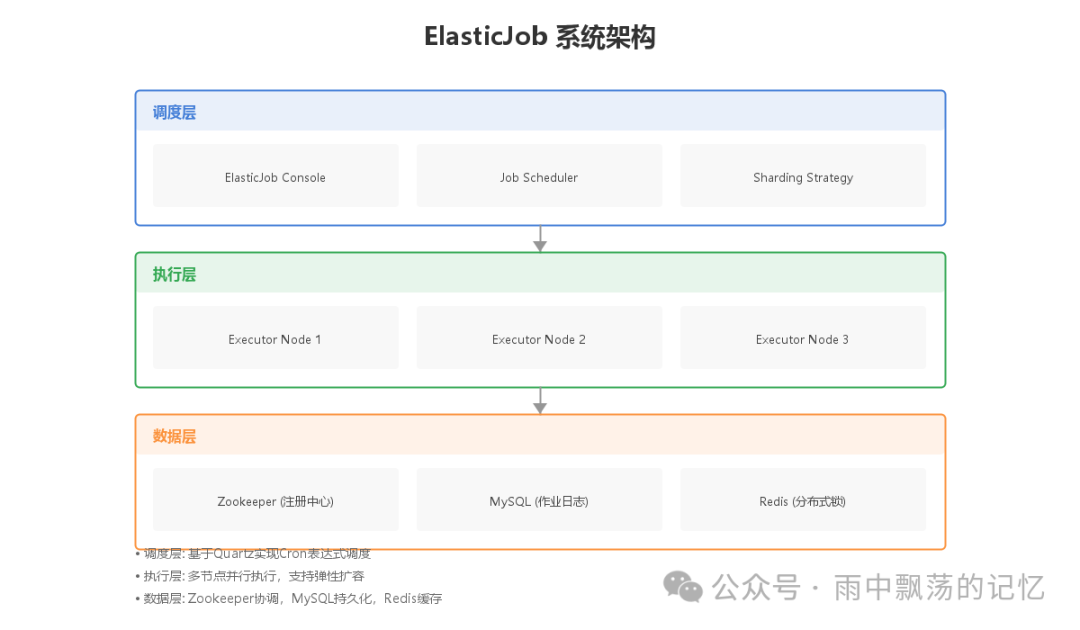

二、核心架构设计

ElasticJob采用清晰的三层架构,各司其职。

2.1 调度层

负责任务的触发与调度逻辑。

- ElasticJob Console:运维控制台。

- Job Scheduler:调度引擎,基于Quartz实现。

- Sharding Strategy:分片策略模块,计算分片如何分配。

2.2 执行层

由你的业务应用实例构成,每个实例都是一个执行节点(Executor Node)。节点启动后向注册中心注册,并领取分配给自己的分片任务执行。

2.3 数据层

提供分布式协调与持久化支持。

- Zookeeper:作为注册中心,存储作业配置、节点状态和分片信息。

- MySQL:持久化作业执行日志。

- Redis:可用于分布式锁、状态缓存等。

三、分片机制详解

分片是ElasticJob实现分布式并行执行的核心。

3.1 分片原理

其核心思想是将待处理数据集按规则拆分,例如对订单ID取模:

// 订单ID为1,4,7,...的订单会被分配到分片0

// 订单ID为2,5,8,...的订单会被分配到分片1

// 订单ID为3,6,9,...的订单会被分配到分片2

int shardingItem = orderId % 3;

3.2 内置分片策略

ElasticJob提供了多种策略:

AverageAllocationJobShardingStrategy:最常用的平均分配策略。OdevityJobShardingStrategy:按奇偶分配,适合双节点。- 其他如全部分配到第一个节点、按配置分配等。

3.3 分片动态调整

当集群节点数发生变化(扩容或宕机)时,ElasticJob会自动触发重新分片,整个过程对业务透明,无需人工干预。

3.4 分片参数使用

可以为不同分片设置不同的业务参数,在配置中指定:

elasticjob:

jobs:

dataSyncJob:

shardingTotalCount: 3

shardingItemParameters: 0=Beijing,1=Shanghai,2=Guangzhou

在代码中通过ShardingContext获取:

@Override

public void execute(ShardingContext context) {

String region = context.getShardingParameter();

// 根据地区参数处理该地区的业务数据

}

四、任务执行全流程

一次完整的任务执行遵循以下生命周期:

- Cron触发:调度器根据Cron表达式判断是否执行。

- 获取分片配置:从注册中心读取作业最新配置。

- 计算分片分配:根据在线节点和策略,计算分片归属。

- 获取执行分片:各节点领取属于自己的分片项。

- 前置回调:执行

beforeJobExecuted()。

- 业务执行:并行执行

execute()方法。

- 后置回调:执行

afterJobExecuted()。

- 记录日志:将执行结果持久化。

关键配置示例:

elasticjob:

jobs:

myJob:

cron: 0 */5 * * * ? # 每5分钟执行一次

shardingTotalCount: 3 # 总分片数为3

monitorExecution: true # 监控执行状态

failover: true # 启用故障转移

misfire: true # 错过重跑

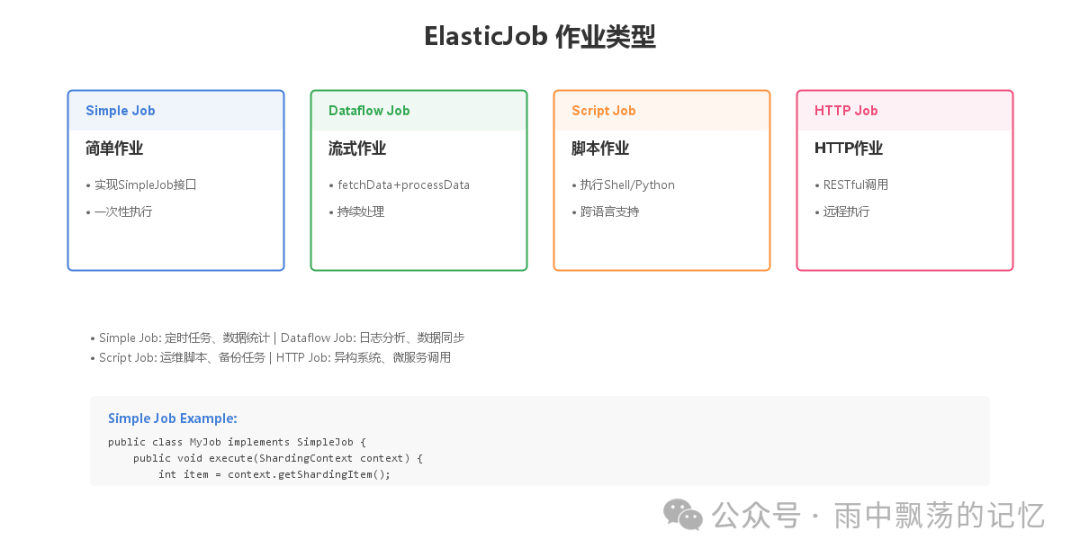

五、作业类型详解

5.1 Simple Job(简单作业)

最基础的作业类型,实现SimpleJob接口,一次性执行完成。

适用场景:数据清理、定时统计。

代码示例:

@Component

public class DataCleanupJob implements SimpleJob {

@Autowired

private DataMapper dataMapper;

@Override

public void execute(ShardingContext context) {

int shardingItem = context.getShardingItem();

// 只清理当前分片负责的过期数据

Date expireDate = DateUtils.addDays(new Date(), -90);

List<Data> expireData = dataMapper.selectExpireData(expireDate, shardingItem, context.getShardingTotalCount());

for (Data data : expireData) {

dataMapper.delete(data.getId());

}

}

}

5.2 Dataflow Job(流式作业)

实现DataflowJob<T>接口,包含fetchData()和processData()方法,适合持续处理数据流。

适用场景:日志实时分析、数据同步。

特点:配置streamingProcess: true后,会循环fetchData -> processData直到数据抓取完毕。

5.3 Script Job(脚本作业)

用于执行Shell、Python等外部脚本,实现跨语言调度。

适用场景:服务器备份、运维脚本。

配置示例:

elasticjob:

jobs:

backupJob:

jobType: SCRIPT

cron: 0 0 3 * * ?

scriptCommandLine: "/opt/scripts/backup.sh"

5.4 HTTP Job(HTTP作业)

通过HTTP调用触发远程服务,非常适合微服务架构。

适用场景:跨服务任务触发、异构系统集成。

配置示例:

elasticjob:

jobs:

reportJob:

jobType: HTTP

cron: 0 0 4 * * ?

restfulUrl: "http://report-service/api/job/dailyReport"

六、环境部署与高可用

6.1 生产架构建议

- 注册中心:部署Zookeeper集群(至少3节点)。

- 执行节点:应用多实例部署,前置Nginx做负载均衡。

- 数据库:MySQL用于日志持久化。

6.2 关键配置经验

- 分片数设置:建议设置为节点数的2-3倍,既充分利用资源,又便于故障转移。

- 启用故障转移:

failover: true确保节点宕机后任务不中断。

6.3 Docker Compose快速部署

可以使用Docker Compose一键拉起包含Zookeeper集群、MySQL、Redis和多个ElasticJob应用实例的完整环境,具体配置详见原文Docker Compose文件。

七、实战案例:电商订单超时取消

7.1 业务挑战

日均百万订单,要求下单30分钟未支付则自动取消。在分布式环境下面临:

- 数据量庞大,单节点扫描压力大。

- 多实例部署易导致重复取消。

- 取消逻辑涉及订单、库存、优惠券等多张表,需保证数据一致性。

7.2 ElasticJob解决方案

核心思路:利用分片机制,将海量订单按ID取模分散到不同节点并行处理。

作业配置:

elasticjob:

regCenter:

serverLists: localhost:2181

jobs:

orderCancelJob:

elasticJobClass: com.elasticjob.job.OrderCancelJob

cron: 0 */5 * * * ? # 每5分钟扫描一次

shardingTotalCount: 3 # 分3片

failover: true

misfire: true

分片查询SQL核心:

SELECT * FROM orders

WHERE status = '待支付'

AND create_time < DATE_SUB(NOW(), INTERVAL 30 MINUTE)

AND MOD(id, 3) = ? -- ? 替换为当前分片项

作业实现关键逻辑:

@Component

public class OrderCancelJob implements SimpleJob {

@Override

public void execute(ShardingContext context) {

int shardingItem = context.getShardingItem();

int shardingTotalCount = context.getShardingTotalCount();

// 1. 查询当前分片下的超时订单

List<Order> timeoutOrders = orderMapper.selectTimeoutOrders(30, shardingItem, shardingTotalCount);

for (Order order : timeoutOrders) {

// 2. 在事务内执行:取消订单、回库存、释优惠券、发通知

TransactionStatus tx = transactionManager.getTransaction(new DefaultTransactionDefinition());

try {

orderMapper.cancelOrder(order.getId(), LocalDateTime.now());

inventoryService.returnInventory(order.getProductId(), order.getQuantity());

if (order.getCouponId() != null) {

couponService.returnCoupon(order.getCouponId(), order.getUserId());

}

notificationService.sendCancelNotification(order.getUserId(), order.getOrderNo());

transactionManager.commit(tx);

} catch (Exception e) {

transactionManager.rollback(tx);

// 记录错误日志

}

}

// 3. 记录本次执行日志

saveExecutionLog(context, successCount, failCount, costTime);

}

}

实施效果:

- 处理效率提升80%:百万级订单可在10分钟内处理完毕。

- 系统稳定性99.99%:分布式部署,无单点故障。

- 资源利用合理:动态分片实现负载均衡。

八、高级特性与扩展

8.1 作业监听器

通过实现ElasticJobListener接口,可在任务执行前后插入自定义逻辑,如初始化资源、记录审计日志。

8.2 自定义分片策略

如果内置策略不满足需求,你可以实现JobShardingStrategy接口,根据IP、机器负载等自定义分片算法。

8.3 线程池配置

通过实现ExecutorServiceHandler接口,可以为作业定制专用的线程池,精确控制并发度。

8.4 自定义错误处理

实现JobErrorHandler接口,可以将作业异常信息接入公司的告警平台(如钉钉、企业微信),实现及时告警。

九、快速开始指南

9.1 基础环境

- 准备JDK 17+、Maven 3.8+。

- 启动Zookeeper单机或集群。

- 在你的Java项目中引入Spring Boot Starter依赖。

9.2 最小化配置

- 添加依赖:

<dependency>

<groupId>org.apache.shardingsphere.elasticjob</groupId>

<artifactId>elasticjob-lite-spring-boot-starter</artifactId>

<version>3.0.4</version>

</dependency>

- 配置文件(application.yml):

elasticjob:

regCenter:

serverLists: localhost:2181

namespace: elasticjob-demo

jobs:

mySimpleJob:

elasticJobClass: com.example.job.MySimpleJob

cron: 0 */5 * * * ?

shardingTotalCount: 3

- 实现一个简单作业:

@Component

public class MySimpleJob implements SimpleJob {

@Override

public void execute(ShardingContext context) {

System.out.println("执行分片:" + context.getShardingItem());

}

}

- 启动应用,任务便会自动注册并按分片定时执行。

十、总结

ElasticJob以其优雅的分布式系统设计、强大的分片机制和灵活的扩展能力,成为了解决分布式定时任务难题的利器。从简单的数据清理到高并发的电商业务场景,它都能提供稳定可靠的支撑。

通过本文从架构原理到实战案例的拆解,相信你已经掌握了ElasticJob的核心要领。技术的价值在于解决实际问题,下一步不妨在你的项目中找一个适合的场景尝试起来。如果你在实践过程中有任何心得或疑问,欢迎在云栈社区与更多开发者交流探讨。