在互联网的世界里,CDN(内容分发网络)常常被视为“隐形基建”,但用了它就一定更快吗?刷视频时秒加载,你可能会感谢CDN;换个地域就卡顿,你又可能怀疑节点有问题。今天,我们就来深入探讨CDN如何让内容“飞”起来,又在什么情况下可能拖慢响应速度。

CDN的飞驰人生:如何破解远距离访问难题?

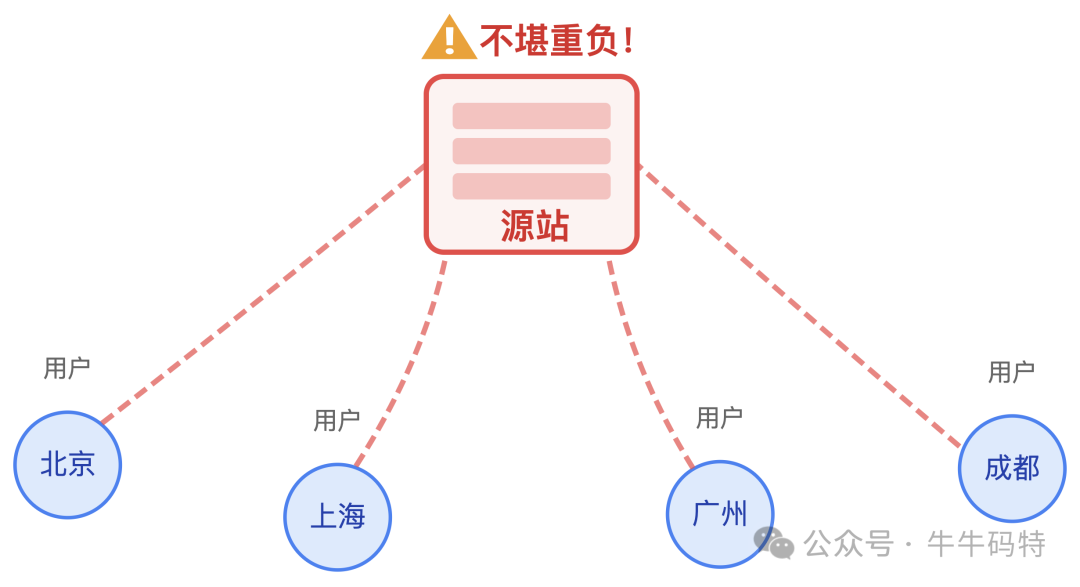

CDN(内容分发网络)的诞生,本质是为了解决一个朴素的问题:当全国的用户都挤到同一台服务器抢内容时,不仅远距离的用户会卡成PPT,服务器本身也会不堪重负。

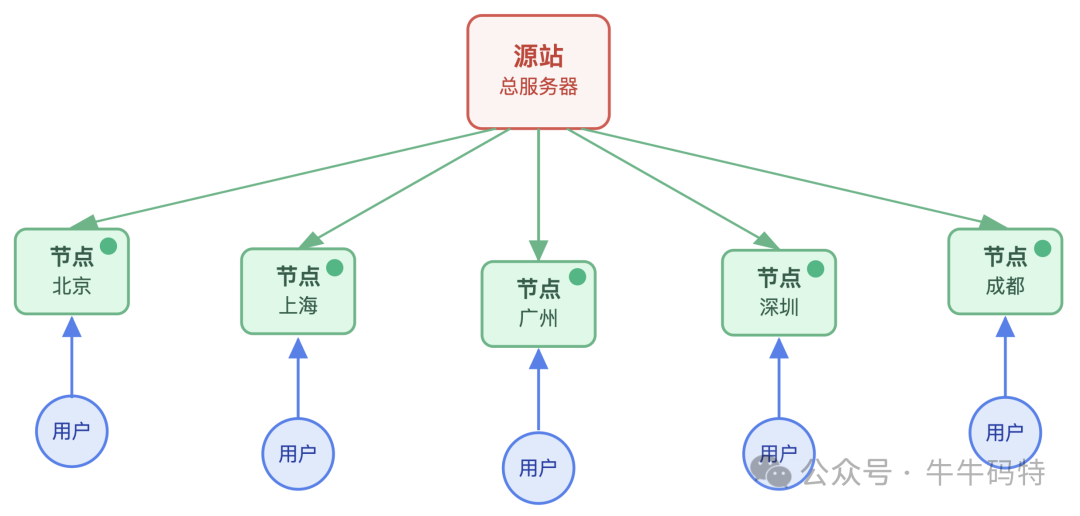

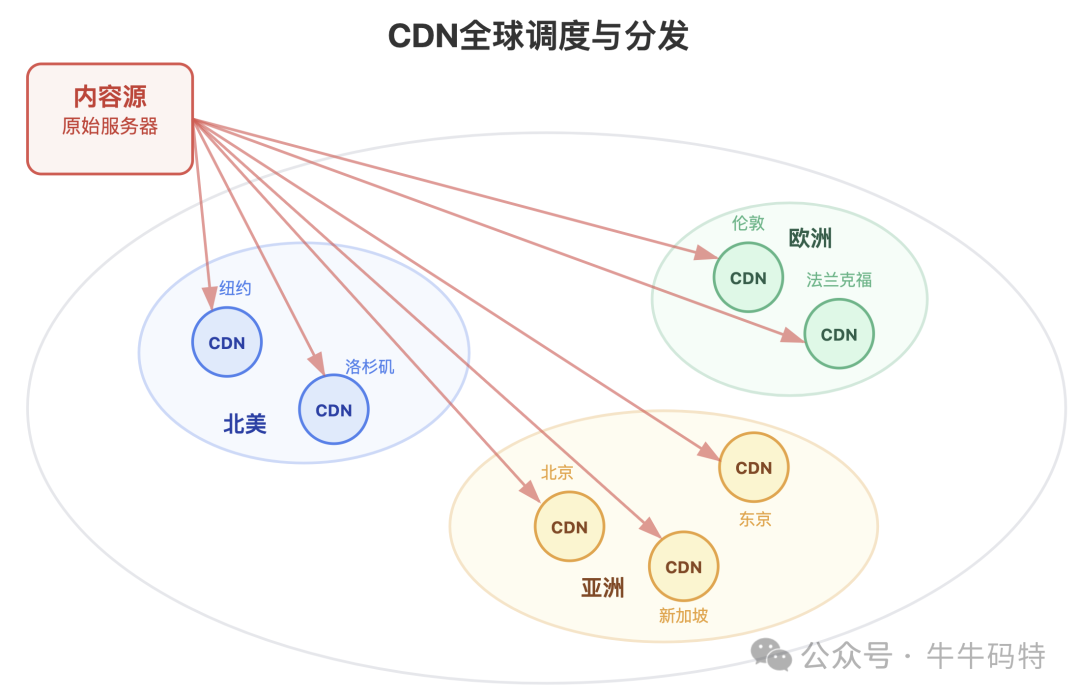

那么CDN是怎么破解这个问题的?简单来说就是:构建一张遍布全国的边缘节点网络,把内容搬家到离用户更近的地方,减少数据长途传输的时间。

比如你刷短视频的时候,视频其实不是从千里之外的总服务器(也就是源站)传给你的。而是CDN提前把这个视频复制到全国多个节点——这些节点就像散布在你小区门口的便利店,能让你就近“提货”。

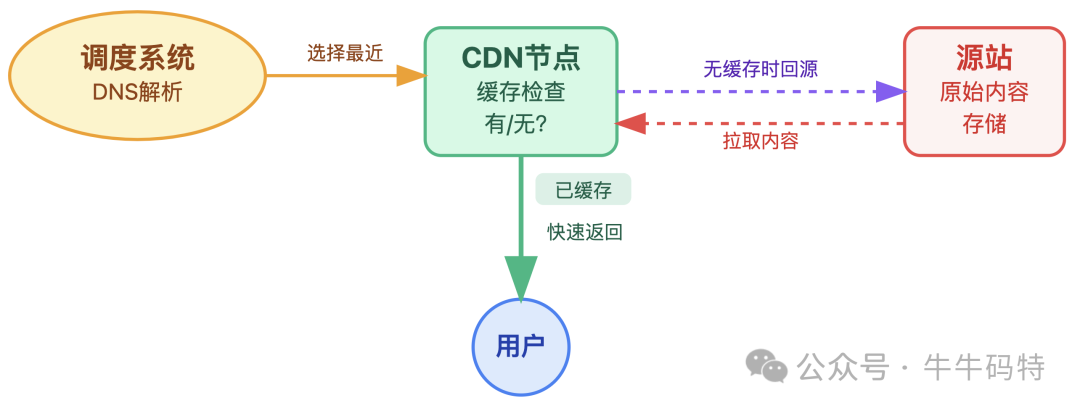

当你点开视频的瞬间,CDN会经历三步清晰且高效的工作流程:

- 智能调度:CDN会通过调度系统自动找离你最近的节点——比如你在广州,就从广州的节点拿视频。

- 缓存读取:要是节点里刚好有你要的视频,那就直接传输给你,速度自然快;

- 回源拉取:要是没有,节点会先去源站把视频拉取过来,一边缓存一边传输给你——这也是第一次加载会稍慢的原因。不过之后再有用户刷这个视频,就能直接从节点里拿了。

这一套就近存、就近取的逻辑,既让用户减少了等待的时间,又帮源站卸下了“同时服务千万用户”的压力。不过,当我们说CDN让内容变快了时,这个“快”其实藏着更细致的门道:它到底是缩短了哪段路?又是怎么把重复劳动变成一次搞定的?接下来,我们就来揭开CDN让内容“快”起来的秘诀。

CDN的“快”,到底是什么快?

看似简单的内容加速,其实要解决三个关键问题:“怎么最快到用户身边?怎么避免频繁回源?怎么不让节点累趴下?”——这背后恰好对应CDN的三大加速策略。

1. 就近访问:距离决定速度

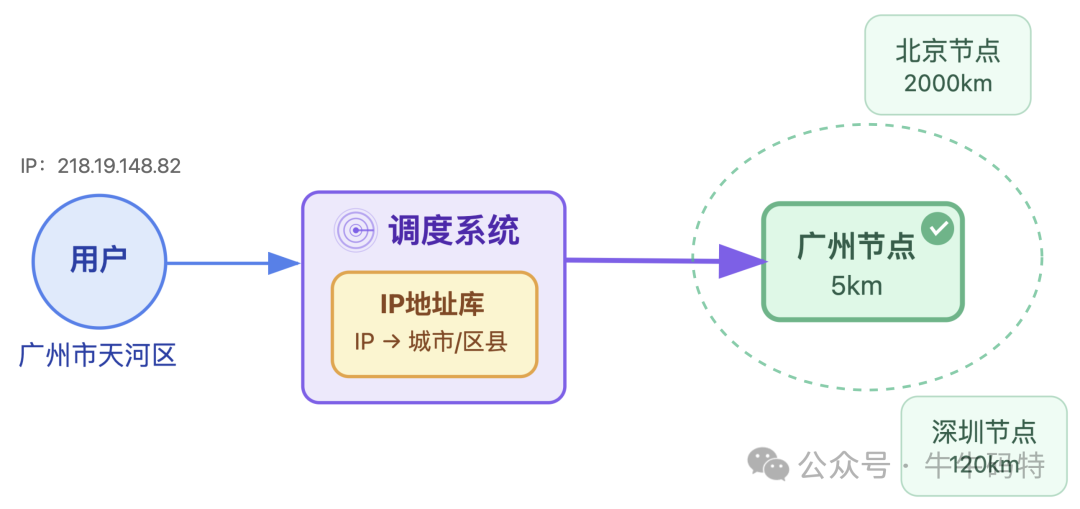

网络世界里,物理距离是速度的硬门槛。数据从北京传到广州,要跨越大半个中国,连跳十几台路由器,延迟至少50ms;但如果广州有节点,数据从节点到你家,可能只需要10ms。

而要打破这个距离限制,靠的就是CDN。为什么CDN能做到精准送上门?核心就在于它的智能调度技术:它会建立一个庞大的IP地址库,通过解析用户的IP,精准定位到其所在的城市甚至区县。

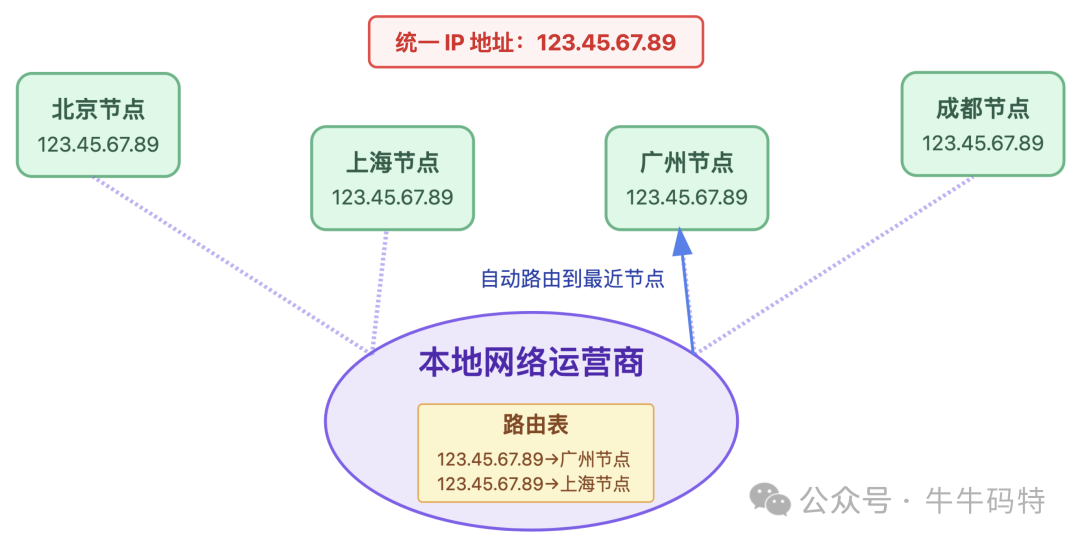

除此之外,有些高端CDN还搭配任播(Anycast)技术来实现更精准的就近接入:给所有节点分配同一个IP地址,并把这个IP地址同步给节点所在的本地网络运营商。运营商收到后,会将这个IP存储至路由表,相当于向全网喊话:“谁要访问这个IP,找我辖区内的节点最快!”

这样一来,后续用户发出的请求,自然会被运营商“导流”到距离用户最近的节点,实现真正的就近访问。

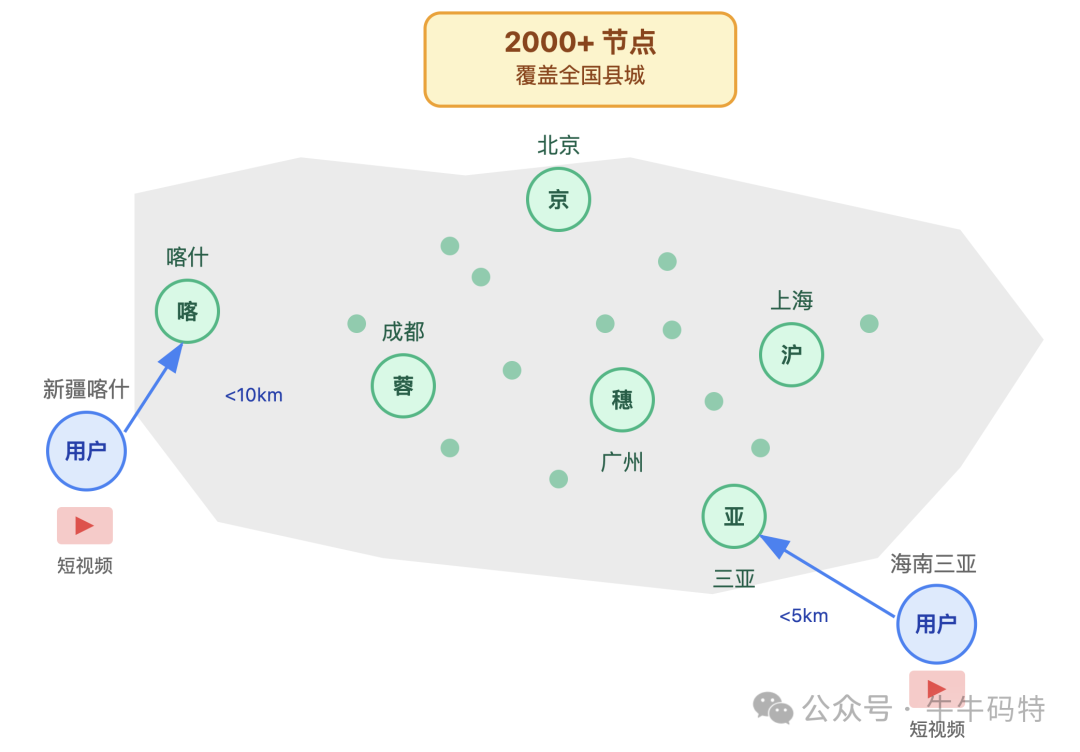

比如某短视频平台,在全国部署了超过2000个CDN节点,连县城都有覆盖。用户不管在新疆喀什还是海南三亚,都能找到距离不到100公里的节点。这种“把内容铺到用户脚边”的能力,直接把数据传输的延迟降到了10ms以内。

不过光靠“近”还不够,要是节点里没有用户需要的那份内容,用户还是得千里迢迢跑回源站取内容,这时就需要CDN的第二个加速秘诀——缓存复用。

2. 缓存复用:拒绝重复“跑长途”

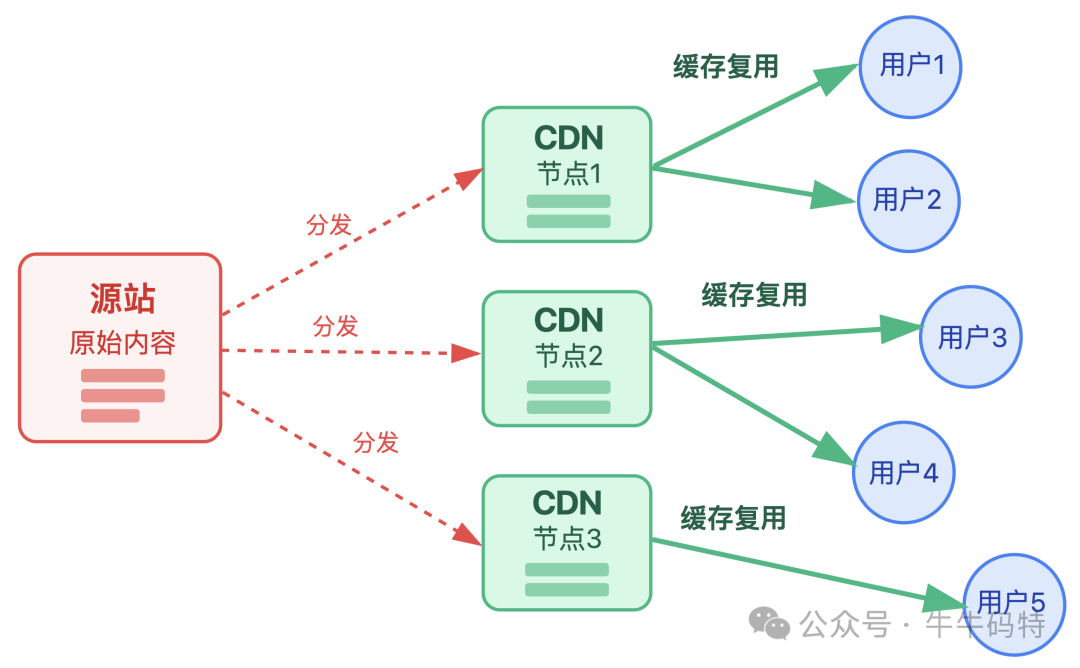

当1000个用户同时刷同一个视频时,CDN会想尽办法让大部分请求直接从就近的节点“提货”,只留小部分未命中的请求需要回源。这背后靠的正是缓存复用:让一份内容服务多个用户,避免大家一窝蜂挤到源站抢内容。

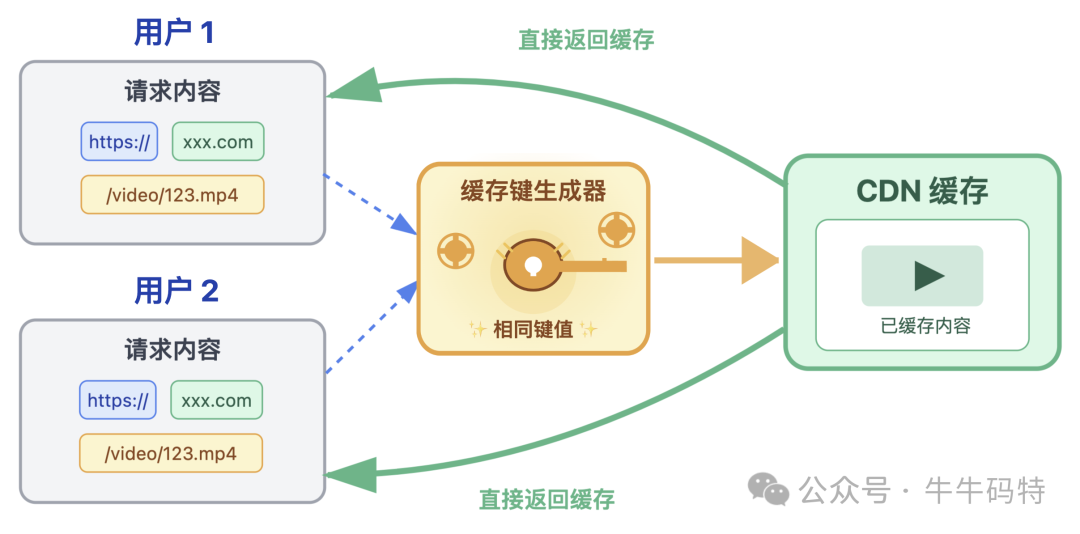

要实现缓存复用,首先要解决内容唯一性识别的问题:CDN的做法是为每个内容生成专属缓存键——通常由请求的URL、协议、HTTP头参数组合而成,比如 https://xxx/video123.mp4 。当用户发起请求时,只要请求的缓存键和节点中已缓存的键值完全一致,CDN就会直接返回缓存内容。

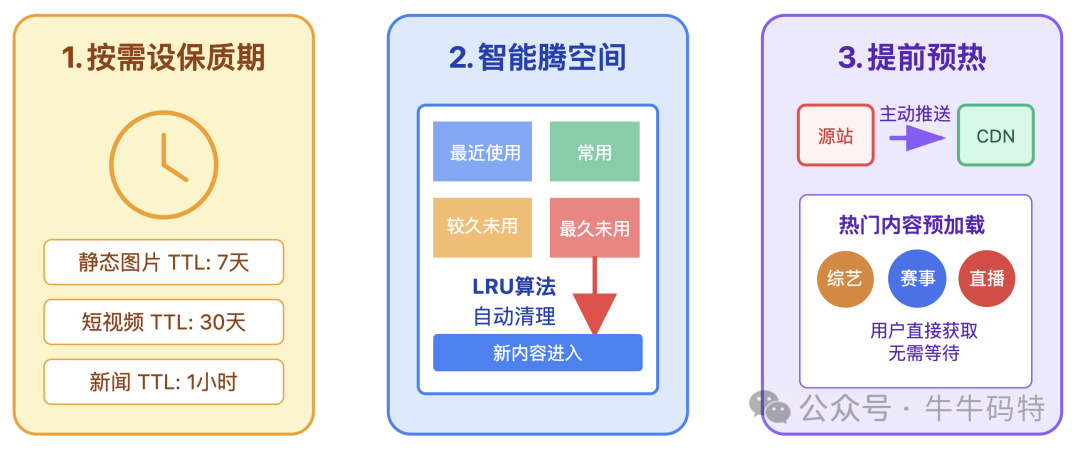

为了提升缓存效率,CDN还会搭配一套精准灵活的缓存策略,核心包含三个操作:

- 按需设保质期:节点会给不同内容设置不同的TTL(生存时间),以此保证内容新鲜度——比如静态图片设7天、短视频设30天、新闻资讯设1小时,在保质期内,节点不会再去源站取内容;

- 智能腾空间:当节点缓存满了,CDN会用LRU算法自动清理“最久没人碰”的内容,给新内容腾出存储空间;

- 提前预热:对预判会爆火的内容,比如综艺首播、赛事直播,源站会提前把内容主动推送到全国节点,用户点开时直接从节点获取,连第一次回源的时间都省了。

正是靠着这套“一次存储、多次分发”的高效玩法,CDN 实现了内容分发的最优解——用最低的带宽消耗,撬动了最高效的内容传输。

但这还不足以应对所有场景:如果遇上热门内容突然爆发,比如一场爆款直播瞬间涌入百万观众,单个节点就算把缓存塞满,也扛不住万级并发的冲击。这时候,就得靠第三个调峰神器:负载均衡。

3. 负载均衡:不让热门节点“累趴下”

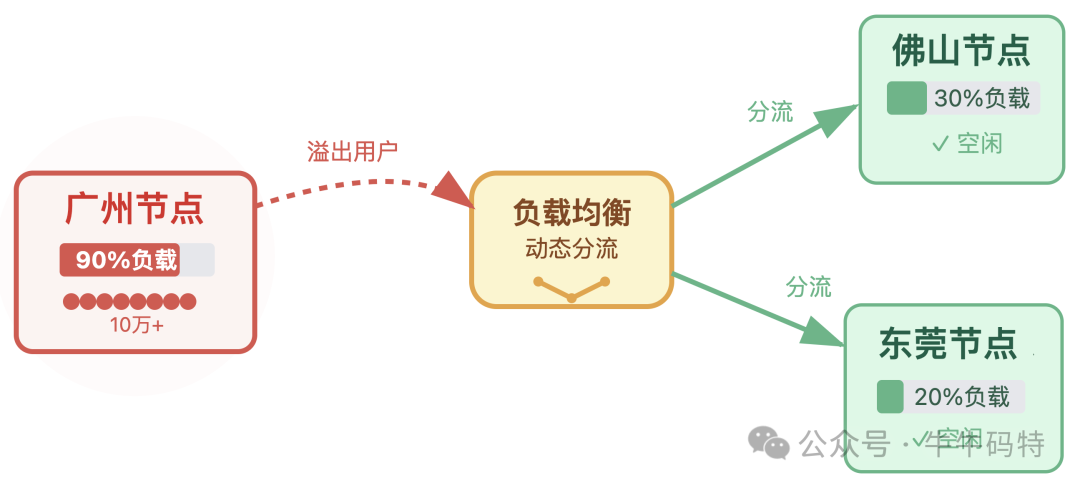

负载均衡就像CDN的交通指挥中心,专门解决节点“忙闲不均”的问题。它就像实时路况监测仪一样,盯着每个节点的核心状态:CPU是不是跑满了?带宽有没有被占满?同时连接的用户是不是太多了?

一旦发现某个节点被堵得水泄不通,比如广州节点突然涌进10万用户,负载直接飙到90%,它会立刻启动动态分流:把这部分溢出的用户,精准导到邻近的佛山、东莞等空闲节点。

除此以外,高端CDN还会根据内容类型做更精细的调度:把大流量的视频请求分配给带宽充足的节点;把高运算需求的图片处理请求分配给CPU性能更强的节点;让每个节点“扬长避短”,效率拉满。

正是靠着这套「就近 + 复用 + 分流」的三重加速逻辑,CDN在互联网站稳了流量分发的绝对主力地位:如今超过80%的全球互联网流量都要经过CDN的调度与分发。 你刷的抖音、追的B站、逛的淘宝,甚至下载的软件安装包,背后都有CDN加速的身影。

那么问题来了:看似万能的CDN,有没有也搞不定、跑不动的场景?答案是肯定的,一旦跳出它擅长的「静态内容、高频复用」领域,它的加速优势就会瞬间失灵,甚至成为拉低速度的“拖油瓶”。

CDN也有“跑不动”的场景

那到底哪些场景是CDN的不擅长领域?别着急,我们从内容本身的冲突和CDN自身的硬件短板两个维度来展开。

先从内容本身说起,有些内容从基因里就吃不到CDN的“缓存红利”。这类内容主要有三类:

1. 实时动态内容:缓存成了“摆设”

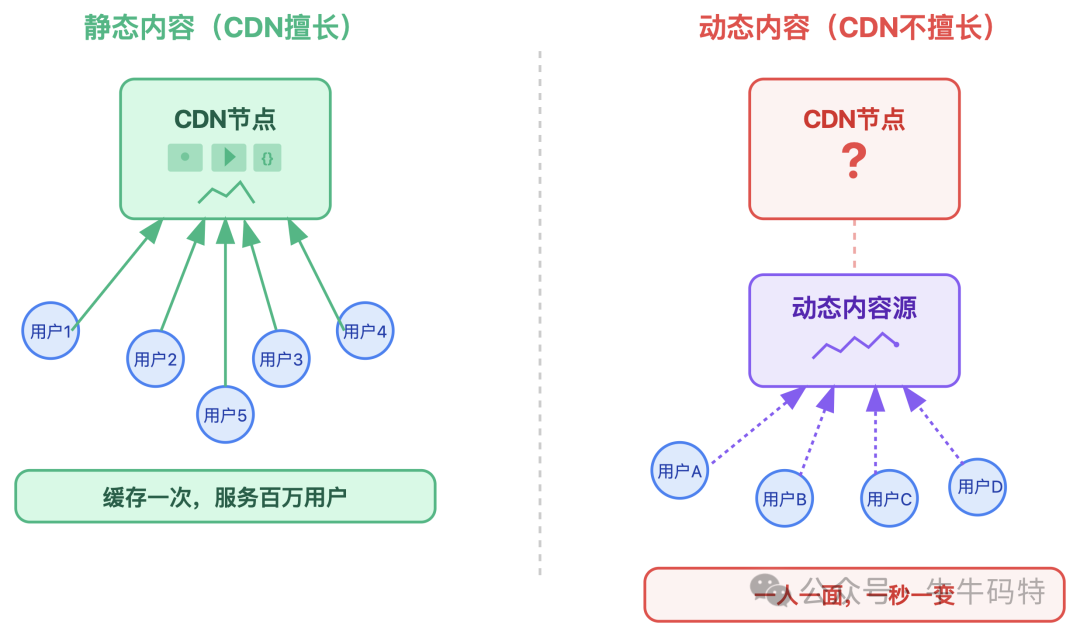

CDN最擅长存“不变的东西”——比如静态图片、预录视频、固定的网页样式,这些内容存一次就能服务上百万人。但对于实时变化的动态内容,比如股票实时行情、电商秒级库存、用户的个性化推荐页,CDN的静态缓存优势就难以发挥。

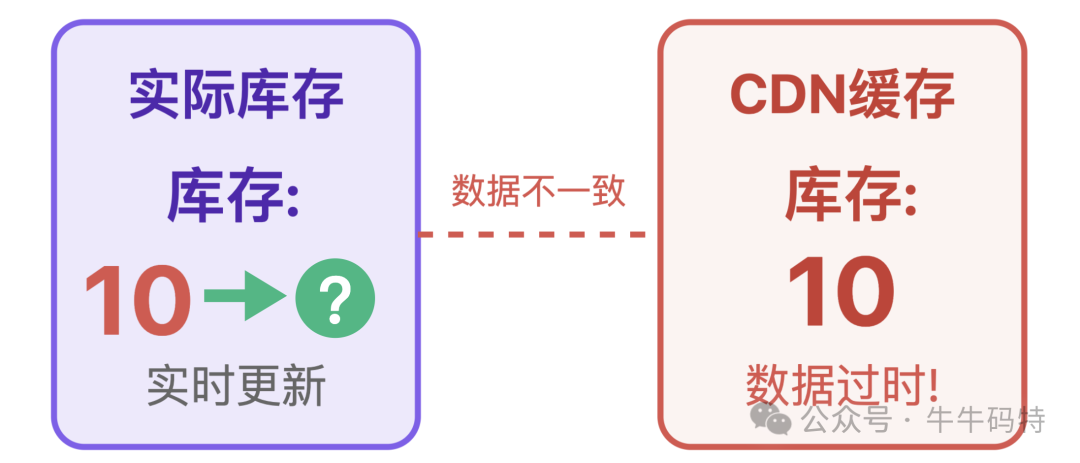

以电商平台的商品库存为例,库存是每秒更新的,你刚看时显示有10件,下一秒可能就被买走2件。如果把这个页面缓存到CDN节点,麻烦就来了:节点里存的永远是过时的数据——要么显示有货实际库存没货,导致超卖;要么显示没货实际库存有货,白白流失用户。

这类动态内容的特点是“一人一面、一秒一变”,CDN的缓存机制根本派不上用场,反而增加一层节点转发。

除了动态内容,还有一类内容虽然本身是静态的,但因为涉及严格的权限管控,也和CDN的“无差别缓存”天生矛盾。

2. 敏感内容:缓存可能变成“安全漏洞”

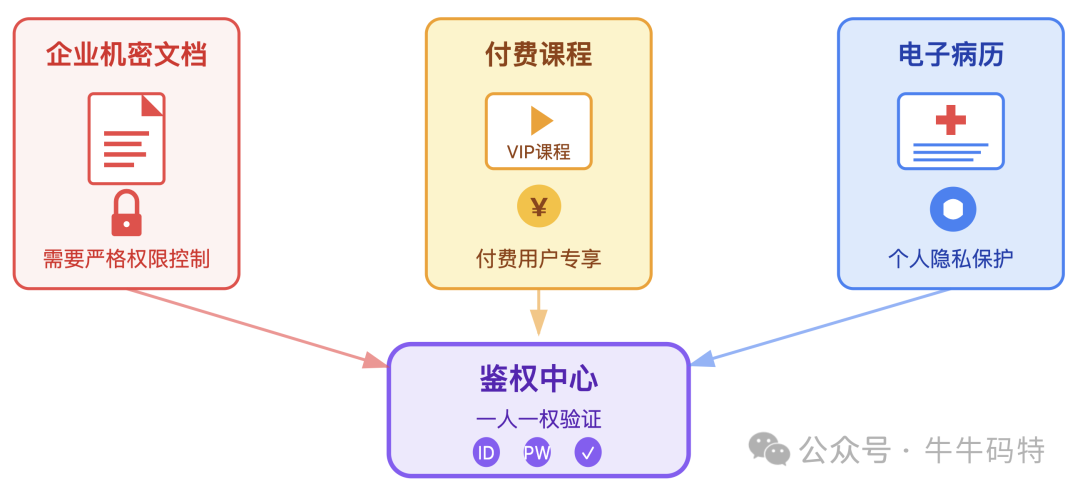

有些内容即使是静态的,也不能随便放进CDN——比如企业内部的机密文档、在线教育的付费课程、医疗平台的电子病历。这些内容需要“一人一权”的严格鉴权。

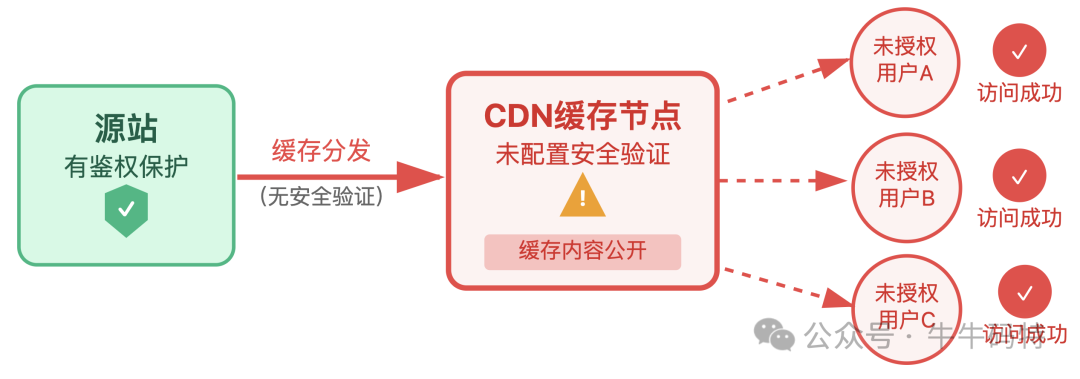

如果简单地将这类内容放入CDN,而未配置相应的安全验证机制,CDN的缓存复用逻辑就会打破权限隔离:任何获取到CDN链接的人都能绕过源站鉴权,直接访问缓存内容。

原本私密敏感的内容变成了“公开资源”,极易引发数据泄露、权限滥用等严重安全问题。

而安全风险之外,还有一类内容的存在本身就很尴尬:访问量太低,对它们进行缓存,无异于一笔“赔本的买卖”。

3. 低频冷内容:缓存成了“鸡肋”

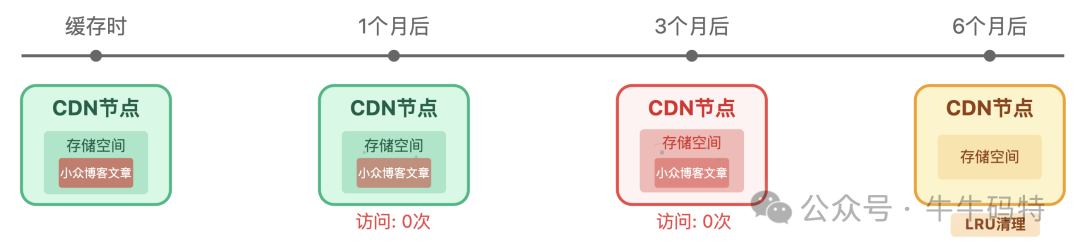

CDN的核心优势之一就是靠缓存复用来降低传输成本。但如果是一年都没几个人看的冷内容,缓存它们就得不偿失了。这些内容缓存到节点后,不仅占用节点存储空间,还可能因为长期不更新变成“死数据”。等到用户访问时,缓存的内容可能早被LRU(最近最少使用)算法清理了,大概率还是要回源站拿,多了一层链路延迟,反而拖累访问效率。

总之,CDN遇到上面这三类内容无异于“有劲使不出”。它们共同界定了CDN的能力边界。

除了内容本身让CDN“水土不服”外,CDN的硬件或配置没跟上,同样会让加速效果大打折扣。这些硬件和配置上的短板,通常体现在三个方面:

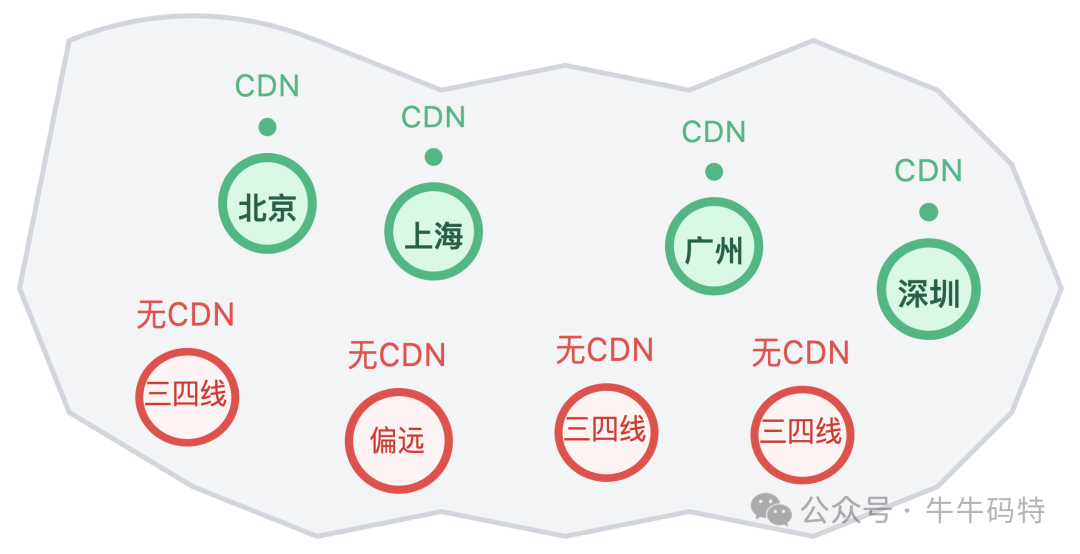

- CDN节点覆盖不足:如果你的用户大多在三四线城市或偏远地区,而CDN服务商只在一二线城市部署节点,那“就近”就成了空话。

- 回源率过高:要是缓存策略没调好,比如TTL设得太短,或者缓存规则未覆盖所有静态内容,CDN就会变成源站的“催命符”——大量请求回源,把源站的带宽和CPU占满,最终导致源站卡顿甚至宕机。

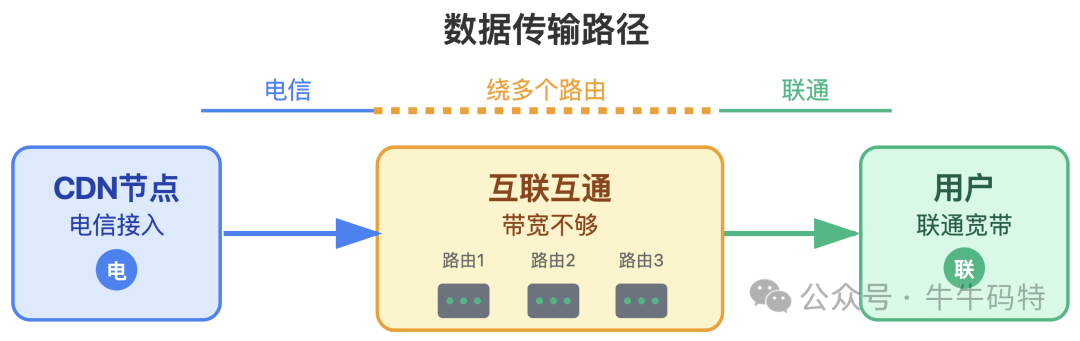

- 最后一公里瓶颈:也就是节点到用户的这段路“堵了”,比如CDN节点是通过电信接入的,可用户用的宽带是联通的。要是两者互联互通的带宽不够,数据传输就要绕好几个路由器,延迟自然大幅增加。

对用户来说,这些硬件或配置短板会直接转化为体验痛点,CDN不仅没起到加速作用,反而成了卡顿延迟的罪魁祸首。

CDN不是万能加速器

回过头看,CDN作为互联网的“隐形基建”,真正的价值从来不是让所有内容都变快,而是在合适的场景里,做最高效的事:它像遍布城市的便利店,只把最高频、最常用的刚需品(静态/公共/热门内容)提前备货,让你随取随用;而那些冷门小众、需要定制的商品(动态/敏感/低频内容),本就不该放进来。

今天的互联网能流畅承载起亿万用户的并发访问,正是因为有无数这样的“隐形基建”在精准适配:CDN解决静态内容的效率问题,边缘计算解决动态内容的实时问题……它们不追求“全能”,只在各自的赛道里,以极致的效率支撑起海量内容的流转。