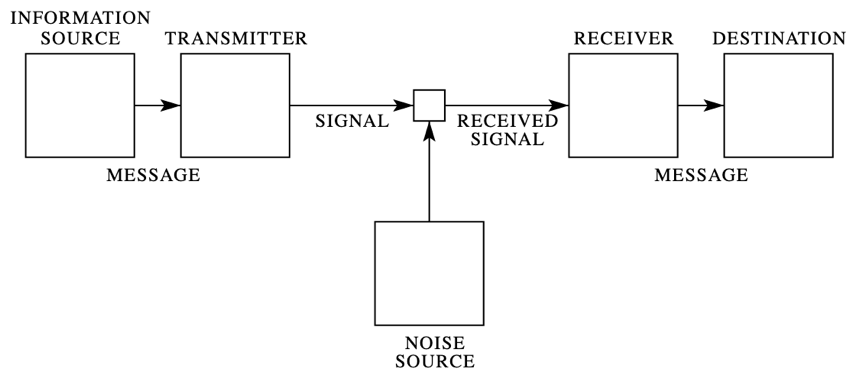

图:一般通信系统原理图。

在本系列的第二篇《信号处理篇》中,我们引入了一些信息论的概念和方法来理解语义嵌入/向量化。本篇将完全从信息论的视角出发,深入解读原论文,探讨大模型背后的第一性原理。

1948 年,香农(Shannon)发表了题为《A Mathematical Theory of Communication》的划时代论文,奠定了现代数字通信的理论基础。论文的主要目标是用数学方法解决有噪声的数字通信系统的可靠传输问题。以此为起点,建立了一套完备的数学框架与理论体系,这便是后来众所周知的信息论。1949 年,韦弗(Weaver)与香农合著了一篇论文,文中明确将通信问题分为三个层级:

- Level-A(技术问题): 通信符号能在多大程度上被准确地传输?

- Level-B(语义问题): 传输的符号能在多大程度上精确传达了预期的含义?

- Level-C(效用问题): 接收到的含义能在多大程度上有效地影响行为,使其符合预期?

香农曾表示,他的理论仅仅解决了可靠通信问题,即 Level-A(技术问题)。这是因为在香农的理论中,信息和不确定性是等价的,并不关注消息的含义或内容。

受到香农方法论的启发,本文尝试从推理的视角出发探讨大模型的可解释理论。我们发现,只要将香农的理论从以 BIT 为中心转换为以 TOKEN 为中心,便可以从信息论的视角完全解释大模型的底层原理,该理论在原论文中被称为语义信息论。

香农信息论的核心与方法论启示

本节先归纳一下香农的主要结论和方法论启示。上图是一般通信系统的原理图。

信息论的三个主要结论

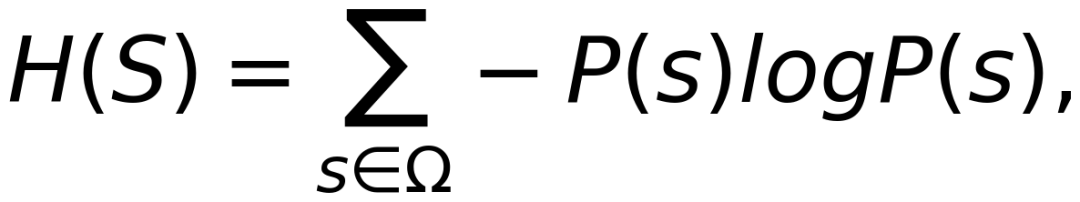

在通信系统中,信源是产生信息的源头。信源编码器将每一个信源符号映射为一个长度为 m 的二进制码字,从而实现对原始信息的压缩。如果信源的输出是一个随机变量 S 的独立采样,香农证明这类信源所产生的信息量就是 S 的熵(Entropy)。用 P(S) 表示 S 的概率分布,那么 S 的熵定义为:

其中 Ω 为随机变量 S 的样本空间。熵是信源无损压缩的可达下界。这个结论就是著名的信源编码定理。

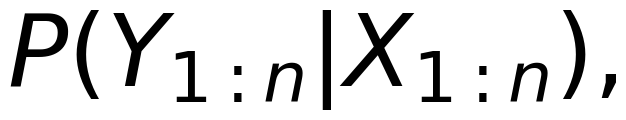

由于信道会受到噪声的影响,如果直接传输信源符号,接收的符号就会出现错误。如何实现可靠的数字通信,是当时任何工程方案都无法解决的世界难题。香农首先创造性地用转移概率来建模通信信道,即

其中 $X_{1:n}$ 是信道的输入序列,$Y_{1:n}$ 是信道的输出序列。他进一步引入信道编码以对抗噪声,同时接收机采用最大似然译码来恢复发送的符号,从而在给定速率的前提下最小化差错概率 $P_e$。

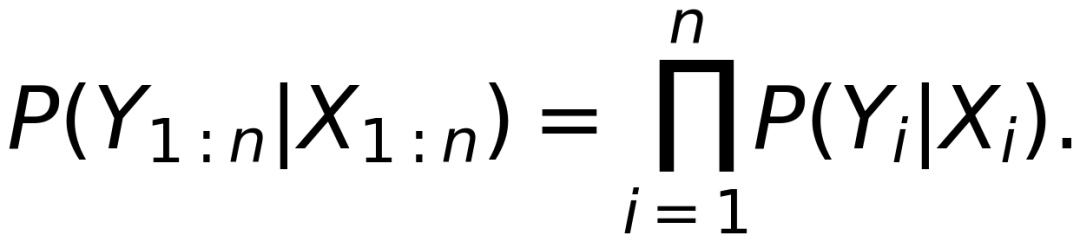

离散无记忆信道(DMC)是一类应用广泛的信道模型。一般认为,它的转移概率满足以下关系:

香农证明了对于 DMC,通信速率 R 的可达上界是下式给出的信道容量:

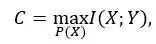

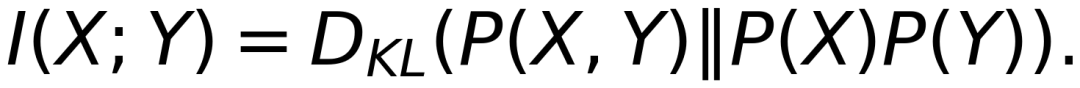

其中 P(X) 是 X 的概率分布,I (X;Y) 是互信息(Mutual Information),定义为:

如果 R < C,那么一定存在一种信道编码使得码长 $n \to \infty$ 时通信系统的差错概率 $P_e \to 0$。这个结论就是著名的噪声信道编码定理。可以看到,信道容量 C 是互信息 I (X;Y) 在优化 P (X) 时可以达到的最大值。

香农的第三个伟大贡献在于证明了信源-信道分离定理,即把一个通信系统分解成信源编解码和信道编解码两个主要组成部分在理论上是最优的。

方法论启示:以数学补物理

香农是用数学理论解决工程技术难题(即以数学补物理)的典范。他最值得称道的方法论是在解决可靠通信问题时,没有陷入具体实现方案的比较,而是回归到一个基本的思想实验:如果一个可靠通信系统真的被造出来了,它应该具备什么功能、应该满足何种数学性质?这是一种自顶向下的方法论。

针对信道编解码部分,香农在论文中回答了以下三个关键问题:

- 在数字通信中,可靠的数学定义是什么?

- 香农的答案是渐进无差错的信息传输,他将概率论和统计学引入了通信领域。

- 可靠通信的数学模型是什么?

- 香农的答案是用转移概率来建模信道。这种概率模型与具体实现无关,具有极大的普适性。在数学上,这类方法被称为概率方法。

- 衡量通信系统的性能指标是什么?

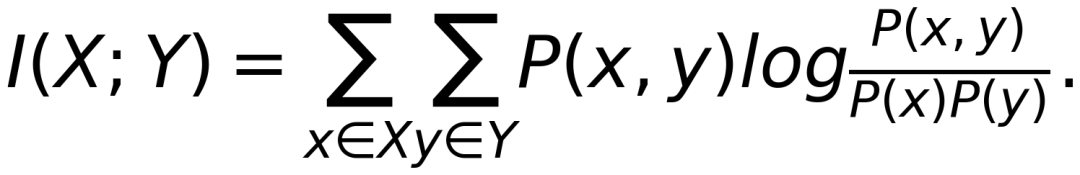

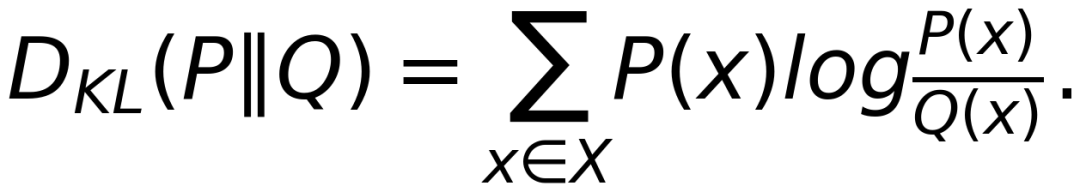

- 香农的答案是可靠通信速率用互信息和信道容量来衡量。互信息本质上是用更基础的 Kullback-Leibler(KL)散度衡量 P (X,Y) 和 P (X) P (Y) 之间的差异,从而刻画 X 和 Y 之间的统计相关性。

KL 散度是信息论中的一个基本概念,其定义为

这样互信息可表示为

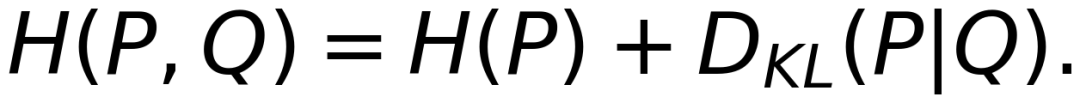

机器学习领域常用的交叉熵损失函数可表示为

如果 H (P) 给定,那么交叉熵和 KL 散度是等价的。

大模型的信息论抽象:三个基本问题

信息论从运行时的视角出发来研究通信系统,对研究大模型的第一性原理极具启发性。因为我们期望给大模型建立与具体实现无关的数学模型和理论。

类似香农解决可靠通信问题的思路,我们也可以对大模型提出以下三个基本问题:

- 对大模型而言,语义意味着什么?

- 大模型与具体实现方式无关的数学模型是什么?

- 衡量大模型性能的指标是什么?

第一个问题在本系列的第二篇中已经回答。本篇后续部分将着重回答第二和第三个问题。

面向大模型的信息论测度

为方便讨论,本节将首先介绍面向大模型的信息论测度,包括速率-失真函数、定向信息和定向信息密度。

1、速率-失真函数

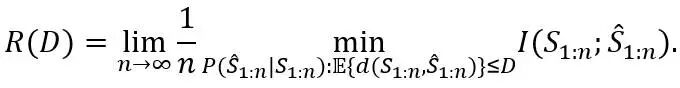

在实际场景中,有损压缩有非常广泛的应用。香农提出用速率-失真函数来刻画有损压缩的端到端性能。具体来说,要确定一个最小速率 R bit/symbol,使得信源符号可以在解压缩时被近似重构,且预期失真度不超过 D。定义衡量失真度的非负函数 $d(S_{1:n}, \hat{S}_{1:n})$,那么速率-失真函数定义为:

根据香农的方法论,该定义将有损压缩和解压缩的过程抽象成转移概率 $P(\hat{S}_{1:n} | S_{1:n})$。上述定义就是在满足预期失真度约束的前提下,寻找最优的转移概率,使得恢复后的序列与信源序列之间的统计相关性最小。

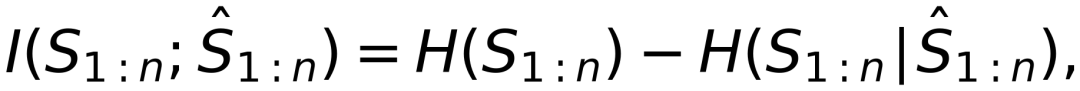

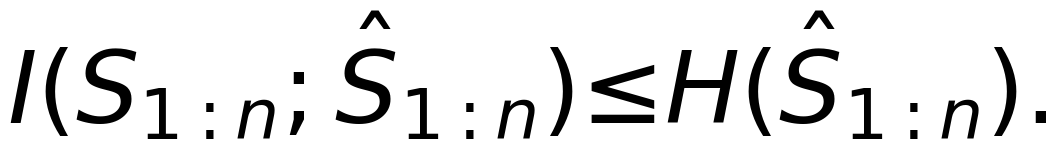

值得注意的是,速率-失真函数的核心是互信息 $I(S_{1:n}; \hat{S}_{1:n})$ 而不是 $H(\hat{S}_{1:n})$。根据信息论恒等式

其中 $H(S_{1:n} | \hat{S}_{1:n})$ 表示已知 $\hat{S}_{1:n}$ 时 $S_{1:n}$ 剩余的不确定性,它与恢复满足失真度约束的 $\hat{S}_{1:n}$ 无关。因此,我们只需要知道 $S_{1:n}$ 中和 $\hat{S}_{1:n}$ 统计相关的部分就足够了。另一方面,有

由于压缩的损失与信道噪声的影响很相似,所以面向有损压缩的速率-失真函数理论与信道编码的逻辑很相似。

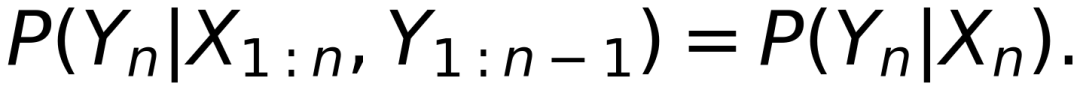

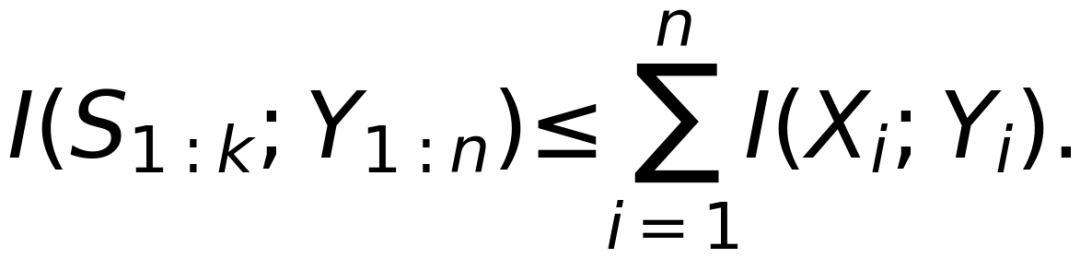

定向信息是由著名信息论专家詹姆斯·梅西(James Massey)提出。他在1990年的论文中指出:传统信息论专著中关于 DMC 的定义是有问题的,因为该定义天然不能包含反馈。

梅西认为离散无记忆信道(Massey-DMC)的转移概率应该满足:

上式表明,信道的输出 $Y_n$ 与信道的输入 $X_{1:n}$ 和时刻 n 之前的信道输出 $Y_{1:n-1}$ 并无关系。梅西进一步指出,如果离散信道是无反馈(Massey-DNFC)的,那么信道转移概率应该满足:

梅西证明:只有信道转移概率 $P(Y_{1:n} | X_{1:n})$ 同时满足以上两个条件,才能得到教科书中的经典 DMC 定义。

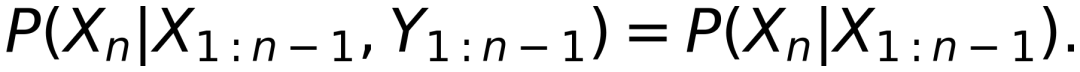

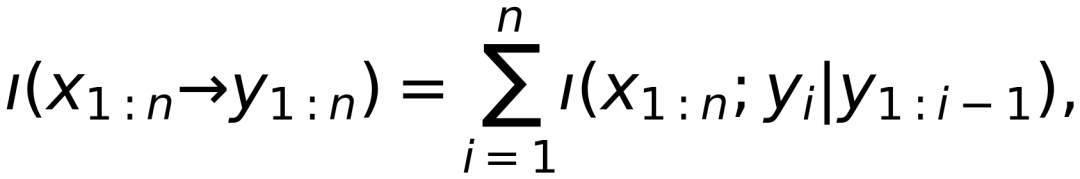

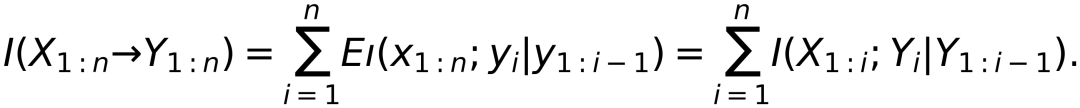

从信道容量的讨论可以看出,互信息 I (X;Y) 描述了经典 DMC 的输入序列和输出序列之间的统计相关性,但却无法适用于 Massey-DMC 信道。梅西提出用定向信息来描述 Massey-DMC 的端到端统计相关性。具体来说,从输入序列 $X_{1:n}$ 到输出序列 $Y_{1:n}$ 的定向信息定义为:

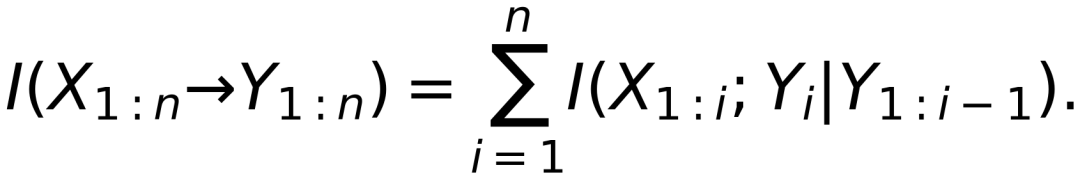

梅西证明了定向信息有以下基本性质:

- 定理1: $I(X_{1:n} \to Y_{1:n}) \le I(X_{1:n}; Y_{1:n})$,当且仅当该信道是 Massey-DNFC(无反馈)时等号成立。

- 定理2: $I(X_{1:n} \to Y_{1:n}) \le \sum_{i=1}^{n} I(X_i; Y_i)$,当且仅当 $Y_{1:n}$ 是独立同分布的序列时等号成立。

梅西在论文中也详细探讨了通信系统中的因果问题。如果一个通信系统是因果的,则信道转移概率应满足: $P(Y_n | Y_{1:n-1}, X_{1:n}, S_{1:k}) = P(Y_n | Y_{1:n-1}, X_{1:n})$ 其中 $S_{1:k}$ 是信源的输出。紧接着,梅西给出了定向信息的第三个性质:

- 定理3: $I(S_{1:k}; Y_{1:n}) \le I(X_{1:n} \to Y_{1:n})$。

由定理 2 和定理 3 可以得到

从而,我们可以导出信息论中的一个著名的反直觉结论:反馈并不能增加信道容量。

以上讨论表明,定向信息能够突破互信息的局限性,描述更广泛信道的输入和输出之间的统计相关性。

3、定向信息密度

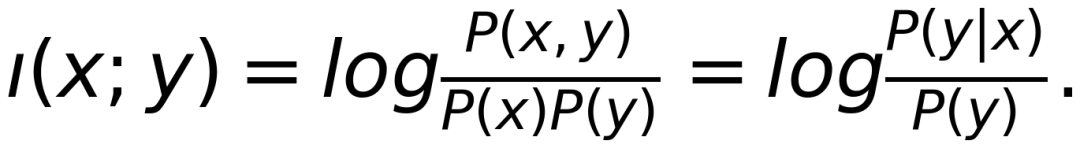

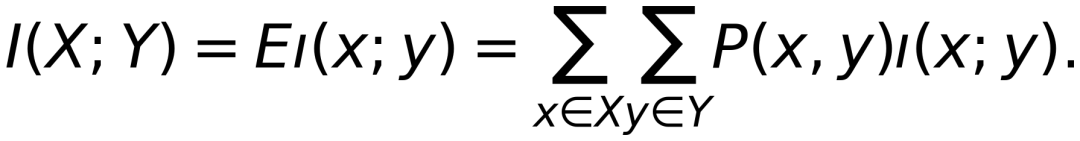

信息密度的概念最早由前苏联数学家多布鲁申(Dobrushin)提出。具体来说,信息密度 $\imath(x;y)$ 定义为:

信息密度是一个随机变量,它的数学期望是互信息:

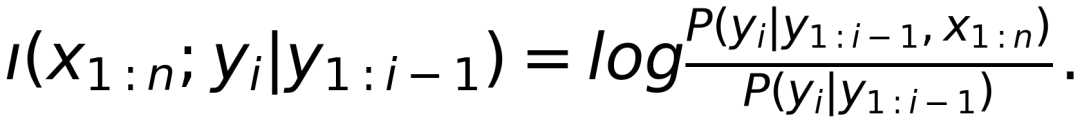

类似地,我们定义从 $x_{1:n}$ 到 $y_{1:n}$ 的定向信息密度如下:

其中

显然,定向信息密度也是一个随机变量,并且有

大模型是有状态、带反馈的信道

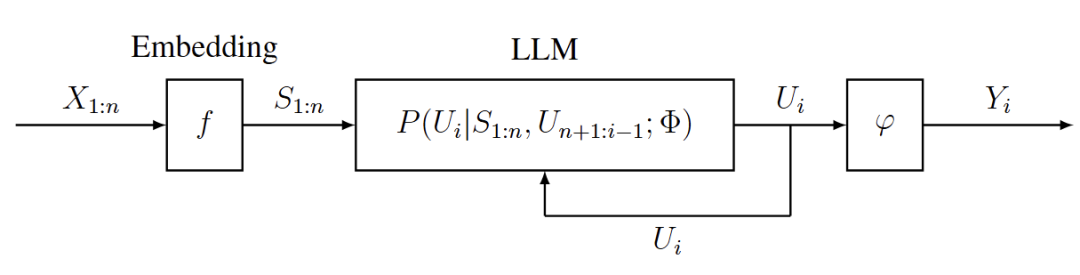

图:大模型是有状态、带反馈的信道

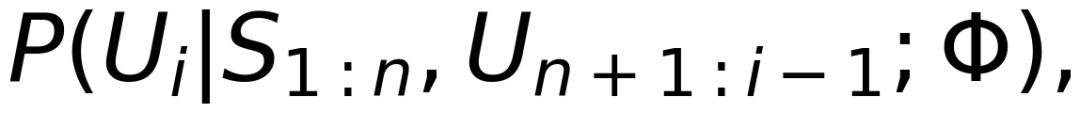

如图所示,考虑输入的 Token 序列为 $X_{1:n}$。通过语义编码模块 f 映射到语义向量序列 $S_{1:n}$。大模型基于输入 $S_{1:n}$ 和之前生成的 Token 序列的向量表示 $U_{n+1:i-1}$ 来生成下一个 Token 的向量表示 $U_i$。因此,大模型可以建模为一个有参数的转移概率:

其中 Φ 表示大模型的参数。φ 是语义解码模块,即 f 的逆映射,把 $U_i$ 映射为对应的 Token 输出 $Y_i$。从信息论的角度看,大模型本质上就是有状态、带反馈的信道。可以看到,这样的概率模型与具体实现无关,因而对其研究具有极大的普适意义。

通信问题与大模型问题的区别与联系在于:

- 通信问题:通信的目的是为了在接收端无差错地恢复发送的信息。在实际通信过程中,不能直接计算 $D_{KL}(P(X|Y) || P(X))$,因为接收机不可能事先知道发射机会发送什么信息。香农引入了互信息 $I(X;Y) = D_{KL}(P(X,Y) || P(X)P(Y))$ 以刻画 X,Y 的联合分布偏离统计独立的程度。如果用 AI 的语言,通信问题的损失函数就是基于 KL 散度定义的互信息。

- 大模型问题:大模型的目的是为了建模人类对特定输入 Token 序列 $X_{1:n}$ 产生的输出 Token 序列 $Y_{n+1:N}$。通过对数据进行标注,KL 散度可直接作用于 $Y_{n+1:N}$ 的概率分布和人类的标注分布,从而使大模型学会人类对特定输入序列产生的输出序列。在实际应用中,由于训练数据的熵是固定的,通常大模型使用与 KL 散度等价的交叉熵作为损失函数。

以上讨论也进一步印证了本文开篇提出的核心观点:只要将香农的理论从以 BIT 为中心转换为以 TOKEN 为中心,便可以从信息论的视角完全解释大模型的底层原理。

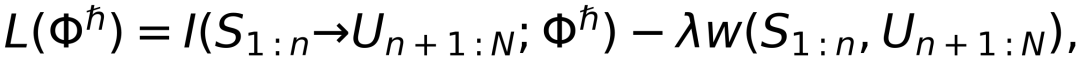

训练阶段的语义信息论原理

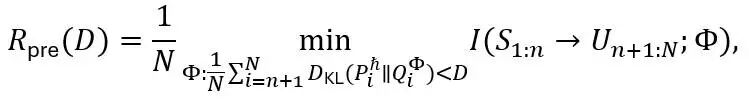

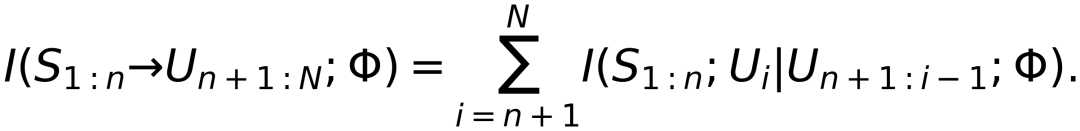

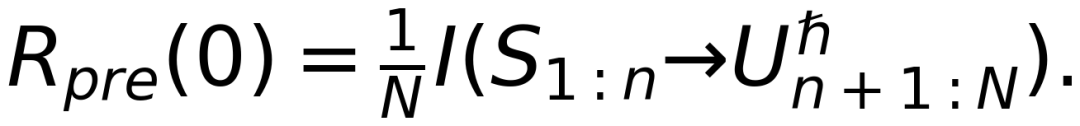

大模型本质上是一个有状态、带反馈的信道,从 $S_{1:n}$ 到 $U_{n+1:N}$ 的定向信息衡量了语义信息在大模型内的流动。令 $U^h_{n+1:N}$ 表示人类对输入 $S_{1:n}$ 的输出 Token 序列。大模型预训练阶段的定向速率-失真函数定义为

其中从 $S_{1:n}$ 到 $U_{n+1:N}$ 的定向信息可展开为

$R_{pre}(D)$ 定义了预训练阶段输入到输出的端到端性能指标,其特点如下:

- $R_{pre}(D)$ 描述了从输入序列 $S_{1:n}$ 生成输出序列 $U_{n+1:N}$ 所需的最小信息量,其中 $U_{n+1:N}$ 距离人类期望输出的失真不超过 D。

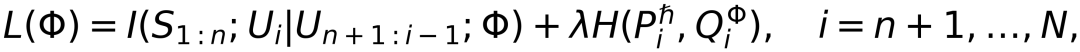

- $R_{pre}(D)$ 中最小化定向信息将过滤掉对产生输出序列无用的信息,从而有助于消除幻觉。因此,我们建议在大模型预训练中使用以下的损失函数:

其中 λ 是 Lagrange 乘子。

简单的数学推导还可以证明当训练理想收敛时:

因此,在理想收敛时,大模型在预训练阶段逼近 $I(S_{1:n} \to U^h_{n+1:N})$,即从 $S_{1:n}$ 到 $U^h_{n+1:N}$ 的定向信息将逼近人类水平。

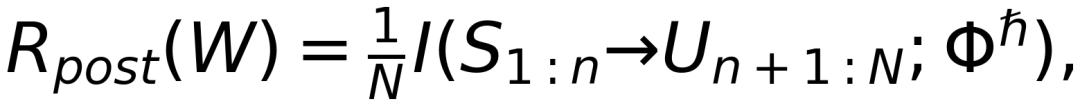

经过预训练的大模型,产生的输出序列不一定符合人类的偏好。因此,后训练通过强化学习或监督微调技术来牵引生成更符合人类偏好的序列。在基于强化学习的后训练方法中,要引入一个奖励函数 $w(S_{1:n}, U_{n+1:N})$ 给大模型的输出打分。类似于定向速率-失真函数,我们在后训练阶段定义奖励-失真函数:

其中后训练的最优解用 $\Phi^{h+}$ 表示。 $R_{post}(W)$ 定义了后训练阶段连接输入到输出的端到端性能指标。我们建议在大模型后训练中使用以下的损失函数:

其中 λ 是 Lagrange 乘子。事实上, $L(\Phi^h)$ 等价于 Direct Preference Optimization(DPO)算法中的损失函数。

推理阶段的语义信息论原理

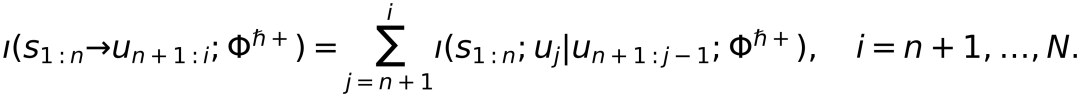

在推理阶段,基于参数 $\Phi^{h+}$ 和输入 Token 序列 $S_{1:n}$,大模型生成 Token 序列 $U_{n+1:N}$。不同于训练阶段关注平均性能,推理阶段则关注特定输入序列下的特定输出序列。令 $s_{1:n}$ 和 $u_{n+1:i}$ 分别表示 $S_{1:n}$ 和 $U_{n+1:i}$ 的样本向量,基于定向信息密度可定义从 $s_{1:n}$ 到 $u_{n+1:i}$ 的单次推理语义信息流:

推理阶段停止于预测到下一个 Token 是停止符号 $\triangle$。因此,输出 Token 序列的长度 N 是关于随机事件 $U_N = u(\triangle)$ 的停时。由此可以证明,语义信息流有以下性质:

- 性质1: $\ell(S_{1:n} \to U_{n+1:i}; \Phi^{h+})$ 是一个具有 Markov 性的下鞅。

- 性质2:根据 Doob 的鞅停时定理,我们有

$I(S_{1:n} \to U_{n+1:N}; \Phi^{h+}) \ge I(S_{1:n} \to U_{n+1}; \Phi^{h+})$

上式说明,当推理结束时,输入到输出的定向信息不小于只输出第一个 Token 的定向信息。

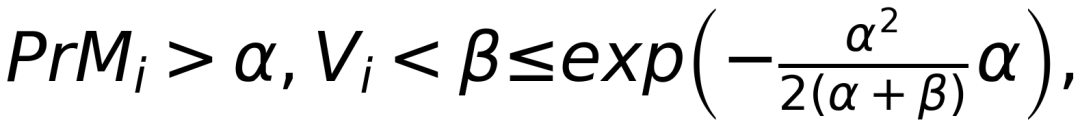

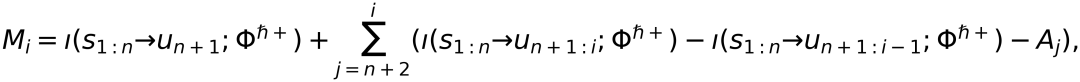

- 性质3:根据下鞅的 Freedman 不等式,对于 $\alpha, \beta > 0$,我们有

其中,$M_i$ 是鞅

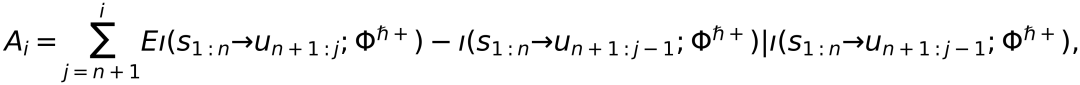

$A_i$ 是可预测的单调不减过程

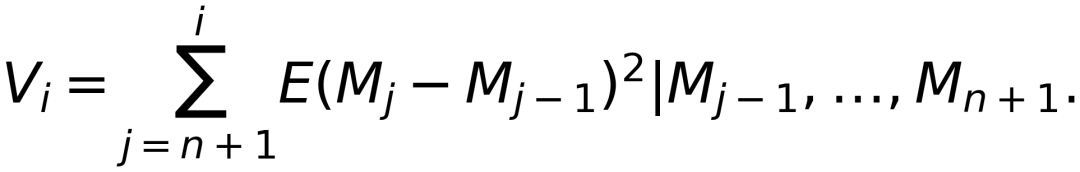

$V_i$ 是鞅差的条件方差,即

上述结论表明,虽然 Token 序列的概率分布非常复杂,但定向信息密度具有非常好的数学性质,可以通过许多现代数学工具加以研究。

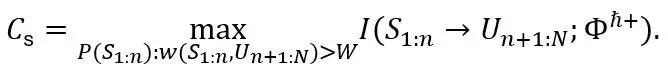

当前评估大模型推理性能的主要方式仍然是在大量测试集上评价推理结果所达到的分数。这种评测本质上是评估推理的平均效果。因此,借鉴香农定义信道容量的思想,可类似定义大模型推理的语义信息容量:

该定义说明,在推理阶段通过调整输入 Token 序列的概率分布 $P(S_{1:n})$,可最大化满足人类偏好的定向信息。这本质上就是通过上下文工程(过去称为提示词工程)提高大模型回答质量的信息论原理。

定向信息的计算和估计

在实际应用中,定向信息的计算和估计是很困难的。在数值算法方面,有研究者提出将经典的 Blahut-Arimoto(BA)算法推广到计算定向信息。这篇论文利用了输入分布的凹性和定向信息的因果结构,并结合动态规划原理,提出了面向定向信息的 BA 算法。

基于互信息的 Donsker-Varadhan 表示,互信息神经估计器(MINE)取得重要进展。受此启发,研究者进一步提出了基于 RNN 的定向信息神经估计器(DINE)。更进一步地,他们最近的工作则提出 Transformer 本身就可以用来估计传递熵(TREET),即有限长度版本的定向信息。TREET 将传递熵的估计问题转化为一个离散序列的自回归预测问题,利用 Transformer 的上下文学习能力来精确计算条件概率的对数似然差。从这个角度看,Transformer 和定向信息是天然结合在一起的。

Granger 因果与 Pearl 因果

在本系列的第一篇和第二篇中,我们都指出:大模型推理的本质,是通过预测下一个 Token 这一看似简单的训练目标,实现逼近人类水平的 Granger 因果推断。

Granger 因果是由诺贝尔经济学奖得主克莱夫·格兰杰提出的。令 $U_i$ 表示整个宇宙在时刻 i 的所有知识,$\bar{U}_i$ 则表示一个经过修改的宇宙在时刻 i 的所有知识,这里的“修改”指的是排除了 $X_{1:n}$ 这个时间序列。称 $X_i$ 引起了 $Y_{i+1}$,如果

$P(Y_{i+1} \in A | U_i) \neq P(Y_{i+1} \in A | \bar{U}_i)$

这个定义是非常普适的,但没有可操作性。为了用信息论测度来衡量两个时间序列的 Granger 因果性,物理学界提出了传递熵的概念。从序列 $X_{1:n}$ 到序列 $Y_{1:n}$ 的传递熵定义为

$T_i(X \to Y) = I(X_{i-L:i-1}; Y_i | Y_{i-L:i-1})$

其中 L 为相互影响的长度。后续的相关研究则进一步印证:对于向量高斯自回归过程,传递熵和 Granger 因果是等价的。

回忆定向信息的定义:

$I(X_{1:n} \to Y_{1:n}) = \sum_{i=1}^{n} I(X_{1:i}; Y_i | Y_{1:i-1})$

可见,传递熵是有限长度版本的定向信息。

机器学习领域的著名专家,图灵奖得主朱迪亚·珀尔(Judth Pearl)教授曾严厉批评 Granger 因果,认为它混淆了因果的定义。在珀尔看来,Granger 因果并非本质上的因果关系,而是属于具有时间顺序的统计。进一步地,珀尔认为没有模型假设的数据,永远无法推导出真正的因果结论。

可以这样概括两种因果概念如下:

- Granger 因果在哲学上属于经验主义,关注的是数据驱动的预测;

- Pearl 因果在哲学上属于结构主义,关注的是模型假设下的干预和反事实。

珀尔证明:仅凭较低层级的信息,无法推导出较高层级问题的答案,除非引入额外的、不可从数据中识别的因果假设。容易看出,Granger 因果属于 Level-A(关联问题),但定义了时序关系,因此是数据驱动的预测能力极限。根据珀尔的定理,如果大模型只在 Level-A 的语料上训练,则永远无法做出 Level-B/C 的推理。

随着强化学习和蒙特卡洛树搜索等算法与大模型相结合,大模型的推理能力得到了显著提升。然而本质上,这类算法是在模型固定的前提下,极致模仿人类语料中的干预和反事实模式。简言之,大模型可以写出非常像干预和反事实的句子,因为它模仿了人类的语言模式。但这只是大模型在做数据驱动的预测,而不是真正进行因果推理。从另一个角度看,当前人类与大模型互动的价值,正是引入了不可从数据中识别的因果假设,从而将大模型作为工具来大幅提升人们的工作效率。

结语:TOKEN 定义 AI 时代

本篇是系列解读文章的最后一篇,它围绕 TOKEN 为大模型建立语义信息论框架。原论文的题目叫《Forget BIT, It is All about TOKEN》丝毫没有贬低 BIT 的意思。事实上,信息时代最伟大的发明就是 BIT。BIT 连接了计算和通信。我现在坚信柯尔莫哥洛夫(Kolmogorov)的观点是对的:信息论不应该建立在概率论的基础上,信息论比概率论更加基础,它和图灵的计算理论一样,建立在逻辑的基础上。

人类已迈向 AI 时代,其核心概念我认为就是 TOKEN。从这个角度出发,可以大胆推测,正如 BIT 连接了计算和通信一样,TOKEN 将连接经验(记忆、推断)和理性(推理)。因此,BIT 定义了信息时代,而 TOKEN 则将定义 AI 时代。

无论大模型当前的技术路径是否能真正通往通用人工智能(AGI),AI 时代的大幕已经正式开启,我们要围绕新的核心概念开展研究与开发,构筑新的理论和系统。也许大模型的下一个 Token 预测并非真的在思考,但无论是谁也无法否认大模型革命性地提升了自动化整合和处理信息的能力。

对这类前沿的深度学习理论与模型原理的深入探讨,欢迎在云栈社区继续交流。