据传 Anthropic 神秘的 Claude Mythos 在复杂推理、系统泛化和深度外推上表现惊人,但官方始终闭源。现在,一个名为 OpenMythos 的完全开源 PyTorch 实现项目正式亮相,它尝试从第一性原理出发,理论重建这个“神话级”架构。

这并非简单的复制,而是基于近期循环变换器(Looped Transformer)相关论文进行的一次大胆探索。那么,Claude Mythos 的核心秘密可能是什么?目前主流的猜想指向了循环深度变换器(RDT)。

核心猜想:循环深度变换器(RDT)

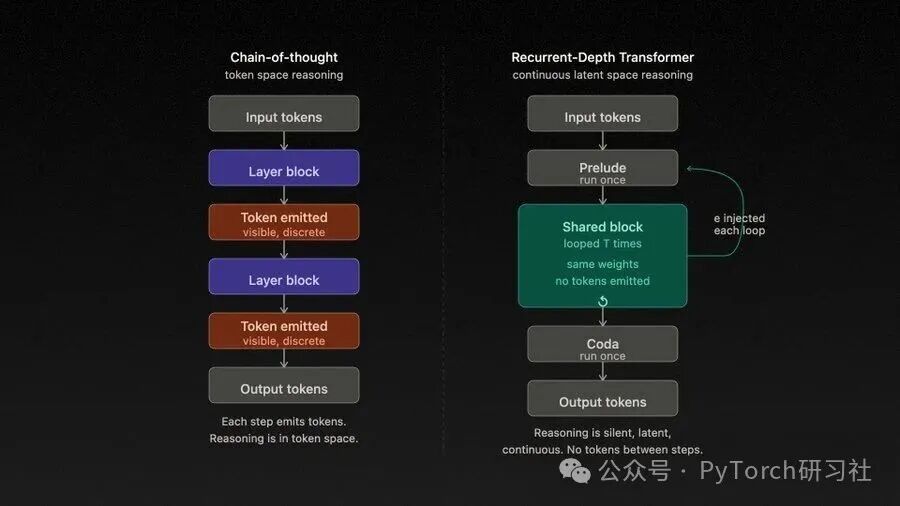

传统 Transformer 通过堆叠更多层来增加深度,但 OpenMythos 的假设完全不同:Claude Mythos 很可能是一种 Recurrent-Depth Transformer(RDT)。

其核心思路是:同一个 Transformer 块在单次前向传播中循环执行多次(例如多达 16 次迭代),权重完全共享。这种做法最直接的优势在于,能够用更少的参数实现更深的推理深度。

具体架构可以划分为三个部分:

- Prelude(前奏):标准的 Transformer 层,仅运行一次,负责对输入进行初始处理。

- Recurrent Block(循环块):这是架构的核心。同一个块会反复循环执行。为了维持循环的稳定性、避免状态崩溃,每次循环都会通过稳定的 LTI(线性时不变)输入注入 机制,将原始输入重新融合到隐藏状态中。

- Coda(结尾):标准的 Transformer 层,同样只运行一次,负责生成最终的输出结果。

在循环块内部,前馈网络采用了 Mixture-of-Experts (MoE) 设计,每次只激活稀疏的 top-K 专家,同时保留少量共享专家。关键之处在于:不同的循环深度可能会路由到不同的专家子集,这使得每一次“思考循环”都具有计算上的独特性,而非简单的机械重复。

注意力机制方面,默认使用 Multi-Latent Attention(类似于 DeepSeek-V2 的方案),通过低秩的 KV 缓存来大幅降低内存占用(据称可节省 10-20 倍)。

此外,项目还集成了多项用于训练和推理稳定的机制:

- 自适应计算时间,用于动态决定何时停止循环。

- 深度方向的 LoRA 适配器,让不同的迭代能够获得额外的表达能力,而不会显著增加参数量。

为何这可能颠覆现有 Scaling Law?

传统模型的扩展主要依赖于增加参数量和训练数据量。而 OpenMythos 引入了一个新的维度:推理时的循环深度。

相关论文和实验显示,一个仅 770M 参数的循环模型,在相同训练数据下,性能可以媲美 1.3B 参数的标准模型。推理深度变成了一种可以动态调节的计算资源——模型在训练时可能只学习了 20 跳的推理能力,但在实际推理时,将循环增加到 30 跳依然有效。

这与传统的 Chain-of-Thought(思维链) 有着本质区别。在 RDT 中,所有推理过程都在 连续潜空间 中无声地完成,并不产生任何中间的 token 输出,这可能带来更好的系统性泛化和组合能力。

简而言之:参数复用 + 循环思考 = 更高效的深度推理。这或许能解释为什么 Claude Mythos 在解决复杂难题时,会给人一种“思维特别深邃”的感觉。

OpenMythos 项目亮点

- 完整的 PyTorch 实现:提供了可配置的、包含 MoE、前馈网络、注意力等核心模块的完整代码。

- 详尽的研究基线:包含架构图、代码示例和训练基线,强调研究的可复现性,方便社区探索循环动态、缩放规律。

- 开放的社区贡献:项目已在 GitHub 开源,欢迎社区在训练稳定性优化、循环深度实验、替代注意力机制等方面进行贡献。这种开源社区快速迭代的模式,正是推动人工智能前沿探索的重要力量。

项目地址:https://github.com/kyegomez/OpenMythos

这对 AI 未来意味着什么?

OpenMythos 虽然是一个理论重建项目(并非 Anthropic 官方发布),但它成功地将“循环推理”这一前沿研究方向推到了聚光灯下。未来,模型的扩展可能不再仅仅比拼参数规模,而是比拼 “如何更聪明地思考”——即在推理阶段动态、灵活地增加计算深度,而非一味地增大静态参数。

如果你是:

- AI 研究者:可以直接 fork 项目代码,运行实验来验证循环架构与单纯堆叠层数的效果差异。

- 开发者:可以尝试在自己的项目中集成类似的循环机制,看看它在长链推理、复杂规划等任务上能带来多少提升。这对于处理需要深度复杂推理的AIGC应用场景可能尤其有价值。

- 技术爱好者:这无疑是又一个见证开源力量推动技术边界的有力案例。

当然,这一切仍处于早期探索阶段,训练稳定性、梯度传播等挑战还需要整个社区共同攻克。但正如项目发起者 Kye Gomez 所言,这是一项开放的研究努力,欢迎所有人参与。循环深度会成为下一代大模型的标配,还是仅仅停留于美好的理论猜想?只有实践才能给出答案。

对于任何对前沿模型架构感兴趣的开发者或研究者,都值得去 GitHub 上关注这个项目。探索新的可能性,正是像云栈社区这样的技术论坛所鼓励的极客精神。 |