近期,多模态跟踪领域在参数高效微调(PEFT)的研究中出现了一个值得警惕的趋势:为了追求性能提升,模型参数不断膨胀,这实际上背离了PEFT追求“高效”的初衷。如何在有限的参数预算下,让模型既高效又强大,是当前面临的核心挑战。

针对这一难题,来自燕山大学、北京航空航天大学等机构的研究团队提出了一种全新的解决方案——SEATrack。这是一个简明、高效且具备自适应能力的双流多模态跟踪器,它从两个关键维度入手,旨在打破性能与效率之间的僵局。

困境:被忽视的跨模态对齐

现有的双流跟踪方法通常分别处理不同模态(如RGB和红外、深度等),但这种方法容易在模型内部形成“模态特有偏置”。简单来说,就是模型在处理不同模态数据时,会形成各自不同的偏好和注意力模式。当需要将这些模态的信息融合起来做决策时,这些相互冲突的注意力图就会“打架”,严重影响模型学习统一、有效的联合表示能力。

SEATrack认为,解决这个问题的关键在于实现匹配响应(matching responses)的跨模态对齐。这是一个长期被忽视,却又至关重要的因素。

核心创新一:AMG-LoRA

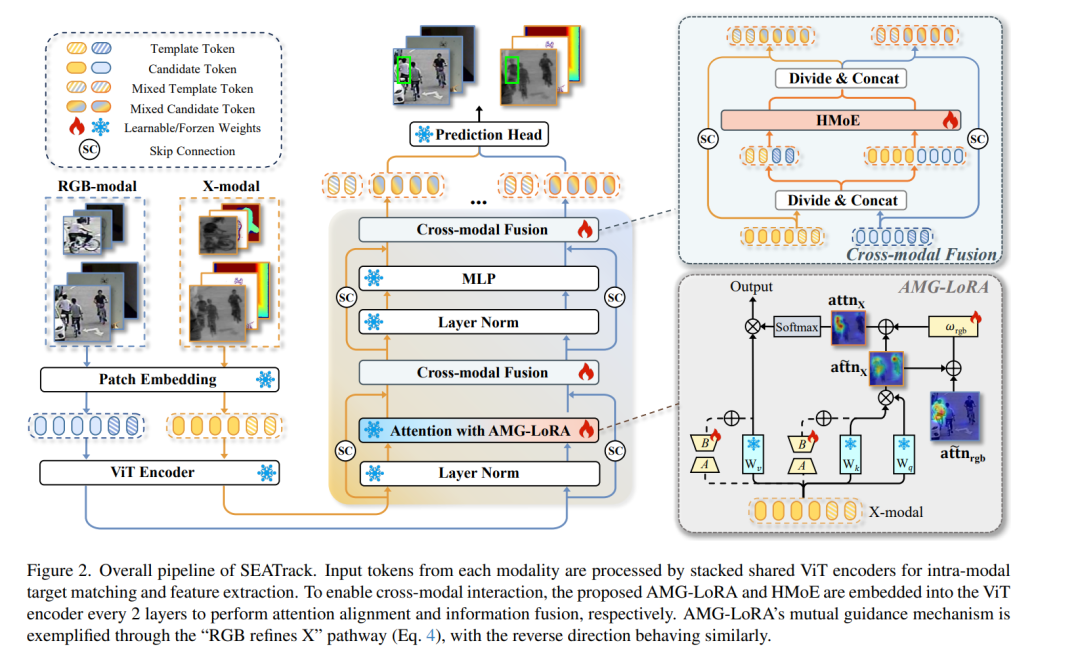

为了实现精细化的注意力对齐与融合,研究者提出了 AMG-LoRA 模块。这个模块巧妙地将用于领域自适应的低秩自适应(LoRA)技术,与一种全新的自适应相互引导(Adaptive Mutual Guidance, AMG)机制结合起来。

传统的LoRA通过向预训练模型注入可训练的低秩矩阵来实现高效微调。而AMG-LoRA在此基础上,让不同模态的注意力图能够动态地相互指导和细化。例如,RGB模态的清晰纹理信息可以引导红外(Thermal)模态的注意力聚焦到更精确的位置,反之,红外模态的热源特征也能帮助RGB模态在复杂背景中锁定目标。这种双向、自适应的引导机制,有效缓解了模态偏置冲突,促成了更和谐的跨模态注意力对齐。

核心创新二:HMoE

在信息融合策略上,SEATrack也做出了革新。它摒弃了传统的局部融合方式,转而引入了层级混合专家模型(Hierarchical Mixture of Experts, HMoE)。

你可以将HMoE理解为一个智能的“信息路由与整合中枢”。它不再局限于局部特征的简单叠加,而是能对全局的跨模态关系进行高效建模。HMoE通过其层级结构和门控机制,动态地选择最相关的“专家”(即特定的特征处理子网络)来整合来自不同模态、不同层次的信息,从而在保持强大表达能力的同时,严格控制了计算开销。

效果与总结

凭借AMG-LoRA和HMoE这两项核心设计,SEATrack在多个主流多模态跟踪基准测试中(包括RGB-T、RGB-D和RGB-E任务)都取得了显著进展。实验表明,它在性能和效率的平衡上超越了现有的前沿(SOTA)方法,真正践行了参数高效微调的初衷。

这项研究为计算机视觉中的多模态学习提供了一个新颖且有效的范式。它表明,通过精心设计跨模态交互机制,完全可以在不显著增加参数的情况下,大幅提升模型性能。目前,该项目的相关代码已在GitHub上开源,这对于推动多模态跟踪领域的进一步发展具有重要意义。感兴趣的研究者和开发者可以在云栈社区关注后续的技术讨论与实现分享。 |