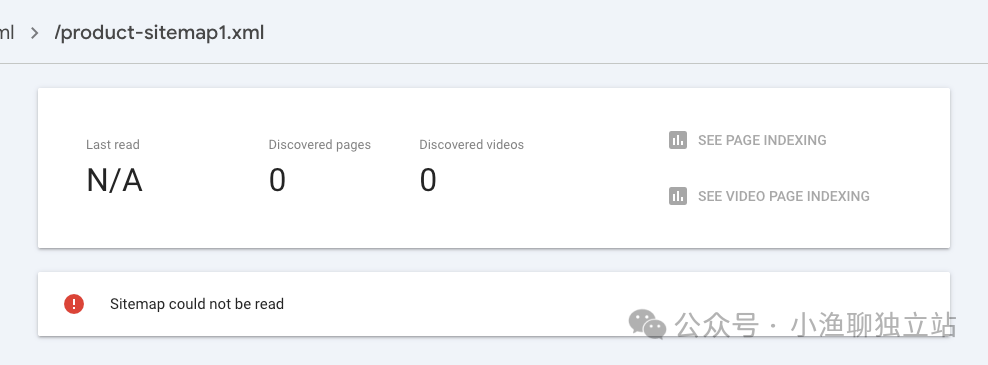

我最近在打理一个独立站时,碰到了一个挺棘手的SEO问题:向Google提交了站点地图(Sitemap),后台却一直显示无法读取,就像下面这张截图一样。

这个网站是去年年底上线的,当时想着过完年再集中精力更新内容,所以上线初期基本就是个“空壳”。最近我开始陆续上传产品,大概有几十款了,但检查收录情况时却发现,这些新内容根本没被索引。

问题出在哪?我开始排查基础配置。在站长工具后台,我尝试手动提交了一条链接。今天再查,这条链接已经被收录了。这说明网站的基础抓取配置应该没问题,我自己也能正常访问站点地图的URL。

那么,最可能的原因就是搜索引擎爬虫在读取站点地图文件时“不顺畅”——事实上,我在服务器日志里也确实看到了谷歌爬虫抓取站点地图的记录。于是,我开始在运维 & 测试相关的技术社区里搜索,看看近期有没有类似案例。

还真让我找到了一个情况高度相似的帖子:同样是网站上线后提交站点地图,显示无法读取内容,但后台日志里却有谷歌爬虫的访问痕迹。更有意思的是,我在帖子底下看到了Google的搜索倡导者John Mueller的回复:

One part of sitemaps is that Google has to be keen on indexing more content from the site. If Google’s not convinced that there’s new & important content to index, it won’t use the sitemap.

这话表面意思是:谷歌得觉得你网站的内容有价值、有更新的必要,才会去积极读取你的站点地图,否则可能直接忽略。

潜台词就很明显了:这涉及到网站本身的“质量”问题。如果爬虫第一次来访时,对你的网站印象不佳,认为内容贫瘠或价值不高,它很可能就不会再花费额外资源去深入抓取,包括读取你的站点地图文件。

仔细想想,我上线网站时的操作,可能还真给爬虫留下了这样的“第一印象”。我的习惯是先让网站框架上线,内容以后再慢慢补。所以网站刚上线那会儿,只有首页、“联系我们”和几个法律协议页面,内容密度极低。

爬虫第一次来访,看到这么一个近乎空白的网站,很可能会判定它“没有抓取价值”。即便我现在开始大量更新内容,但几周前形成的负面印象可能已经生效,短期内想要扭转并不容易。这或许就是为什么我的站点地图一直显示读取失败,但手动提交的单个链接却能成功收录的原因。

目前的解决思路是:持续稳定地更新高质量内容,同时通过站长工具手动提交几个信息密度高的核心页面,主动引导爬虫重新评估网站。过段时间再看看站点地图的状态和整体收录情况是否有改善。对于网站运维和SEO优化来说,上线初期的内容铺垫真的不能马虎。

你在管理网站时,是否也遇到过类似因“第一印象”导致的收录问题?欢迎在云栈社区分享你的经验和见解。 |