近期,谷歌在开源领域放出了一个大招,将其强大的AI技术打包成可免费使用的模型——Gemma 4。这意味着,你现在可以将一个功能接近顶级大语言模型的AI,直接部署在你的手机或个人电脑上,完全离线运行,无需联网、注册或支付任何费用。

我自己体验了一番,记录下在手机和Mac Mini上成功运行Gemma 4的全过程,希望能帮你快速上手。

Gemma 4 是什么?

简单来说,你可以把Gemma 4理解为一个免费的、完全运行在你本地设备上的ChatGPT。

它是谷歌基于其顶级模型Gemini 3的技术,推出的一个可下载的本地版本。所有对话、推理都在你的设备上完成,聊天记录绝对私密,没有任何数据上传。无论是日常聊天、文档翻译、代码编写还是逻辑分析,ChatGPT能做的事情,Gemma 4基本都能胜任。

谷歌发布了多个版本的Gemma 4,对于我们普通用户,主要关注两个:

- 轻量版 E4B:专为移动设备和轻薄笔记本设计。量化后模型大小约3GB,8GB内存的设备即可流畅运行。它支持文本、语音甚至图像输入,适合作为随身的AI助手。

- 性能版 26B A4B:这是一个拥有260亿参数的大模型,但采用了高效的稀疏激活技术,每次推理只激活约38亿参数,在保持强大能力的同时显著降低了资源消耗。在配备16GB统一内存的Mac Mini上就能运行,效果非常出色。

如何在手机上运行 Gemma 4?

有两种主流的App方案,一个来自谷歌官方,另一个则深度集成于苹果生态。

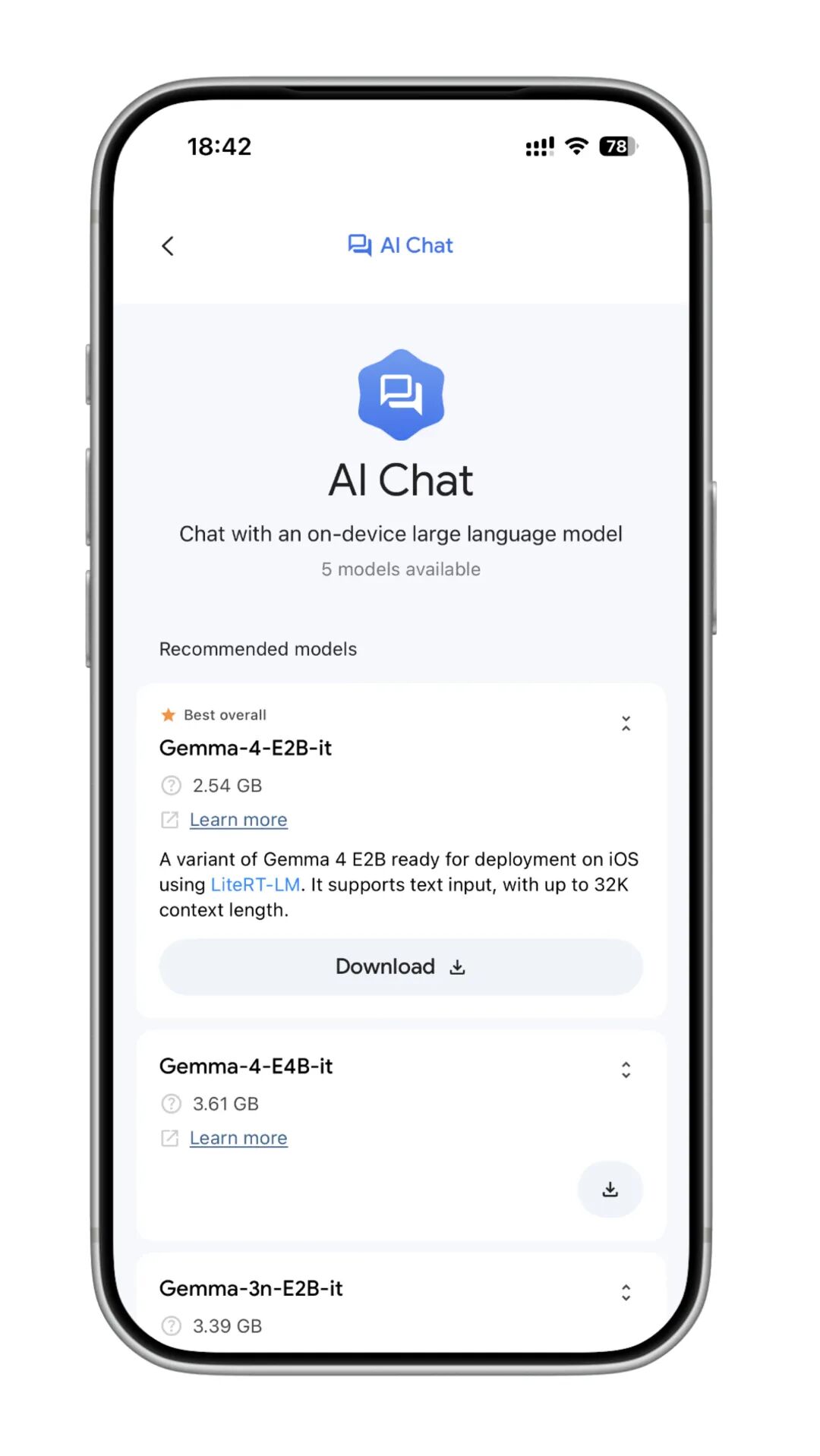

方案一:Google AI Edge Gallery(安卓/iOS通用)

这是谷歌官方推出的应用,上手最简单。你只需要在Google Play(安卓)或App Store(iPhone)搜索“AI Edge Gallery”并安装。打开应用,从模型库中选择Gemma 4的相应版本下载,完成后即可开始对话。整个过程无需任何代码操作。

- 安卓用户:建议选择 E4B 版本。

- iPhone用户:内存较小的设备可选更精简的E2B版本;如果是iPhone 15 Pro/16 Pro等8GB内存的机型,可以尝试E4B以获得更好体验。

方案二:苹果用户专属 - Locally AI

在App Store搜索“Locally AI”下载即可,同样无需注册。其底层使用了苹果专为自家芯片优化的MLX框架,在iPhone、iPad和Mac上运行效率更高、更流畅。除了Gemma 4,它还支持Llama、Qwen、DeepSeek等主流本地大语言模型,可谓“一个App囊括所有”。

用手机运行AI,需要管理好预期。生成速度大约在每秒5-10个词,用于问答和翻译绰绰有余,但撰写长文可能就需要一点耐心了。

如何在 Mac Mini 上运行 Gemma 4?

对于本地AI部署,配备M系列芯片的Mac Mini堪称完美载体。其统一内存架构让CPU和GPU高效共享内存,天生适合运行AI模型。关键是功耗极低,几乎静音,可以24小时不间断作为私人AI服务器,电费成本几乎可以忽略。

部署过程仅需三步,十分钟内即可完成。

第一步:安装 Ollama

访问Ollama官网的Gemma 4模型页:https://ollama.com/library/gemma4:e4b,下载Mac版安装包,像安装普通应用一样拖入“应用程序”文件夹即可。

第二步:拉取并运行模型

打开“终端”(Spotlight搜索“终端”或Command+空格后输入),复制粘贴以下命令:

ollama run gemma4

回车后,Ollama会自动下载并运行Gemma 4 E4B模型,下载完成后会进入交互式聊天界面。

如果你的Mac Mini内存大于16GB,强烈建议运行更强的26B版本,其在代码生成、长文分析和复杂推理上表现更好:

ollama run gemma4:26b

16GB内存可以运行,若拥有24GB或更多内存,运行将非常流畅。

第三步(进阶):共享给家庭网络

如果你想让同一Wi-Fi下的手机、平板都能使用这台Mac Mini上的AI,可以在终端运行:

OLLAMA_HOST=0.0.0.0:11434 ollama serve

然后,其他设备就能通过Mac Mini的本地IP地址和11434端口连接到这个AI服务。你还可以为其安装Open WebUI等开源Web界面,这样全家就拥有了一个免费、完全私密的ChatGPT服务。

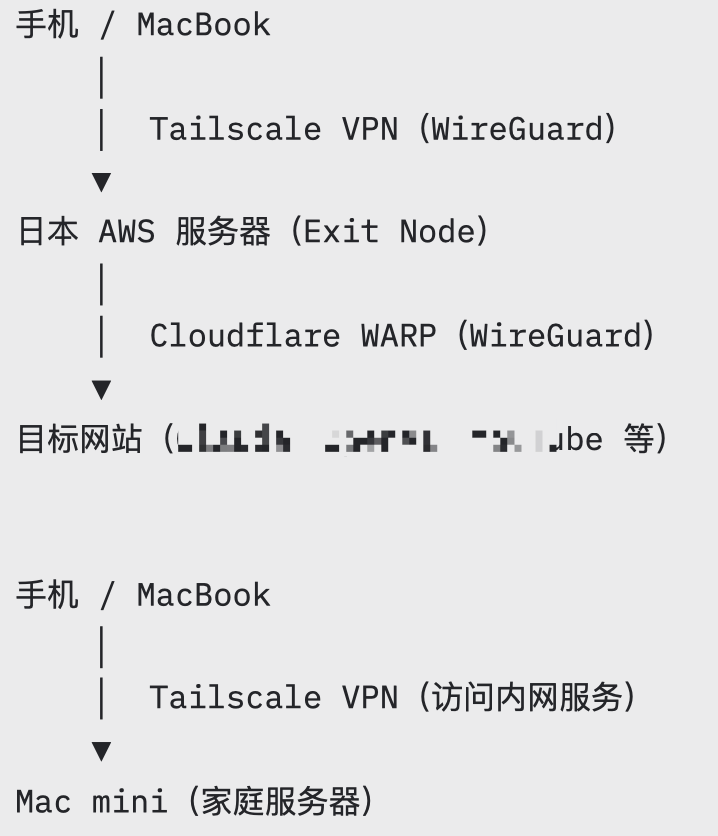

一个更极客的玩法是,通过Tailscale等工具组建虚拟局域网,将家中的Mac Mini变成你的“私有AI云”。这样即使出门在外,也能通过手机安全地访问家中部署的Gemma 4,无需消耗任何在线API的Token。

版本选择与硬件建议

如何选择版本?主要看你的设备内存:

- 8GB以下:首选E2B,是手机上的最佳选择。

- 8GB - 16GB:选择E4B,适合多数轻薄笔记本。

- 16GB - 24GB:26B A4B,性价比之王,Mac Mini绝配。

- 24GB以上:可以尝试31B Dense版本,体验开源模型的顶级能力。

一些开发者视角的观察

这件事对苹果硬件生态相当利好。本地AI极度依赖内存带宽和容量,Mac的统一内存架构在此场景下效率远超传统PC。同样实现24GB的可用内存,Mac Mini的成本远低于需要独立大显存显卡的PC。曾经被吐槽“金子般”的苹果内存,在AI时代反而成了高性价比的算力入口。

目前,谷歌(Gemma)、Meta(Llama)、国内厂商(Qwen等)在开源模型领域竞争激烈。对我们用户而言无需站队,哪个好用、哪个适合你的设备就用哪个,反正都是免费。花上十分钟,体验一下AI完全在你自己掌控之下的感觉,确实很不一样。