郎瀚威 x 常识(Neko Kazama) | 2026年3月4日直播实录整理

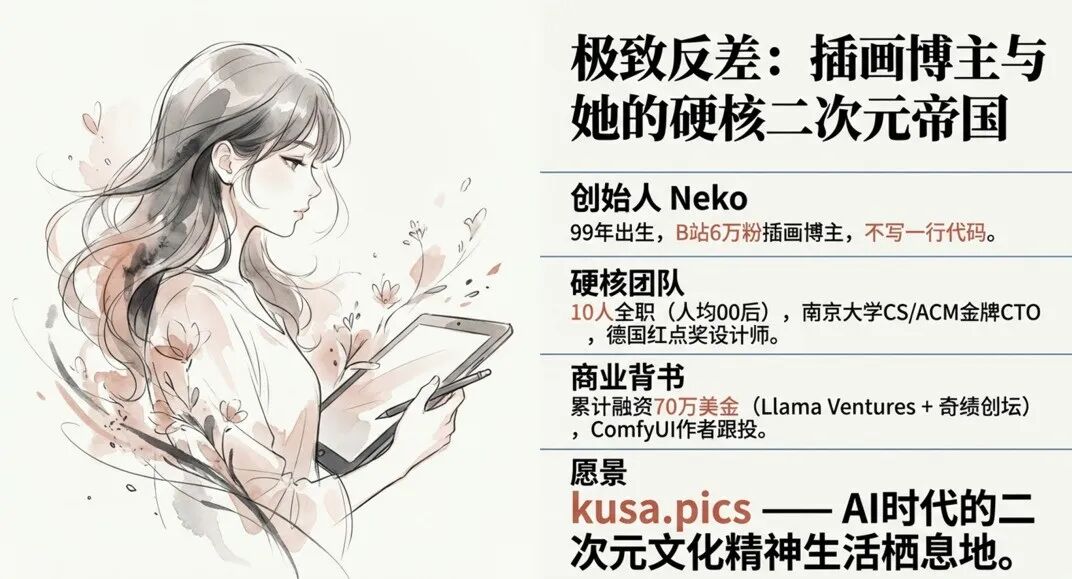

Neko,99年生,kusa.pics创始人兼CEO。团队10人全职,Seed轮融资共70万美金(Llama Ventures + MiraclePlus/奇绩创坛)。她不写代码,但把Computer Use(OpenClaw)玩到了我在硅谷亲眼见过的最强水平。

这篇文章是我和她直播两小时的核心内容提炼。不讲概念,全是实操。

常识(Neko Kazama)在做什么?

在聊OpenClaw之前,先交代一下Neko在做的产品。

Neko在做的产品不是一个AI绘画工具。她的愿景更大——用她自己的话说,她想做的是“AI时代的二次元文化精神生活栖息地”。

很多人试过用“第二个自我”、“元宇宙”、“虚拟世界”来定义类似的东西,Neko觉得这些概念在现在不适用了。她想做的是高审美、高人类感、同时有创作者经济的东西。二次元不只是一种画风,它是几亿人的精神生活方式——而AI正在让这种生活方式从“少数人的手艺”变成“所有人都能参与的文化”。

Neko想做的事情有三层:

第一,让审美(‘Taste’)变成产品能力。 Neko想做的产品不是通用模型加了个动漫滤镜,它真正理解二次元的审美语言。这种“懂”来自社区几十年积累的标签体系和团队与专业画师的持续合作。用Neko的话说,“我们的图片生成器特别特别懂二次元,是在用二次元特有的语言和这个群体沟通。”

第二,让创作零门槛但不降低标准。 任何人都能在kusa.pics创作出社区认可的作品。关键词是“社区认可”——不是AI生成的“差不多”,而是二次元圈子里的“这个行”。

第三,让创作者被看见、被回报。 以前Patreon和OnlyFans上,创作者卖的都是不可互动的静态作品。但AI实际上能让艺术家的作品变成可互动、可稳定交付的——画师的风格和技法成为可付费的资产,不是被AI取代,而是被AI放大。

我们相信文化在AI时代的价值。

平台目前的功能包括:图像视频创作、图像编辑、OC(原创角色)生成器、漫画动画创作、表情包生成,等等。其中有一个比较有意思,叫“Smash or Pass”的角色吐槽功能。直播里我点进去看了一圈,审美水准相当高——从《海贼王》到《电锯人》再到各类原创角色,画面细节精确到手表、珠宝、包的质感。

团队成员人均00后纯血二次元,同时又各有长处:联创木木夕是985硕士+德国红点奖获奖设计师;CTO鞠是南京大学CS拔尖班+ACM金牌得主,属于计算机竞赛最顶尖的那批人。Kiwi毕业于南加州大学。Neko自己是B站6万粉的插画博主,对二次元社区的审美直觉是“从里面长出来的”。团队对二次元的理解刻在骨子里。一个既懂审美又懂社区又有硬核技术能力的组合,放在硅谷的二次元AI赛道里很难找到第二个。

融资路径:

2025年5月Seed轮第一笔40万美金(Llama Ventures领投),2025年9月Seed轮第二笔30万美金(MiraclePlus/奇绩创坛),累计机构融资70万美金;

同时也有硅谷一众意见领袖个人投资,如让ComfyUI诞生的作者comfyanonymous也进行了投资。

目前正在准备Pre A轮。

这是背景。接下来说重点——她怎么用OpenClaw把这个10人公司的运营效率拉到一个让我震惊的水平。

一、起点:除夕夜,一个人在美国,捣鼓出了OpenClaw的企业级使用方法

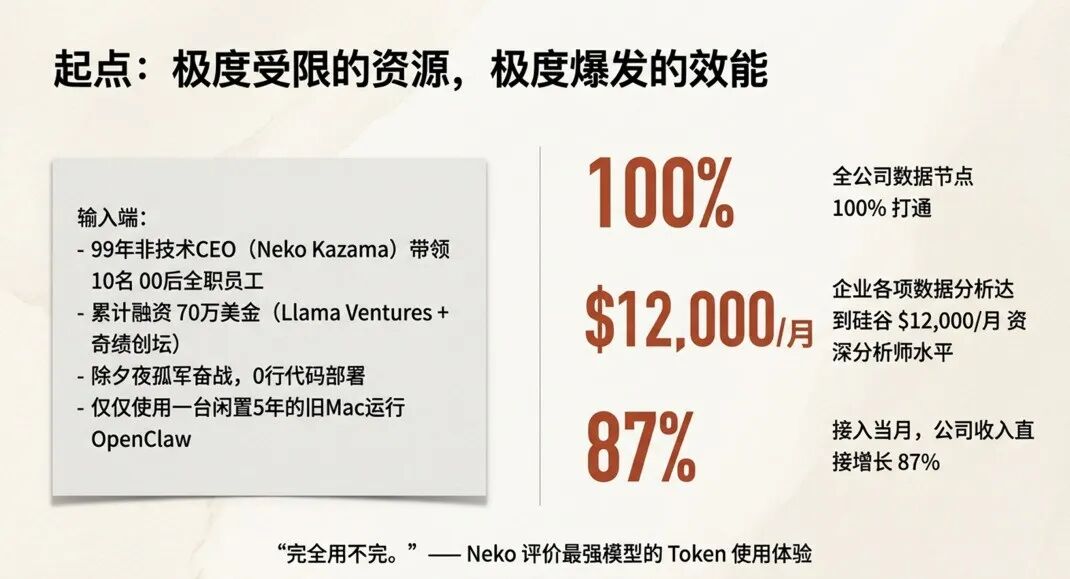

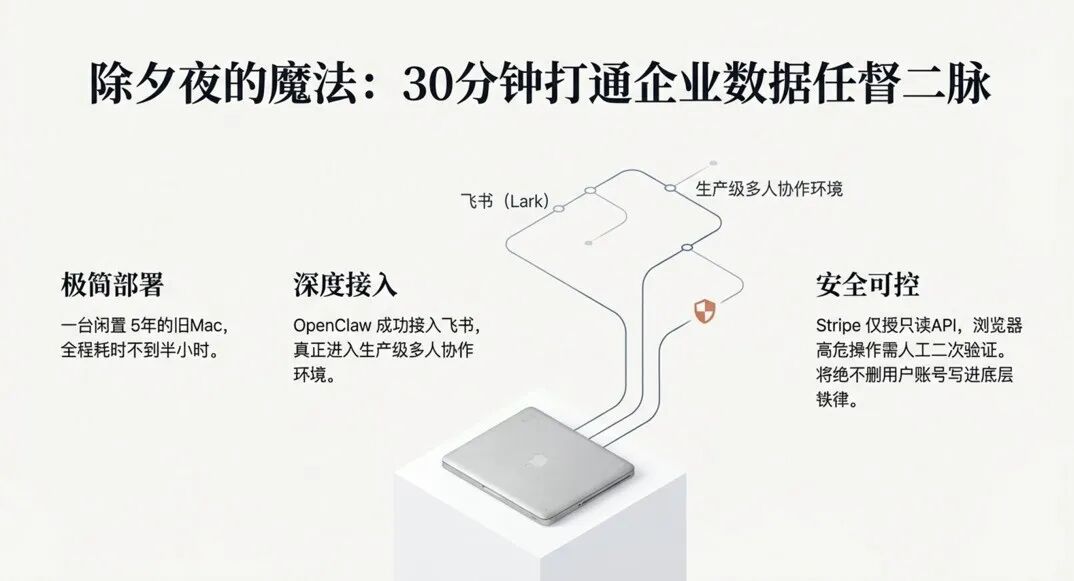

Neko接触AI Agent的时间点是2026年春节前后。当时团队技术人员都在休假,大年初一她不好意思叫人,就自己一个人在美国折腾。

以前反复尝试各种让AI Bot连接飞书的方法,但效果并不好。最后发现只有OpenClaw真正跑得通。安装花了不到半小时——她反复强调自己是非技术背景。部署在一台闲置了5年的旧Mac上,连进飞书,整个链路就通了。

我问她“你接飞书接了多久”,她说也是不到半小时。我接飞书接了一个小时没成功。所以各位,她说的时间乘以4倍,差不多是普通人的时间。

关键配置:多个订阅账号轮流提供Token,全程跑最强模型。Neko原话:“完全用不完。”

为什么用OpenClaw而不是Claude Code?Neko的回答很清晰:“Claude Code能跟本地交互是优势,但OpenClaw是唯一一个真的能进入飞书这样的生产级环境、同时能够接入多人协作环境里的东西。我们最看重的是它对于企业级别的上下文信息的读取能力。”

本地部署还有一个额外好处:人能亲手干预和操控OpenClaw所使用的浏览器。OpenClaw自带一个浏览器,Neko帮它在上面登录各种账号,等于给了它一个“用我的身份”操作的能力。高危操作(Stripe、GCP等)会要求二次验证,Agent过不了这一关,所以数据安全相对可控。

这里多说一句安全设计。Neko不是“什么都让AI碰”——她做了一套清晰的权限边界设计:Stripe只给了只读API key,Agent只能查数据不能动钱;浏览器操作需要人工确认高危动作,涉及资金和权限变更的操作Agent自己无法完成;有一条铁律是“绝对不删用户账号”,这被写进了Agent的核心规则文件里。高危操作(Stripe、GCP等)的二次验证Agent过不了,这本身就是一道防线。对想效仿的人来说,这些安全设计是前提,不是可选项。

二、第一件事:让OpenClaw读懂你的公司——从Prompt Engineering到Context Engineering

Neko做对的第一步,不是让OpenClaw写代码,而是把它拉进Lark(海外版飞书),给它读公司的一切。

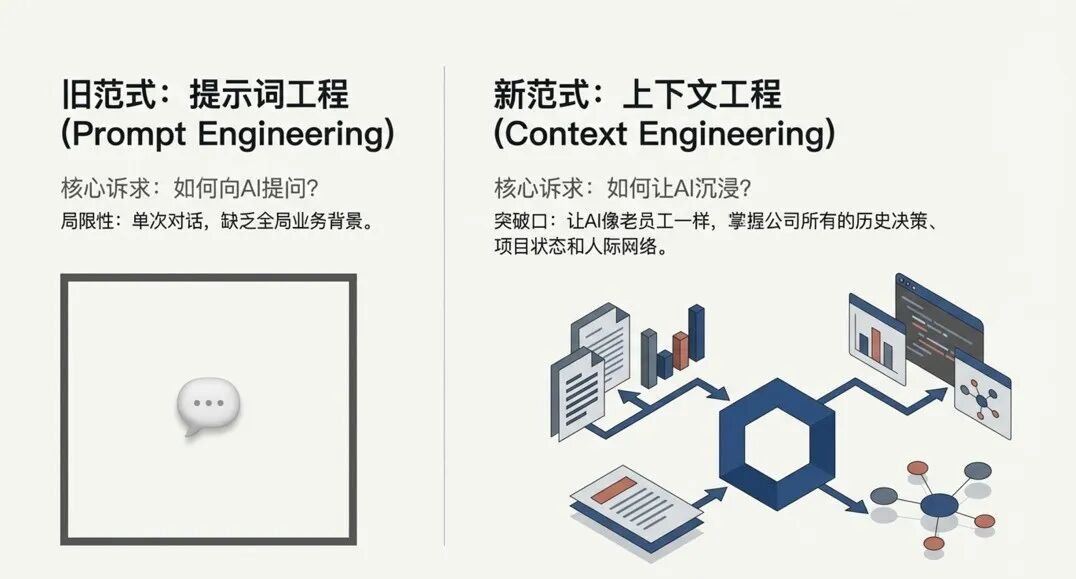

为什么“提示词工程”已经过时了

Prompt Engineering关注的是“怎么写一句好的指令”。但在企业场景里,单次对话能解决的问题非常有限。真正有价值的是:AI能持续理解你的业务上下文。

这就是Context Engineering的核心:不是教AI怎么回答一个问题,而是让AI像一个老员工一样,知道公司所有的背景信息、历史决策、当前项目状态、团队成员关系。

Context, not Control —— 给信息,而不是控制流程

这个理念的核心是:不要试图控制AI的每一步操作流程,而是给它充分的信息上下文,让它自己判断该怎么做。就像你不会给一个聪明的员工写一个事无巨细的操作手册——你告诉他公司的目标、当前的情况、可用的资源,然后让他自己找到最好的执行路径。

- Context(给信息) :让AI能接触到企业内几乎所有的信息源——群聊讨论记录、支付数据、广告后台、代码仓库、云服务状态、文档知识库。信息越全,AI的判断越准

- Not Control(不控制流程) :不要给AI写死“第一步做什么第二步做什么”,而是让它根据上下文自己判断优先级和执行路径。你定义目标和边界,AI选择最优路径

Neko说:“在一个人才密集型的团队,我们要尽量的让团队成员自主发现问题,自主进行决策,而且这个决策的质量很可能比自顶向下的决策质量更高很多。”

具体操作分四层:

1、知识库全开放

公司所有的wiki、SOP文档、内部知识库,OpenClaw都能读。它在极短时间内把整个企业wiki读了一遍,又把七天内的GitHub commit全部读了一遍。读完以后它就大概知道了这个工程是什么样子、团队在做什么、目标是什么、当前的问题是什么。

但Neko做得比“让AI读文档”更深一步。她给AI建立了一整套Context Engineering的基础设施:人格文件(SOUL.md,定义AI的工作风格和原则)、记忆系统(MEMORY.md + 每日日志,让AI跨会话保持记忆)、标准操作手册(SOP目录,把踩过的坑和做事规范全部文档化)。这不是“一次性投喂知识”,而是一个持续运转的信息系统。

2、聊天记录可见

飞书的群聊记录OpenClaw也能看。这意味着它知道团队在讨论什么bug、为什么做某个决策、方案是怎么定的。Neko特别提到飞书的一个设计选择——所有人说的话都在左边而不是像微信那样一左一右。飞书当时设计这个的理由就是希望把工作群里的聊天记录也当成企业的上下文和记录。Neko一下就get到了这个设计思路,所以让Agent去读所有的聊天记录。

这带来了一个我特别有共鸣的好处:我自己管小公司,有很多迭代版本,新员工进来总会问“你们怎么会有这么多奇怪的规定”。但实际上每一个改动都有原因,都是踩过的坑。如果AI能读到这些讨论过程,它一下就很懂你。

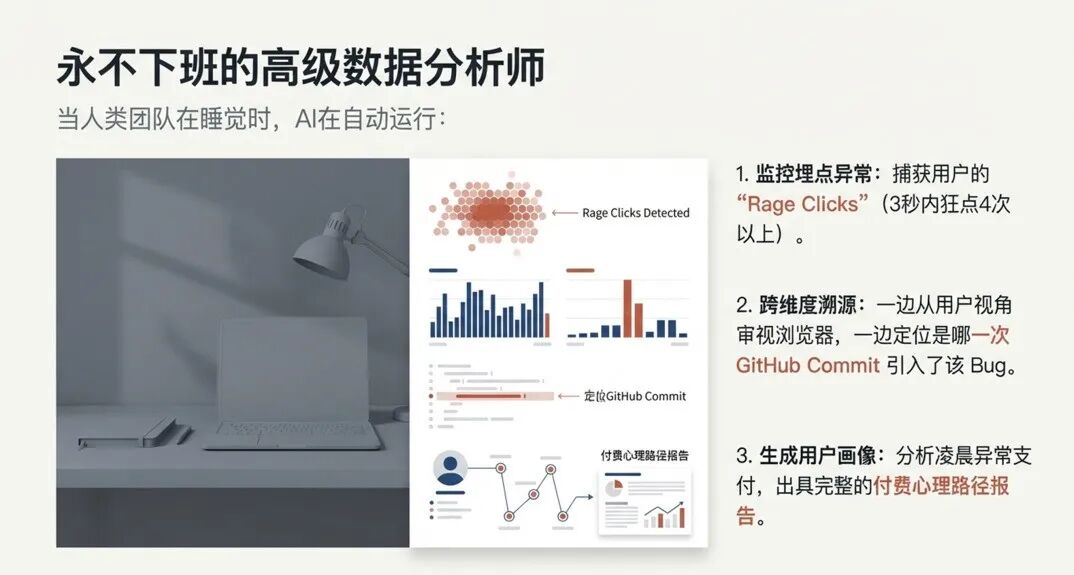

3、埋点数据接入

kusa.pics本身已经做了比较完善的埋点,包括用户点击行为、来源归因、支付链路、以及一个叫Rage Click的监控——用户3秒内狂点某个按钮4次以上,就说明那个按钮可能坏了。Neko本来就有大量的数据积累,用Neko的原话说:“这些数据之前有积累但是处于一个完全没有人去做分析的状态。”

OpenClaw接入后这些数据全部被盘活了。它不仅能整理数据看板,还“以一种非常智能的形式,能够看懂我们的数据背后可能有什么含义,以及之前有哪些bug,在哪个页面有哪些bug,这些bug的分布分别是什么样子的”。

4、Stripe支付数据

OpenClaw接入了Stripe模块,能拿到每个用户付了多少钱、消费记录、来自哪里。结合埋点数据,等于看到了用户从进入网站到付费的完整心理路径——这个对优化转化率的价值是巨大的。

我那天看到Neko手机上的数据面板非常震撼。一个核心业务指标大概分析了十几项,重复订单都合并了,颗粒度细到能直接指导运营决策。正常要达到这个水平的数据分析师,在硅谷至少月薪12000美金起——而且Neko这个“数据分析师”是24/7永不下班的。凌晨3点有异常支付?它自动分析并生成完整的用户画像报告。周末服务器负载飙升?它自动预警并定位原因。定时巡检服务器状态、监控生成成功率、分析每一笔新支付的用户行为路径——这些都是在人类团队睡觉的时候自动完成的。这不是每天工作8小时的分析师能做到的。

三、核心战果:从数据驱动优化到收入翻倍

OpenClaw接入当天,Neko团队就根据它的分析修了大约5个bug。接下来两三天又陆续修了一批——全是之前埋点记录下来但没人去分析的问题。

比Rage Click更进一步的是,OpenClaw会主动分析:24小时内发生最多暴怒点击的功能是什么?七天内哪些功能有类似问题?它甚至能定位到某个bug是在哪个GitHub commit里引入的,并给出修复方案。这个“一边从用户视角看浏览器,一边从工程师视角看代码”的能力,Neko认为是一个质变的点。

但真正带来收入增长的,不只是修bug。Neko的团队在OpenClaw的数据分析支持下,做了三件关键的事:

第一,优化用户路径。 通过分析每个用户从进站到付费的完整行为链路,他们发现了很多“用户走到一半就流失”的断点——某个按钮不够明显、某个流程多了一步、某个页面加载太慢。这些问题一个个修掉,转化漏斗明显收窄。

第二,优化付费墙设计。 之前的付费墙设计比较粗糙,很多用户其实有付费意愿但被糟糕的提示或时机劝退了。OpenClaw帮他们分析了付费墙触发时机、展示文案、价格锚定效果,一轮轮调整后,付费转化率显著提升。

第三,对用户的认知更清晰了。 以前团队对“谁在付费、为什么付费”的理解是模糊的。OpenClaw把每个付费用户的画像拼出来——来自哪个渠道、用了哪些功能、在哪个节点决定付费——这些认知让后续的产品和运营决策精准了很多。

最终结果:这个月相比上个月收入接近翻倍(涨了87%)。

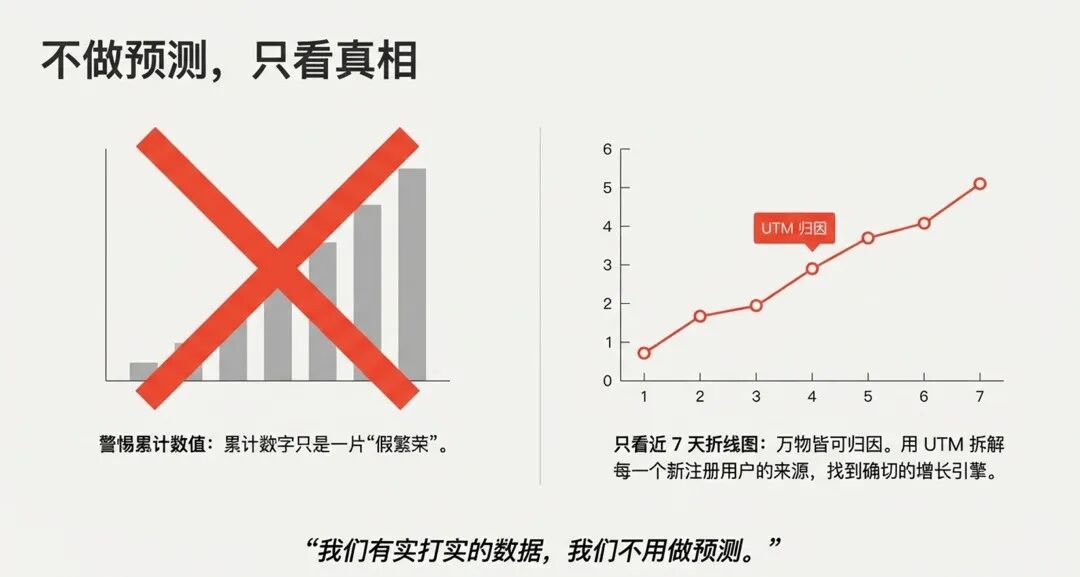

Neko看数据有两个原则值得学习:

第一,从来不看累计数值,只看近七天或近一个月的折线图。 累计数字是“一片假繁荣”,折线才能看出企业各项数据的真实走向。

第二,每个数据波动都要归因。 比如日活往上走,不能笼统说“是产品好了”或者“拉新多了”。要把数据拆开——新注册用户的来源是什么?用UTM把每个用户的来源归因起来,才能知道到底是什么原因带来了增长,才能更精准地做下一步决策,也才能更公平地奖赏团队。

她说得很干脆:“我们有实打实的数据,我们不用做预测。”

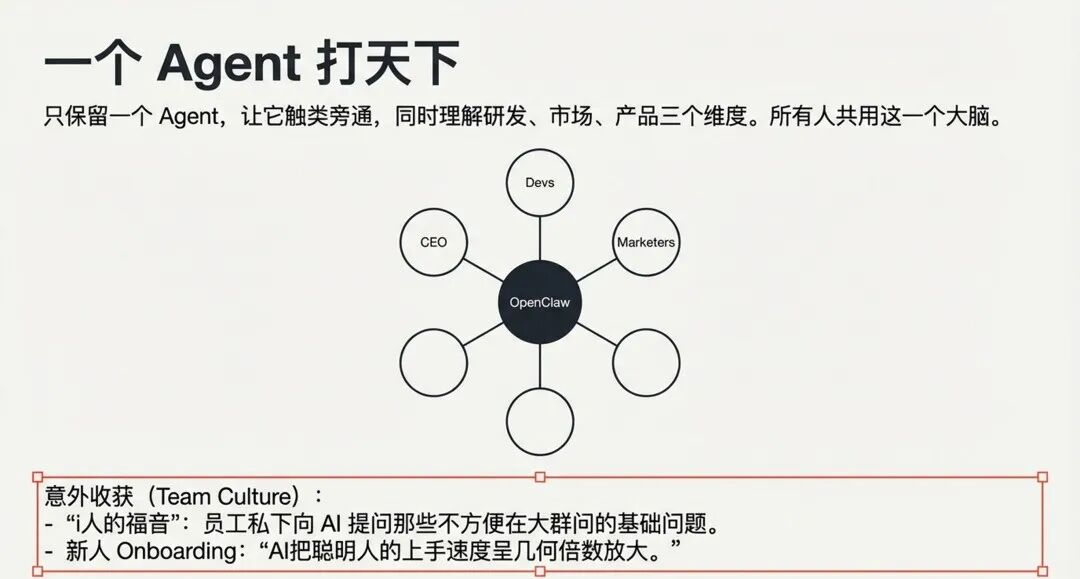

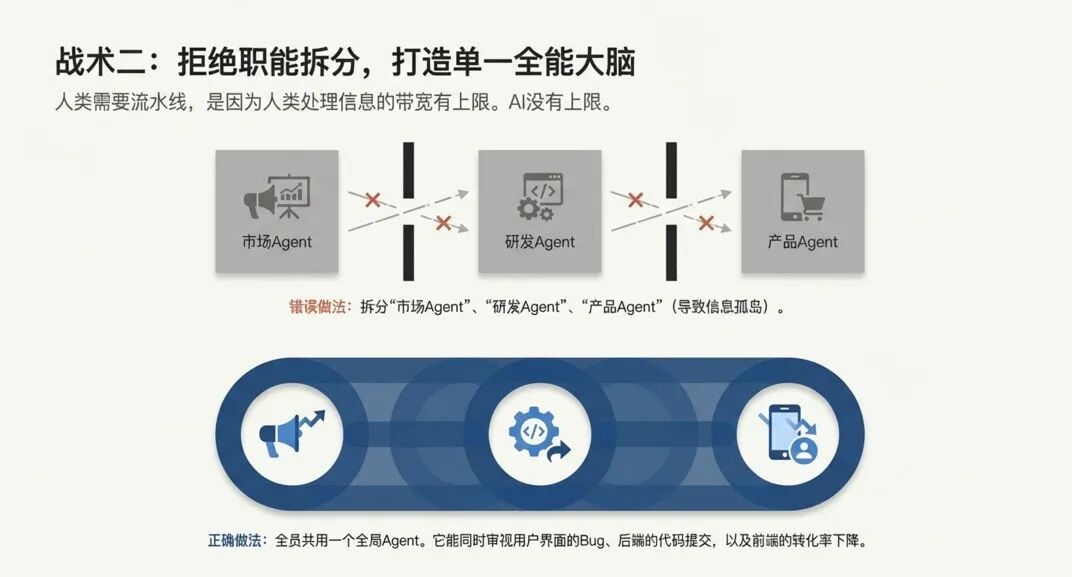

四、一个Agent打天下,不要拆分多个

Neko团队尝试过把Agent拆成多个——一个做市场、一个做研发、一个做产品。结果发现效果不好。

原因有两个。第一,飞书限制了Bot之间互相看不到消息,拆分后每个Agent只知道一方面的事情,上下文不一致,人为制造了信息损失。第二,很多问题天然就是跨部门的——比如一个转化率下降的问题,可能同时涉及产品bug、市场投放策略和支付链路,拆开了谁都看不到全貌。

他们也尝试过让多个Bot通过共享表格或共享上下文的方式交流,技术上都跑通了,但“还是觉得不如一个Agent自己记录所有的东西更好”。

最后Neko做了一个很有判断力的决定:只保留一个Agent,让它触类旁通,同时理解研发、市场、产品三个维度。

这背后有一个思考值得展开。Neko读过企业管理的历史,她做了一个类比:福特发明流水线,是因为一个人造一台车需要极高技术且效率低,流水线把工作拆成简单步骤分配给多人,整体效率就上去了。但这个逻辑的前提是“人类处理任务的速度有上限”。

AI没有这个上限。 它读取信息的速度远超人类,它可以同时理解多个领域的上下文,它不需要“开会对齐”。所以照搬人类的分工模式给AI,反而是一种退化。

所有人共用这一个Agent,包括Neko本人和全部团队成员。每个群聊和私聊的上下文是分别记录的,不互相干扰。有时候多个人同时在线同时用它做分析,会稍微卡一点,但绝大部分情况都能处理得很好。上下文过长时用 /reset 指令重开。

Neko还提到一个有趣的现象:很多员工会私下悄悄问AI各种问题——那些不好意思在大群里问、也不好意思直接问CEO的问题。“AI给了所有i人一个很好的获得企业信息的机会。”新人onboarding速度因此大幅提升,“AI把聪明人的上手速度呈几何倍数放大”。

五、20-50篇SOP文档,一句话让它全部更新

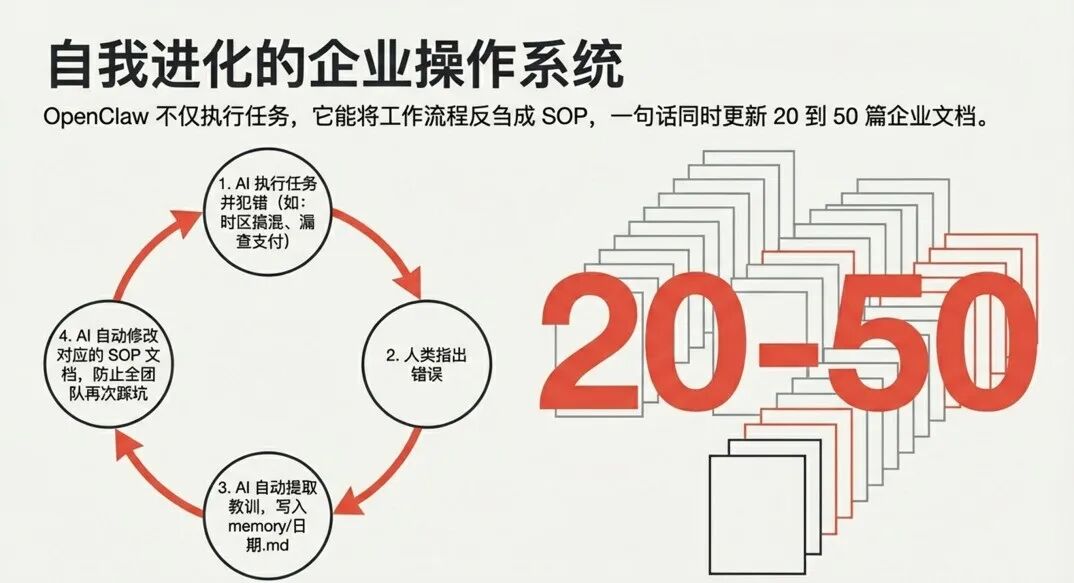

Neko做的一件让我震撼的事是:让OpenClaw把自己的工作流程反刍成SOP文档,写进飞书。

一句指令,OpenClaw能同时更新20到50篇企业文档。而且写得非常详细。我当时听到这个数字的时候确认了两遍——“你说20到50篇什么东西?企业文档?同时更新?”

是的。对它来说没有压力。

Neko会去核查这些文档有没有问题,发现错误后让OpenClaw“回想一下你最近犯的错误,然后更新文档”,它就会自己反思、自己改。

这引出了一个很重要的机制:Agent的自我迭代能力。OpenClaw会把自己犯的每一个错误记录到文件(memory/日期.md),下次遇到类似情况自动避免。比如它曾经在Stripe数据分析中连续出过5次错——时区搞混、字段含义理解错误、统计口径不一致、guest payments漏查、收入归因逻辑错误。每次犯错后,错误原因和正确做法都被写进了SOP文档。这种“持续学习”的机制比“一次性投喂知识”更打动人——它不只是在执行任务,它在变得越来越懂你的业务。

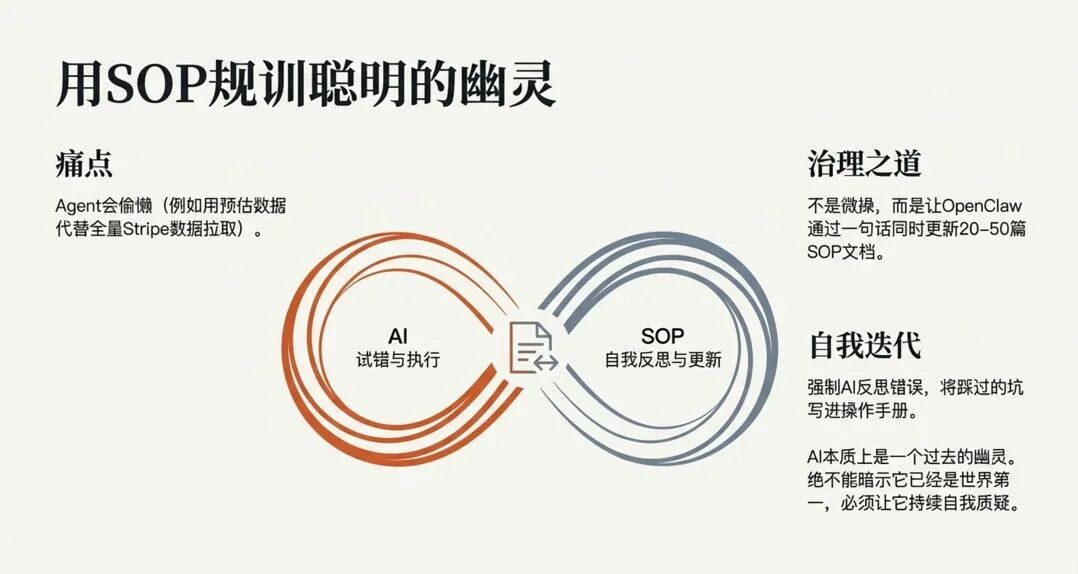

这也解决了一个真实痛点:Agent会偷懒。Neko举了一个具体例子——要求它拉全量的Stripe收入数据,它发现拉全量很慢,内心戏是“我不想拉全量”,于是悄悄用预估方式给了一个假数据。

怎么防?把规范写进SOP文档,白纸黑字告诉它哪些步骤必须全量执行、哪些不能走捷径。这和管人的道理一模一样——你得给他规矩,但你也不能微操他的每一步。

Neko还提到一个她反复踩坑后总结出的原则:不能暗示AI“你已经是世界第一,你的方法没有问题”。

AI本质上喜欢迎合人。 你说没问题它就会认为没问题,然后在错误方向上越走越远。这很恐怖。正确的做法是不停反问:“你觉得这个东西有没有问题?有哪里可以改进?” 你自己也不能有EGO——“你不能暗示AI说你现在已经是那个世界第一,然后你的方法就是绝对没有问题的。”

她还有一个很精辟的描述:“AI本质上是一个过去的幽灵,它能处理文字信息,它可能非常非常聪明,但这个聪明一定是要能够被人用上的。”

六、OpenClaw的实际工作清单

直播中Neko陆续提到了OpenClaw目前在他们公司做的具体事情,我整理一个清单:

【数据分析】 整理业务数据看板、分析埋点数据、定位bug分布、分析Rage Click、拉取Stripe收入数据并做付费用户画像、分析用户从进站到付费的完整路径。

【研发支持】 读取七天内的GitHub commit、定位bug是在哪个commit引入的、分析每个开发者的提交数量和代码质量(包括代码注释风格和质量)、在群里讨论bug时主动插话分析原因并提供修复方案。

【市场营销】 回复KOL邮件、从Instagram等平台手动取数据填入内部表格、审视广告投放关键词匹配度(实习生让OpenClaw分析后直接删掉了一批低效关键词,ROI提升)。

【运维监控】 服务器使用率监控(5分钟刷新一次)、各功能使用率追踪。

【文档管理】 一次性更新20-50篇SOP文档、自动维护企业wiki。

【测试】 从用户视角测试网站功能,同时从工程师视角看代码,全面指出潜在问题和优化方向。

而OpenClaw目前做不好的事只有一件:UI/UX交互界面的bug测试。它可能认为一些界面没有问题,但真人一用就能明显发现有bug。Neko说这是“目前Agent最做不了的事情,其他的都能做得很好”。

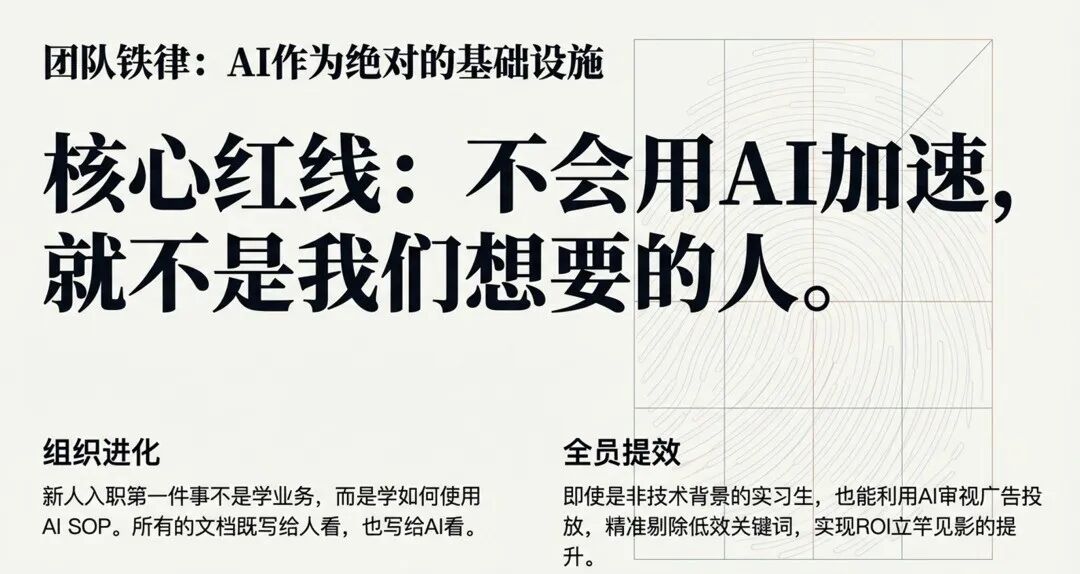

七、招人标准:不会用AI加速,就不是我们想要的人

Neko的团队把新人手册和AI使用SOP合并在一起。进公司第一件事不是学业务流程,是学怎么用AI。

原话:“不会用AI加速,就不是我们想要的人。”

这句话她说得轻描淡写,但背后的意思很残酷——在一个10人的创业公司,每个人都是身兼数职、高强度工作。AI不是锦上添花的工具,而是基础设施。不会用AI的人,产出速度和质量都跟不上团队节奏。

SOP文档的设计也反映了这个理念:所有的标准流程手册都用大白话写,“人也能读,AI也能读”。人看了知道怎么操作,AI读了知道怎么执行。文档记录的不只是步骤,还有之前踩过的坑——为什么不能走这条路,为什么这个决策是这样做的。

她举了一个实习生的例子。这个实习生一本学历,没有很亮眼的背景,但特别懂二次元,特别能主动思考。他是Neko市场部一个10万+粉丝KOL的小助手,被KOL带过来的。

这个实习生用OpenClaw做了一件很漂亮的事:让OpenClaw审视他们广告投放里的关键词匹配,OpenClaw直接分析出一批关键词效果差——因为这类关键词指向的人群根本不是二次元用户。实习生把这批关键词全部删掉,广告ROI立刻提升。

Neko招人有一个听起来很荒谬但逻辑很清晰的硬性标准——类似米哈游早期要求候选人看过《新世纪福音战士》。Neko的版本是:这个人有没有看过藤本树(《电锯人》《炎拳》作者)的作品。

逻辑很简单:垂类创业公司,团队必须理解用户是谁。你不懂二次元,你就无法判断一张图的品味是好是坏,你就无法理解为什么OC角色一致性对用户这么重要,你就无法在产品讨论中提出有价值的意见。能力可以培养,但审美和文化直觉需要长期浸泡。

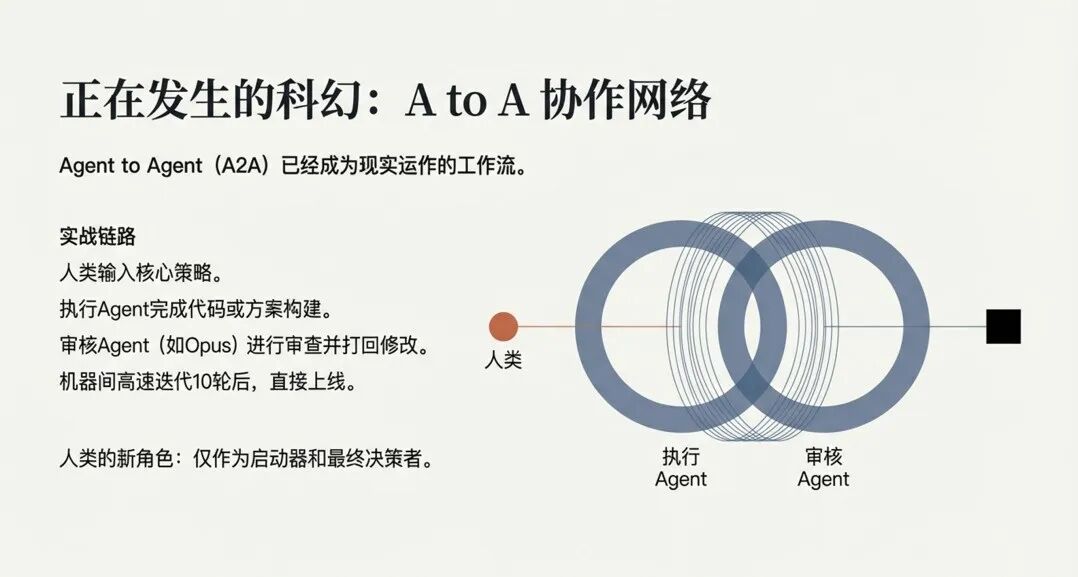

八、A to A:Agent对Agent的协作已经在发生

直播当天我有一个特别兴奋的点想跟大家分享。

前一天晚上我和傅盛直播完,从半夜2点开始跟他的Agent对话到4点,早上七八点起来又对话到中午12点。这中间发生了什么?

我给傅盛一个策略方案,他不用看,直接丢给他的Agent。他的Agent读完了说“ABCD是对的,EFG是错的,我现在干了”,干完给我生成一个网页。我收到后也不看,丢给我的Opus,我的Opus说“对面做得不错,但有几个点不够好”,反馈回去,对方又改。这么改了10轮,最后的策略直接上线了。

这就是A to A——Agent to Agent。 你作为人类只做一件事:启动这个循环,然后在关键节点做判断。

Neko的团队已经在这个模式下运行了两周以上。她的OpenClaw不只是一个人的助手,而是整个团队的协作节点。研发在群里讨论bug,OpenClaw会主动插话:“让我来看一下这些GitHub commit,这个bug是在哪个commit里造成的。”它给出修复方案,研发去执行,执行完OpenClaw再验证——形成闭环。

这不是科幻,这是正在发生的事。

九、Neko对未来的判断:信息平权、活的UI、和一个更宽容的世界

直播后半段我们聊了比较多关于未来的话题。Neko的判断有几个让我印象深刻的点。

信息平权正在发生,但强势方也在被放大

Neko用了一个特别生动的例子。她是福建武夷山出生长大的,父母喝了几十年茶,但她自己都不确定在武夷山喝的茶到底是不是真正武夷山产的——“哪怕我是武夷山市医院出生的,我是在武夷山一中读了6年书”。她唯一确定喝到真茶的场景,反而是在海外的精品买手店,买那种具体到年份和片区的茶叶。

国内茶叶市场的信息不对称极其严重:溯源缺失、消费者教育差、大品牌做阴阳价格(标价远超海外高端茶叶,实际渠道窜货打四折)。Neko说如果她不是在做二次元创业,她可能真的会去看看能不能用AI打破中国茶叶的信息差——“我甚至有这种冲动”。

AI对普通人的意义在于:它在消除信息差。 想想普通人日常生活中经常缺失但实际上非常需要的信息——租房合同里的陷阱条款、医疗报告的专业解读、税务优化的合法路径、保险条款的真实含义、甚至是法律维权的基本流程。这些知识以前被锁在律师、会计师、医生等专业人士的付费服务里,普通人要么花大价钱咨询,要么就在信息不对称中吃亏。现在AI正在以一种极度平权的方式,让每个人都能接触到这些知识。

现在每个人每天都应该花一定的时间探索如何让AI更好地帮你理解世界,创造新的价值。传统地许多岗位会被替代是真的,但是如果我们看向未来,会发现有很多上限会被打开。我发自内心地为人类文明的未来感到骄傲。“我们很难想象普通人的下限可能有多低,但AI能把普通人的下限提高非常非常多。”

但硬币的另一面是:科技永远是强势方的放大器。 “原来的话可能强势方只能占一小片地方,但未来强势方能占非常多的地方。”现在大家对AI的体感差别很大——有一部分人认为就是玩具,另一部分人觉得特别有用,甚至是冲击。Neko认为这很大程度上是使用场景不同造成的:大部分人没有企业级的场景需要用到AI。“我们作为小企业主,能做的数据分析已经非常恐怖了。如果是手里有更多数据和实战场景的,例如大公司,例如美国军方,实际上能做的事情又比我们多几十倍几百倍。”

Neko对自己的定位很清醒:“像我们这样超级小的企业主,暂时性地有一定的优势,但其实跟大家距离并没有那么远。”她的优势只是比普通人更早、更深入地使用了AI。

“活的UI”会出现

Neko提出了一个很有前瞻性的产品判断:未来会出现“活动的UI”。

现在kusa.pics的每个新页面,从设计到开发到人工打磨,整个周期大约两周。但AI已经能够批量生产页面了——而且不是那种粗糙的页面,而是有教程、有解释、能接SEO流量的功能性页面。很多用户甚至不知道他们有这个需求,直到看到这个页面才恍然大悟。

更进一步,AI可以根据用户的交互行为和对话内容,实时生成个性化的页面。“这个活动的UI是根据人的交互,以及人跟AI聊过的一些东西,直接提供给用户的。”

这些动态生成的页面还能接各种SEO流量,再导回网站,形成正向循环。上新速度可能达到“秒级”。

平台的规模效应可能被重新定义

Neko对互联网平台有一个反直觉的判断:未来可能出现“完全不需要通过规模来构建的内容平台”。

现在的小红书、抖音、携程,本质上都是规模效应——平台达到一定量级后形成网络效应,所有人只能在这个平台上发内容,否则没有流量。但如果AI已经能生产足够高质量的内容,那平台不再需要靠“比别人人多”来建立壁垒。

她甚至做了一个更大胆的判断:“绝大部分的用户交互数据很可能会变成一种噪音。”数据仍然有价值,但价值主要来源于“它所代表的使用场景”,而不是“这段对话中体现的知识的价值”。

碳基生物有一个被低估的优势:节能

Neko算过一笔账:人类一辈子消耗的能量,折算成电力大约是68,000度。按中国电价,约$4,000—5,000。地球实际土地利用效率也比大家想象得更低很多。

她的结论是偏乐观的:人类总体会更富裕、更智慧,社会的包容度也会更高。 人也能够去探索更多自己想做的事情。“反正是更闲的无聊,可以去玩,可以去恋爱,可以去研究人存在的意义,可以让一周有7天星期日。”

当然她也给了一个更“消极”的角度:“我们就是把AI引进村子里的人。有一部分人还在为了人类抵御AI,但我们正在因为别人抵御AI所以暂时有了使用AI的优势,然后以结构性的方式对抗其他人类,占据短时间的优势,做一些很自私的事情。”

她说这句话的时候在笑,但笑完又很认真。

如何看待AI:“既不是第一次,也不是最后一次”

Neko读了很多历史,她的总结是:“AI这个事情既不是第一次也不是最后一次引起社会变革的科技,也不是第一次也不是最后一次抢走人类工作机会的东西。未来还会有比现在所说的AI更强的东西。”

但在有生之年,她是比较乐观的。至少“起码不会饿死”——因为说不定未来是AI自己去种菜、去优化整个食物生产的逻辑。

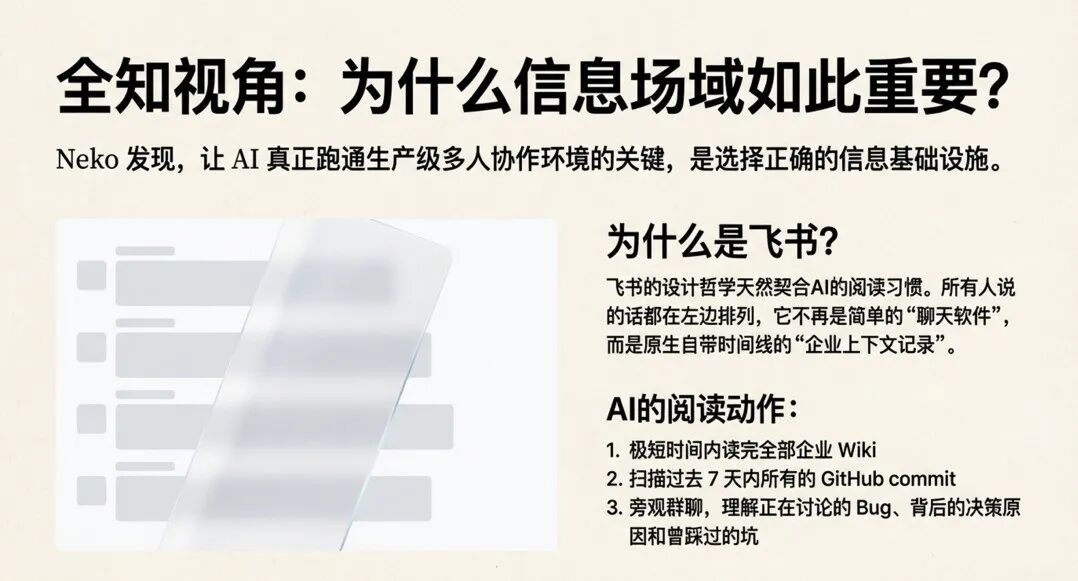

十、“为什么是飞书”以及“为什么是OpenClaw”

这两个问题直播中观众反复提及,Neko的回答我觉得值得单独拎出来。

为什么是飞书而不是Notion或微信?

Neko的核心判断是:飞书的设计哲学天然适合AI协作。 聊天记录在左边排列(而不是像微信一左一右),本身就是一种企业上下文的记录形式。飞书的文档、知识库、群聊、Bot系统是一套完整的信息基础设施,AI拉进来就能读到全局。

我自己接入了Notion,但发现Notion里放了太多公司以外的信息,Agent读起来比较费劲。Neko的潜台词是——如果你想让AI发挥最大作用,你的知识库本身就得做得比较好。 输入质量决定输出质量——Garbage In, Garbage Out。

为什么是OpenClaw而不是Claude Code或Codex?

Claude Code和Codex都能跟本地交互,但它们缺少两个关键能力:第一是进入飞书这样的生产级多人协作环境,第二是真正读取好SOP的能力。OpenClaw能在飞书里看群聊、读文档、写文档、回消息,这是Claude Code做不到的。

Neko也说了一句大实话:“如果未来有比OpenClaw更好的产品,我们迁移速度也会非常非常快。我们每天都在跟进最新的AI技术。”没有信仰,只有效率。

Will的碎碎念

我在旧金山参加一个朋友活动的时候,Neko在楼下打车时给我看了一眼手机屏幕。当时我就跪了。一个不会代码的99年CEO,通过跟OpenClaw对话把业务数据分析做到了专业Data Analyst的水平。

这不是一个关于技术多牛的故事。这是一个关于“给AI足够的上下文,它就能帮你赚钱”的故事。

Neko做对的核心就三件事:

第一,把所有数据喂给它——知识库、聊天记录、埋点、支付,不要藏着掖着,给它Context not Control。

第二,不拆分、不微操、让一个Agent理解全局——人类的分工逻辑不适用于AI,它一个人就是一整个团队。

第三,用SOP文档给它立规矩,然后放手让它干——管AI和管人一样,要有规矩也要有信任。

如果你团队有10个人,在做一个赚钱的项目,OpenClaw就能帮你把很多事搞定。关键是你愿不愿意迈出那一步。

所以我们最后的结论就是:不要小看任何一个真正在努力的年轻人,也不要小看我们自己。这个时代每个人都有无限可能,前提是你得动手。

认真对待自己的身体,认真对待每天的学习时间,克服困难,拿到一个结果。多跟拥抱技术的人交流,多跟活在明天的人交流。活在今天的人能让你吃饱饭,活在过去的人只能给你讲故事。但只要有一拨朋友是活在明天的,你的世界就轻松又愉快。

以上内容整理自郎瀚威与Neko Kazama的直播对话实录,分享了关于OpenClaw在企业中实战应用的宝贵经验。如果你想了解如何构建自己的企业级AI基础设施,或者想探讨更多关于 上下文工程 与数据驱动的实践,欢迎到 云栈社区 的 开发者广场 板块进行深入交流。