一、并行编程与图

要想高效利用硬件的并行性能,软件的抽象层和算法设计就必须做好充分的准备。在众多并行算法模型中,图(Graph) 是一种极为常见且强大的抽象。图实现并行编程的核心思想,在于将算法任务与硬件特性有机融合,通过依赖关系调度,最终达到整体执行的最优效果。

为了实现这一点,开发者需要根据不同硬件的架构特点、驱动设计以及持续的优化手段,不断调整和适配图算法本身。而NVIDIA的CUDA平台,正是在GPU编程领域将这一理念付诸实践的典范。

二、CUDA中的图

在CUDA中,图(Graph)是一种先进的工作提交模型。它由一系列操作节点(例如内核启动、数据拷贝等)构成,节点之间通过明确的依赖关系(边)连接。最关键的特性之一是,图的定义与执行是分离的。这意味着你可以一次性构建好整个工作流,然后多次重复执行它。

这种分离带来了显著的优势:

- 降低CPU开销:相比于传统的流(Stream)提交方式,图中许多设置工作(如参数配置)在定义阶段就已完成。执行时,CPU的启动开销被大幅降低。

- 全局优化机会:CUDA驱动能够看到整个工作流的全貌,从而进行更深层次的全局优化。这比流模型中分段式、增量式的工作提交拥有更大的优化空间。

举个例子来加深理解:当你通过流提交一个核函数时,CPU主机需要为内核在GPU上的执行做一系列准备工作。这些设置和启动操作,每个提交的内核都需要经历一次。如果GPU内核本身的计算时间非常短,那么这些准备工作的开销与GPU实际工作的比例就会失调,变得“得不偿失”。

而使用CUDA图,你可以将这些准备工作“打包”进图定义中,只需支付一次开销。之后,反复启动这个图即可高效执行相同的工作流,从而获得更好的整体性能。

三、图的结构

对于学习过离散数学、操作系统或图论的开发者来说,理解CUDA Graph的结构并不困难。其核心组件有两个:

- 节点(Node):代表一个具体的操作,如运行一个内核、进行一次内存拷贝。

- 边(Edge):代表操作之间的依赖关系,决定了节点的执行顺序。

节点和边共同定义了一个有向无环图(DAG)。一旦图的依赖关系建立完成,具体的调度和执行就交由CUDA系统来高效管理。

四、图的节点

如前所述,节点是图的基石。CUDA支持多种类型的节点,以适应不同的计算和同步需求,主要包括:

- 内核节点(Kernel):执行一个CUDA核函数。

- CPU函数调用节点(CPU function call):在主机端执行一个函数。

- 内存拷贝节点(Memory copy):在主机与设备之间,或设备内部进行数据拷贝。

- 内存设置节点(Memset):用指定值填充一段内存。

- 空节点(Empty node):不执行任何操作,仅用于构建依赖关系。

- 等待CUDA事件节点(Waiting on a CUDA Event)

- 记录CUDA事件节点(Recording a CUDA Event)

- 通知外部信号量节点(Signalling an external semaphore)

- 等待外部信号量节点(Waiting on an external semaphore)

- 条件节点(Conditional node):根据条件决定执行路径。

- 内存节点(Memory node):管理内存分配与属性。

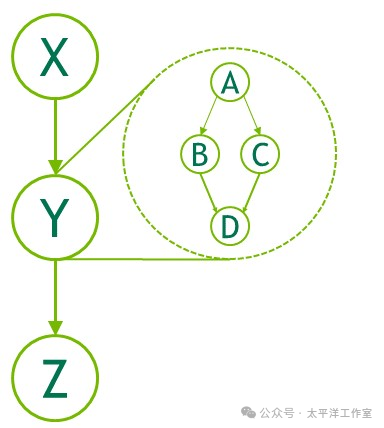

- 子图节点(Child graph):用于执行一个独立的、嵌套的图。这允许你将复杂的图模块化,如下例所示,一个主图可以调用另一个子图。

五、图的边与边数据

图的边主要功能是指引操作的执行顺序。从CUDA 12.3开始,图引入了边数据(Edge Data) 的概念,为依赖关系提供了更精细的控制。边数据通常包含三个部分:出端口、入端口和依赖类型(熟悉Intel TBB的开发者可以对比其图节点来理解)。

- 入端口(Input Port):处理来自其他节点的依赖边。

- 出端口(Output Port):处理触发后续依赖节点的边。

- 类型(Type):定义并修改端点间的依赖关系(例如,是完整的执行依赖,还是特定的内存同步依赖)。

由于CUDA图是有向的,端口的值可以根据类型和方向来设置。某些边类型可能只适用于特定的节点类型。通常,零初始化的边数据代表默认行为:

- 出口端为0:表示等待源节点整个任务完成。

- 入口端为0:表示阻塞目标节点的整个任务。

- 边类型为0:表示具有内存同步行为的完整依赖关系。

边数据可以通过图API中与节点关联的并行数组来可选地指定。如果省略输入参数,则默认用零初始化。如果省略输出参数,那么只有当所有被忽略的边数据都为零时,API才会接受;否则会返回 cudaErrorLossyQuery 错误。

此外,边数据也可以在流捕获(Stream Capture)的相关API中获取,例如 cudaStreamBeginCaptureToGraph()、cudaStreamGetCaptureInfo() 和 cudaStreamUpdateCaptureDependencies(),具体细节可参考流捕获的专题内容。

需要注意:目前只有内核节点可以定义额外的出端口,而没有节点类型可以定义额外的入端口。开发者可以通过 cudaGraphDependencyTypeProgrammatic 来定义内核节点中的程序化依赖(非默认依赖)启动。

六、总结

图作为一种经典的数据结构和算法模型,在不同的计算框架和硬件平台上,其具体实现和应用机制各有侧重。CUDA Graph的核心目标,正是为了将并行计算任务与GPU硬件以最优的方式结合。底层硬件架构、驱动设计以及框架本身的特性,共同决定了图算法最终的执行效率和机制。理解这些基础概念,是后续进行高效CUDA图编程和性能调优的第一步。

如果你想深入探讨更多CUDA或高性能计算的话题,欢迎来到 云栈社区 与其他开发者交流分享。 |