在 Windows 系统上体验和部署新兴的 AI智能体 项目,使用 Windows Subsystem for Linux (WSL) 是一种便捷高效的方式。本文将详细介绍如何在 Windows 10 或 11 系统上,通过 WSL2 完整部署 OpenClaw(小龙虾)项目,涵盖前置环境准备、核心组件安装以及基础配置的全过程。

前置环境准备

部署前,请确保你的系统已准备好以下环境:

- Ubuntu 22.04+ 系统(通过 WSL2 安装)

- Node.js 22+

- 大模型 API 及相应的 Token(用于后续配置)

步骤一:安装 WSL2 与 Ubuntu

-

启用 Windows 功能

首先,你需要启用“适用于 Linux 的 Windows 子系统”和“虚拟机平台”这两个功能。在 Windows 搜索框中输入“启用或关闭 Windows 功能”,打开设置窗口,勾选下图所示的两个选项,然后重启电脑。

-

安装 Ubuntu

打开 Microsoft Store,搜索 “Ubuntu 22.04.5 LTS” 并下载安装。首次启动安装时,可能会提示需要安装 WSL2 内核更新包。

步骤二:在 Ubuntu 中安装 Node.js 22+

打开已安装好的 Ubuntu 终端,执行以下命令来安装 Node.js 22:

# 添加 NodeSource 仓库

curl -fsSL https://deb.nodesource.com/setup_22.x | sudo -E bash -

# 安装nodeJS

sudo apt install -y nodejs

安装完成后,可以通过 node -v 命令验证版本。

步骤三:安装 OpenClaw (小龙虾)

在 Ubuntu 终端中,运行官方的一键安装脚本:

curl -fsSL https://openclaw.ai/install.sh | bash

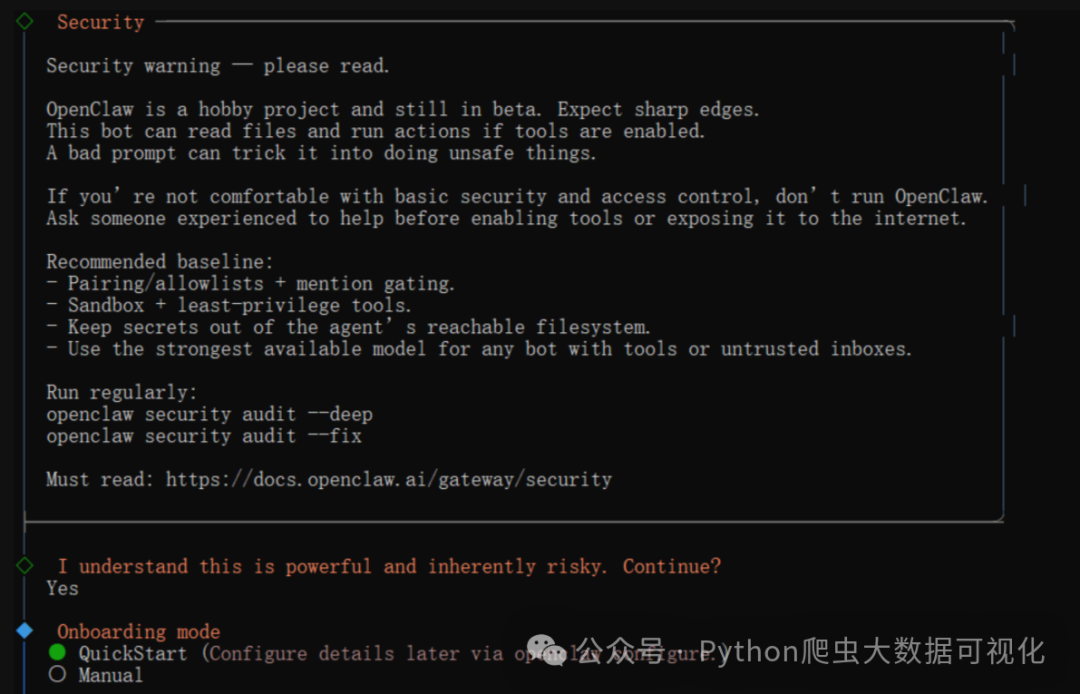

安装过程中,终端会显示安全警告。这是一个提醒,告知 OpenClaw 目前仍处于测试阶段,并且具备读取文件和执行操作的能力,需要用户具备基本的安全意识。请仔细阅读后输入 Yes 继续。

步骤四:初始配置与启动

-

选择配置模式

在安全确认后,安装程序会提示选择配置模式。为了快速体验,这里选择 QuickStart 模式。此模式会以最小配置完成基础部署,细节可以后续补充。

-

跳过高级配置

接下来的配置向导中,关于模型提供商(Providers)、技能(Skills)等选项,均可选择 Skip for now 暂时跳过。这些都可以在部署完成后通过命令行单独配置。

-

完成安装

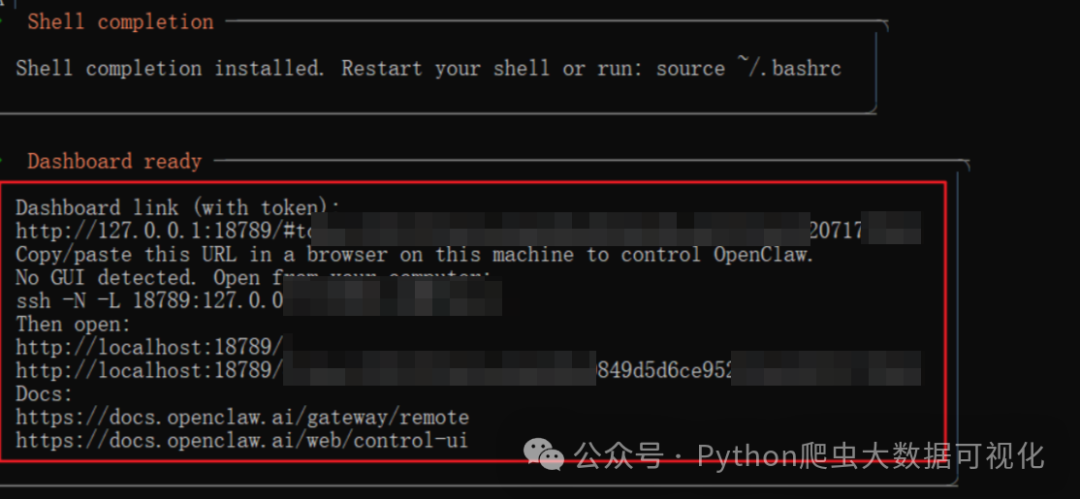

跳过配置后,安装程序会完成设置并输出关键信息。当你看到包含 Dashboard 链接和 SSH 隧道命令的输出时,即表示核心组件已安装成功。

-

启动网关服务

在终端中运行以下命令,以后台方式启动 OpenClaw 网关:

nohup openclaw gateway run > /tmp/openclaw_gc.log 2>&1 &

启动后,你可以使用上一步中得到的本地链接(例如 http://127.0.0.1:18789/#token=xxx)在浏览器中访问 OpenClaw 的 Web 控制仪表盘。

步骤五:配置模型提供商

要让 OpenClaw 真正工作起来,你需要为其配置一个大模型后端。在 Ubuntu 终端中执行:

openclaw configure --section providers

此命令会进入交互式配置,你可以添加如 OpenAI、智谱 AI 等模型提供商,并填入相应的 API Base URL 和 Token。完成配置后,你的 OpenClaw 智能体就具备了“大脑”,可以开始执行任务了。

总结与后续

至此,你已经在 Windows WSL2 环境下成功部署了 OpenClaw 智能体平台。整个过程涉及了 WSL 环境搭建、Node.js 生态依赖安装以及一个典型 开源实战 项目的部署流程。

对于刚接触 运维/DevOps 和 AI 智能体的开发者来说,在 Windows 上利用 WSL 进行学习和测试是一种低成本的入门方式。后续你可以继续探索 OpenClaw 的技能配置、多代理协作等高级功能。如果在部署过程中遇到问题,欢迎在技术社区如 云栈社区 与其他开发者交流探讨。 |