在智能化办公的趋势下,将AI能力无缝集成到企业通讯工具中,是提升团队效率的关键一步。企业微信作为国内主流的企业协同平台,其AI生态也在持续演进。

以往,当开发者尝试将像 OpenClaw 这样的高度自主AI智能体接入企业微信时,常会面临一道技术壁垒:传统的URL回调(Webhook)接入方式。这种方式不仅要求开发者拥有已备案的公网域名,还需精心配置IP白名单。一旦网络出现波动或配置稍有差池,回调就会失败,导致AI助手出现“失联”或响应不及时的情况。

为了彻底解决这一日常工作中的痛点,官方推出了支持长连接(Long Connection)机制的接入插件。这项更新移除了网络环境配置的障碍,使得私有化部署的AI智能体能够以更稳定、便捷的方式服务于企业内部流程。

核心功能解析

这次基于长连接的方案,为企业级AI应用带来了多方面的提升:

首先是连接稳定与部署门槛的降低。 长连接模式完全摆脱了对公网IP、域名备案以及IP白名单的依赖。只要部署 OpenClaw 的服务器或本地设备能够访问互联网,就能建立起稳定的双向通信通道。这从根源上解决了因回调地址不可达而导致的消息丢失问题。

其次是无缝的跨端交互体验。 通过企业微信管理后台,员工不仅可以在PC端和移动端的企业微信内直接与AI对话,还能利用“微信插件”功能生成专属关注二维码。团队成员用个人微信扫码后,即可在微信中随时唤醒并使用这个强大的企业专属助手。

最后是强大的数据与系统联动能力。 该方案原生支持与企业微信智能表格深度整合,并开放了完整的企业微信API调用权限。这意味着AI智能体可以超越聊天机器人的范畴,演变为一个能自动处理外部数据、读写内部文档、甚至调度OA系统的中枢单元。对于希望构建复杂后端 & 架构集成的团队来说,这提供了丰富的可能性。

详细使用与接入方式

开始配置前,请确保已安装最新版企业微信客户端,并在本地或云端服务器上成功部署了OpenClaw运行环境。

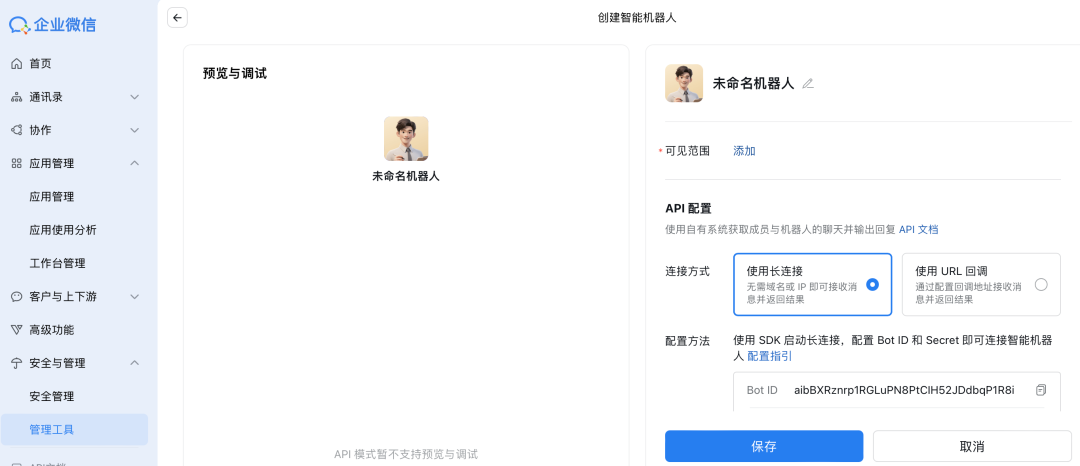

第一步:创建长连接智能机器人

这一步至关重要,且需要管理员权限。如果操作者权限不足,在创建界面将看不到API模式的选项。

- 登录企业微信客户端,进入“工作台”。

- 找到并点击“智能机器人”应用,选择“创建机器人”。

- 配置好可见范围后,务必选择“API模式”进行创建。

- 在接下来的连接方式中,勾选 “长连接”。

- 创建成功后,系统会生成一对核心凭证:

Bot ID 和 Secret。请务必妥善保存,这是后续连接的关键。

第二步:终端环境配置与插件安装

这里以在本地终端部署OpenClaw为例。打开命令行工具,依次执行以下命令来安装官方插件并启动服务:

# 安装企业微信官方插件

openclaw plugins install @wecom/wecom-openclaw-plugin

# 启动OpenClaw网关服务

openclaw gateway start

# 添加并配置新的通讯渠道

openclaw channels add

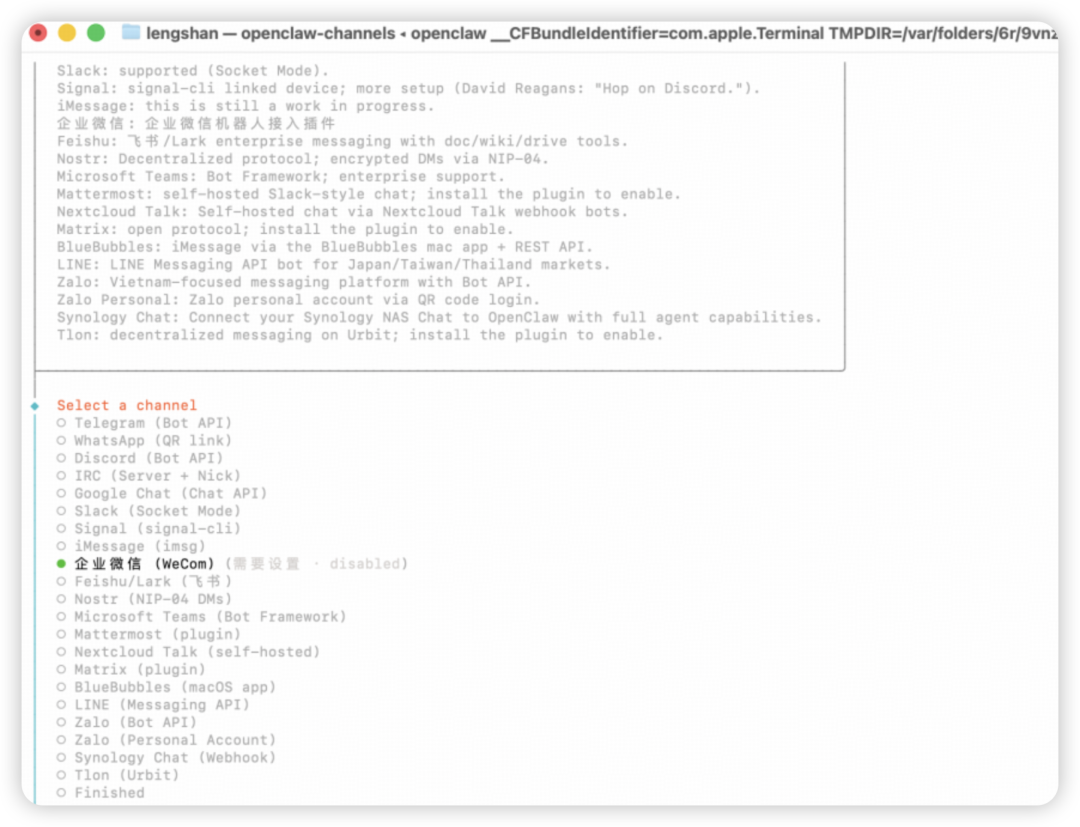

执行 openclaw channels add 命令后,终端会进入交互式配置流程:

- 在渠道列表中,使用方向键选择 企业微信(WeCom)。

- 根据提示,依次输入第一步获取到的

Bot ID 和 Secret。

- 选择完成后,在认证方式中选择 配对(Pairing)。

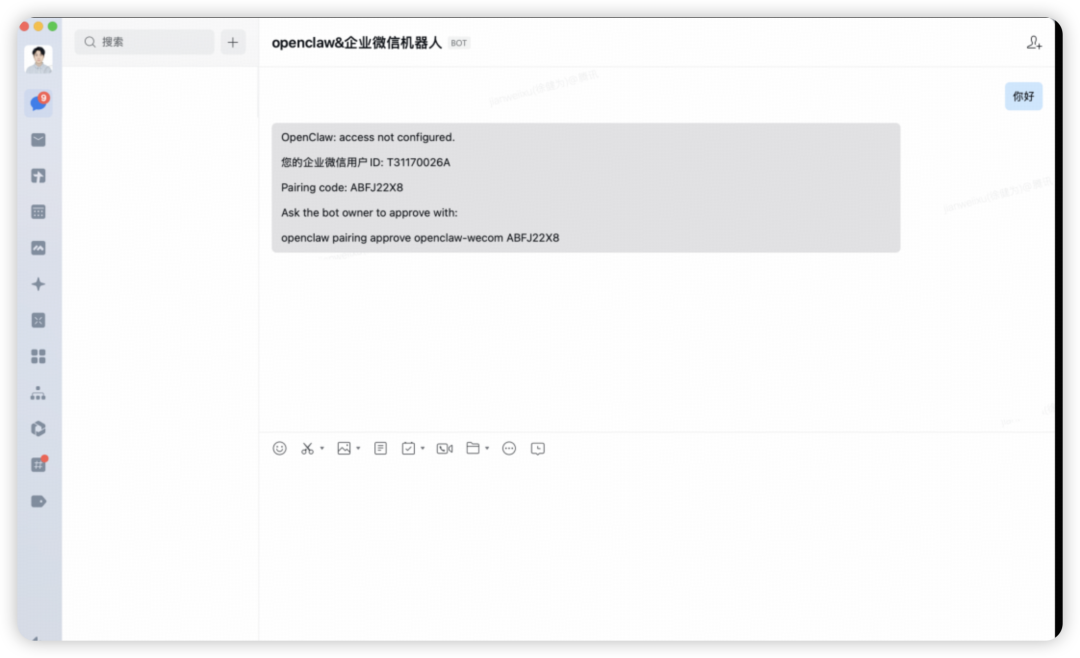

此时,请回到企业微信,向刚刚创建的机器人发送任意消息。机器人会回复一段包含配对码的系统信息。复制信息的最后一行指令,将其粘贴回仍在等待的终端窗口中,即可完成安全配对。看到终端提示渠道配置成功,核心链路就打通了。

第三步:打通个人微信与探索高阶应用

为了使用更方便,管理员可以在企业微信后台的“我的企业” -> “微信插件”中,找到“邀请关注”板块的专属二维码。团队成员用个人微信扫码关注后,就能在微信对话列表中找到该智能体。

基础对话功能实现后,可以通过赋予 OpenClaw 更高权限来挖掘其业务价值。这通常需要仔细查阅相关的技术文档并配置相应的API密钥:

智能表格联动(Webhook): 在企业微信智能表格中开启“接收外部数据”功能,获取专属的Webhook地址。将该地址配置给OpenClaw后,AI就能将外部信息自动写入表格。例如,让AI定时抓取行业数据或业务系统的订单流,清洗后自动归档。

企业微信API深度调用: 在管理后台的“自建应用”中获取企业ID(CorpID)和应用密钥(AppSecret)。将这两个参数配置给OpenClaw,它便能自动获取Access Token,进而调用更多官方API,实现如自动拉取内部文档、群发通知等复杂工作流。

总结

基于长连接的官方插件,是企业微信生态与开源AI运行时结合的一次重要优化。它以一种优雅的方式,解决了过去困扰开发者的网络穿透与鉴权难题,让构建高度自主的企业级AI助手变得触手可及。

在享受AI带来的效率提升时,也需注意高频自动化调度可能产生的Token消耗。建议团队在实际部署前,对底层大语言模型服务进行合理的成本规划。目前主流云服务商都提供了性价比不错的套餐,这为中小企业低成本试错并全面拥抱AI工作流提供了可能。整个配置过程本身,也是一次有趣的开源实战体验。