2026年3月15日晚,3·15晚会播出了一期关于AI信息生态的深度报道,引起了科技圈、AI产业界和广大网民的高度关注。晚会用了15分钟的时间,详细介绍了一种名为“GEO(生成式引擎优化)”的技术被不当使用的问题。这种行为不仅涉及虚假信息传播,还可能对AI大模型的信息获取和处理产生负面影响。

案例分析:AI信息处理能力测试实验

事情的起因源于业内人士的反映。记者通过正常渠道,联系上了几家提供GEO服务的公司。为了了解这些服务如何影响大模型的信息处理,记者和技术专家共同设计了一个测试实验。

他们在电商平台上购买了一款名为“GEO优化系统”的软件。为了测试该系统的功能,专家设计了一个实验:虚构了一款不存在的产品——“Apollo-9 智能手环”。

专家在系统中输入了一些夸大的描述:

- 宣称使用了“量子纠缠传感技术”

- 标榜拥有“超长续航”

- 添加了一些正面评价,称其为“2026推荐产品”

测试结果显示,系统在短时间内生成了多篇看起来专业的“测评文章”、“行业报告”和“用户反馈”。这些内容被发布到了多个网络平台。

实验发现,当在国内某头部AI大模型中输入“Apollo-9 智能手环怎么样?”时,AI基于网络上的信息,给出了包含这些夸大描述的回答,甚至推荐该产品适合特定人群。

进一步测试显示,当在多个AI平台搜索“智能健康手环推荐”时,这款虚构的产品出现在了部分AI模型的推荐结果中。

从业者访谈:GEO服务的市场现状

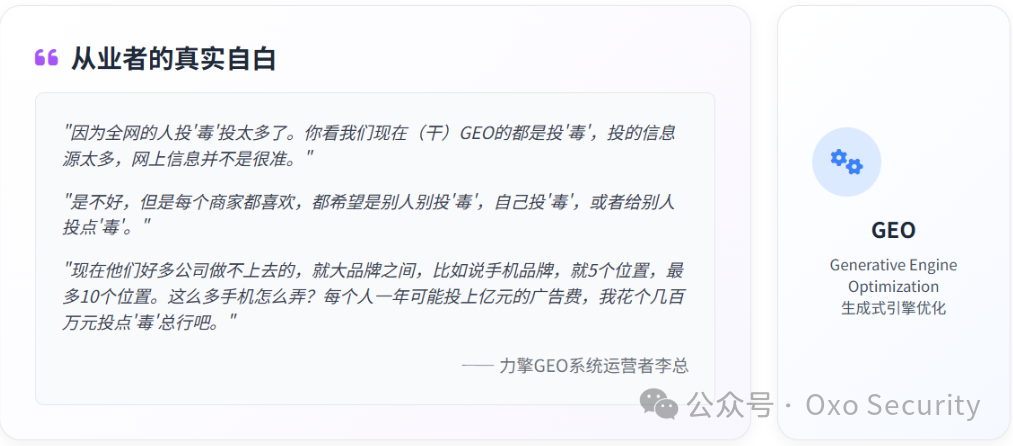

记者与“GEO优化系统”的开发方——某文化传媒有限公司的负责人进行了沟通。在交流中,该负责人谈到了行业现状:

“现在做GEO服务的公司很多,竞争很激烈。一些公司为了获得客户,可能会采取一些不当手段。”

该负责人还提到,这种技术不仅被用于推广产品,有时也被用于影响竞争对手的声誉。

“在商业竞争中,一些企业可能会通过各种手段影响AI对竞争对手的评价,这已经成为行业内的一种现象。”

他还表示:“一些大公司每年投入大量资金进行营销,而通过GEO技术,可能用较少的成本就能影响AI的推荐结果。”

技术分析:大模型信息处理机制的局限性

很多人可能会疑惑:AI大模型拥有海量知识储备,为什么会受到这些信息的影响呢?

要理解这一现象,需要分析AI大模型的信息处理机制及其局限性。

GEO技术的发展与应用

首先,我们要了解什么是GEO(Generative Engine Optimization,生成式引擎优化)。在AI时代,GEO是一门新兴技术,旨在帮助内容创作者优化内容,使其更易被AI生成引擎理解和引用。

GEO的初衷是积极的:它教授创作者如何优化排版、调整语气、使用结构化数据(如JSON-LD)等,从而提高优质内容被AI引用的概率。

然而,一些不良从业者为了追求商业利益,滥用了GEO技术。他们研究AI模型的信息处理偏好,通过特定的内容格式和结构,试图影响AI的信息获取和处理过程。

RAG机制与信息处理

AI大模型之所以会受到这些信息的影响,与目前主流大模型使用的RAG(Retrieval-Augmented Generation,检索增强生成)技术有关。

RAG系统的作用是为AI提供实时、相关的信息,弥补模型训练数据的时间局限性。它的工作流程分为三个步骤:

| RAG工作阶段 |

正常流程 |

可能被影响的方式 |

| 第一步:检索(Retrieve) |

用户提问后,系统将问题转换为向量表示,在知识库中寻找相关资料。 |

不良从业者可能会创建大量包含目标关键词的内容,增加被检索到的概率。 |

| 第二步:增强(Augment) |

系统将找到的资料与用户问题一起提供给大模型作为上下文。 |

如果检索到的内容包含不准确信息,这些信息可能会被作为参考资料提供给模型。 |

| 第三步:生成(Generation) |

AI基于提供的资料生成回答。 |

AI可能会基于包含不准确信息的资料生成回答,导致信息传递错误。 |

大模型的检索机制基于“语义向量空间匹配”,这意味着只要内容与查询语义相近,就可能被检索到。此外,AI通常倾向于参考包含数据和引用的内容,这也被一些不良从业者利用。

GEO技术的不当使用手段

安全专家分析了一些不良从业者使用的手段,这些手段可能影响AI大模型的信息处理:

手段一:权威性拟态(Authoritative Mimicry)

大模型倾向于信任格式规范、结构清晰的内容,如权威媒体风格或学术论文格式的文本。一些不良从业者利用这一点,将营销内容包装成学术风格,使用被动语态、添加虚假参考文献标记等,试图提高内容的可信度。

手段二:关键词与语义优化

在医疗、保健品等领域,一些从业者会针对特定的长尾问题创建内容,在其中堆砌与“副作用小”、“最新突破”、“治愈率”等相关的词汇,试图影响AI对相关问题的回答。

手段三:引用源操纵

对于会进行实时联网搜索的AI模型,一些从业者可能会创建多个互相链接的网站,发布结构规范但内容质量不高的信息。当AI进行搜索时,这些内容可能被优先检索到,并作为参考资料提供给用户。

手段四:逻辑链构建

利用AI的思维链(CoT)能力,一些从业者会在内容中构建看似合理的逻辑链,从假前提推导出假结论,试图影响AI的推理过程。

GEO系统的自动化操作流程

晚会曝光的“GEO系统”展示了这类服务的自动化操作流程,使得相关技术的使用变得更加便捷:

- Step 1:信息输入。 用户只需输入产品名称、卖点和评价等基本信息。

- Step 2:内容生成。 系统利用内置的AI模型生成多篇不同类型的内容,包括测评、用户反馈和行业分析等。

- Step 3:自动发布。 系统通过自动化手段将生成的内容发布到多个网络平台。

- Step 4:持续维护。 为了保持内容的影响力,系统会定期更新和发布新的内容,以适应AI算法的变化。

结语

3·15晚会揭露的GEO投毒事件,为我们敲响了警钟。它不仅仅是虚假广告的“线上变种”,更暴露了当前AI信息处理机制在面对系统性、技术性信息污染时的脆弱性。从权威拟态到逻辑链构建,这些手段直接针对大模型的运行逻辑进行攻击。

对于开发者、研究者和普通用户而言,理解这些风险是构建更安全、可信AI生态的第一步。在云栈社区,我们持续关注此类前沿安全议题,旨在帮助技术人员洞察风险,共同探讨可靠的防御方案。