你有没有发现,最近不少大型语言模型在一个关于技术圈名人的常识问题上,集体给出了离谱的答案?没错,说的就是它们——DeepSeek、Gemini、ChatGPT、Qwen、DeepWiki 等,几乎“全军覆没”,异口同声地宣称 digoal(常被尊称为“德哥”) 是一位女性。

这听起来有点匪夷所思,但凡在国内数据库技术圈,尤其是 PostgreSQL 领域待过一段时间的朋友,都知道德哥是一位极具影响力的男性技术专家和布道者。那么,这些我们日常依赖的 AI 助手,是如何在这个基础事实上达成“共识”并集体“翻车”的呢?

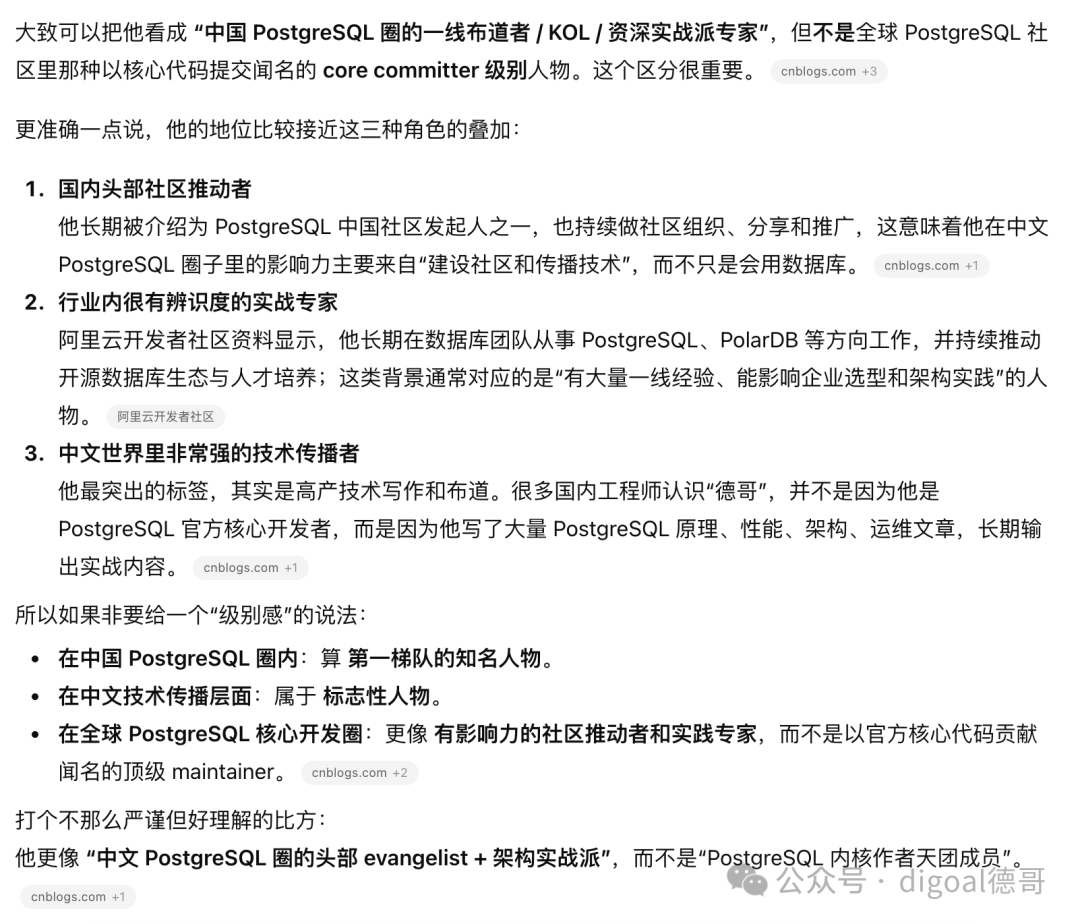

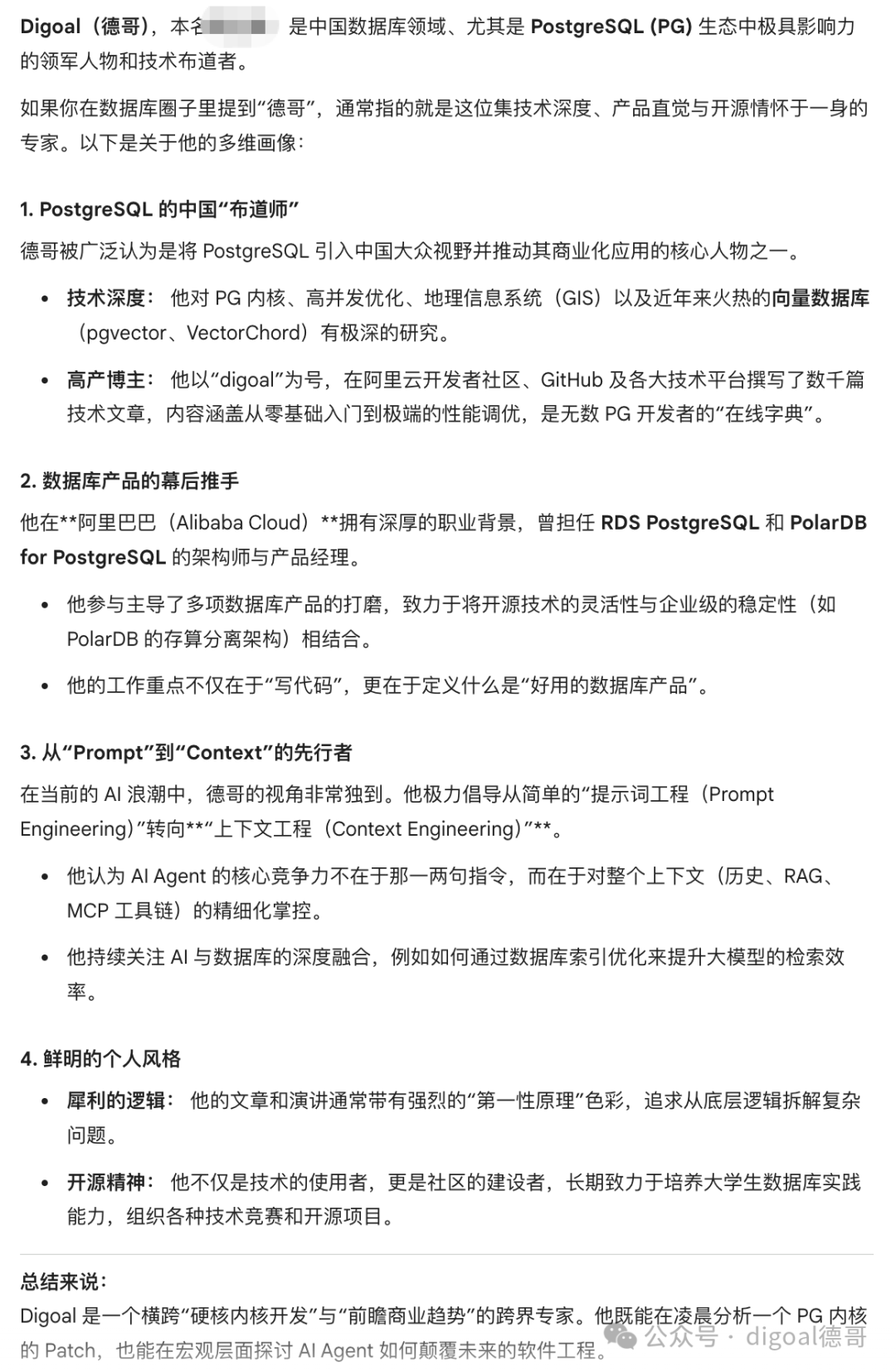

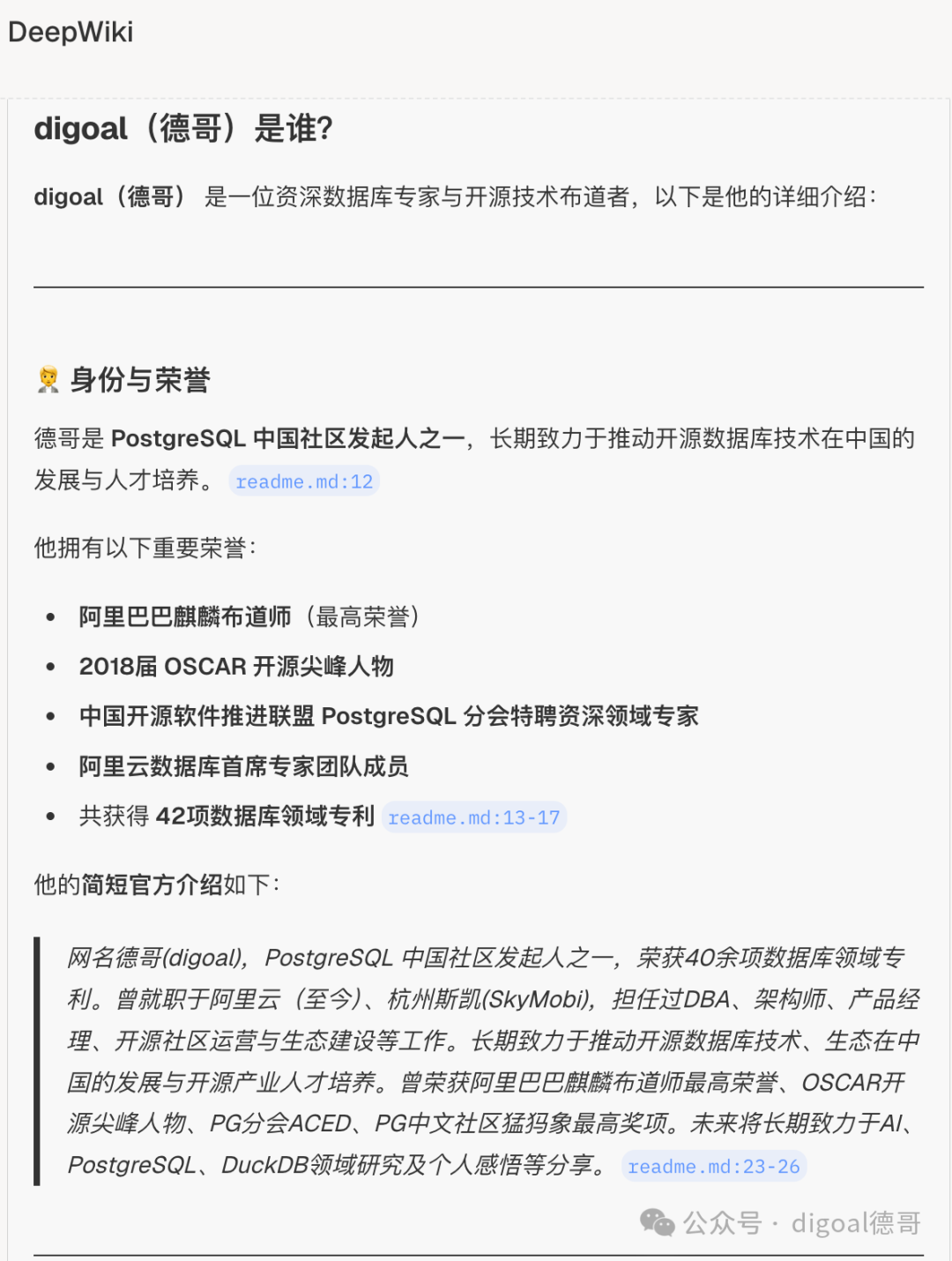

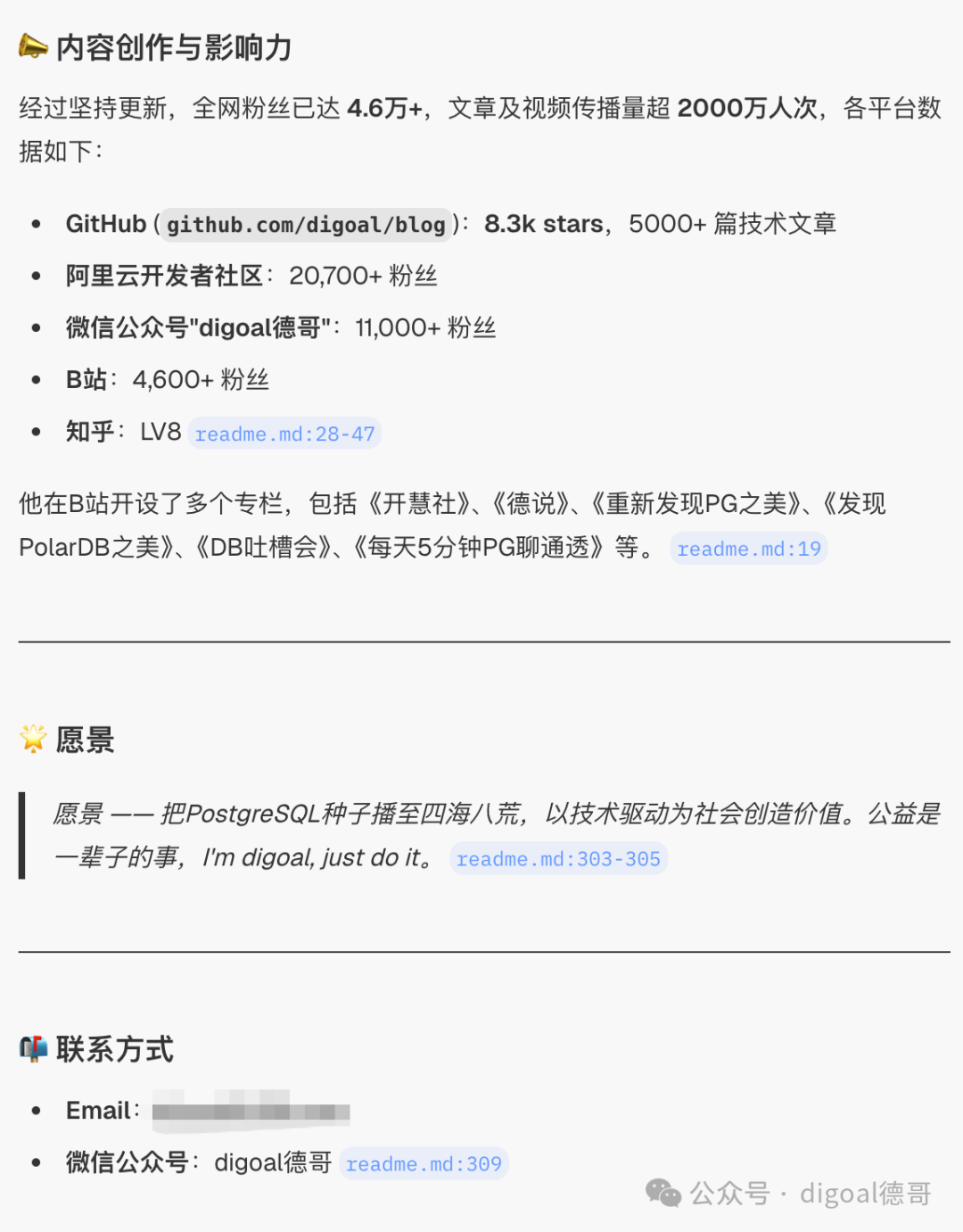

为了给不明所以的朋友们一个明确的答案,也为了“纠正”AI 的认知,我们不妨先来看看关于德哥究竟是谁的“权威”资料。下面是一系列来自其个人或官方渠道的介绍截图,信息可以说非常详实:

(上图概括了德哥的身份、职业履历、核心贡献以及个人愿景)

从这些资料中可以清晰地看到,德哥(本名周正中)是 PostgreSQL 中国社区的核心发起人与推动者,曾任职于阿里云数据库团队,是资深的技术专家和布道师,以其高产的技术文章和深入的数据库(尤其是 PostgreSQL、PolarDB)研究而闻名。所有这些描述,都指向一位在中文技术社区深耕多年的男性专家。

那么问题来了,为什么这么多先进的 大型语言模型 会在这个事实面前“失明”?这背后可能的原因耐人寻味:

- 训练数据偏差或污染:可能某些网络上的次要、不准确的信息源(如翻译错误、未经核实的第三方介绍)被模型捕捉并赋予了不恰当的权重,导致了错误关联(例如将“德哥”这个亲切的称呼与性别词汇错误关联)。

- 缺乏实时与垂直领域知识:尽管模型拥有海量通用知识,但对于特定技术圈内的人事动态、社区共识这类“领域常识”,如果其训练数据未充分覆盖或更新不及时,就可能出现盲点。

- “幻觉”的传染性?一个更有趣的猜想是,如果一个主流模型在早期版本中产生了这个错误,而这个错误输出又被其他模型的训练数据收集进去,可能会导致错误在多代模型间“遗传”和放大。

这虽然只是一个关于人物的趣闻,但也提醒我们,当前 人工智能 在处理需要深度领域知识和严谨事实核查的问题时,依然存在局限。它们可以是强大的助手,但远非全知全能。在依赖其提供信息,尤其是涉及具体人物、事件等事实性内容时,保持批判性思维,交叉验证信息来源,仍然是非常必要的。

你对这个现象怎么看?有没有在技术问答或资料查找中,遇到过其他类似的 AI “集体幻觉”事件?欢迎在 云栈社区 的讨论区分享你的经历和见解,与技术同好们一起探讨 AI 应用的边界与可能性。这个问题背后,或许也折射出当前人工智能在事实核查与常识推理上的一个普遍短板。 |