最近,一篇由阿里巴巴集团与中山大学联合发表的AI编程相关研究,在社交平台X上引发了广泛讨论。

研究团队通过一场持续233天、消耗高达100亿token的大规模实验,对主流的18个AI智能体在真实代码库上的“耐力”进行了极限测试。实验结果指向一个令开发者五味杂陈的结论:当前大多数AI并非合格的代码维护者,而是在高效地“制造技术债务”。

一项在X平台获高赞的帖子,由微软前产品故事讲述者Priyanka Vergadia分享,总结了这一研究的核心发现:人工智能编程或许不会抢走开发者的工作,因为它正忙于编写那些需要人类在未来十年不停修复的“遗留代码”。

正如一些业内人士指出的,这项研究更深层的意义在于,它建立了一个真正有价值的“评分系统”,将评估重点从“一次性修复”转向了“长期可持续性”。

打破泡沫:一次性修复不等于真正的“编程”

这篇名为《SWE-CI: Evaluating Agent Capabilities in Maintaining Codebases via Continuous Integration》的论文,指出了一个普遍存在但长期被忽视的问题:如何评估AI在长期软件开发中的表现。

目前,绝大多数AI 智能体在HumanEval或SWE-bench这类“一次性考试”中表现出色,能快速解决一个明确的Bug。然而,现实中的软件开发是动态演进的:今天修复Bug,明天需求变更,后天依赖库升级。

这种持续演进的过程,无法被静态、一次性的修复测试所刻画。

因此,阿里与中山大学的研究团队提出了一种全新的评估标准:衡量一个AI的能力,不应只看它能否修复眼前的Bug,而要看它能否在长达数月甚至半年的项目演进周期中,保持代码库的稳定,不引入新的缺陷。

SWE-CI:一场长达233天、消耗百亿token的“极限耐力赛”

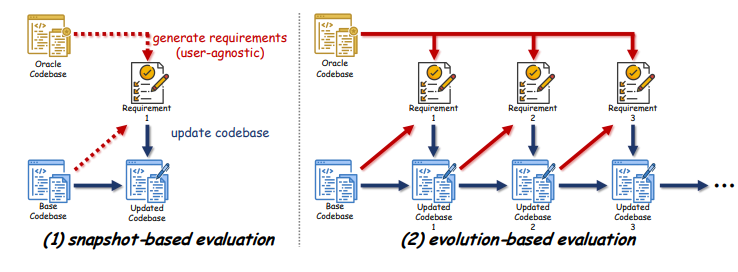

为了真实测试AI代理的“抗压能力”,研究团队构建了一个全新的基准——SWE-CI。这是一个基于持续集成流程的代码仓库级评估基准,首次将AI编程评估从“一次性快照”转向“长期演化”。

SWE-CI包含100个源自真实项目的任务,每个任务都对应一个真实代码仓库中平均233天、包含71次连续提交的演进历史。你可以将其理解为一场对AI智能体极为残酷的“耐力赛”。

- 真实战场:任务时间跨度长,平均达233天,涉及71次连续提交。

- 模拟人类:AI需要像真实开发者一样,在持续集成的循环中,应对一轮又一轮的需求变更。

- 残酷规则:总计算消耗超过100亿Token。

实验设置的核心细节如下:

每个SWE-CI任务都来自GitHub上68个真实的Python仓库(维护≥3年、≥500星、包含单元测试和依赖配置文件)。

任务定义为:让智能体驱动代码库从“基线提交”演进到“目标提交”。这个过程平均跨越233天、71次提交、至少500行源码变更(不含测试)。智能体在Docker隔离环境中,通过最多20轮迭代,逐步完成这些需求变更。

值得注意的是,实验采用了双Agent架构来模拟真实开发流程:

- 架构师Agent:负责分析失败的测试、定位根因,并输出高层次的需求文档。

- 程序员Agent:遵循测试驱动开发流程,实际修改代码。

整个过程模拟了真实的CI/CD流水线,每一次变更都会影响后续状态,前期决策的后果会逐步累积,这正是传统基准无法模拟的“长期记忆”与“技术债务放大器”。

相应的,评估指标也升级为两个核心维度:

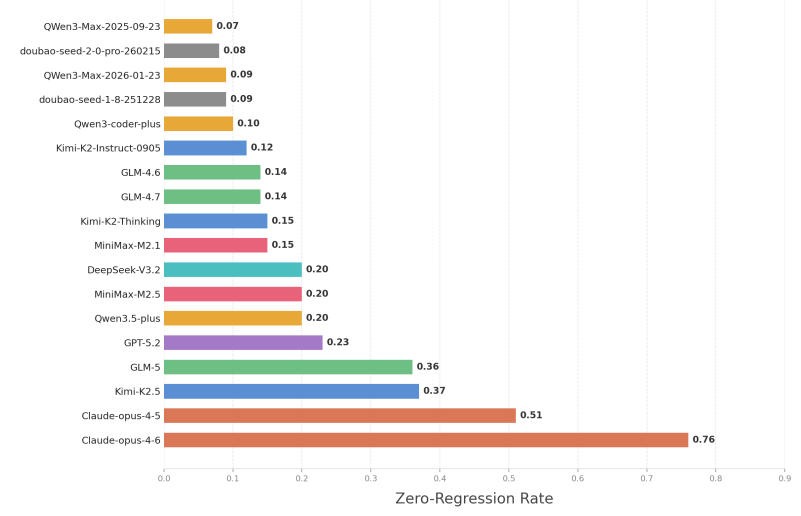

- 零回归率:在任务演化过程中,最初通过的测试在后续变更后仍保持通过的比例。

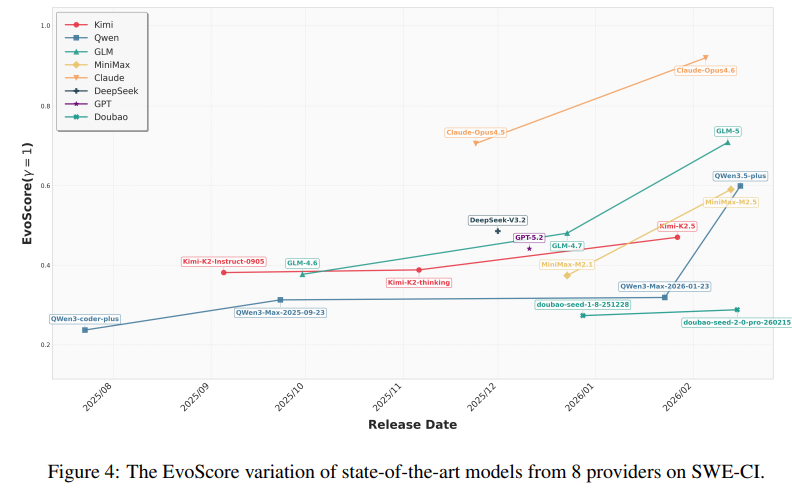

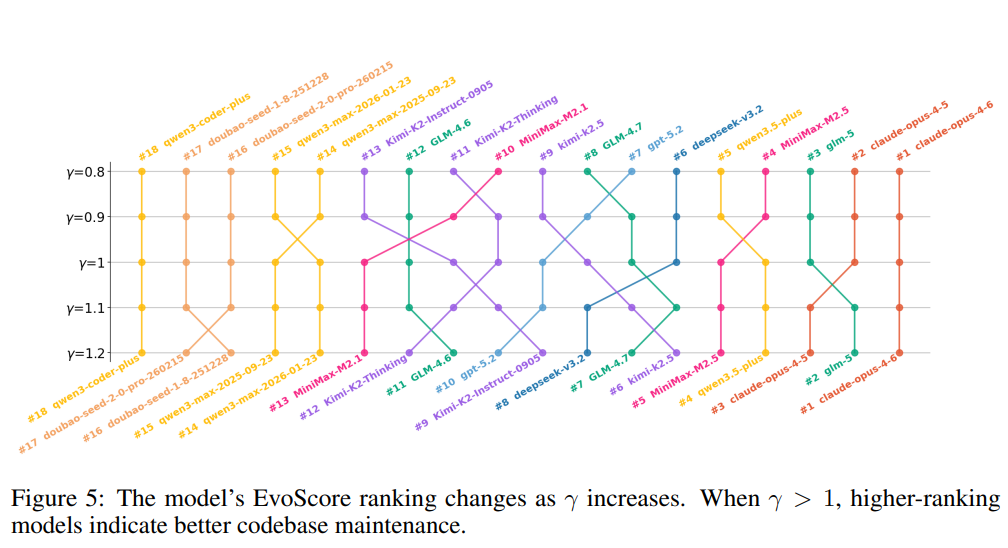

- EvoScore:一种加权平均指标,其公式为 EvoScore = Σ(i=1 to N) γ^i × a(ci) / Σ(i=1 to N) γ^i。其中γ>1时,会对后期迭代赋予更高权重,强调长期稳定性;当γ=1时则退化为普通平均。

战况惨烈:75%的AI正在疯狂制造“技术债务”

实验结果令人印象深刻。即便在2026年,主流AI智能体的表现依然暴露出其在长期维护上的巨大短板。

首先,“零回归率”普遍惨不忍睹。在模拟长期开发的测试中,绝大多数大模型的“零回归率”竟然不到25%。这意味着,这些模型每进行四次代码修改,至少有三次会破坏原本正常的功能。

其次,技术债务指数级累积。随着项目演进,大多数模型产生的技术债务呈指数级增长。前期看似高效的修改,可能在后期引发系统级的“雪崩”。

那么,在这场残酷的耐力赛中,谁是最后的赢家?

如果你关注AI编程领域,答案或许并不意外:Claude 4.5/4.6。它是唯一能在长周期维护中保持50%以上零回归率的选手,展现了强大的“架构师思维”和稳定性。

值得注意的是,国产大模型GLM-5的表现同样亮眼,在应对长期代码演进时稳居第一梯队。

研究发现:不同AI智能体呈现出鲜明的“人格”倾向

论文中还揭示了一个有趣的现象:不同模型厂商的智能体表现出显著的风格差异,而同一厂商下的模型则倾向一致。

- “救火队长”型:如Kimi、GLM等模型,在修改代码时更为激进,追求立刻解决当下的问题,但可能较快耗尽代码库的长期演进空间。

- “长线规划”型:如GPT、DeepSeek、MiniMax等模型,修改时更谨慎,会考虑代码结构对未来的影响,更具“架构师”潜质。

- “全能稳健”型:如Claude、Doubao、Qwen等模型,无论在短期还是长期考量下,表现都较为均衡。其中Claude更是稳定性与能力上限结合得最好的选手。

研究团队通过调整EvoScore公式中的γ参数来验证这一点。当γ<1时,模型早期迭代的收益被放大,有利于追求“即时收益”的模型;当γ>1时,后期迭代获得更高权重,则有利于为“长期改进”优化的模型。

这种差异可能反映了不同厂商在训练策略和价值观上的侧重,而厂商内部的一致性则表明其训练流程相对稳定。

为什么AI容易积累技术债务?未来路在何方?

论文间接指出了AI在代码维护中表现不佳的原因:

- 追求短期最优:模型倾向于选择“最快通过当前测试”的方案,而非全局最优的架构设计。

- 上下文遗忘:在多轮迭代中,模型对早期变更带来的深层影响缺乏持续、深刻的理解。

- 真实环境的复杂性:真实代码库的外部依赖、配置漂移和边界案例,远超模型训练数据所能覆盖的范围。

这意味着,如果一家公司大规模采用AI生成代码,初期交付速度可能大幅提升,但6~12个月后,维护成本(如Bug修复、重构、迁移的难度)可能会呈指数级上升。

这篇研究并非旨在否定AI编程的价值,而是提供了一面“镜子”和一个“诊断工具”。SWE-CI的意义在于,它将AI编程的门槛从“能跑通”提升到了“可维护”的实用层面。

研究者为优化方向提出了几点建议:

- 在评估中提高对长期稳定性的权重(提高γ值),以鼓励模型进行长远规划。

- 优化双Agent架构,例如引入“回顾Agent”来反思历史决策。

- 将AI与现有开发工具链(如自动生成维护文档、回归测试优先级排序)深度结合。

项目已开源,欢迎社区参与

目前,SWE-CI的开源实战仓库及相关数据集已在GitHub和Hugging Face上线,任何人都可以复现、验证并扩展这一基准。

这标志着,未来AI编码能力的竞赛赛道,很可能将从“谁写得快”转向“谁写得稳”。

网友热议:AI自动化了技术债务的生产线?

研究结论在开发者社区引发了广泛共鸣和讨论。许多网友感叹:AI生成代码的速度越快,技术债务积累的速度也就越快。

有评论尖锐地指出:“我们投入千亿美元算力,难道就为了完美模拟一个‘快速交付、八个月后留下一堆烂摊子的初级开发者’吗?”

也有人提出了更深层的思考:“当SWE-CI成为新的评估标杆后,AI编程工具的估值逻辑是否需要重写?”

正如论文所言:“智能体的代码维护能力只有通过长期演化才能显现,过去决策的后果会在连续变更中累积。” 这深刻地揭示了一个事实:写代码 ≠ 维护系统。

软件工程的核心远不止于代码生成,更在于管理复杂性、演进系统架构,以及在无数次变更中保持系统核心属性的稳定。当前的AI智能体,在这一层面的挑战面前,依然显得力不从心。

这项研究或许预示着,下一代开发者工具的重心,将从“生成代码”逐渐转向“理解系统”。而对于开发者而言,真正的价值将愈发体现在对系统的深刻理解、清晰的架构判断和高效的风险管理能力上。

无论你是感到庆幸还是焦虑,这场关于AI编程能力的讨论都已在云栈社区等开发者广场中热烈展开。软件开发的未来图景,正在这样的研究与争鸣中被重新描绘。

论文原文地址:

https://arxiv.org/pdf/2603.03823