🔥Token 是新大宗商品、英伟达路线图公布、发布NemoClaw、组建Nemotron 联盟🔥

英伟达 GTC 2026 主题演讲落幕。

黄仁勋发布 Vera CPU、Groq LPU、Vera Rubin 系统与 DLSS 5。

黄仁勋公布未来 12 个月 AI 蓝图。

黄仁勋GTC演讲直播略有推迟,开场英伟达播放大量乡村音乐,意外出圈(疑似AI生成)。

2026 年 3 月 17 日 凌晨 2:18 正式开始!

虽然晚了几分钟,但演讲正式启动。

开场播放短片,讲述 AI Token 以及我们用它在医疗、航天、建筑等领域所做的一切。

2026 年 3 月 17 日 凌晨 2:21

主角登场:CEO 黄仁勋

黄仁勋身着标志性皮夹克登台——抱歉,今年没有特别款夹克。

他开场感谢了预热环节的嘉宾。

2026 年 3 月 17 日 凌晨 2:24

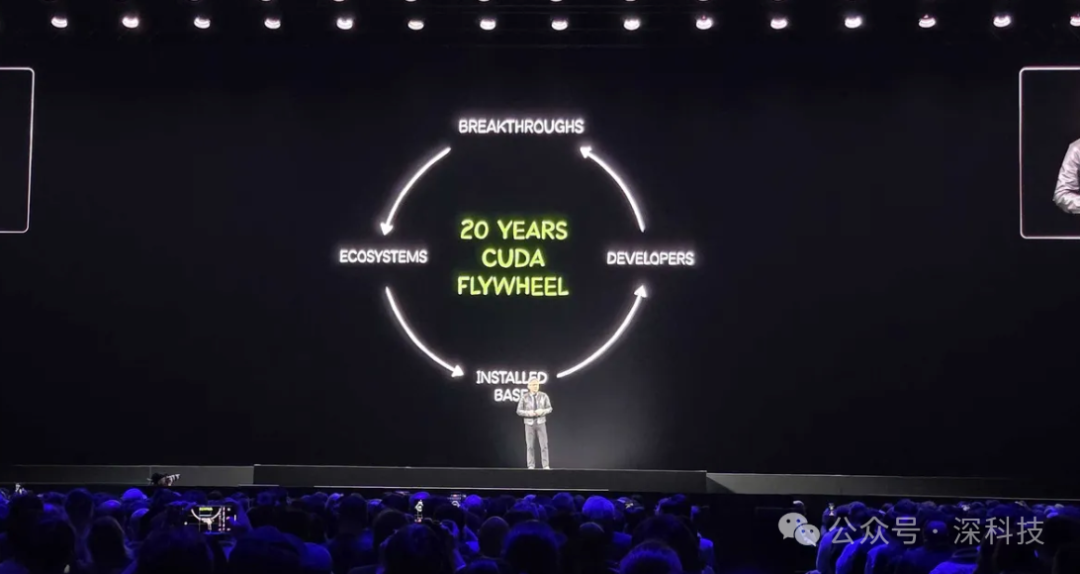

“我们深耕 CUDA 已有 20 年”

CUDA 是英伟达今天地位的核心原因之一,本届 GTC 正值 CUDA 20 周年。

“最难的一件事,是建立起我们的用户基数——我们进入了每一朵云、每一家计算机公司、每一个行业。”

2026 年 3 月 17 日 凌晨 2:26

云端 Ampere 价格反而在上涨

CUDA 的普及形成了英伟达所谓的“飞轮效应”:

吸引开发者 → 开发者基于 CUDA 开发 → 更多人采用英伟达硬件 → 循环持续。

正因如此,黄仁勋表示,老旧 Ampere 架构 GPU 在云端的价格反而上涨。

2026 年 3 月 17 日 凌晨 2:28

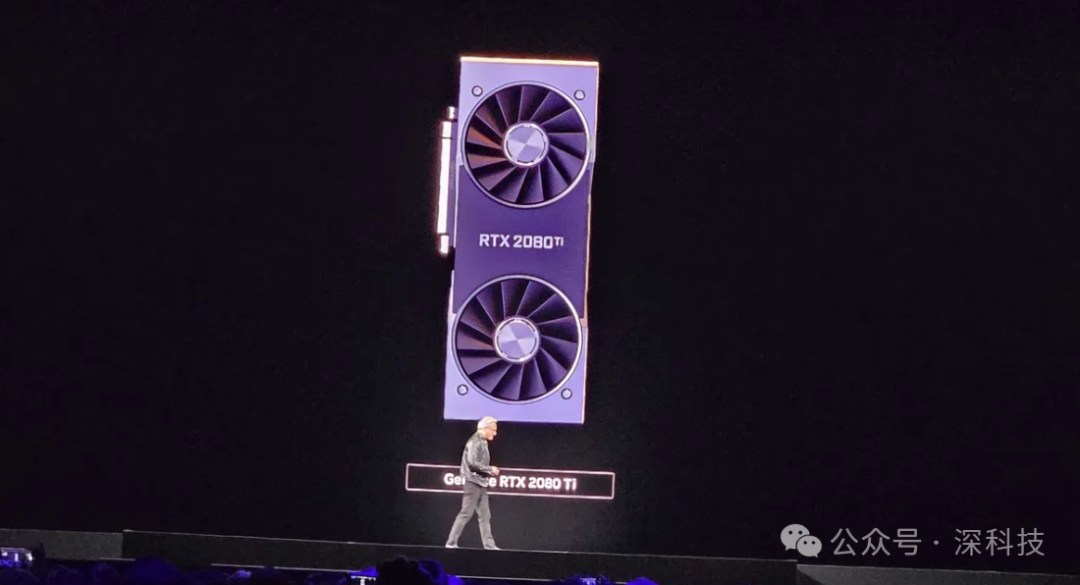

“GeForce 是英伟达最成功的营销”

黄仁勋表示:“GeForce 是英伟达最棒的营销活动。”

他回顾:25 年前英伟达创造了首个可编程着色器,最终发展出 CUDA,并以 GeForce 作为普及载体。

2026 年 3 月 17 日 凌晨 2:30

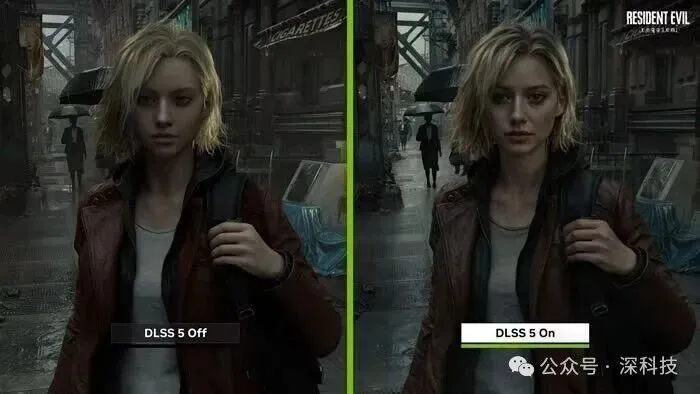

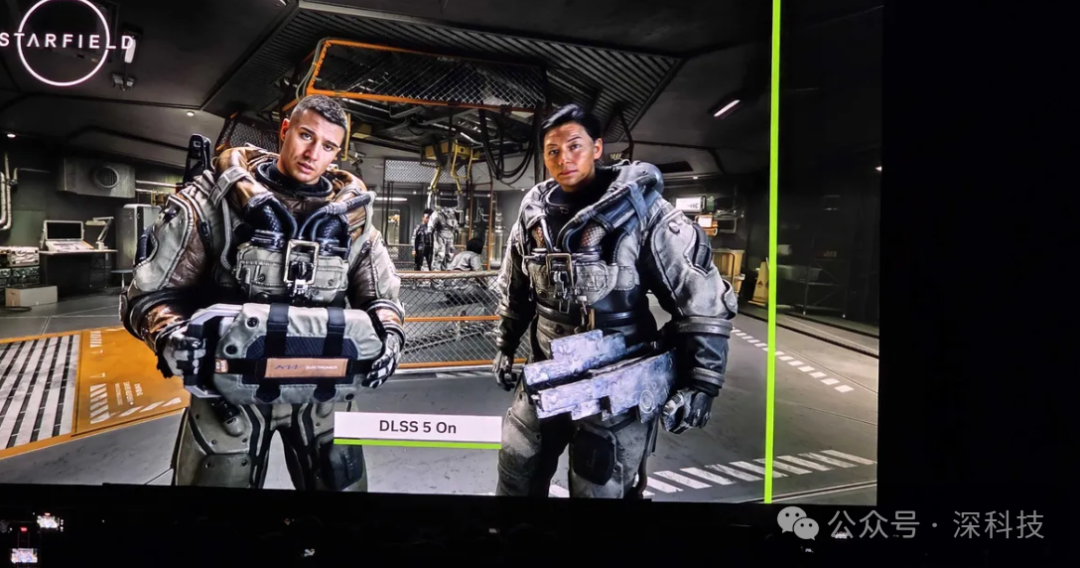

英伟达公布下一代计算机图形技术:DLSS 5

首个重磅发布:DLSS 5。

英伟达在《生化危机:安魂曲》《霍格沃茨之遗》《星空》中进行展示。

大家都在期待 DLSS 5 的具体细节,而对比画面已极具说服力。

DLSS 5 是什么?

英伟达将可控 3D 图形、结构化数据与生成式世界结合。

“结构化数据与生成式 AI 融合的理念,将在一个又一个行业重演。”

2026 年 3 月 17 日 凌晨 2:34

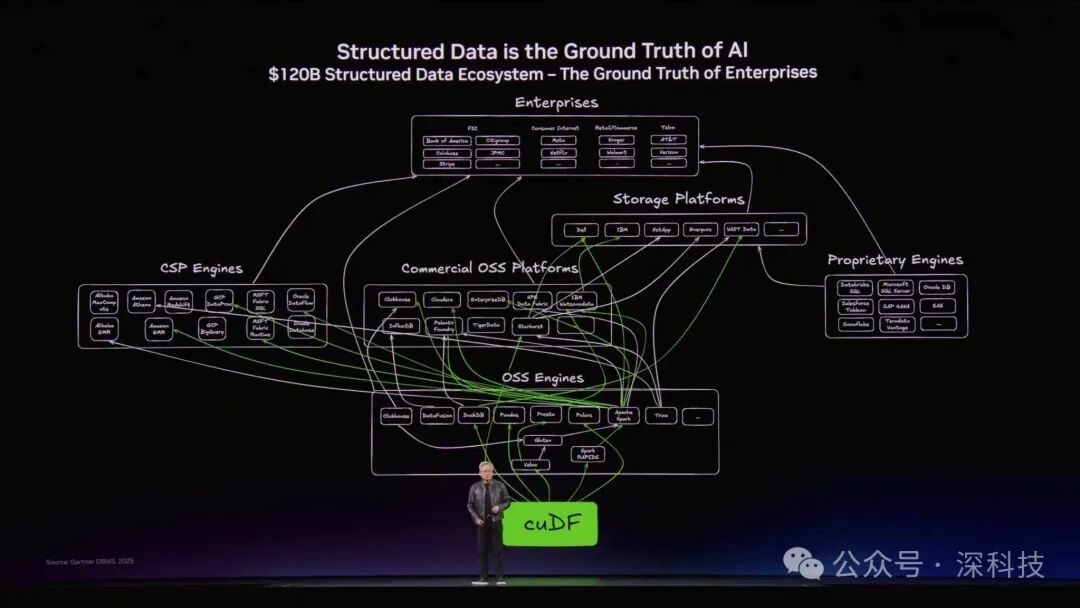

“这是我最棒的一页 PPT”

黄仁勋开玩笑说,他要用整场剩下的时间讲解这页关于结构化数据的 PPT。

这是企业计算的“基本事实”。

2026 年 3 月 17 日 凌晨 2:36

AI 可以处理非结构化数据

黄仁勋强调 AI 对非结构化数据的重要性:这类数据占全球数据的 90%,但过去因为无法检索、查询而“毫无用处”。

SQL 的发明者 IBM,正通过 cuDF 加速框架为 WatsonX 数据提供加速。

2026 年 3 月 17 日 凌晨 2:41

再谈摩尔定律

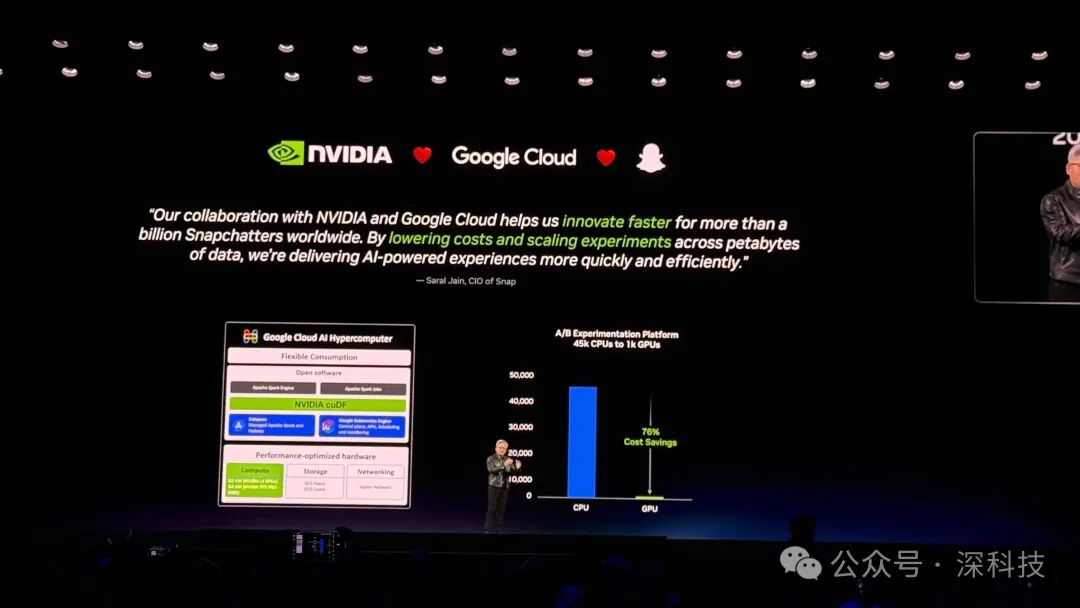

黄仁勋再次谈到摩尔定律已失效: “摩尔定律已经动力耗尽,加速计算让我们实现巨大飞跃。”

他以谷歌云为例,展示英伟达加速方案如何在各公司、各行业复制。

2026 年 3 月 17 日 凌晨 2:43

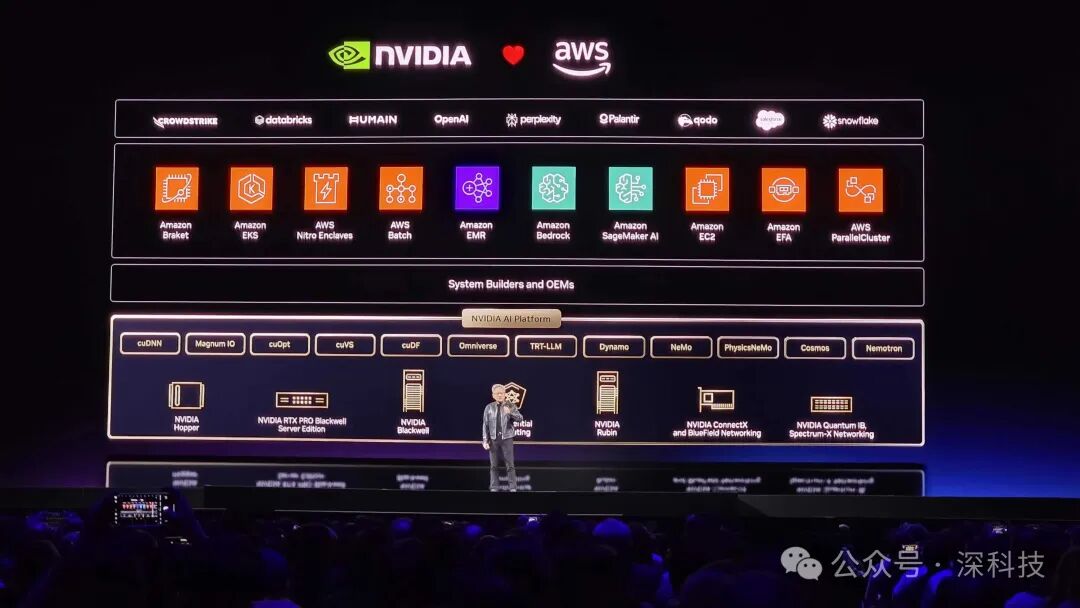

英伟达今年将把 OpenAI 引入 AWS

“众所周知,OpenAI 完全受算力限制。”

黄仁勋表示,OpenAI 今年将登陆 AWS,有望缓解其巨大的基础设施压力。

2026 年 3 月 17 日 凌晨 2:47

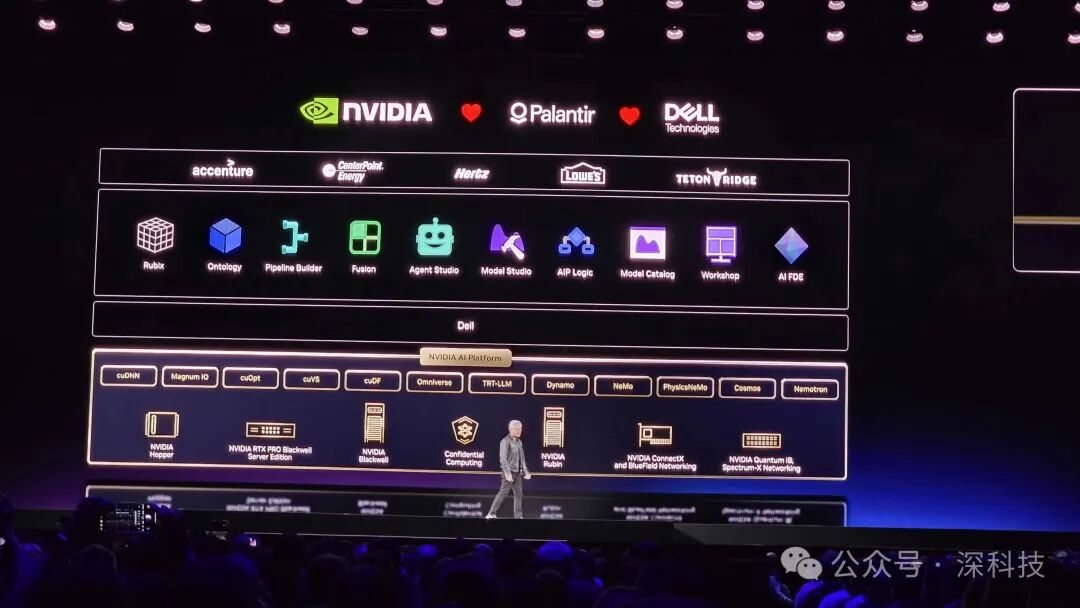

“垂直整合,但水平开放” :我们别无选择

黄仁勋将英伟达定位为“垂直整合、水平开放”,这可能会引起 FTC(美国联邦贸易委员会)的关注。

但英伟达表示,在加速计算领域,别无选择,必须为客户提供全栈方案。

2026 年 3 月 17 日 凌晨 2:51

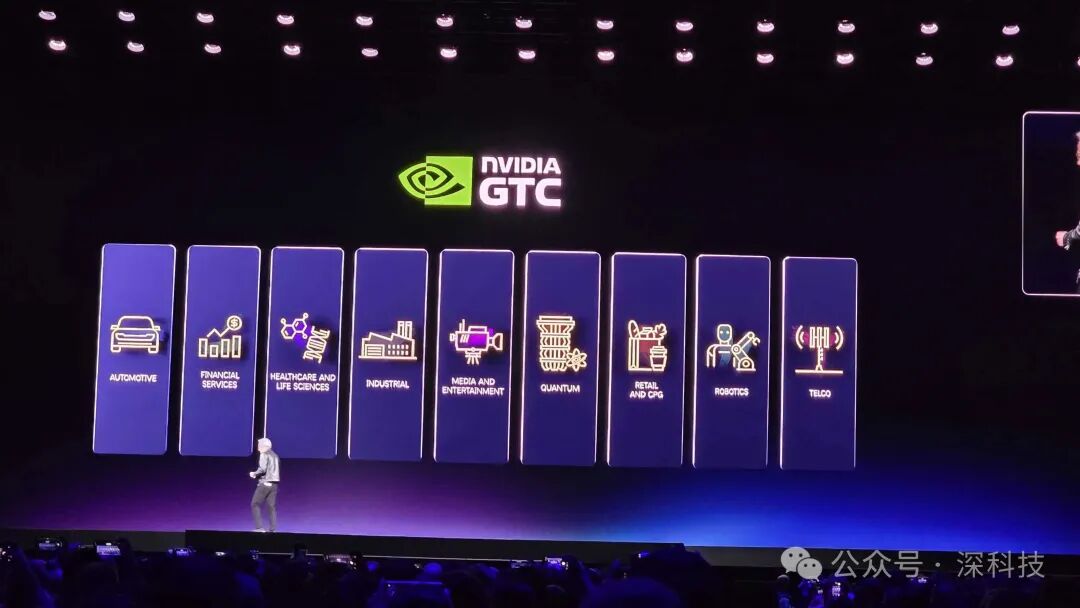

英伟达称需要领域专用库满足不同行业需求

AI 应用广泛,但黄仁勋表示,不能简单粗暴地把生成式 AI 套用到所有场景。

“我们必须拥有领域专用库,解决每一个垂直行业的问题。”

2026 年 3 月 17 日 凌晨 2:54

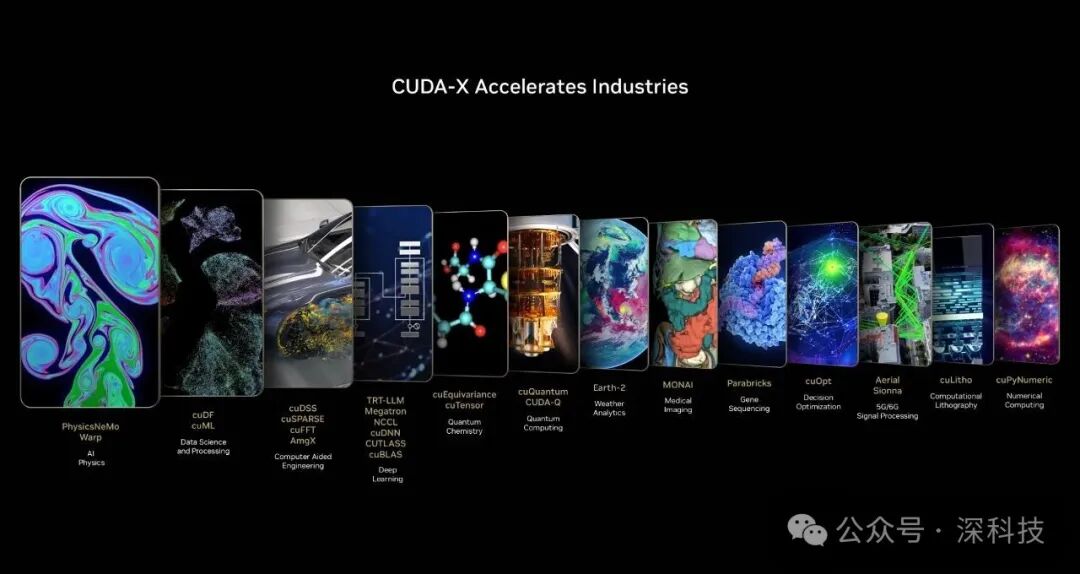

回归 CUDA “我们是一家算法公司。”

在花 10 分钟讲解软件栈在各行业的应用后,黄仁勋再次回归核心。

一切都回到英伟达的 CUDA-X 库,他称之为公司的“皇冠明珠”。

cuDNN 引爆了 AI“大爆炸”

英伟达称,cuDNN(CUDA 深度神经网络库)是公司史上最重要的库之一,引爆了现代 AI 的“大爆炸”。

现场播放 CUDA-X 各类库的演示视频,包含一段高度逼真的全仿真画面。

2026 年 3 月 17 日 凌晨 3:02

英伟达“重新发明了计算”

黄仁勋谈到众多 AI 原生公司,它们之所以存在,正是因为英伟达“重新发明了计算”。

我们正处在新一轮平台变革的起点,堪比当年 PC 革命。 过去两年,ChatGPT 开启了生成式 AI 时代。

2026 年 3 月 17 日 凌晨 3:07

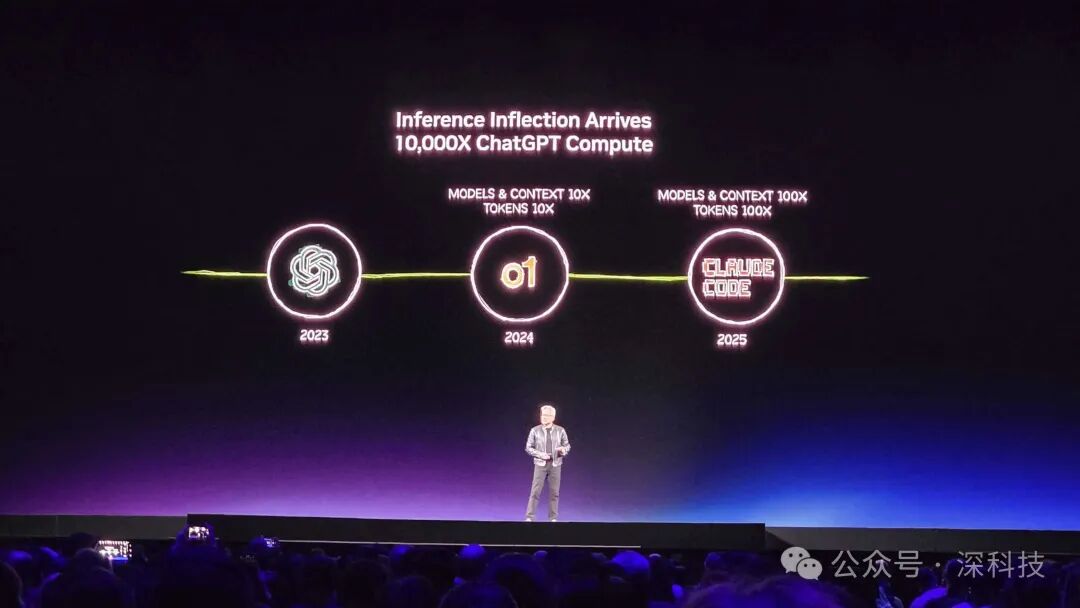

AI 加速时间线

近几年 AI 发展极快:

- 2023:ChatGPT

- 2024:推理模型,如 o1

- 2025:超大上下文窗口模型,如 Claude Code(首个“智能体模型”)

英伟达全员都在使用 Claude Code 及其他模型。

- 2026:英伟达称,我们迎来推理的拐点。

2026 年 3 月 17 日 凌晨 3:10

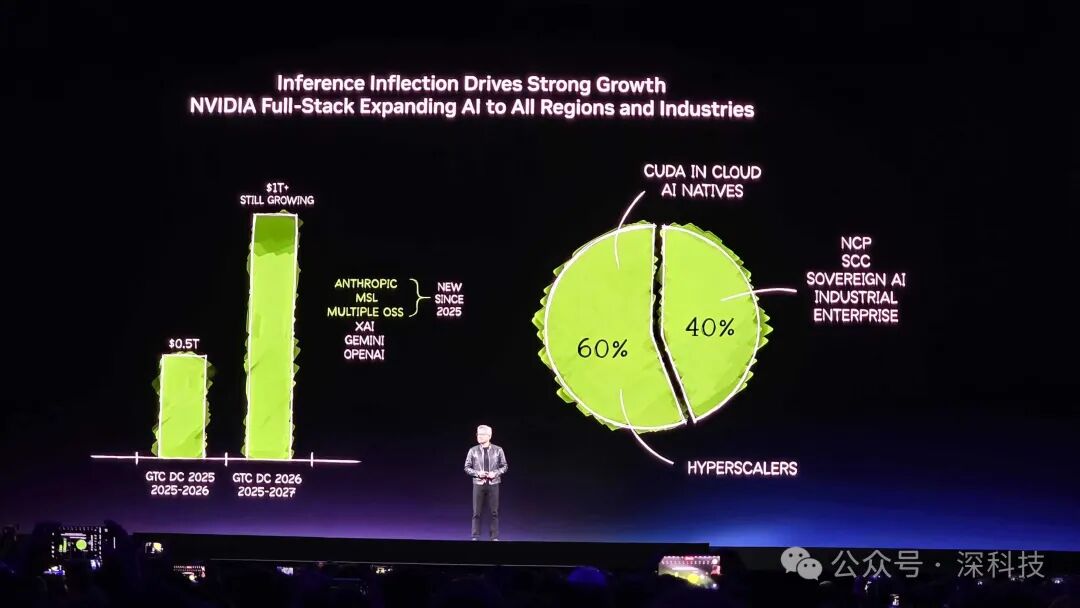

英伟达预计未来一年需求将翻倍

去年,英伟达称到 2026 年 Blackwell 与 Rubin 体系的高确定性需求与订单达 5000 亿美元。

“我预计到 2027 年,这一数字至少达到 1 万亿美元。”

“这合理吗?”黄仁勋表示,这正是他本场演讲要解释的内容。

2026 年 3 月 17 日 凌晨 3:13

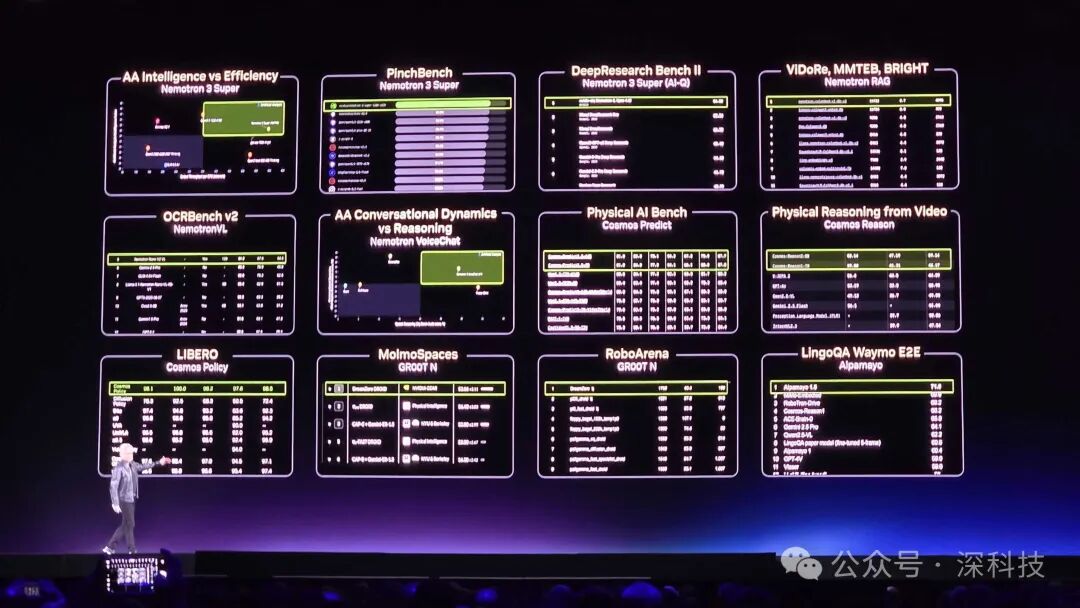

英伟达是唯一覆盖全领域 AI、全模型的公司

黄仁勋称,英伟达是唯一一家覆盖全领域 AI、全模型的厂商。

英伟达、Anthropic、Meta SL 三者加起来,占据全球 AI 算力的 1/3。

黄仁勋表示,已充分证明:作为 AI 基础设施厂商,“你可以完全放心地基于我们构建”。

2026 年 3 月 17 日 凌晨 3:17

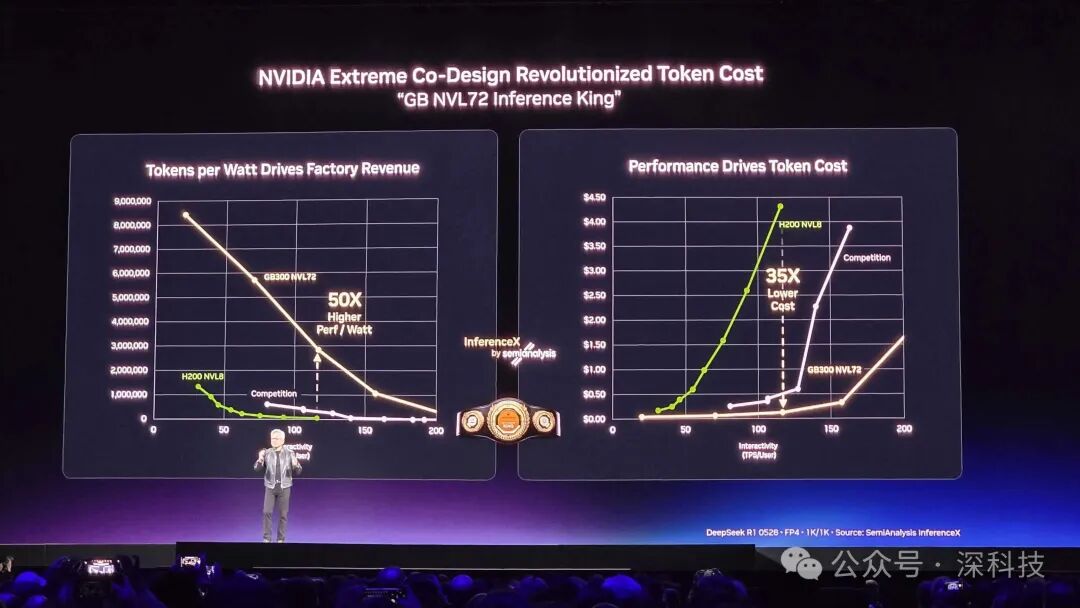

英伟达称 Grace Blackwell 是“一场豪赌”

黄仁勋表示,NVL72 是一场“巨大豪赌”,并感谢合作伙伴的支持。

“对所有人来说都不容易……推理是终极难题。” 而这场赌局,英伟达赢了。

2026 年 3 月 17 日 凌晨 3:21

每瓦性能提升 50 倍,成本降低 35 倍 “当时没人相信我。”

黄仁勋表示,NVL72 最初宣称每瓦性能提升 30 倍,实际做到了 50 倍。

他再次提及摩尔定律:其每年性能提升大约只有 1.5 倍。

2026 年 3 月 17 日 凌晨 3:24

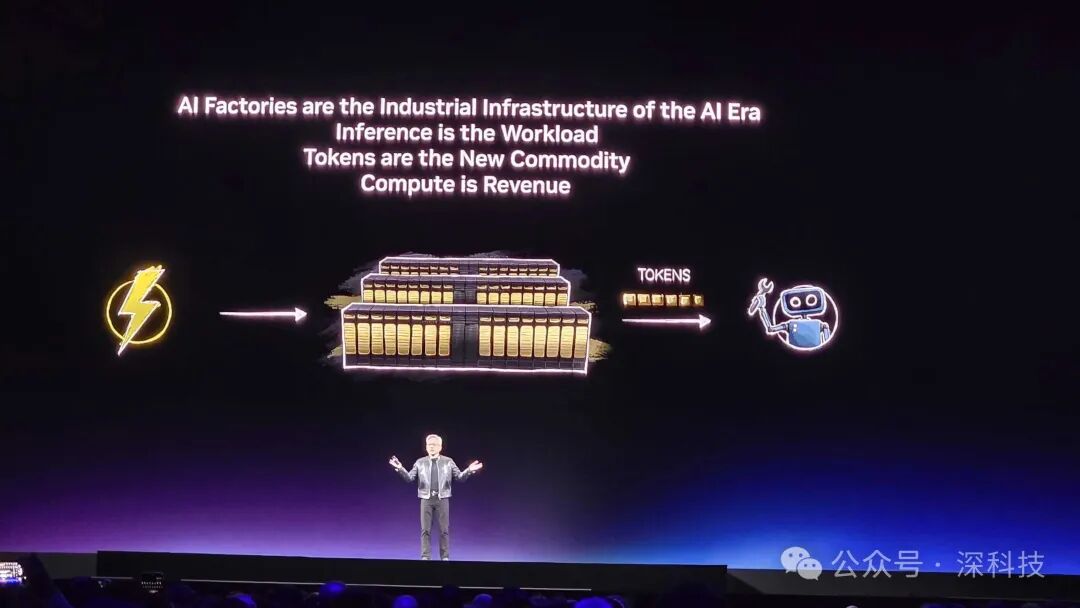

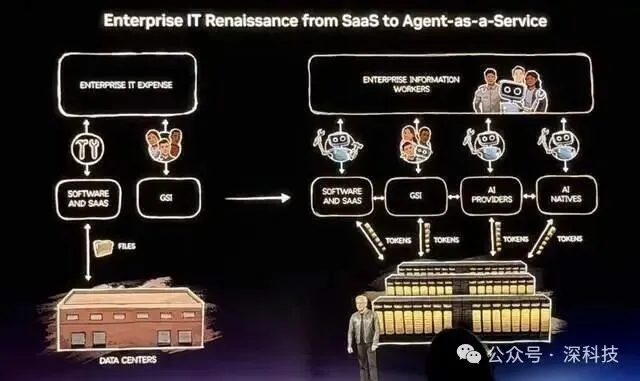

“数据中心现在是生产 Token 的工厂”

黄仁勋说:数据中心过去是存储文件的地方,现在是生成 Token 的工厂。 推理是核心工作负载,Token 是新大宗商品。

随后播放一段短片,回顾发展历程。

2026 年 3 月 17 日 凌晨 3:30

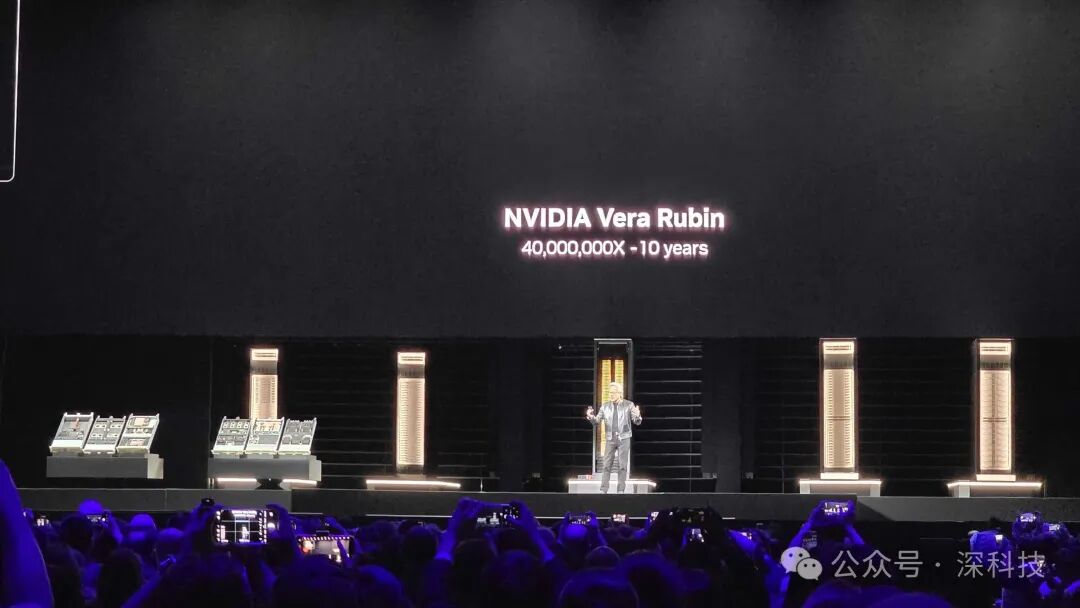

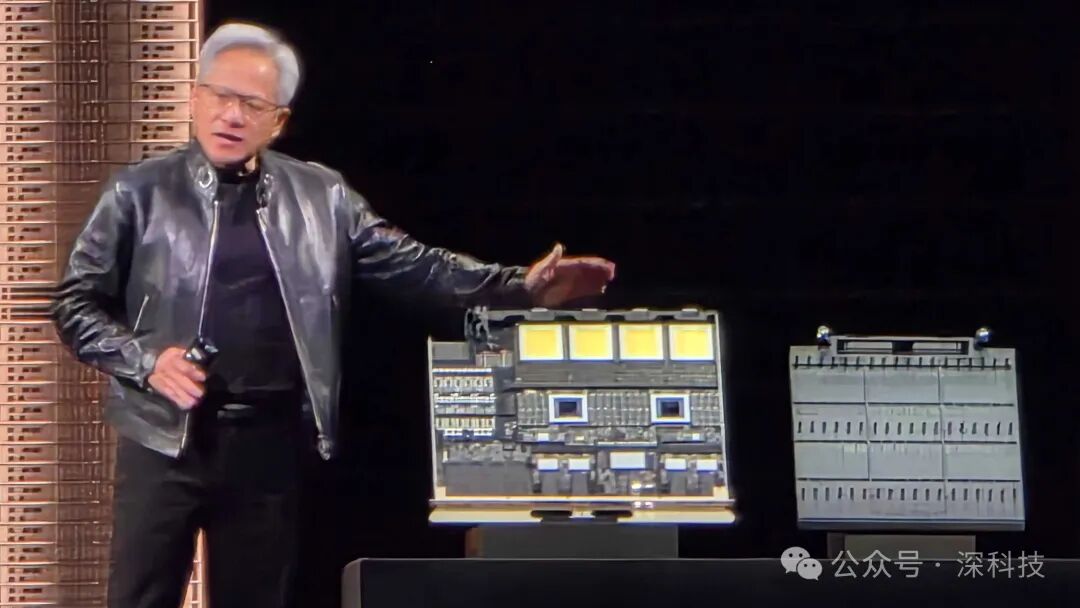

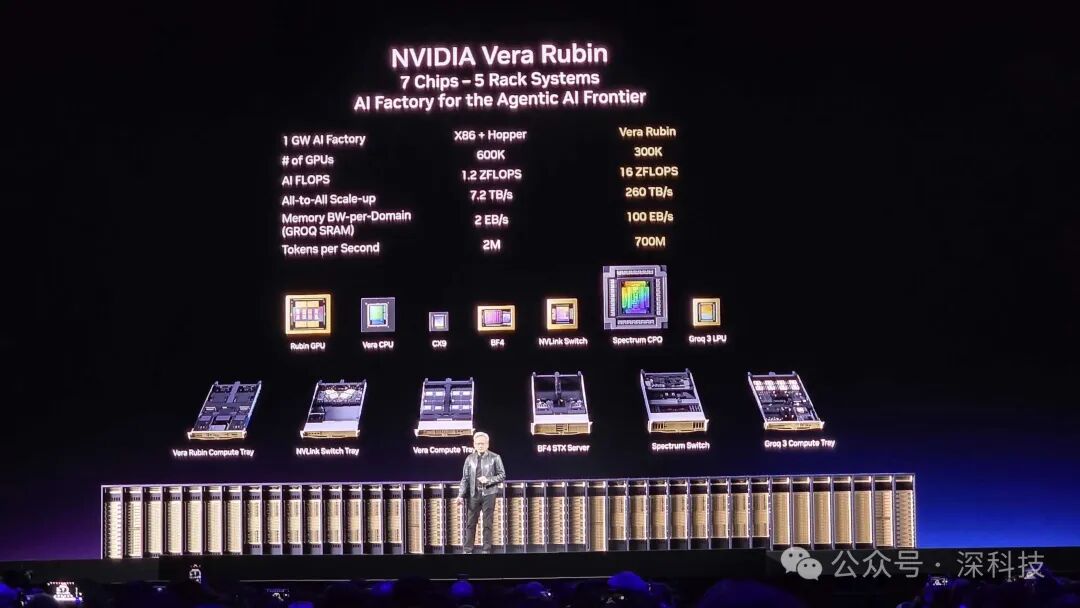

Vera Rubin 亮相舞台

Vera Rubin NVL72 是“驱动智能体 AI 时代的超级引擎”。

新增 Groq 3 LPX 模块。

英伟达称,过去十年算力提升达到 4000 万倍。

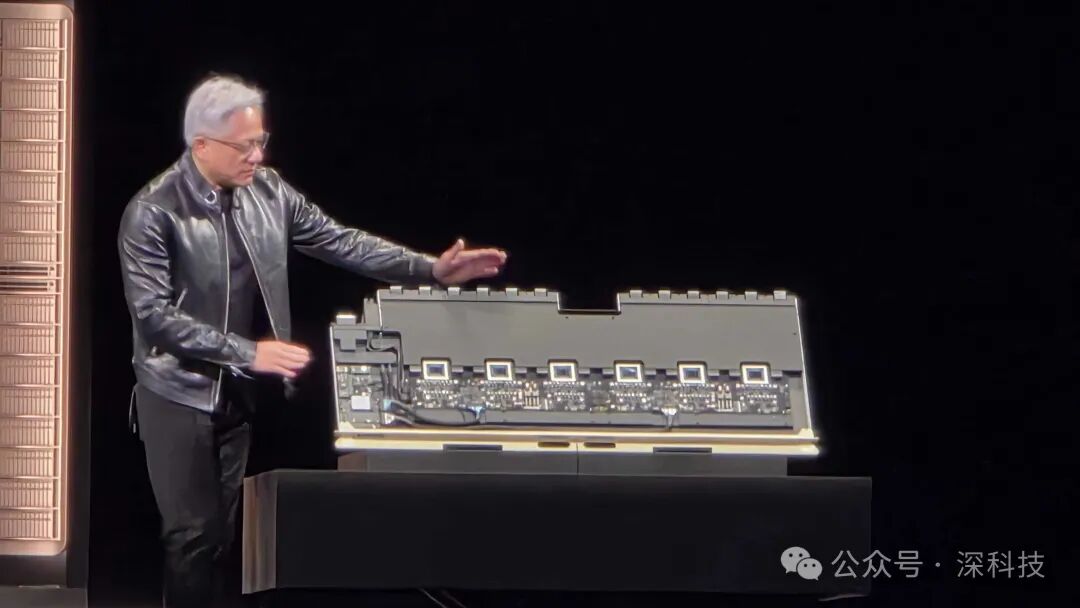

黄仁勋在台上展示完整 Vera Rubin:它是“一个巨型系统”。

他表示,Vera CPU 专为高单核性能设计,与机架配合用于智能体处理。

2026 年 3 月 17 日 凌晨 3:32

Vera CPU 详细信息

88 核 Vera CPU,单个机架可搭载 256 颗芯片,全部采用液冷。

这款面向 AMD、英特尔的最新竞品。

2026 年 3 月 17 日 凌晨 3:35

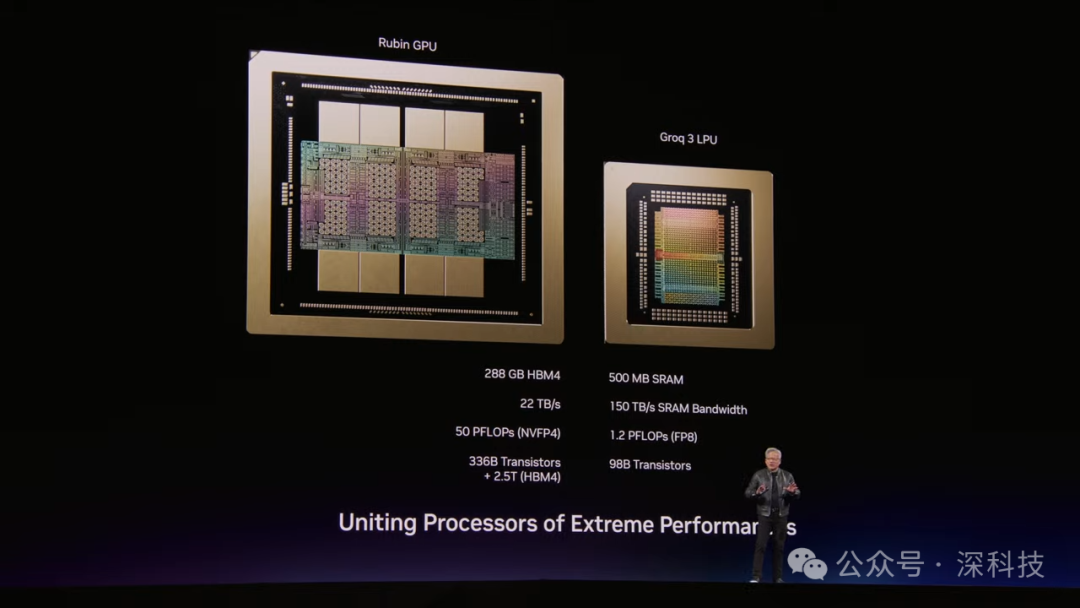

Groq 3 LPU 与 Groq LPX 登场

系统新增 Groq LPX 机架,这在 GTC 之前已有消息。

2026 年 3 月 17 日 凌晨 3:37

黄仁勋展示 Rubin Ultra 的 NVLink

黄仁勋讲解 Rubin Ultra 的 NVLink 工作方式:计算单元在前,扩展互联架构在后。

2026 年 3 月 17 日 凌晨 3:42

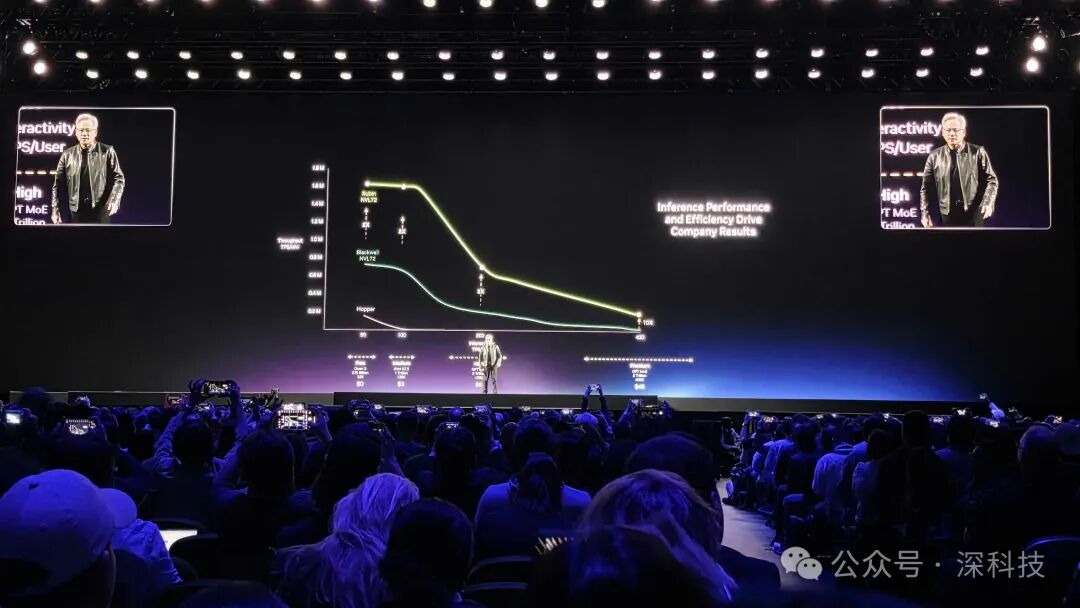

黄仁勋:这是企业“最重要的图表”

英伟达表示:Token 是新的大宗商品。

对企业而言,同等功耗下 AI 工厂的吞吐能力,将“被研究很多年”。

更多 Token 意味着更智能的模型,模型越智能,就越需要更高的 Token 吞吐。

英伟达称,在每一个层级,Vera Rubin 都提供了更高得多的吞吐性能。

2026 年 3 月 17 日 凌晨 3:47

低延迟与高吞吐本是“天敌”

Groq 对英伟达至关重要,因为它突破了 NVL72 的极限。

借助 Groq LPX,英伟达称可让使用 Vera Rubin 的企业收入提升最高 10 倍。

它解决了低延迟与高吞吐难以兼得的问题——黄仁勋称二者本是“天敌”。

英伟达通过解耦推理(disaggregated inference),将高吞吐芯片与低延迟芯片合二为一。

2026 年 3 月 17 日 凌晨 3:51

Vera Rubin 样品进展“极其顺利”

黄仁勋坦言,Grace Blackwell 样品阶段曾遇到一些问题,但 Vera Rubin 的样品推进非常顺利。

事实上,首台 Vera Rubin 系统已在微软 Azure 云端运行。

2026 年 3 月 17 日 凌晨 3:53

Vera Rubin:横跨 5 个机架、集成 7 颗芯片

Vera Rubin 无疑是英伟达迄今为止最具野心的系统: 横跨 5 个机架系统,内置 7 颗芯片。

英伟达称,对比 x86 与 Hopper: - Vera Rubin:7 亿 Token/秒- 传统架构:仅 200 万 Token/秒

2026 年 3 月 17 日 凌晨 3:56

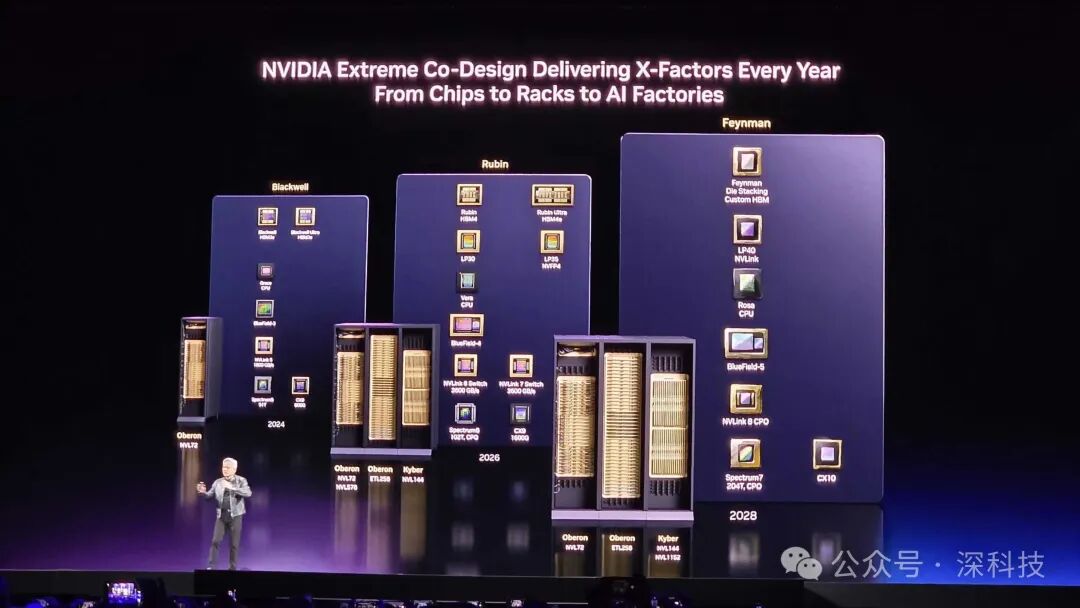

英伟达路线图公布

黄仁勋预告下一代 Feynman 系统: 包含全新 GPU、全新 LPU、名为 Rosa 的全新 CPU、Bluefield 5,以及支持铜互连与 CPO 规模化的 Kyber。

Feynman 系统计划 2028 年推出,今年会陆续公布更多信息。 明年 GTC,我们大概率会像今年谈论 Vera Rubin 一样,密集讨论 Feynman。

2026 年 3 月 17 日 凌晨 3:59

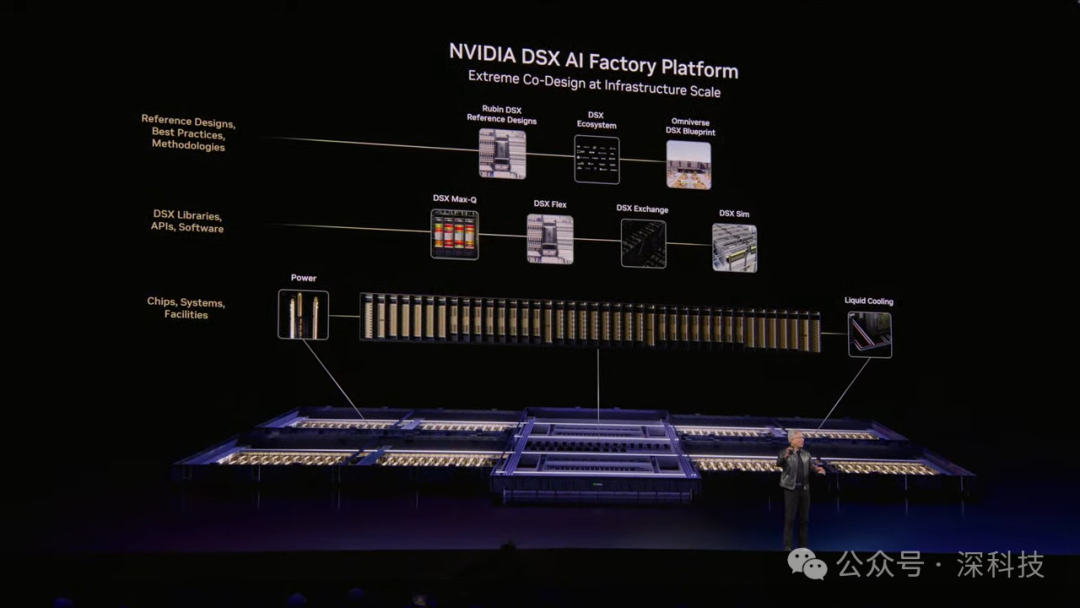

在 Omniverse 会面

英伟达打造 Omniverse,用于与供应商虚拟会面,实现数据中心更大规模的协同设计。

目标是“不浪费一丝功耗”。 这些是 AI 工厂的蓝图,英伟达称之为 DSX 平台。

2026 年 3 月 17 日 凌晨 4:04

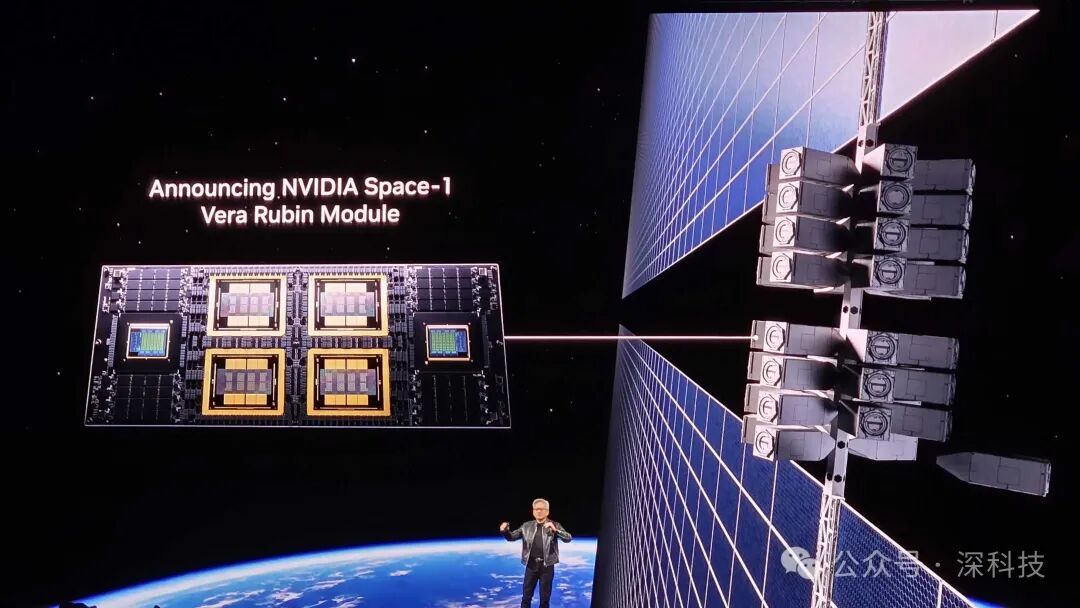

数据中心要上天了

英伟达正在研发名为 Vera Rubin Space-1 的系统,将成为首个太空数据中心。

目前仍处于早期阶段,但英伟达表示“有大量顶尖工程师”参与该项目。

2026 年 3 月 17 日 凌晨 4:06

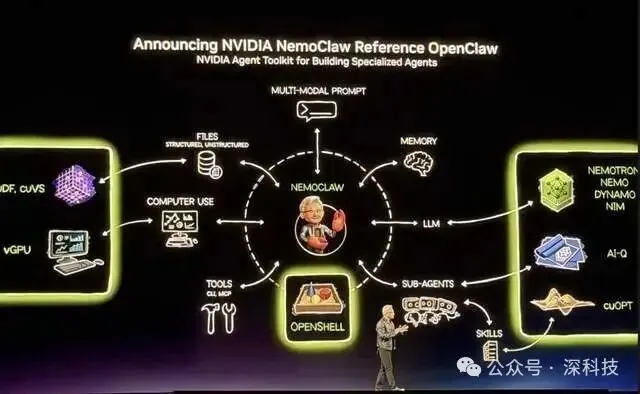

NemoClaw 让 OpenClaw 变得简单易用

英伟达简化了基于 OpenClaw 搭建 AI 智能体的流程: 只需输入两行 Shell 命令,即可启动一个 AI 智能体。

之后只需交给它任务,让智能体自主运行即可。

curl -fsSL https://nvidia.com/nemoclaw.sh | bash

nemoclaw onboard

2026 年 3 月 17 日 凌晨 4:09

OpenClaw 是什么?黄仁勋定义:一个操作系统

黄仁勋现场解释 OpenClaw——其实在场观众早已熟知。

简单说:它是一个可连接云端系统的智能体,能创建子智能体、任务调度、拆解问题等。

黄仁勋将其定义为操作系统: “这和当年 Windows 让个人电脑普及的逻辑一模一样。”

2026 年 3 月 17 日 凌晨 4:13

英伟达与 OpenClaw 合作,打造企业级安全方案 NemoClaw

具备企业级安全能力,可保护敏感信息。 AI 智能体可对外通信并自主执行,这显然存在安全风险。

NemoClaw 为企业提供参考软件栈,让 OpenClaw 安全可用。

2026 年 3 月 17 日 凌晨 4:19

英伟达组建 Nemotron 联盟

英伟达表示,Nemotron 3 Ultra 将成为全球最强基座模型。

为规模化推进 Nemotron,英伟达将为 Nemotron 4 组建联盟,成员包括: Black Forest Labs、Perplexity、Mistral、Cursor 等。

2026 年 3 月 17 日 凌晨 4:24

将智能体带入物理世界

英伟达在 GTC 现场展示了 110 台机器人,展示其“物理 AI”实力。

英伟达宣布多家新合作伙伴,包括 4 家自动驾驶出租车合作伙伴:比亚迪、现代、日产。

同时与优步(Uber)合作,在部分城市将自动驾驶出租车接入优步网络。

2026 年 3 月 17 日 凌晨 4:31

《冰雪奇缘》雪宝 Olaf 登台,与黄仁勋同框

在一场毫不尴尬的互动中,《冰雪奇缘》的 Olaf 登上舞台。

黄仁勋介绍了生成 Olaf 所用到的各类 AI 模型。

总之,Olaf 参与了本次 keynote 的收尾环节。

2026 年 3 月 17 日 凌晨 4:34 演讲正式结束

发布会正式落幕。

英伟达在演讲结尾播放了一段动画:多台机器人(连同黄仁勋)围坐在篝火旁,演唱一首关于本次 keynote 的乡村歌曲。

这首歌大概率由 AI 生成。

彩蛋:

黄仁勋致美光CEO:致我在美光的各位朋友。我们的合作改变了世界。业界速度最快的HBM4显存已交付给英伟达。

美光已向英伟达大规模交付 HBM4 显存,用于 Vera Rubin AI 平台

带宽超 2.8TB/s,能效大幅提升

锁定英伟达下一代 AI 芯片量产订单,直指 AI 算力核心瓶颈

消息发布于美光财报前,信号明确

本次GTC 2026大会信息量巨大,从底层芯片到AI工厂蓝图,再到面向开发者的智能体工具,展示了英伟达在人工智能和云计算基础设施领域的全面布局。更多AI、云计算和开发者资讯,欢迎访问云栈社区。