近两年,AI视频创作工具层出不穷,“一键生成大片”的口号不绝于耳。然而,当这些工具被用于真实的专业影视或广告项目时,问题便暴露无遗:画面崩坏、角色形象前后不一、镜头调度与光影控制更是无从谈起。许多看似酷炫的AI工具,在商业项目的严苛要求下,往往显得华而不实。

正是在这样的背景下,LiblibAI(哩布哩布AI)于2026年3月正式推出了其专业的视频创作平台——LibTV。这并非又一个简单的AI视频生成器,而是一个从底层逻辑到交互设计都经过重构的平台,其目标直指影视后期、广告制作、动画设计等高端专业领域。

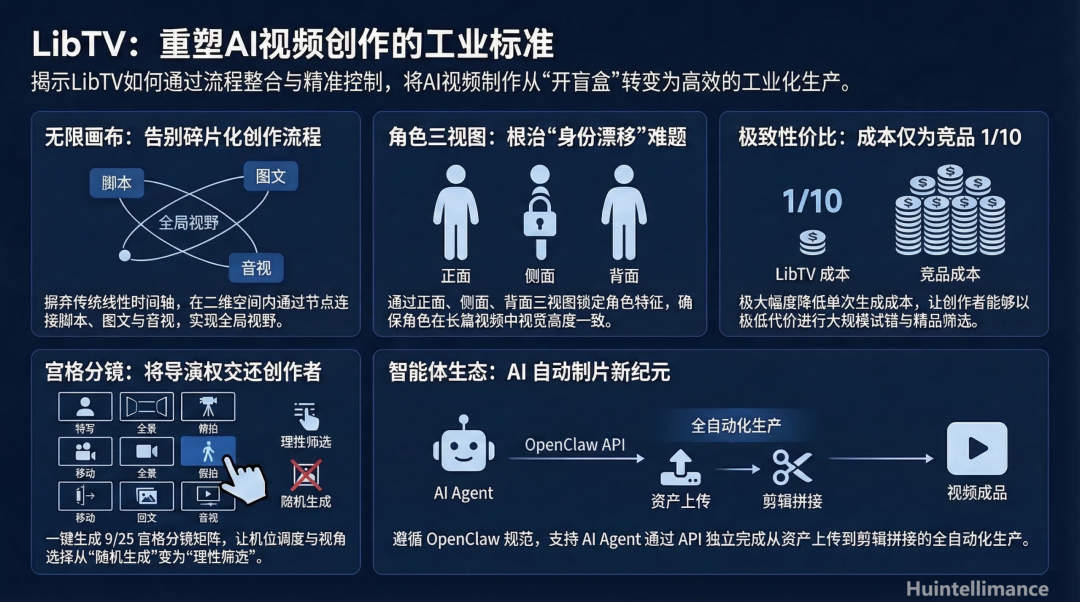

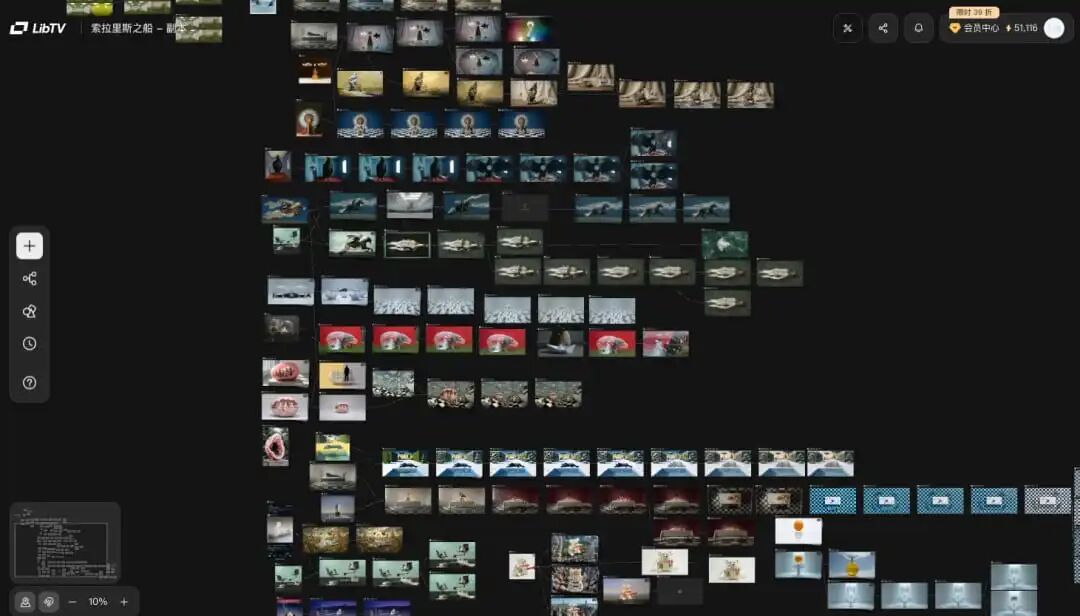

传统视频剪辑软件的核心局限是什么?答案往往是那条线性时间轴。在密密麻麻的轨道中埋头苦干,极易失去对项目整体的掌控。LibTV大胆地摒弃了传统时间轴,引入了“无限画布”的概念。创作者可以在一个自由缩放、无限延展的二维平面上,将剧本、素材、分镜与成片全部铺开,真正做到了一眼览全局。这一设计革新,让许多专业导演和剪辑师感到惊喜。

五大创意节点:将影视流水线搬进浏览器

LibTV最核心的创作逻辑在于其“节点化工作流”。平台将一切创意元素抽象为五种基础节点:文本、图片、视频、音频和脚本。用户可以通过拖拽和连线,自由地将这些节点串联成完整的创作流水线。

其精妙之处在于节点间的联动:当上游节点(如剧本文本)被修改后,下游依赖节点(如分镜图、视频片段)会自动触发重新渲染。这从根本上解决了影视工业中令人头疼的环节——跨部门文件反复传递与版本核对。试想,创作一支30秒的产品广告:在画布左侧设定角色文本,中间自动生成分镜图,右侧直接输出视频片段。所有环节一目了然,导演能实时把握全局进度,而非在繁杂的文件夹中大海捞针。

AIGC视频另一个长期存在的顽疾是“角色漂移”——同一角色在不同镜头或场景中,面部特征、发色、五官比例发生微妙改变,导致观感断裂。LibTV针对性推出了“角色三视图生成”功能,通过锁定角色的正面、侧面、背面定妆照,将特征向量牢牢固定。一旦角色被绑定,无论后续镜头多复杂、视频多长,角色形象都能保持高度一致。这对于制作AI短剧、动漫连载的创作者而言,无疑是巨大的解脱。

宫格分镜、逐帧微调与智能体自动化

分镜是导演创意的直观体现,但如何向AI准确传达“摄像机调度”的微妙感觉?LibTV的9/25宫格分镜生成功能,将“随机尝试”变为“理性筛选”。输入场景提示词后,系统会同时生成9个或25个不同视角、运镜和透视关系的分镜方案,一次平铺供导演选择。创作者不再是碰运气单张生成,而是像审阅样片一样,从一系列成熟方案中挑选最契合叙事的那一个。

在深度微调层面,LibTV提供了逐帧精细编辑、感知式高清增强、虚拟摄像机运镜(推拉摇移)以及动态打光切换等专业功能。这些功能专为对品质有严苛要求的商业项目准备。例如,其高清增强是对画面内容的智能感知重建,而非简单放大;打光切换是真实改变场景光源属性,而非叠加滤镜。正是这些细节的堆叠,共同撑起了“专业级”工具的称号。

LibTV最令人瞩目的设计是其“双开门”底层架构。平台一侧服务于人类创作者,另一侧则完全向AI智能体开放。通过遵循OpenClaw技能规范,LibTV将其核心生成引擎以API形式开放。这意味着,如果你正在使用基于OpenClaw规范的智能体(如Autoclaw、kimiclaw等),可以直接通过指令调用LibTV的全套能力——你只需在对话框中提供一个参考视频和一句提示词,智能体便能在后台自动完成从剧本生成、分镜设计、视频渲染到最终成片合成的全部流程。

这或许才是“AI自动化内容生产”从概念走向现实的模样。

在算力成本方面,LibTV宣称将单次视频生成的算力消耗压降至市面同类产品的十分之一左右。对创作者而言,这意味着试错成本急剧降低,可以毫无负担地进行多方案比较与筛选。对平台生态而言,低门槛吸引了海量创作者涌入,产生的优质数据持续反哺模型迭代,形成良性循环。算力,在LibTV的体系中,已然成为驱动整个生态高效运转的“基础货币”。

自2023年5月上线以来,LiblibAI已积累了近2000万活跃创作者,日均图片生成量超过500万次。LibTV的推出,标志着其从静态图像向动态视频、从单一工具向综合创作生态的关键跨越。其背后并非简单的功能堆砌,而是一套从工作流逻辑到商业模式都经过深思熟虑的完整体系。

对于关注AI视频前沿动态的开发者与创作者,可以访问云栈社区获取更多深度资讯与实战讨论。AI视频创作的赛道竞争激烈,而LibTV选择以重塑底层工作流的方式切入,为专业领域提供了一条值得期待的新路径。

相关资源链接:

|