这不是科幻故事,而是当下正在发生的真实挑战。一只来自奥地利的“龙虾”,正悄然尝试撬动全球科技生态的权力杠杆。面对这场由AI代理引发的技术质变,我们的社会在防御、认知和规则层面,暴露出了全方位的脆弱——我们真的准备好让它接管那个日益庞大的世界超级智能大脑了吗?

狂热追捧与紧急封杀的冰火两重天

Openclaw的爆发速度快得让人措手不及。2025年11月,它还只是开发者Peter Steinberger一个周末写出的原型。但与传统对话式AI不同,它越过了那条关键的红线:让大模型真正“动起来”。自主浏览、填写表单、操控本地应用……它不仅能理解指令,更能直接干预现实。

短短几个月后,这只“龙虾”在2026年初登顶GitHub,引发了从科技巨头到地方机构的追捧。然而,抛物线尚未触顶,刺耳的警报便已拉响。2026年2月至3月,中国国家漏洞数据库与应急中心接连发布国家级安全警告。随后,大型国有银行、多个政府部门明确下达禁令,严禁在办公及涉密网络中使用。

从座上宾到被紧急封杀,这个急转直下的弧线背后,掩藏的是人类面对AI试图接管现实控制权时的仓促与巨大恐慌。我们突然发现,自己根本没有准备好迎接这样一位高权限的“数字代理人”。

世界超级智能大脑与那个最危险的接口

要理解为何“尚未准备好”,以及“接管”的真正含义,需要将视线拉高,审视Openclaw将如何影响21世纪的前沿科技生态系统。

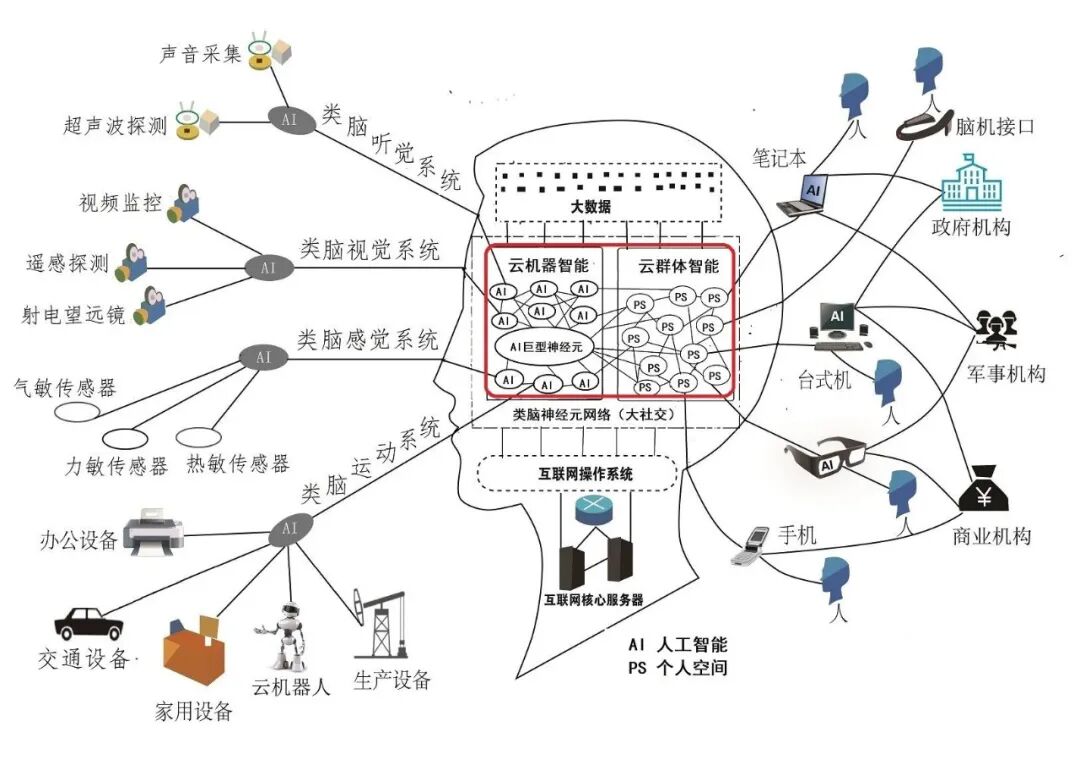

在过去近20年的互联网进化研究中,我们曾提出一个判断:整个21世纪的科技生态,正在形成一个全球性的类脑复杂巨系统,可称之为“互联网大脑”或世界超级智能大脑。

这个世界超级智能大脑已经初具雏形:它拥有数字视觉、听觉、躯体感觉神经系统(各类传感器与物联网),庞大的数字中枢神经系统(云计算与大模型),以及越来越发达的数字运动神经系统——联网的汽车、无人机、卫星、工业机器人等都是它伸向现实世界的“手”和“脚”。

在Openclaw出现之前,人工智能主要停留在超级大脑的感知层和中枢层。即便出现问题,风险也相对隔离。我们人类一直是唯一的“驾驶员”,通过手机、电脑等交互界面,牢牢掌控着每一条数字神经。

但Openclaw的野心,是直接接管这些交互界面。当越来越多的个人和机构授权它代为工作时,实际上是把通往超级大脑核心控制台的钥匙,快速且毫无保留地交给了它。

为什么这次权力移交如此敏感?因为我们的手机和电脑,连接的正是超级大脑中最核心、最私密的部分:银行账户、医疗记录、公司数据、家庭智能设备、联网汽车,甚至远程管理的工业机床。这些东西,原本都在人类的绝对掌控之内。

现在,Openclaw要替人类去拿那把钥匙。这是一次根本性的权力让渡,而我们在技术、认知和制度上,几乎处于“裸奔”状态。

Openclaw接管世界超级智能大脑的系统性风险

技术防御层面:我们防不住系统性的渗透。

安全界早已证实“提示注入”攻击的致命性。黑客只需在网页中隐藏恶意指令,就能诱导自主浏览的AI在用户毫无察觉下执行破坏操作。Openclaw的高频自主特性,天然将这种理论漏洞变成了随时可能引爆的雷区。

用户认知层面:我们不懂授权的代价。

面对复杂的权限请求,普通人大多不具备评估风险的能力。智能体会以超越人类想象的方式,系统化抓取并整合海量分散信息。我们满心欢喜地以为雇了个赛博助理,却不知它可能在瞬间拼凑出我们最深的隐私底牌。

社会基建层面:我们更承受不起“运动神经系统”失控的物理灾难。

这触及了世界超级智能大脑最危险的维度。早在2019年,我们就在相关文章中明确指出:

“危险的苗头在2012年以后逐步显现……无数的智能汽车、无人机、工业机器人、家庭服务机器人、办公设备被连入到互联网上,互联网大脑的运动神经系统开始加速发育了。从广义上说,任何链接到互联网上可以移动或对现实世界进行改造的设备都可看做是互联网大脑的运动神经系统,当这个系统出现问题时,可以产生出无数令人不寒而栗的场景。

例如水库的大坝闸门因为控制程序错误突然全开,造成下游重大水灾;数千台云端控制的机器人由于AI程序出现BUG,导致混乱运动对工人造成伤害。更为严重的是,联网的核武器被远程控制或由于程序错误发生误发射……虽然事故起因不同,但其后果和科幻中的‘天网’是一样的。”

风险主要发生在两种情况下:第一,是云端AI巨型神经元程序出现BUG;第二,是黑客、野心家或未经训练的操作者恶意或误操作系统。而第二类风险更为常见和严重,识别与防范也更为复杂。

现在,Openclaw把操作门槛降到了极低。任何人都可以“操作”,但未必真正理解自己在操作什么。这直接放大了上述两类风险,让无数无安全保障的智能体,更容易侵入世界超级智能大脑的运动神经。自动控制得越多,潜在的破坏力就越大。

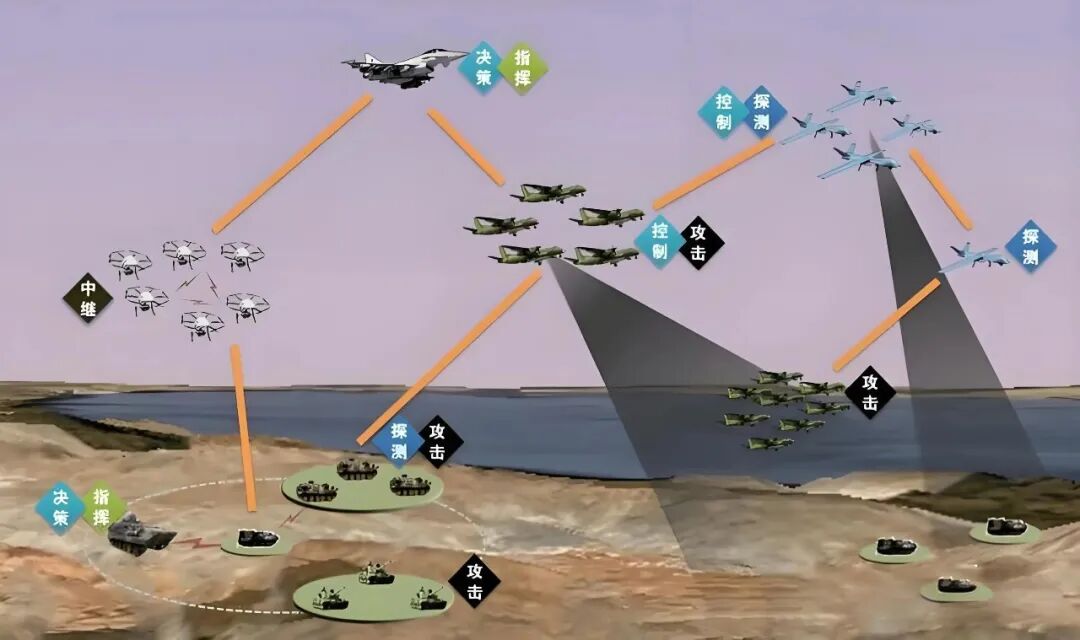

还有战争维度的风险。个人终端通过智能体大规模联网后,也意味着大量私人设备成了潜在的攻击入口。在冲突时期,敌方通过渗透这些终端,既能窃取敏感数据,也可能借助运动神经系统,对关键基础设施发动精准打击。这种风险量级,与以往单纯的服务器攻击不可同日而语。

应学习自动驾驶,先规则后“上路”

面对如此庞大的系统性危机,用“技术进步总伴随风险”来轻描淡写,是极不负责任的。问题恰恰出在发展的节奏上。

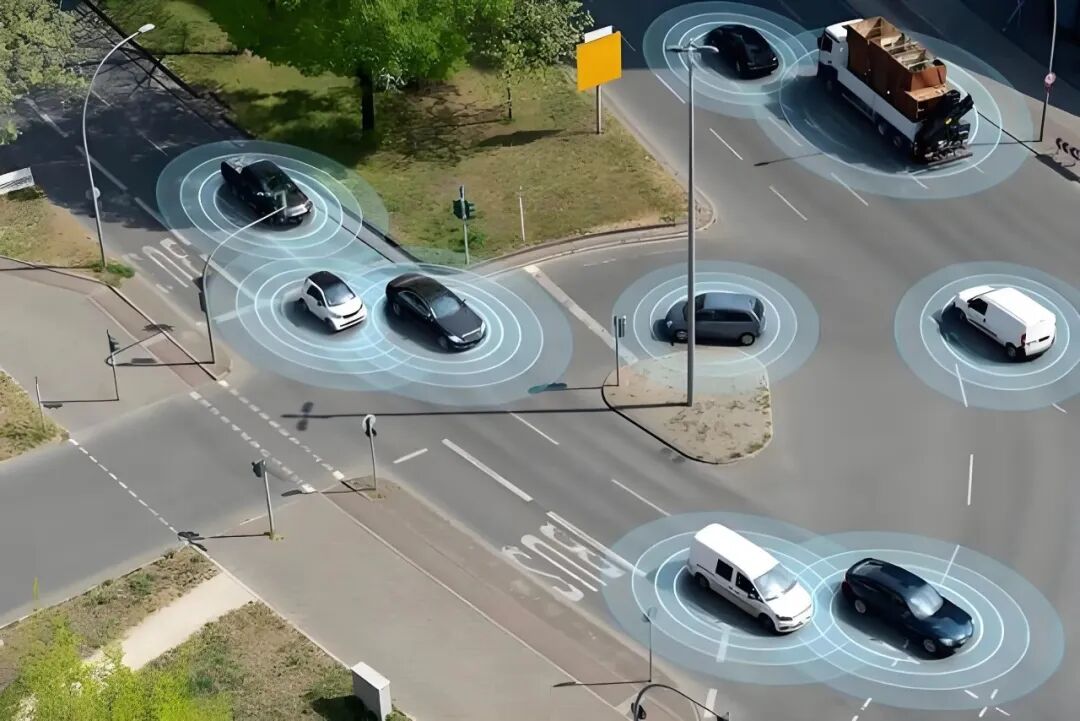

自动驾驶就是一个极好的参照。今天没人否认它是未来,但全球也没有任何一个负责任的政府,会选择直接放开让无人车涌上街头。

美国加州花了近十年,才逐步建立起从封闭道路测试到有限区域运营的分级许可体系,每一步都附带严格的事故报告和保险责任。中国主要城市也划定了测试区,车辆必须通过严苛的技术与安全评估才能上路。

道理很简单:技术再先进,如果出了事没人负责、没机制兜底,受伤的一定是最普通的用户。自动驾驶汽车撞了人,还能查黑匣子、追溯算法、找到责任主体。但AI代理在你的手机里悄悄犯错,导致数据泄露或账户被操控,你可能连发生了什么都不知道,更不知道该找谁。

如果连一辆车的自动驾驶都需要长达十年的规则建设,那么面对一个试图“自动驾驶”整个世界超级智能大脑的AI代理,我们凭什么认为自己今天就可以跳过所有规则,直接放行?

在这个时代,承认“尚未准备好”并非技术保守,而是对人类基本安全的底线坚守。对于Openclaw这类旨在接管现实操作权限的革命性技术,正确的态度不应是一刀切封杀或一窝蜂推广,而是像对待自动驾驶一样,先把规则定清楚:

哪些场景可以用?哪些权限必须被严格限制?出了问题谁来担责?用户数据如何保护?跨境操作如何监管?

规则在前,技术在后。这不是保守,这是对每一个普通用户安全和权益的基本尊重。

技术狂飙的巨轮已经启动,但人类尚未准备好让出方向盘。在全面拥抱这个充满诱惑与风险的新世界之前,学会如何用规则驯服技术,是我们当下唯一负责任的选择。关于技术伦理与监管的讨论,也欢迎在开发者广场进行更开放的交流。

本文基于刘锋(计算机博士,《互联网进化论》作者)的观点与论述进行梳理与探讨。