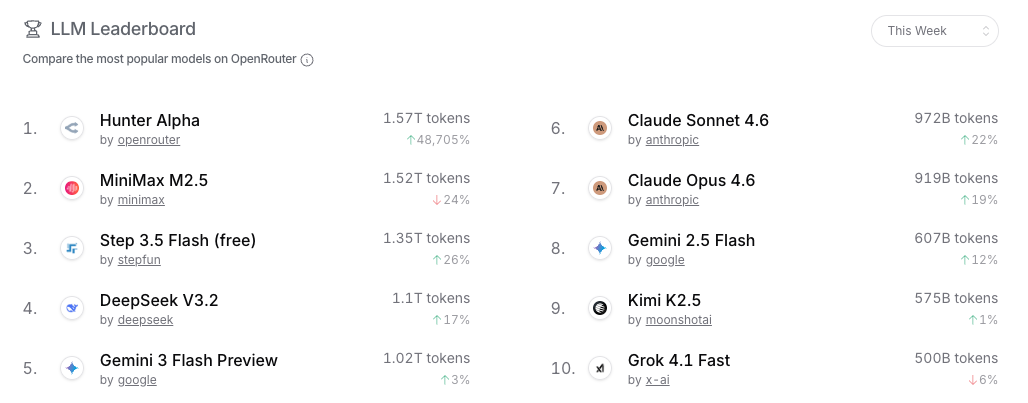

上周,在全球最大的大模型 API 聚合平台 OpenRouter 上,一款代号为 Hunter Alpha 的神秘模型调用量一路飙升至榜首,迅速成为圈内热议的焦点。

在外界还在猜测这个“幕后玩家”究竟是谁时,答案很快揭晓——今天,小米正式出面认领,并发布了这款模型的真实身份:MiMo-V2-Pro。此外,其还推出了相关系列模型 MiMo-V2-Omni 和 TTS。

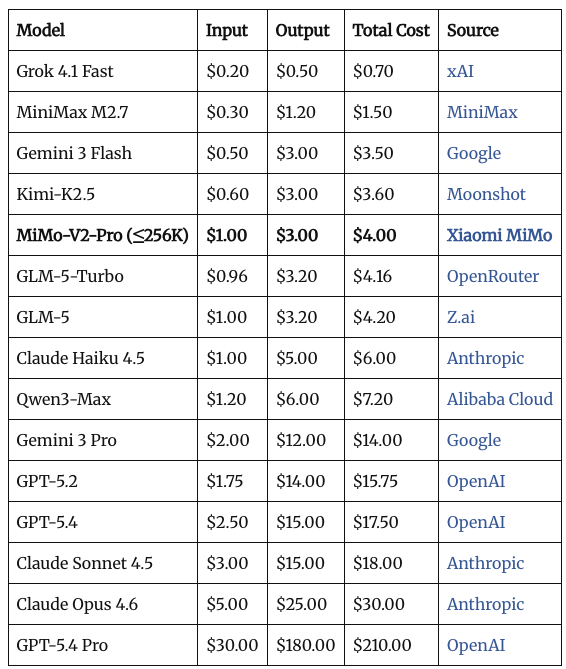

这款模型一亮相就直接把关注度拉满:万亿参数规模,性能对标 GPT-5.2 和 Claude Opus 4.6,而通过自有 API 调用的成本却压到对手的约六分之一到七分之一。

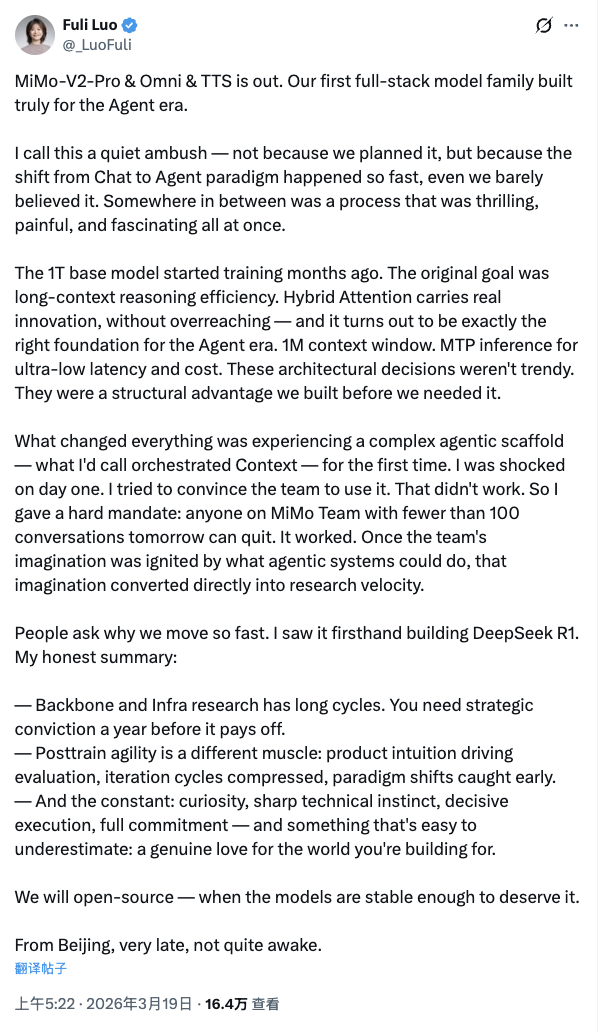

此项目由小米 AI 实验室大模型团队负责人、前 DeepSeek R1 核心成员罗福莉领衔,她将这次发布形容为一次“悄无声息的伏击”。

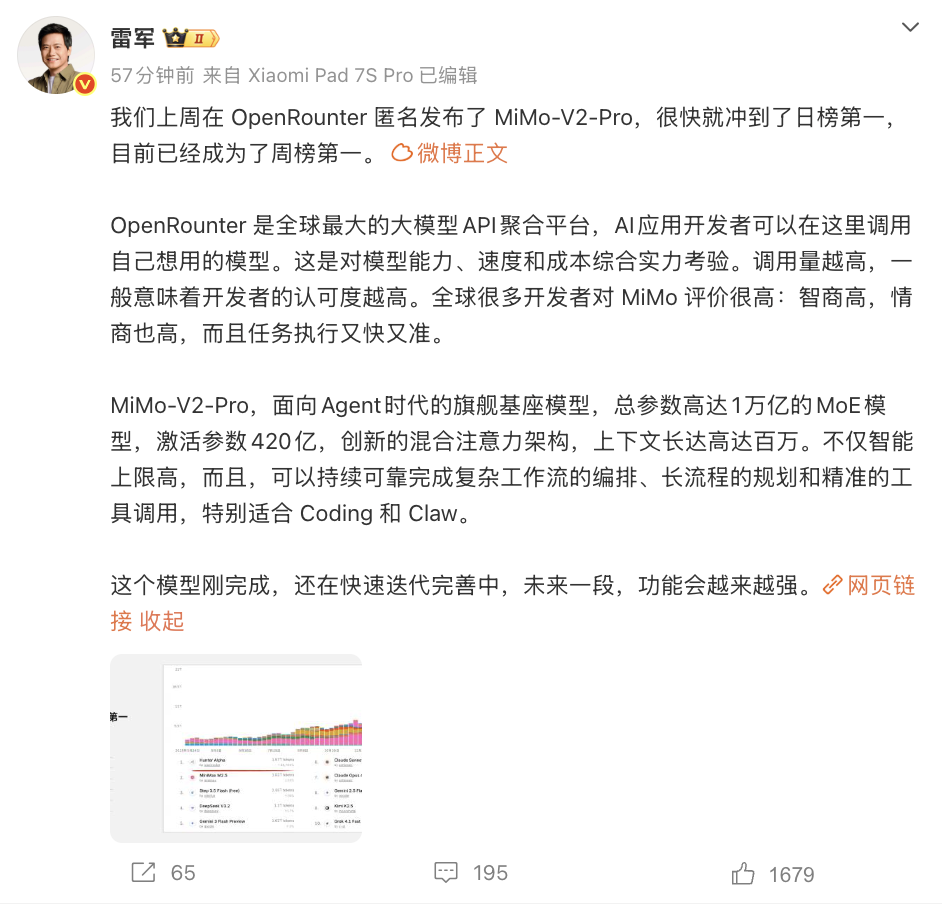

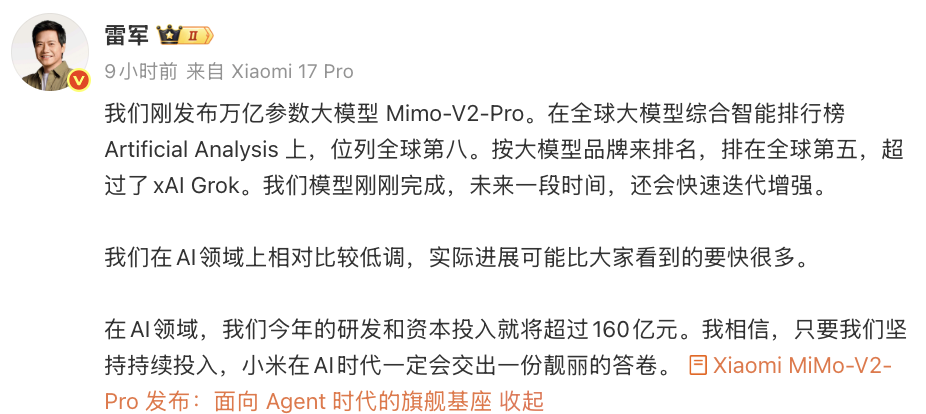

随即,雷军也在微博发文确认,小米上周在 OpenRouter 匿名发布的 MiMo‑V2‑Pro 不仅快速登顶日榜,如今更是成为周榜第一。

MiMo‑V2‑Pro 登场,直接生成成品

很多人对大模型的印象,还停留在陪人聊天、写文案、答问题。但 MiMo‑V2‑Pro 从设计之初就走向了另一条路径。

它的能力不再局限于“回答问题”、“生成 Demo”,而是被打造为 Agent 时代的执行中枢。换句话说,它更像复杂系统的“中央大脑”,可以直接参与代码生成、终端执行、长流程任务规划,甚至多智能体协同与企业级知识处理。

在罗福莉的描述中,这是“小米首个真正为 Agent 时代构建的全栈模型体系”。

小米对它的定位也很明确:不只是工具,而是要成为驱动各类系统与工作流的底层核心,在真实生产环境中持续产生价值。

此次发布之际,小米也晒出了 MiMo-V2-Pro 的一些成果,其已经不只是“能生成代码”,而是更接近“直接交付成品”。

譬如让 MiMo-V2-Pro 用 Three.js 或 Babylon.js 开发一款 3D 塔防游戏,其能够生成完整的、可运行的代码。

此外,当模型被要求复刻一种带有 1990 年代印刷杂志风格的网页设计:标题使用衬线字体,正文采用等宽字体,整体采用多栏排版,版式还刻意带有不对称结构和“出血”效果;图片带有褐色滤镜与颗粒噪点,页面切换模拟翻页效果;导航被设计成类似杂志目录的样式,每一项带编号并在悬停时放大;底部则还原为类似“出版信息”的版块,甚至包含虚构的 ISSN 号。

在这样的复杂提示下,MiMo-V2-Pro 能够一次性生成结构完整、风格统一的网页,而不仅仅是零散片段,整体更接近可直接使用的成品。

万亿参数模型揭晓

不过,“智能体时代”的核心挑战,是在海量数据范围内保持高保真的推理能力,同时避免因延迟或成本带来的“智能税”。

根据官方介绍,MiMo-V2-Pro 通过稀疏架构来应对这一问题。虽然该模型的总参数达到 1 万亿,但在实际运行时,单次仅激活 420 亿参数,规模约为 MiMo-V2-Flash 的 3 倍。

底层架构设计上,其效率来自进化后的混合注意力机制。传统 Transformer 在上下文增长时计算复杂度呈平方级上升,而 MiMo-V2-Pro 采用 7:1 的混合比例(较 Flash 版本的 5:1 有所提升),来管理高达 100 万 token 的上下文窗口。

这一设计让模型在处理长时任务时依然能够保持“深度记忆”,而不会出现性能明显下降。

此外,模型还结合了轻量级的 MTP 多 token 预测层,使其能够同时预测多个 token,大幅降低智能体工作流中“思考阶段”的延迟。

罗福莉表示,这些结构性设计早在数月前就已确定,目的是在行业突然转向智能体时获得“结构性优势”。

MiMo-V2-Pro 位列全球第八,国内第二

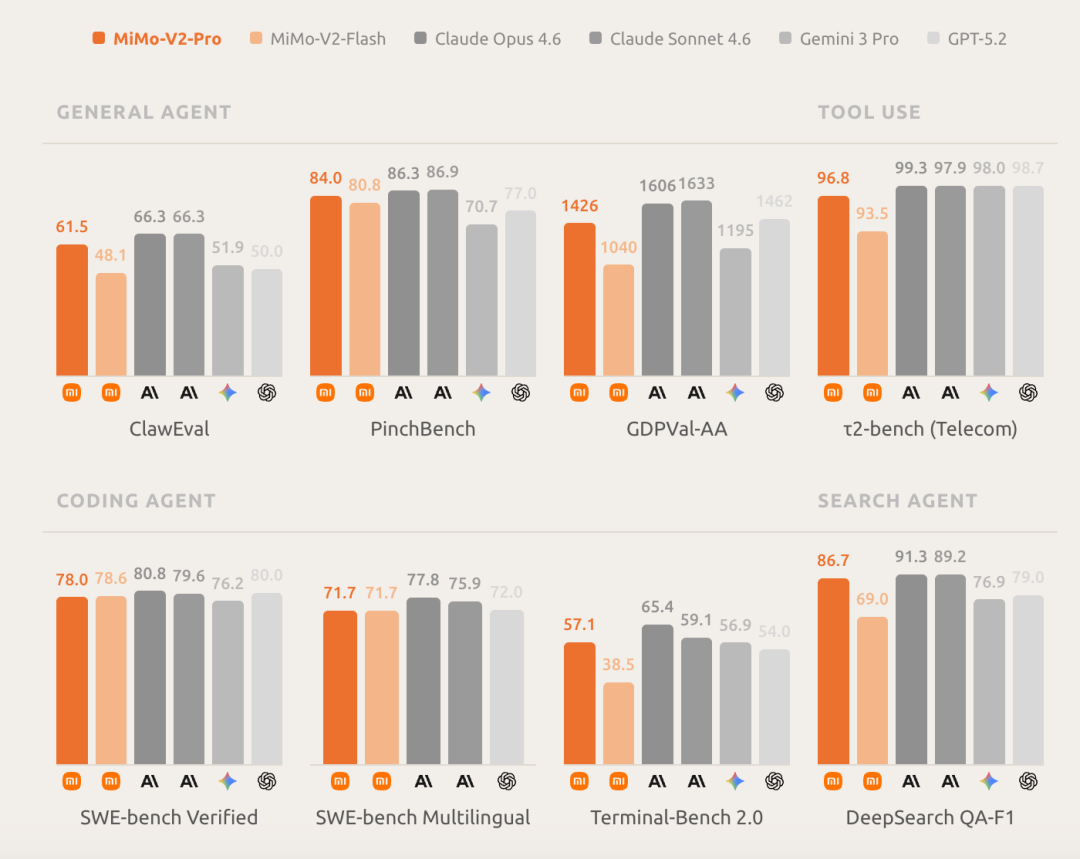

在具体性能表现维度,根据小米官方分享的基准测试结果显示,MiMo-V2-Pro 在主流智能体基准测试中表现出色。其编码能力超越了 Claude 4.6 Sonnet,通用智能体性能(ClawEval)接近 Opus 4.6。工具调用稳定性和准确率也得到了显著提升。

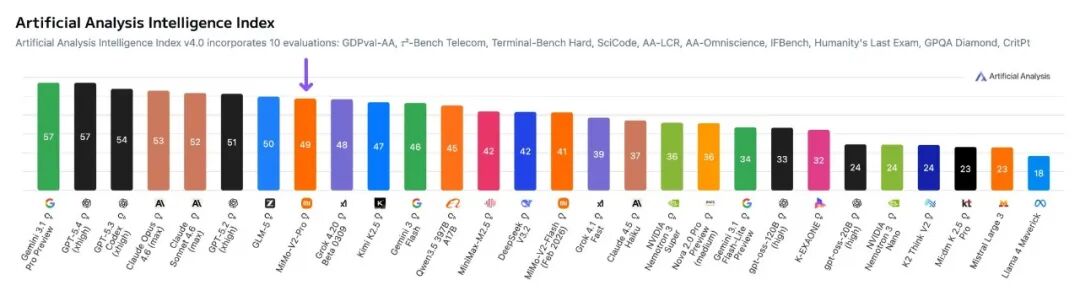

此外,据第三方机构 Artificial Analysis 的评测显示,MiMo-V2-Pro 拿下全球第八,国内第二的好成绩。

从细分维度来看:

➤ MiMo-V2-Pro 在 Artificial Analysis 智能指数中得分 49,仅次于 GLM-5(推理版,50 分),高于 Kimi K2.5(47 分)和 Qwen3.5 397B A17B(45 分)。在综合榜单中排名第 10,位于 GPT-5.2 Codex(49 分)之后、Grok 4.20 Beta(48 分)之前。

➤ 在 GDPval-AA(面向真实世界任务的智能体基准)中,MiMo-V2-Pro 以 1426 Elo 领先同类模型,包括 GLM-5(1406)、Kimi K2.5(1283)和 Qwen3.5 397B A17B(1209)。相比之下,GPT-5.4 和 Claude Sonnet 4.6 的 Elo 分别为 1667 和 1633。

➤ 凭借较低的幻觉率,MiMo-V2-Pro 在 AA 全知指数(Omniscience Index)中获得 +5,领先 GLM-5(+2)、Kimi K2.5(-8)和 Qwen3.5(-30)。不过,Claude Opus 4.6(+14)和 Gemini 3.1 Pro Preview(+33)仍然更高。

➤ 在 token 使用效率方面,MiMo-V2-Pro 更加精简:完成整套评测仅使用 7700 万输出 token,显著低于 GLM-5(1.09 亿)和 Kimi K2.5(8900 万)。

如果说接近第一梯队的性能是惊喜,那么同样让人惊讶的还有它的成本。

成本仅为主流竞品的六分之一到七分之一

Artificial Analysis 实测数据显示,MiMo-V2-Pro 运行整套智能指数测试仅需 348 美元(按输入 $1 / 输出$3 每百万 token 计费)。

尽管得分仅比 GLM-5 低 1 分,但成本更低。

相比之下,GPT-5.2 约为 2304 美元,Claude Opus 4.6 约为 2486 美元。同样的任务,小米模型的成本仅为这些主流竞品的六分之一到七分之一。

与此同时,小米为 MiMo-V2-Pro 制定了极具攻击性的定价策略:

- MiMo-V2-Pro(≤256K):每百万输入 tokens 1 美元,每百万输出 tokens 3 美元

- MiMo-V2-Pro(256K–1M):每百万输入 tokens 2 美元,每百万输出 tokens 6 美元

- 缓存读取(Cache read):低档为每百万 tokens 0.20 美元,高档为每百万 tokens 0.40 美元

- 缓存写入(Cache write):暂时免费(0 美元)

相较其他领先前沿模型,小米的这种定价策略,也直接打破了“顶级大模型=极高成本”的行业惯例,让中小企业、普通开发者都能用上接近 GPT‑5.2 水平的 人工智能 能力。显然,小米的这一策略明显意在抢占开发者市场,推动高强度应用场景的落地。

罗福莉揭晓 MiMo‑V2‑Pro 落地的背后思考

MiMo‑V2‑Pro 的横空出世,离不开核心负责人罗福莉。

对于这次发布,罗福莉也在 X 平台上分享了这款新模型训练的过程与自己的思考,她表示:

「这个万亿参数的基础模型几个月前就已经启动训练,最初的目标是提升长上下文推理效率。Hybrid Attention 带来了真正的创新,但又不过度激进,结果证明它恰好成为 Agent 时代的理想基础:支持 100 万上下文窗口,结合 MTP 推理实现超低延迟与成本。这些架构选择并不是追逐热点,而是我们在需求真正爆发前就构建好的“结构性优势”。

真正改变一切的,是第一次体验复杂的 agentic scaffold——我更愿意称之为“编排后的上下文”(orchestrated context)。那一刻非常震撼。第一天我就试图说服团队去用,但没人买账。于是我下了一个硬性要求:MiMo 团队里,如果第二天对话数少于 100 次,可以直接离开。结果证明,这一招奏效了。一旦团队真正理解了 Agent 系统的潜力,这种想象力就会直接转化为研究速度。

很多人问我们为什么能推进这么快。我在做 DeepSeek R1 时就亲身经历过,可以简单总结为:

— 基础模型和基础设施研究周期很长,需要在一年前就建立战略判断

— 后训练阶段则完全不同,更依赖产品直觉驱动评估,迭代节奏更快,也更容易捕捉范式变化

— 而始终不变的,是好奇心、敏锐的技术直觉、果断执行、全情投入,以及一个常被低估的因素:对你正在构建的世界发自内心的热爱

我们会开源——等模型足够稳定、真正“配得上”开源的时候。」

雷军:Mimo-V2-Pro 超过了 xAI Grok

在模型推出的第一时间,雷军也亲自站台发文庆贺道:“在全球大模型综合智能排行榜 Artificial Analysis 上,Mimo-V2-Pro 位列全球第八。按大模型品牌来排名,排在全球第五,超过了 xAI Grok。我们模型刚刚完成,未来一段时间,还会快速迭代增强。小米在 AI 领域上相对比较低调,实际进展可能比大家看到的要快很多。”

同时他还透露,在 AI 领域,小米今年的研发和资本投入就将超过 160 亿元。

对全球 AI 行业而言,小米发布 MiMo‑V2‑Pro,远不止是推出一款新模型,它更像一个信号:AI 正在从“会说话”,走向“能做事”。

从性能到成本,从架构到定位,小米试图回答一个更本质的问题——在智能体时代,模型到底应该如何参与世界?

而 MiMo-V2-Pro,只是这个方向的起点。如果说过去的竞争是“谁更会对话”,那么接下来的竞争,可能会变成——谁更能行动。

来源:

想了解更多 AI 领域的技术资讯和深度解读?欢迎访问 云栈社区,与广大开发者一起探讨技术前沿。