3 月 19 日,AI 编程工具 Cursor 发布了自研新模型 Composer 2。其官方博客称它来自「我们的第一次继续预训练」,跑分超过了 Claude Opus 4.6。

然而在一天之内,技术社区就发现了端倪:Composer 2 的底层,是基于月之暗面公司的开源模型 Kimi K2.5 微调而来的。但 Cursor 的博客里对此事只字未提。

一个估值高达 500 亿美元的硅谷明星 AI 产品,其核心能力竟然跑在一家中国公司的开源模型上,并且最初没有说明。这件事怎么看都充满了看点。

但 Cursor 事件只是近期一系列信号中最新的一个。同样在本周,更多关键事件接连发生:

- Cloudflare 将 K2.5 上架到其全球边缘计算平台 Workers AI,内部实测成本降低了 77%。

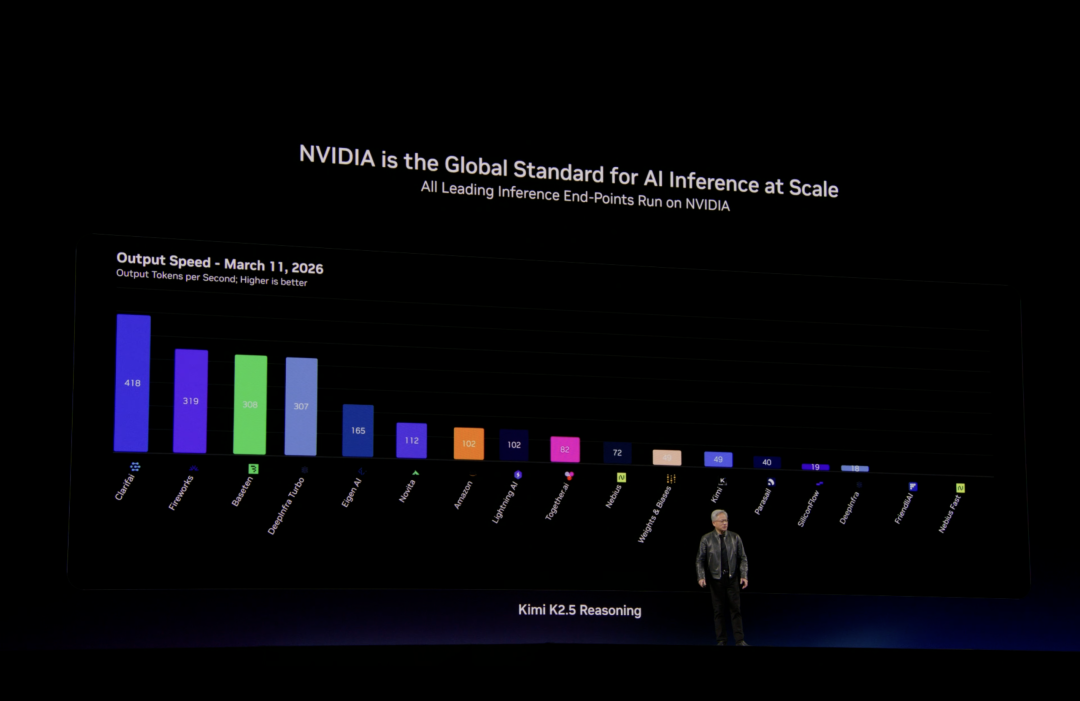

- 黄仁勋 邀请月之暗面创始人杨植麟作为唯一来自中国的独立大模型公司创始人在 GTC 2026 上发表演讲。

- 埃隆·马斯克 在一周内两次公开点赞 Kimi。

而 Kimi 自身,正以投前估值 180 亿美元(约合人民币 1200 亿元)的规模,进行新一轮 10 亿美元的融资。它已成为中国增长最快的“十角兽”公司之一。

从 1 月 29 日开源发布,到 3 月 20 日 Cursor 事件引爆,不到两个月的时间,Kimi K2.5 已经跑进了硅谷从应用层到基础设施层的核心工具链。这一切是如何发生的?

Cursor 的新模型,底层是 Kimi

Cursor 在 3 月 19 日发布了 Composer 2。官方博客写得颇具吸引力:其在 CursorBench 上得分 61.3,超过了 Claude Opus 4.6 的 58.2;在 SWE-bench Multilingual 上达到 73.7,相比上一代 Composer 1.5 的 65.9 有了大幅提升。博客中“我们的第一次继续预训练”这一表述,容易让人理解为这是 Cursor 从头训练的一个编程模型。

但很快有敏锐的开发者通过比对输出特征和行为模式,指出 Composer 2 的底层实则是 Kimi K2.5。随后的信息逐步浮出水面:Composer 2 约 25% 的预训练来自 K2.5 的基座模型,Cursor 在此基础上进行了微调和续训,推理部署则由 Fireworks 完成。

马斯克也在同日于 X 上转发了相关的讨论。

事件发酵后,双方先后出面,将合作定性为授权合作。Cursor 联合创始人 Aman Sanger 的回应很直接:“一开始没在博客里提到 Kimi 的底座,是我们的疏忽。下一个模型我们会改正。”

这件事为什么重要?

首先需要了解一个背景:Cursor 此前只使用 OpenAI、Anthropic 和 Google 的模型,它对模型供应商的筛选标准在行业内是出了名的严格。

而现在,这家硅谷明星产品选择了一个中国公司的开源模型来构建自己的核心编程能力。这不仅仅是“将其加入可选列表”,而是将 K2.5 的权重作为预训练基座,在上面搭建自己的专属模型。

Composer 2 的定价也耐人寻味:标准版为 0.50美元/M input tokens 和 2.50美元/M output tokens,甚至比 K2.5 的官方 API 定价(0.60/3.00)还要低。Cursor 之所以能把价格打到更低,正是因为 K2.5 本身具备极具竞争力的成本结构。

外媒 The Decoder 在 3 月 21 日的报道中分析了 Cursor 最初不披露的原因:“不披露很可能出于竞争定位的考虑……承认依赖(外部模型)会动摇其独立 AI 能力的说法。”

但反过来看,Cursor 选择 K2.5 本身就是最好的技术背书。如果 K2.5 不够出色,一个对模型要求如此苛刻的产品绝不会冒险采用。这不再是“中国公司在模仿硅谷产品”,而是“硅谷产品基于中国模型来构建核心能力”。

Cursor 事件引爆当天,马斯克在 X 上转发并评论,这已是他一周内第二次公开提及 Kimi。

马斯克的第一次转发,源于一篇论文。3 月 16 日,Kimi 团队在 arXiv 上发布了关于 Attention Residuals(注意力残差)的论文,挑战了 Transformer 沿用近十年的残差连接设计。这篇论文在 X 上迅速引爆,获得了数百万阅读量和上万次互动。马斯克转发点赞,AI 领域知名人物 Andrej Karpathy 和 OpenAI 联合创始人 Jerry Tworek 也发表了高度评价的评论。

不止 Cursor:硅谷的基础设施也在接入 Kimi

Cursor 是应用层的一个标志性事件。但与此同时,Kimi 也在打入硅谷的基础设施层和算力层。

Cloudflare 接入 Kimi,成本降低 77%

在 Cloudflare 公布数据之前,硅谷已经有人喊出了更具冲击力的数字。知名投资人 Chamath Palihapitiya 在其拥有超10亿播放量的 All-In Podcast 中公开表示:“我觉得大家还没意识到这个 Kimi K2.5 时刻有多重要……把下一代系统和开源结合起来,AI 的成本能砍掉 90%。” 他甚至宣布取消了所有 OpenAI 的账户。

Chamath 的预测是“节省 90%”,而 Cloudflare 随后用自己的生产数据给出了接近的验证。Cloudflare 在其 Workers AI 平台上架了 Kimi K2.5。Workers AI 是全球最大的边缘计算平台之一,此前平台上的模型均来自 Meta、Google 等美国公司,K2.5 是第一个来自中国的大语言模型。

真正有说服力的是 Cloudflare 内部的使用数据。其官方博客披露:他们内部的安全审查 Agent 每天处理超过 70 亿个 Token,此前使用中等价位的闭源模型年费约 240 万美元。切换到 Kimi K2.5 后,成本降低了 77%。

一个来自投资人的判断,一个来自工程团队的账本,量级基本吻合。被 Cloudflare 选中,不仅意味着多了一个分发渠道,更意味着 Kimi 被编入了全球开发者的默认工具箱,这对 AI创业 生态的影响是深远的。

黄仁勋与 Kimi:从 CES 到 GTC

黄仁勋对 Kimi 的关注并非始于 GTC。在今年1月的 CES 上,他就已经使用 Kimi 模型来验证下一代芯片的性能。对于 NVIDIA 而言,选择哪个模型作为芯片的“验货工具”,本身就是一种技术判断——该模型必须足够复杂、足够考验硬件架构的极限。

两个月后的 GTC 2026,黄仁勋再次选择了 Kimi。他邀请杨植麟在 GTC 做了一场题为“我们如何扩展 Kimi K2.5”的演讲。同时,NVIDIA 在大会上使用 Kimi 模型公开展示其推理能力。

杨植麟是唯一受邀现场演讲的中国独立大模型公司创始人。他在演讲中首次系统披露了 K2.5 的完整技术路线图,并指出了一个关键问题:“很多通用技术标准正在成为 scaling(扩展)的瓶颈。”

翻译过来就是:不能仅仅依靠堆砌算力和数据,必须革新底层架构。他提到的优化器改进、注意力机制重构等,都是模型架构层面的“地基工程”。

将这些信号放在一起看:应用层,Cursor 选择 K2.5 作为底层;基础设施层,Cloudflare 将其部署到全球边缘节点;算力层,NVIDIA 从 CES 到 GTC 连续两次以其作为展示标杆;投资圈,顶尖播客公开喊出“K2.5 时刻”。三层信号,共同指向一个结论:硅谷 AI 圈的核心工具链正在接入 Kimi。

Kimi 做对了什么?

硅谷的工具链为何会选择一个中国开源模型?具体分析,主要有两大原因。

技术路线:从底层架构入手

K2.5 采用了 MoE(混合专家)架构。其总参数量高达 1 Trillion,但每次推理只激活其中的 32 Billion 参数——从 384 个专家模块中挑选 8 个“工作”,其余“休息”。这意味着用户能获得接近万亿参数级别模型的能力,却只需支付 320 亿参数规模的推理成本。

这正是 Cursor 和 Cloudflare 选择它的直接原因:性能身处第一梯队,成本却只有同级别闭源模型的几分之一。

在编程场景的数据上,K2.5 表现突出。其在 SWE-Bench Verified 上达到 76.8%,在 LiveCodeBench v6 上达到 85.0%,后者甚至超过了 DeepSeek-V3.2。这证实了其基座模型本身的质量足够过硬。

更值得关注的是其在底层架构上的持续创新。3月16日发布的 Attention Residuals 论文,用 softmax 注意力机制替代了 Transformer 中固定的残差连接权重,让模型能根据当前输入动态决定“回看”哪些层的信息。实验显示,该技术在 GPQA-Diamond(研究生级别科学推理)任务上带来了 7.5 个百分点的提升。

正如杨植麟所概括的,Kimi 选择了一条不同的路——通过改进底层架构,让同样的算力产出更多的智能。 Cloudflare 实测的 77% 成本降低,正是这条技术路线最直接的商业验证。

开源找到了自己的生态位

必须承认,在绝对能力的最高天花板上,Anthropic 的 Claude、OpenAI 的 GPT 等闭源模型依然领先。但 K2.5 的案例证明,开源模型已经找到了闭源模型难以覆盖的、具备不可替代竞争力的应用市场。

具体而言,是三个关键的生态位:

第一,性价比驱动的大规模部署。 像 Cloudflare 安全审查 Agent 这样每天处理70亿 Token的超大规模场景,使用闭源模型的 API 定价根本不现实。开源模型支持自部署、量化压缩和特定场景优化,这在成本控制上具备巨大优势。

第二,深度可定制性。 Cursor 基于 K2.5 的权重微调出了自己的编程模型 Composer 2。这在闭源世界里是不可能的,因为企业无法获得 Claude 或 GPT 的权重进行深度定制。开源模型的公开权重,为企业在特定领域的优化和定制打开了大门,这正是 开源模型 的核心优势之一。

第三,透明度和信任。 开发者可以审计模型权重、行为,并能进行本地部署。对于安全敏感的企业和政府场景,这并非“锦上添花”,而是“刚性需求”。

K2.5 在 HuggingFace 上的下载量已超过 356 万,GitHub 上有数百个项目集成了它。开源并非在与闭源进行同一维度的战争,它成功地在闭源模型难以覆盖的场景——大规模部署、深度定制、可审计性——建立了自己的坚固壁垒。 而 Kimi K2.5,是目前在这条赛道上跑得最快的选手之一。

Kimi 正在从模型公司,变成 Agent 基础设施公司

Kimi 自身也在快速推进产品化。其提出的“模型即 Agent”路线,正通过一系列产品动作得到验证。

- Agent Swarm(智能体集群):这是 K2.5 带来的激进尝试。一个编排器可动态调度最多 100 个子 Agent 并行执行复杂任务,速度比单 Agent 快数倍,旨在解决“一个 Agent 不够用”的痛点。

- Kimi CLI & GUI:终端里的 AI 编程助手已在开发者社区积累口碑,图形界面版本正在试水,旨在将能力推向更广泛的非技术人群。

- KimiClaw / Openclaw:基于自家模型快速上线的一键部署版 Agent 环境,用户无需搭建服务器即可体验 24/7 在线的智能体服务。

Kimi 正在从一个纯粹的模型公司,转变为一个 Agent 基础设施提供商。

市场数据也在验证这条路线。据 Similarweb 数据,kimi.com 的访问量已达历史新高,最近三个月累计访问量突破 1.2 亿次。这表明,Kimi 不仅在开发者社区有口碑,也正在成为一个拥有庞大用户基数的消费级产品。

从 1 月 29 日开源发布,到 3 月 20 日 Cursor 事件引爆,短短两个月内发生的一系列事件——硅谷明星产品以其为基座、全球基础设施巨头用它大幅降本、顶级芯片厂商连续以其作为技术展示标杆、投资界与科技领袖密集关注——所有这些都指向一个清晰的信号:硅谷的核心 AI 生态工具链,已经开始基于来自中国的开源模型进行构建。

这并非意味着中国模型在所有维度上已全面超越顶尖闭源模型,但在大规模生产部署、深度定制需求与严苛的成本控制面前,以 K2.5 为代表的开源模型,确实找到了属于自己的、坚实而广阔的生存与发展空间。想要了解更多关于人工智能和开源实战的深度讨论,欢迎访问云栈社区的技术论坛。