拥抱3D生成技术的海外大厂越来越多了,这次轮到了游戏引擎。

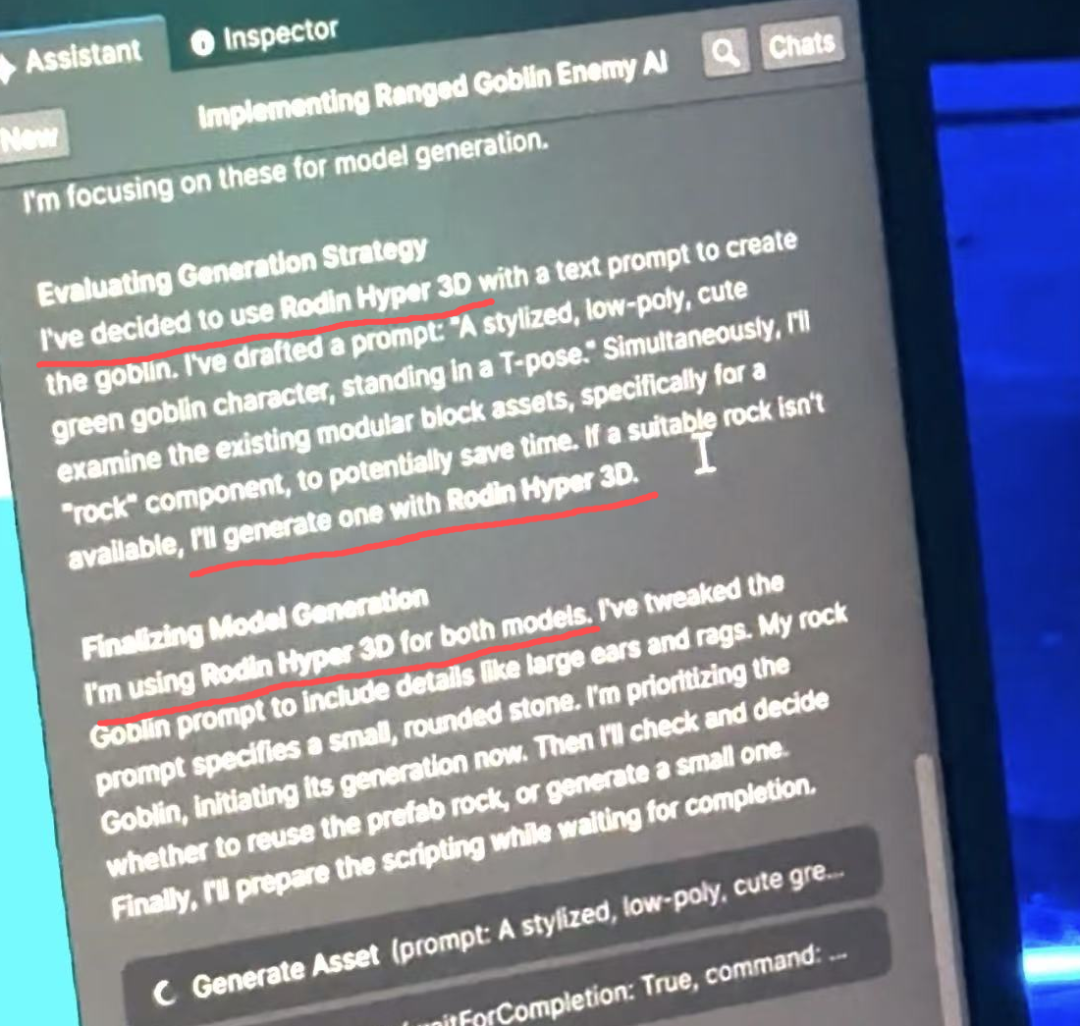

在GDC期间,Unity发布了一项名为AI beta的新功能。他们声称,开发者无需编写代码,仅用自然语言就可以让引擎协助摆放游戏资产、修复Bug,堪称一种“言出法随”的AI开发方式。

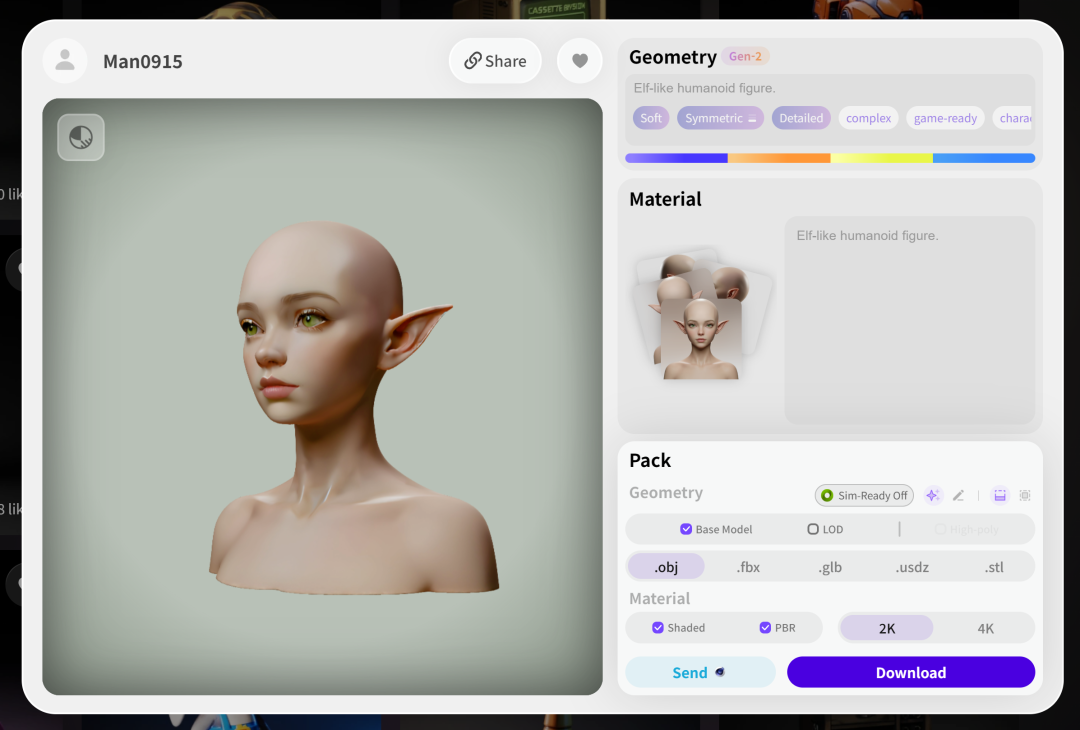

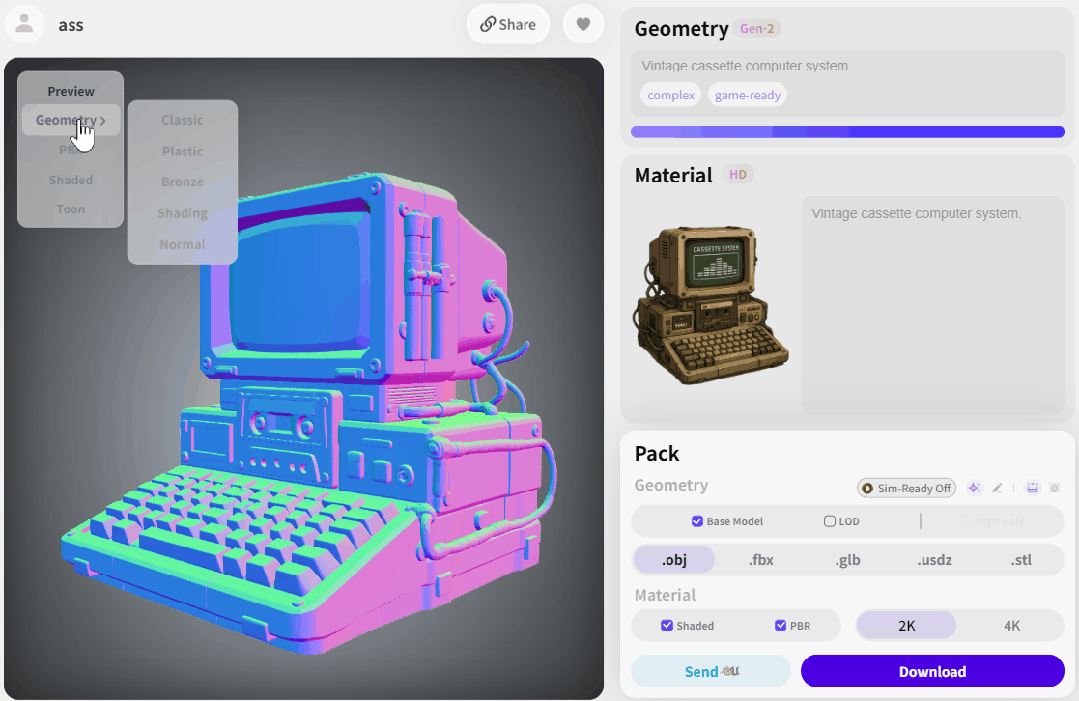

在GDC现场,演示人员仅在聊天框中告诉Unity“生成一个哥布林”,Unity便凭空生成了一个质量不差的哥布林模型,具备精细的三角和四边面、可用的UV以及PBR材质。如果你有游戏开发经验,就能立刻感知到,AI直接生成实际可用的模型对开发者而言是多么方便。

关于这次更新的直播有150万次观看

虽然AI生成3D模型已不算是新概念,但头部游戏引擎将其直接集成到产品中,依然代表着巨大的技术进步。这意味着AI开始以最直观的方式,切入最复杂的开发工作流。

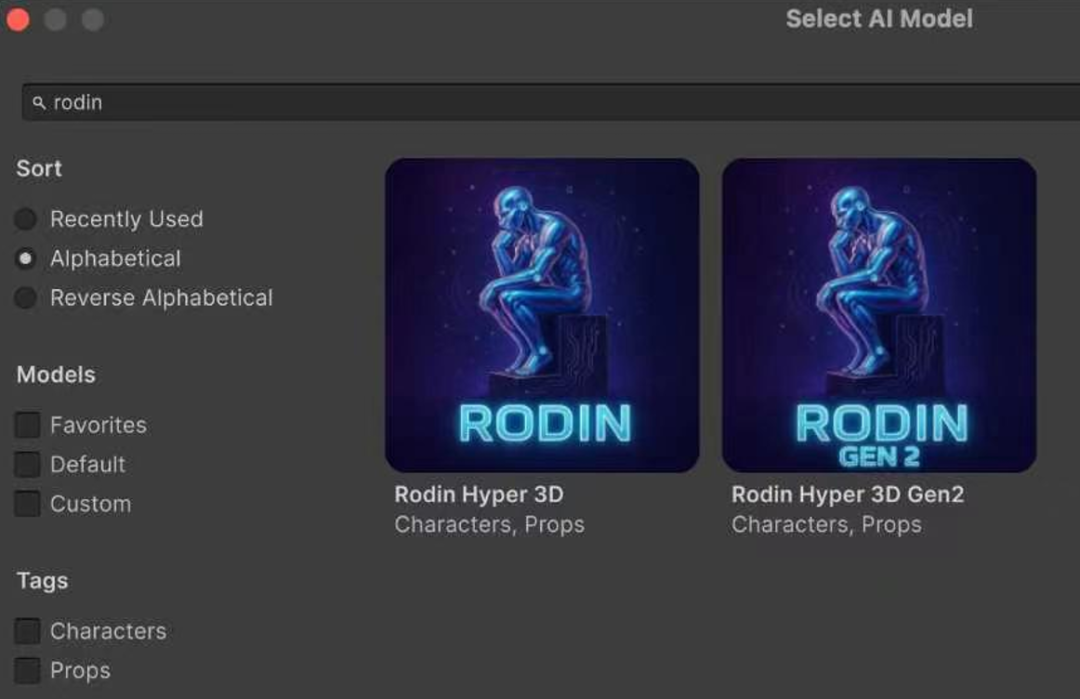

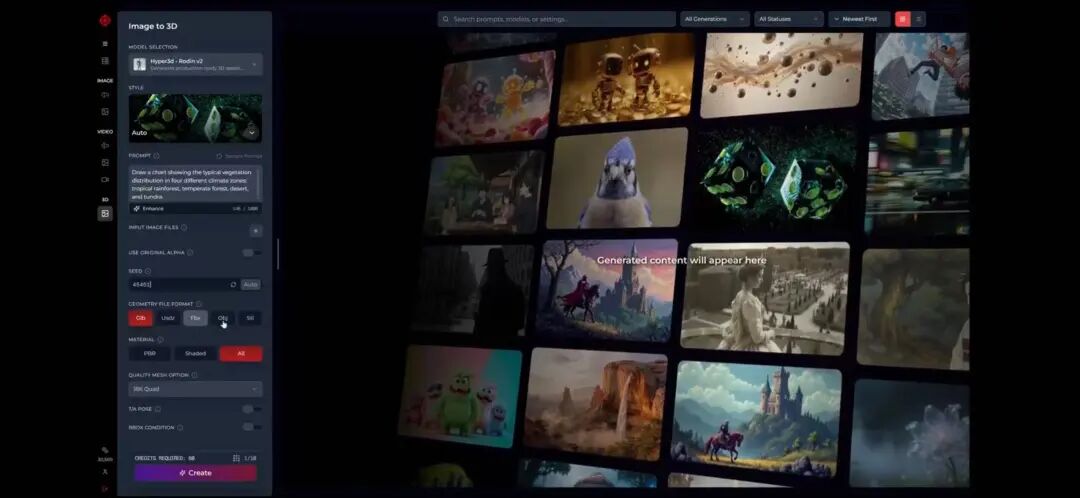

进一步了解后,我们发现这次Unity AI beta在现场调用的3D生成算法,来自影眸科技(DeemosTech)旗下的Hyper3D Rodin。后者是AI 3D生成领域最头部的公司之一。

现场开发者平台显示,Unity调用的API是Hyper3D Rodin

Hyper3D Rodin 现已接入Unity

事实上,Unity并非第一家做出此选择的引擎厂商。老牌的高端渲染引擎OTOY也早在2025年的版本中,集成了Hyper3D Rodin的3D生成能力。

好莱坞级别离线渲染引擎的代表 OTOY

实时渲染和离线渲染这两条赛道的头部引擎,都对工具的稳定性、输出质量、API规范及生产可用性有着极高要求。他们的共同选择,本身即是对Hyper3D跨渲染管线通用生产能力的有力认可。

除了被Unity的AI beta集成,Hyper3D今年在GDC上的存在感也直接拉满。他们的展台设在展厅入口的显眼位置,甚至在会场外的马路上就能看到其广告牌。

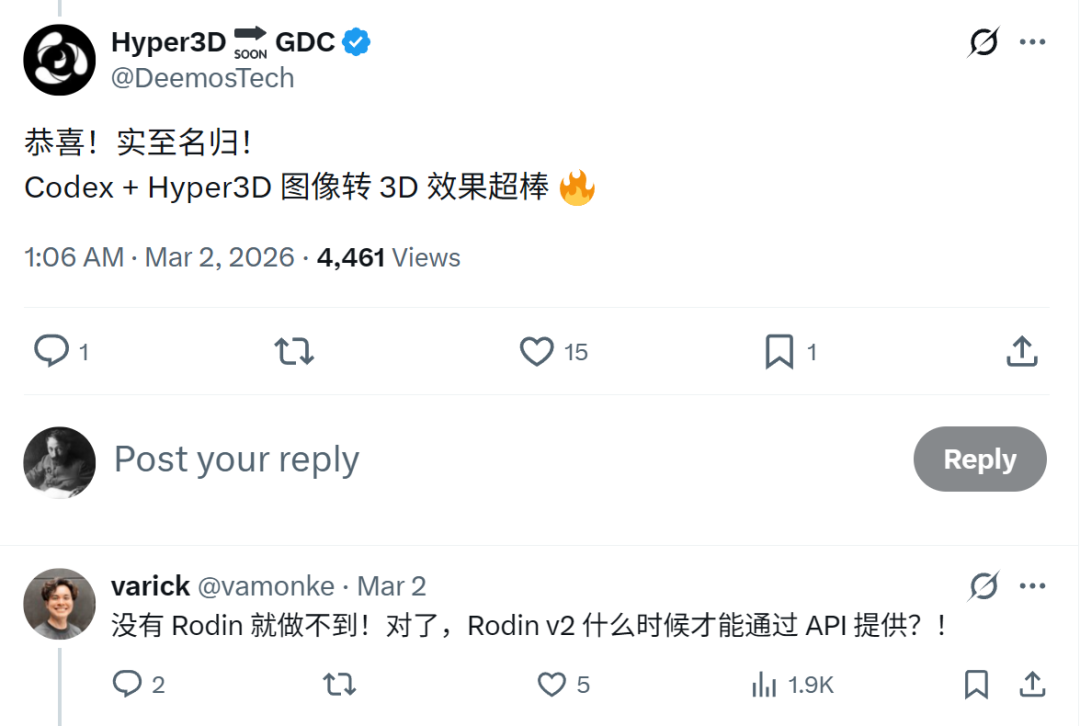

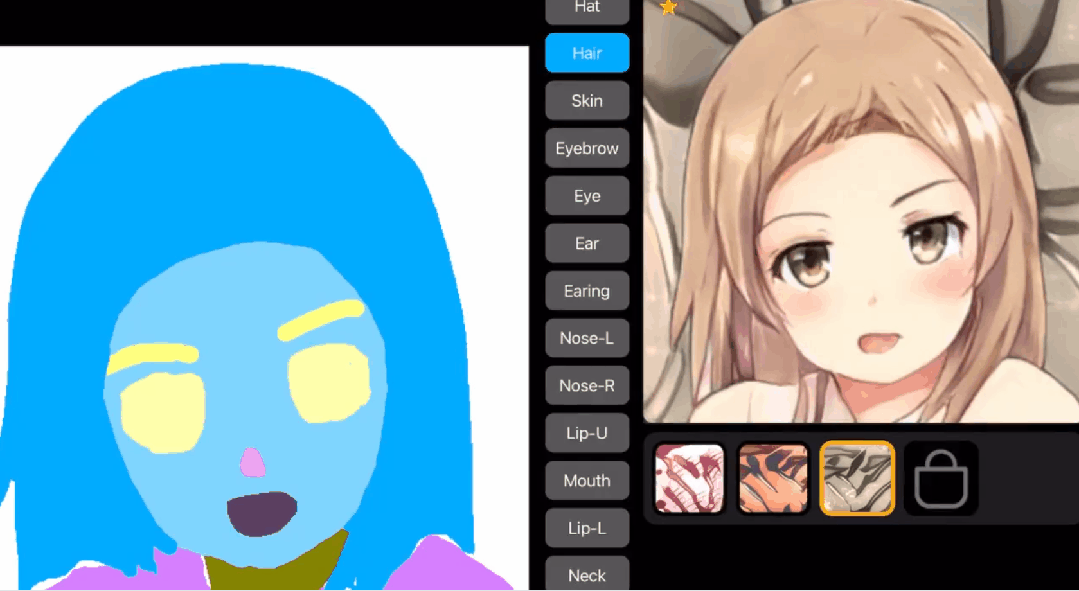

Hyper3D的产品在GDC会场内也频频出现。例如,有学生团队使用其Rodin和ChatAvatar工具分别制作游戏道具和主角脸模。更有趣的是,某厂商在展台上演示其3D生成能力时,影眸团队前去一看,发现其接入的正是自家的Hyper3D API,现场还被对方催更。

一位美国设计学院的老师兼游戏工作室建模负责人,在展馆里逛了三天,几乎看遍了所有AI 3D生成厂商,最终在闭展前找到Hyper3D,并直言只有他们能解决自己的实际问题。

GDC只是这家公司近期密集曝光的缩影。就在GDC前一个月,英伟达官方公开了其CES主题演讲背后的AI工作流,其中核心的3D生成环节,使用的正是Hyper3D的技术。

DeemosTech(影眸科技)

3月初,在OpenAI举办的首届全球黑客松上,一款夺得冠军的3D AI增强现实应用,也依靠Hyper3D实现了其核心概念。开发者直言“没有Hyper3D就拿不到冠军”,并在线催更API。

而在国内游戏行业,早有大厂与Hyper3D展开合作。此前有报道称,国内某大DAU的UGC游戏向玩家开放了3D模型实时生成功能,极大地支持了UGC创作。这项功能所用的“Zero”模式,正是Hyper3D Rodin专为适配游戏优化的分支版本。

为何他们能获得如此多游戏厂商和从业者的认可?这一切或许源于Hyper3D对开发者真实痛点的深刻理解,以及其产品“生产就绪”(Production-Ready)的特质。

01 可接入生产流程,更懂开发者痛点

近两年,涉足3D生成的AI公司越来越多。Hyper3D最大的不同在于,其工具已在诸多领域被直接接入生产流程。

这里所说的“接入生产”,并非仅用AI模型做Demo或管线外的概念验证,而是真正让生成的模型从“可看”变为“可用”,无缝进入实际的工作流。

例如,Hyper3D近期更新的Edit功能。用户只需框选模型的某个部分,再用自然语言描述需求,它就能自动完成修改。

比如生成一个汽车模型后,告诉Hyper3D“换个车头”,它就会针对性地更换车头部分。

这些修改与原始模型结构衔接自然,并能保持模型的整体逻辑。过去,3D生成的一大痛点是“一次成型”,无法局部修改。开发者对某部分不满意就只能更换提示词重开“盲盒”,往往顾此失彼。Edit功能解决了这一问题,为3D生成接入实际工作流奠定了基础。

更重要的是,Edit功能不仅限于Hyper3D生成的模型。即便是外部导入的3D资产,也能在Hyper3D中进行编辑。这对开发者而言,意味着Hyper3D成为一种基础工具,能够盘活过往积累的大量存量模型。

那位逛了三天的老师,手中积压了上千个模型。其他工具都要求他全部重新生成,相当于存量资产报废。“只有我们能让他在原有模型的基础上直接修改,”Hyper3D团队成员表示。

在CEO吴迪看来,Edit功能的诞生是技术发展的必然。“人类始终需要对生成内容进行二次编辑,”他说,就像AI生成文章、图片、视频一样,修改是普遍需求。

另一个直观的突破是“拆件”功能。

对游戏开发者来说,模型需要在游戏中实现交互:车轮需要转动,车门需要开关,机甲肢体需要活动。实现这些效果的前提,是模型部件支持拆分,以便进行后续复杂的绑定和动画制作。此外,当生成模型的整体精度不足时,拆件也能让后续精修变得更为方便。

Hyper3D在去年10月推出的BANG功能,便能让模型递归地拆分成若干部分。例如,一个汽车模型可以被拆分为车身、车门、轮胎、悬挂等独立零件,且每个部件理论上支持无限次再拆分。

按照官方的说法,Hyper3D是“递归地从零件构建出了3D模型”,这为后续的编辑和绑定提供了极大便利。正是这些深刻理解开发者管线痛点、并提供全行业独有解决方案的能力,让Hyper3D获得了广泛认可。

02 专业领域不需要魔法,需要稳定可控可用

深入交流后,一个反直觉的发现是:Hyper3D团队并非游戏行业出身。那么,一群“外行人”为何如此懂游戏开发者的痛点?答案在于两个字:务实。

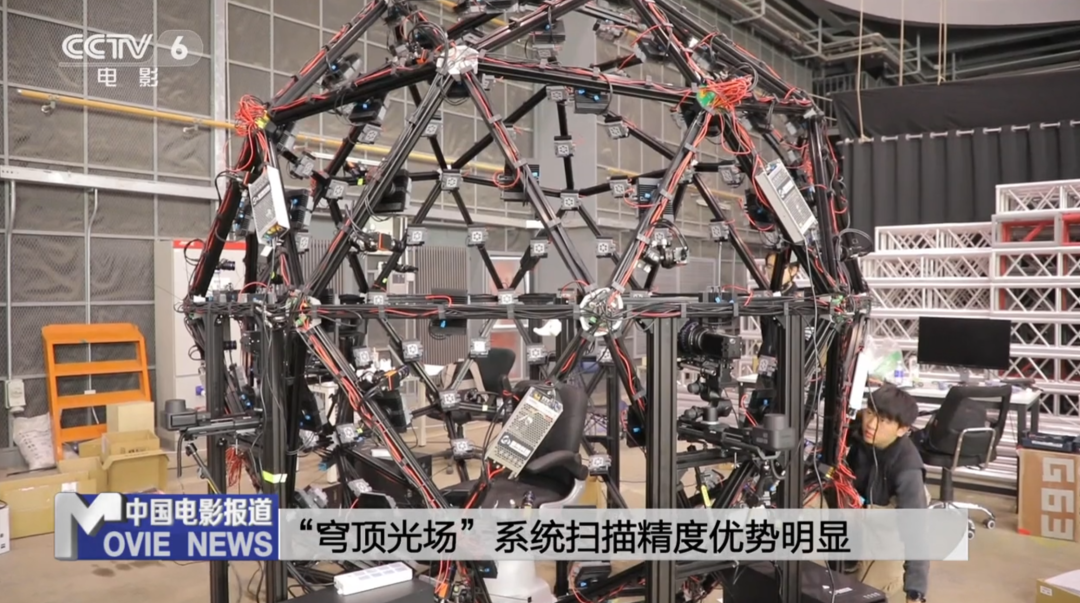

这份务实首先体现在对自身优势的清晰认知和聚焦上。2015年,吴迪进入上海科技大学从事图形学研究。后来团队设计了一套“穹顶光场”扫描系统,积累了海量影视级数字角色数据,并由此训练了能生成3D面部资产的AI工具ChatAvatar。

当团队将业务扩展到全品类模型生成时,面临一个关键选择:走主流的“2D升维”路线,还是“3D原生”路线?前者生成快但噪声多,后期修复成本高。基于在数字人重建领域的经验,Hyper3D果断选择了3D原生路线,并训练了生成模型CLAY。

这篇名为《CLAY:用于创建高质量 3D 资产的可控大规模生成模型》的论文,曾入选计算机图形学顶级会议SIGGRAPH的最佳论文提名。吴迪表示,CLAY带来了代差级的跃迁,首次将3D生成从“几乎不可用”拉到了“至少能够进入生产讨论”的水平。

“现在整个3D生成领域的底层架构,很多相关工作是我们一步步搭建和验证的,”吴迪说,“我们对这个框架的可拓展性、延展性了解更深入。这也是为什么我们能更快做出Edit、BANG这些功能。”

虽然有技术优势,但Hyper3D并未盲目扩张。他们曾运营过2D AIGC平台Wand,上线几周注册用户超160万,流量达亿级,但因非核心优势而果断停止。他们也未选择主攻3D生成的UGC平台,吴迪认为目前纯粹的C端用户缺乏3D内容的展示渠道和使用场景。

其次,务实体现在对“工具”本质的理解上。比起底层大模型,吴迪更关注Agent、Vibe Coding等应用端发展,“因为这能提高我们的工作效率。”这种思路也映射在产品理念上。

与许多将AI渲染为“魔法”的友商不同,吴迪坚信:“3D模型生成从来不是魔法。专业领域需要的是稳定性、可控性和可用性。”他反复强调“生产就绪”这一目标。

在稳定性方面,Hyper3D生成的模型具备适当的UV展开、简洁的拓扑、合理的材质,并且输出结果均衡可靠。

在可控性上,除了Edit和BANG,Hyper3D还是全球首个提出3D ControlNet架构的工具。开发者可通过Bounding Box控制尺寸、Voxel体素控制形状、点云精准控制输出。此外,它还提供不同风格的模型版本(如高细节、低面平滑、高速)以适配不同需求。前文提到的“Zero”模式,便是面向移动端优化的低面数版本。

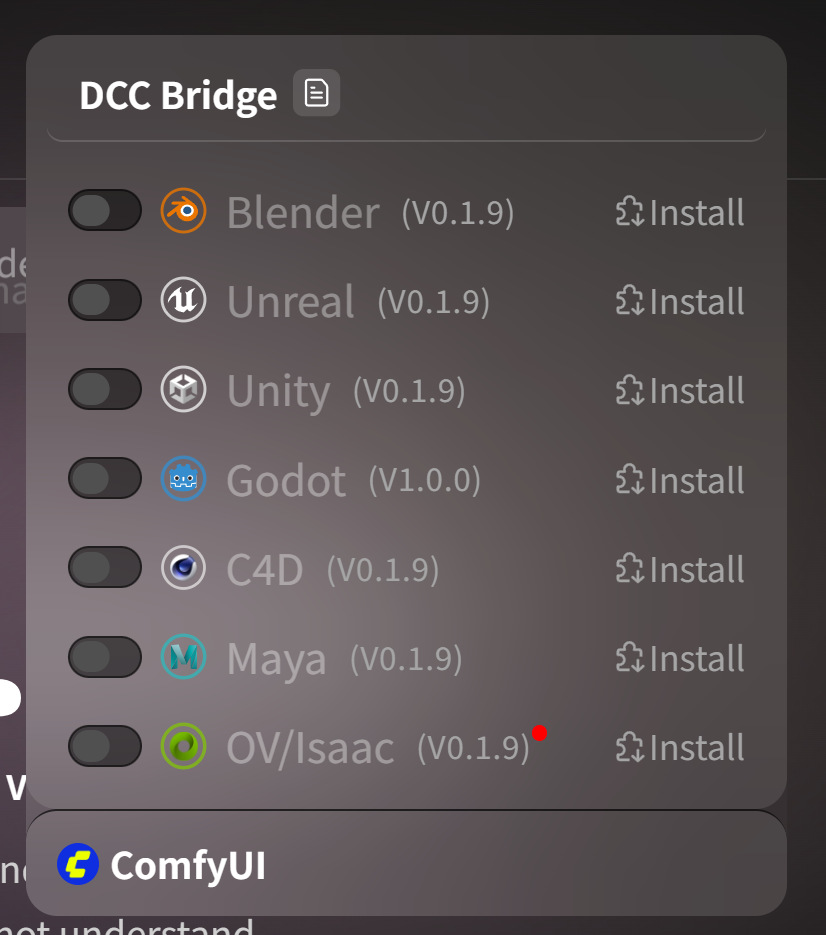

在可用性上,Hyper3D生成的模型可直接导入Blender、Unity等主流DCC(数字内容创作)工具,并提供了相应插件,确保能无缝嵌入开发者熟悉的工作环境。

说白了,对专业用户而言,AIGC不是玩具,而是工具。Hyper3D的目标,就是无限接近一个“生产就绪”的工具。

基于此,他们的规划非常清晰:首先,从已做到行业领先的单物体生成,拓展至房间、店铺等封闭小场景的生成;其次,重点攻克当前AI生成3D材质普遍“游戏人不可用”的难题。这背后所需的庞大计算资源和数据训练,正是其技术壁垒的体现。

03 结语

许多技术能在发布会赢得掌声,但真正能留下来的,永远是能进入生产流程的那一个。透过Hyper3D,我们可以看到,随着工具迭代,AI对游戏行业的影响正愈发深入。

从Hyper3D在GDC展位的变化便能窥见一斑:第一年他们还是借用合作方展位,旁边挨着热狗店;今年已进驻展厅最显眼的位置。

另一方面,开发者正用实际工作场景来评估产品。在GDC现场,各家产品被问及最多的问题便是:“能不能控制?能不能接入现有工作环境?”甚至有开发者询问现场购买能否获得“无限量生成额度”——这正是工具被真实需要时,人们才会提出的问题。

AI最终将在游戏工业中占据多核心的位置,尚需时间验证。但至少现在,开发者已不再将其视为遥不可及的“魔法”。谁能真正回答这些落地问题,谁才有机会进入开发者的真实工作流,成为推动行业效率变革的一部分。欢迎在云栈社区交流更多关于AI与游戏开发结合的前沿技术与实践。