想象一下这个场景:一位用户在周一联系某电商平台的智能客服,咨询了一款高端相机的详细参数和优惠活动,并明确表示“我倾向于购买A品牌”。客服助手热情地解答了问题。

到了周三,这位用户再次联系客服,想了解这款相机的配件和保修政策。然而,由于大模型的上下文窗口限制,它完全“忘记”了周一的对话,甚至可能向用户推荐B品牌的相机。这种体验无疑是割裂且令人沮丧的。

这正是大语言模型(LLM)在智能客服、虚拟助手等需要深度个性化和上下文连贯性的场景中面临的根本性挑战——有限的上下文窗口。它无法记住上一次对话的内容,更无法跨会话积累对用户的理解,使得应用价值大打折扣。

传统的解决方案,如简单地将历史对话拼接到当前请求中,很快就会触及Token上限。而引入一套独立的向量数据库来管理记忆,则往往带来架构复杂、成本高昂、数据孤岛以及实时性不足等问题。

今天,我们将介绍一种创新且高效的范式:Hologres + Mem0。这套组合利用 Hologres 作为统一的实时数据基础设施,结合开源框架 Mem0 的自动化能力,为企业级 LLM 应用构建一个高性能、低成本、高可用的长记忆引擎。

方案全景:Hologres + Mem0 长记忆架构深度解析

1. Mem0 是什么?

Mem0 是一个开源框架,专为管理 LLM 的个性化记忆而生。它的核心价值在于自动化地完成记忆的提取、存储、检索和上下文融合的整个生命周期。

Mem0 项目地址:https://github.com/mem0ai/mem0

2. Hologres 的角色:不止于向量库

在此方案中,Hologres 扮演着统一实时数仓的角色,成为整个长记忆系统的坚实底座。它负责所有结构化和非结构化数据的持久化存储与高性能检索,而不仅仅是一个向量库。

3. 架构图解:数据如何流动

整个流程闭环运行,各司其职:

- 记忆提取: Mem0 框架中的提取器会监听用户与大模型的对话流,自动识别出具有长期价值的信息(如“我喜欢科幻电影”),并生成结构化的记忆条目。

- 向量化: Mem0 调用指定的文本嵌入模型(如 text-embedding-v4),将这些记忆条目转化为高维向量。

- 统一存储: Mem0 将向量、原始文本、用户ID、时间戳、自定义标签等所有数据,通过标准接口写入 Hologres。Hologres 负责高效、可靠地持久化这些数据。

- 智能检索: 当需要检索记忆时,Mem0 将查询向量化后,向 Hologres 发起检索请求。Hologres 利用其内置的 HGraph 向量索引,在毫秒内执行 Top-K 相似度搜索,并返回最相关的记忆片段及其元数据。

- 上下文融合: Mem0 接收到来自 Hologres 的检索结果后,将其按相关性排序,并以自然语言的形式动态拼接到 Prompt 中,形成增强输入,最终交给大模型进行推理。

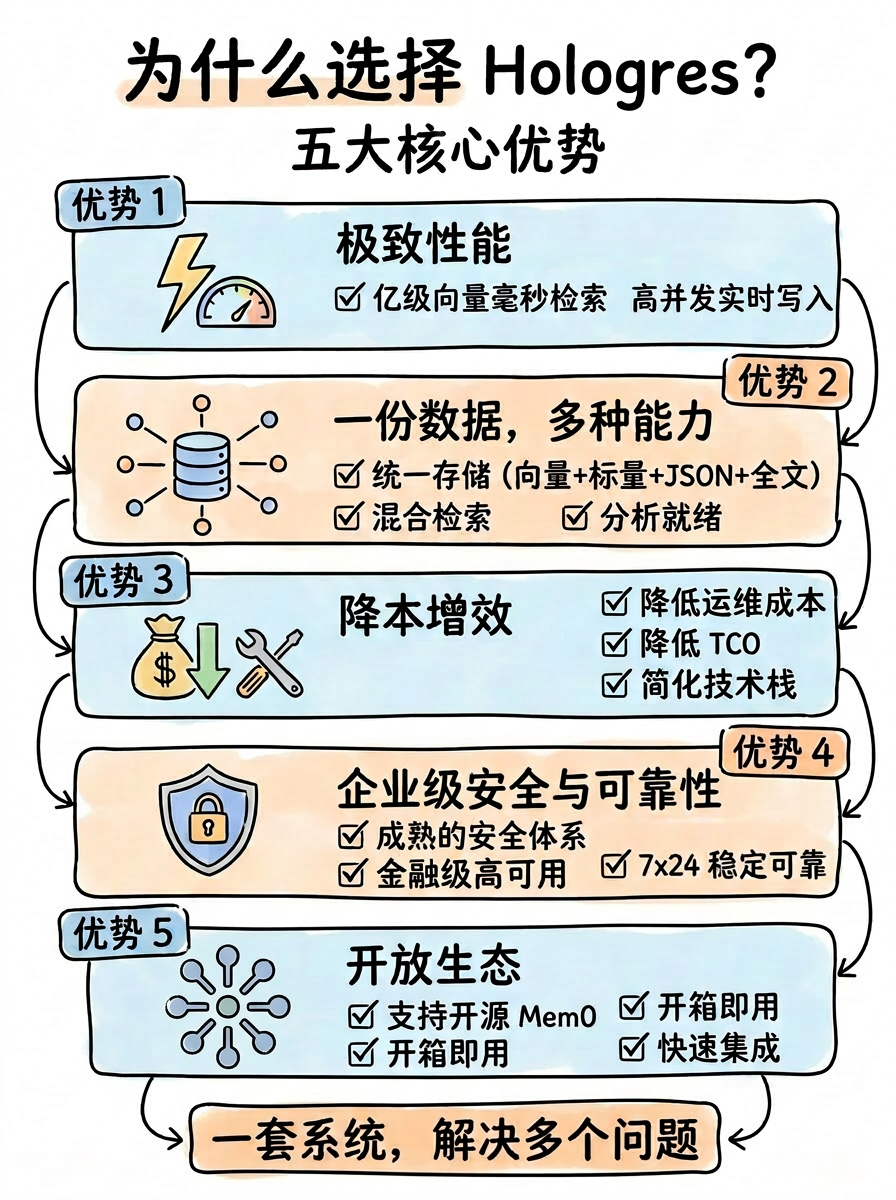

为什么是 Hologres?五大核心优势详解

优势一:极致性能,满足在线服务严苛要求

- 亿级向量毫秒检索: Hologres 内置的 HGraph 向量索引,专为大规模、高并发场景优化,轻松应对在线推理的低延迟需求。

- 高并发实时写入: 支持每秒数万条记忆记录的实时写入与更新,确保用户的最新偏好和行为能即时生效,避免“记忆滞后”。

优势二:一份数据,多种能力,打破数据孤岛

- 统一存储: 向量、标量(如用户ID)、JSON(如元数据)、全文文本均可在同一张表中存储,彻底告别多套存储系统。

- 混合检索: 支持

向量相似度 + 关键词匹配 + 标量过滤 的复杂查询。例如,可以精确检索“用户 alice 关于 movies 类别的记忆中,与‘推荐’最相关的条目”,灵活性远超纯向量数据库。

- 分析就绪: 存储的记忆数据本身就是宝贵的业务资产。数据分析师可以直接在 Hologres 上进行 SQL 查询、BI 分析,洞察用户行为模式,无需额外的 ETL 流程。

优势三:显著降本增效,简化技术栈

- 降低运维成本: 无需单独部署、监控和维护一套向量数据库。复用 Hologres 成熟的高可用、自动备份、弹性扩缩容和监控告警体系,极大减轻运维负担。

- 降低总体拥有成本 (TCO): 避免了多套系统的许可费用、资源冗余和人力开销,用一套系统解决多个问题。

优势四:企业级安全与可靠性

- 成熟的安全体系: 继承 Hologres 完善的企业级安全特性,包括细粒度的 RAM 权限控制、VPC 网络隔离、SSL/TLS 传输加密、TDE 存储加密等。

- 金融级高可用: 提供同城双活、异地灾备等高可用架构,保障记忆服务 7x24 小时稳定可靠。

优势五:开放生态,快速上手

- 基于开源: Mem0 本身是开源项目,社区活跃,代码透明,便于开发者理解和定制。

- 开箱即用: 阿里云提供了完整的 Python SDK 和详细的示例代码,开发者可以快速集成到现有 人工智能 应用中。

典型应用场景

- 个性化智能客服: 记住用户的购买历史、产品偏好、过往投诉记录,提供连贯、精准、有温度的服务,大幅提升客户满意度。

- 企业知识助手: 长期记忆员工的项目进展、会议纪要、待办事项和内部知识库,成为每位员工高效的个人工作伙伴,提升生产力。

- AI 游戏 NPC: 为游戏中的非玩家角色(NPC)赋予持久记忆,使其能记住玩家的行为和选择,创造更沉浸、更真实、更具叙事性的互动体验。

快速上手:五分钟构建你的长记忆系统

Mem0 支持 OpenAI、Gemini、DeepSeek 等多种大语言模型。下面我们将基于 Mem0 框架 + 阿里云大模型服务平台百炼 + Hologres 进行实践。

第一步:准备工作

- 部署 Mem0: 参考示例代码 mem0_hologres 部署Mem0,你可以任意选择一种方式:

- 托管平台 (Hosted Platform): 在 Mem0 官网 注册,通过 API Key 快速接入。

- 开源自建 (Self-Hosted): 直接使用我们提供的示例代码。你需要配置阿里云百炼的 API Key 和 Hologres 连接信息,然后运行示例脚本即可体验完整的记忆添加、检索和删除功能。

- 部署 Hologres: 参考官方文档创建 Hologres 实例,并连接你的 Hologres 实例,执行

CREATE DATABASE mem0;

第二步:在 mem0 开发环境安装依赖

打开示例代码所在目录,创建、激活虚拟环境,并安装所需的依赖库。

cd /home/mem0_hologres

python3.11 -m venv myenv

source myenv/bin/activate

pip install -e .

pip install “psycopg[pool]” / pip install psycopg2-binary

第三步:配置与运行

阿里云大模型服务平台百炼为开发者提供了兼容 OpenAI 的 API 及全链路模型服务。详细的代码示例和配置说明,请参考最佳实践文档:《最佳实践:基于Mem0实现大模型长记忆》。

总结与展望

Hologres + Mem0 的组合,不仅仅是一个技术方案,它代表了一种更简洁、更高效、更具成本效益的大模型应用构建思路。通过将长记忆能力下沉到统一的数据基础设施层,我们能够以更低的成本、更高的可靠性,释放大模型的全部潜力。

立即行动:

如果你想了解更多关于大模型、向量数据库以及云原生技术的实践与讨论,欢迎访问 云栈社区 的相应板块,与更多开发者交流心得。 |