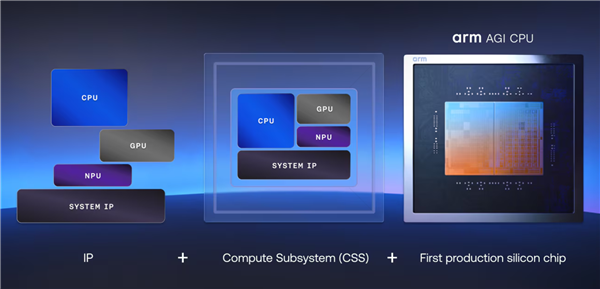

一直以来,Arm 都以其 IP 授权商业模式著称,向合作伙伴提供包括 CPU、GPU、NPU 在内的各种系统 IP。随后,Arm 推出了计算子系统(CSS),这相当于一个集成了多种 IP 的平台级解决方案,客户可以基于此快速设计出完整的芯片,例如小米的玄戒平台。

如今,Arm 宣布其计算平台战略迈入了全新阶段:首次亲自设计并推出量产芯片,其首款产品便是名为“AGI CPU”的数据中心处理器。

这可以类比为 NVIDIA 或 AMD 不仅出售 GPU 芯片,也推出自有品牌的公版显卡。这款由 Arm 自主设计的 CPU 芯片,主要面向 人工智能 数据中心,旨在应对日益增长的代理式 AI(Agentic AI)工作负载,同时帮助生态伙伴快速、大规模地部署基于 Arm 平台的量产系统。未来,合作伙伴可以根据自身需求,灵活选择 Arm 的 IP 授权、CSS 方案,或者直接采购并部署 Arm 的成品芯片。

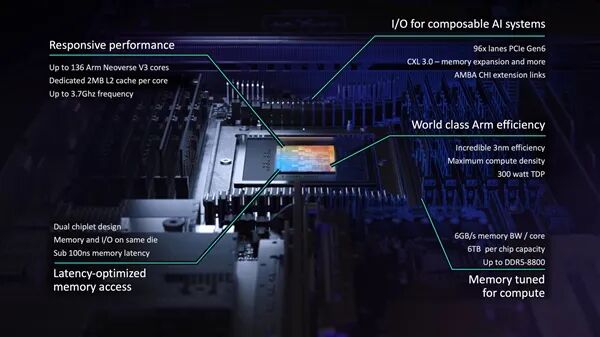

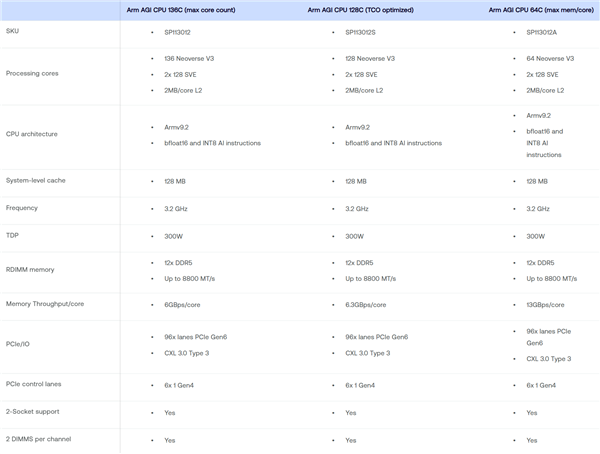

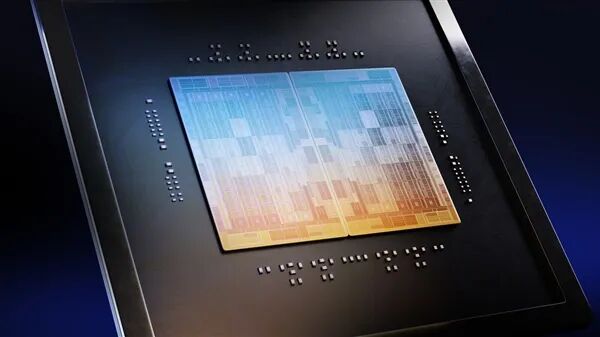

Arm AGI CPU 基于 Armv9.2 指令集和 Arm Neoverse V3 CPU架构,并支持 bfloat16、INT8 等 AI 专用指令集。 这套核心架构如今也支撑着众多数据中心级别的 CPU,例如 NVIDIA Grace、亚马逊 Graviton、谷歌 Axion 以及微软 Azure Cobalt。

在制造工艺与核心配置上,它采用台积电 3nm 工艺制造,提供了 136 核、128 核和 64 核三种规格,支持单路和双路部署。 每个核心配备两个 128-bit 可伸缩矢量扩展(SVE)单元和 2MB 的私有二级缓存(L2 Cache),使得芯片总二级缓存最大可达 272MB。此外,芯片还集成了 128MB 的系统级三级缓存(L3 Cache)。基础频率为 3.2GHz,热设计功耗(TDP)为 300W。

内存方面,支持 12 通道 DDR5,每通道支持 2 条内存模组,最高速率可达 8800 MT/s。 每核心内存带宽高达 6GB/s,内存访问延迟被优化至低于 100 纳秒。

I/O 扩展能力极为强劲,提供了 96 条 PCIe 6.0 通道,支持 CXL 3.0 Type 3 协议,并额外提供 6 条 PCIe 4.0 控制通道。

Arm 官方的参考服务器设计采用 1OU 双节点形态,基于符合开放计算项目(OCP)标准的 DC-MHS 规格。每个刀片服务器节点搭载两颗 Arm AGI CPU,并配有独立的内存和 I/O 子系统,总计 272 个核心。

这些刀片服务器可以在标准风冷、功率为 36 千瓦的机架中满配部署,最多容纳 30 台,从而在一个机架内提供总计 8160 个核心。 此外,Arm 还与超微(Supermicro)合作,推出了 200 千瓦的液冷设计方案,该方案可容纳多达 336 颗 Arm AGI CPU,核心总数超过 45,000 个。

Arm 宣称,其 AGI CPU 在单核、SoC、刀片服务器乃至整个机架层级上,均实现了行业领先的性能表现,尤其是一个完整机架的性能可达同类 x86 平台的两倍以上。 更高的单线程性能与能效可以处理更多任务,结合更多的可用线程数,最终实现了单机架性能的飞跃。领先的内存带宽则确保每个机架能够运行更多线程,避免在高持续负载下因核心争抢资源而导致性能下降。

Arm 还指出,部署其 AGI CPU 后,每吉瓦 AI数据中心 算力所需的资本支出(CapEx)有望节省高达 100 亿美元。

在客户与合作生态方面,Arm 已与 Cerebras、Cloudflare、F5、OpenAI、Positron、Meta、Rebellions、SAP、SK Telecom 等公司达成进一步合作,这些伙伴将在各自的解决方案中部署 Arm AGI CPU,应用场景涵盖加速器管理、控制平面处理、云与企业级 API、任务与应用托管等。

同时,Arm 也与 永擎电子(ASRock Rack)、联想、广达电脑、超微 等头部 OEM/ODM 厂商合作,目前已推出基于 Arm AGI CPU 的早期系统,更广泛的商用部署预计将于 2024 年下半年展开。

包括 AWS、博通、谷歌、Marvell、美光、微软、NVIDIA、三星、SK 海力士、台积电 在内的 50 多家来自超大规模云服务、芯片、内存、网络、软件及系统制造领域的领军企业,均对 Arm 进军芯片领域表示支持。

对于关注芯片架构演进与数据中心算力发展的开发者与技术人员而言,Arm 这一战略转变无疑将重塑市场格局。想了解更多前沿技术动态与深度解析,欢迎访问 云栈社区。