一个问题长久困扰着“AI for Science”领域:我们能否真正训练一个大模型,让它“学会”进行科学发现?

这不是指简单地用提示词让模型头脑风暴,而是构建一个能从已有科学知识出发,系统性生成有价值新假设的模型。想法听起来很合理,但实践中鲜有成功案例。阻碍并非模型不够强大,而是在数学层面,这个问题本身似乎就走不通。

最近,一篇题为“MOOSE-Star”的论文在 HuggingFace 上获得了83个点赞,它声称破解了这个“走不通”的难题。仔细研读后,其思路确实令人耳目一新。

科学发现为何难以被“训练”?

首先需要明确问题。科学发现可以抽象为一个建模过程:给定一个研究背景,模型需要从浩如烟海的科学文献中找出相关的“灵感”,然后将这些灵感组合成一个新的、有潜力的“假设”。

这模仿了人类科学家的思维过程。牛顿看到苹果落地(灵感),结合对天体运动的背景知识,综合出了万有引力定律。反向传播算法的诞生,则是“多层神经网络”结构与微积分中“链式法则”这两个灵感的结合。

真正的难点在于规模。全球科学文献数量级在千万以上。假设每个新假设需要组合3个灵感,那么总的搜索空间将达到10的21次方,这比宇宙中的恒星总数还要高出好几个数量级。试图让一个模型在如此庞大的空间中学习到正确的组合模式?标准的端到端训练方法在这里基本无法收敛。

这个问题可能是“AI for Science”领域最被低估的瓶颈。当大家都在讨论模型是否能理解科学原理时,往往忽略了“搜索空间太大、根本无法有效训练”这个更为基础且棘手的难题。

以往的方法论存在局限

现有基于大模型的科学发现方法,大多着力于推理阶段的优化。例如,精心设计提示词引导模型思考,或者利用实验反馈进行迭代修正。这些方法有一定效果,但本质上还是在依赖一个未经“科学发现”专项训练的通用模型去“碰运气”。

先前有研究提出过一个数学分解框架,将组合爆炸的联合概率拆解为“寻找灵感”和“组合灵感”两个子步骤。这个方向很有启发性,但他们仅仅将其应用于推理阶段。至于训练?依然要面对那个无法逾越的“搜索空间巨大”的障碍。

MOOSE-Star 的破局三步骤

MOOSE-Star 的核心思想可以用一句话概括:既然无法在整个空间中搜索,那就明智地避免搜索整个空间。

具体而言,它通过三个层层递进的技术,将问题的计算复杂度极大地压缩。

第一步:问题分解,化整为零。

不再尝试直接训练“从背景到假设”的端到端模型,而是将其分解为两个可独立学习的子任务:“从文献库中检索一个相关灵感”和“利用该灵感组合出下一步假设”。每个步骤只需在N篇文献中挑选一个,重复k次即可。如此一来,搜索空间从恐怖的N^k骤降至可管理的k × N。

第二步:层级导航,替代线性扫描。

即便复杂度降至线性,遍历千万级文献库的成本依然高昂。MOOSE-Star 的解决方案是将全部文献按语义组织成一棵搜索树。检索时,模型从根节点开始,逐层向下,每层仅在少数几个候选节点中做出选择。在理想情况下,检索复杂度从O(N)降低到了O(log N)。

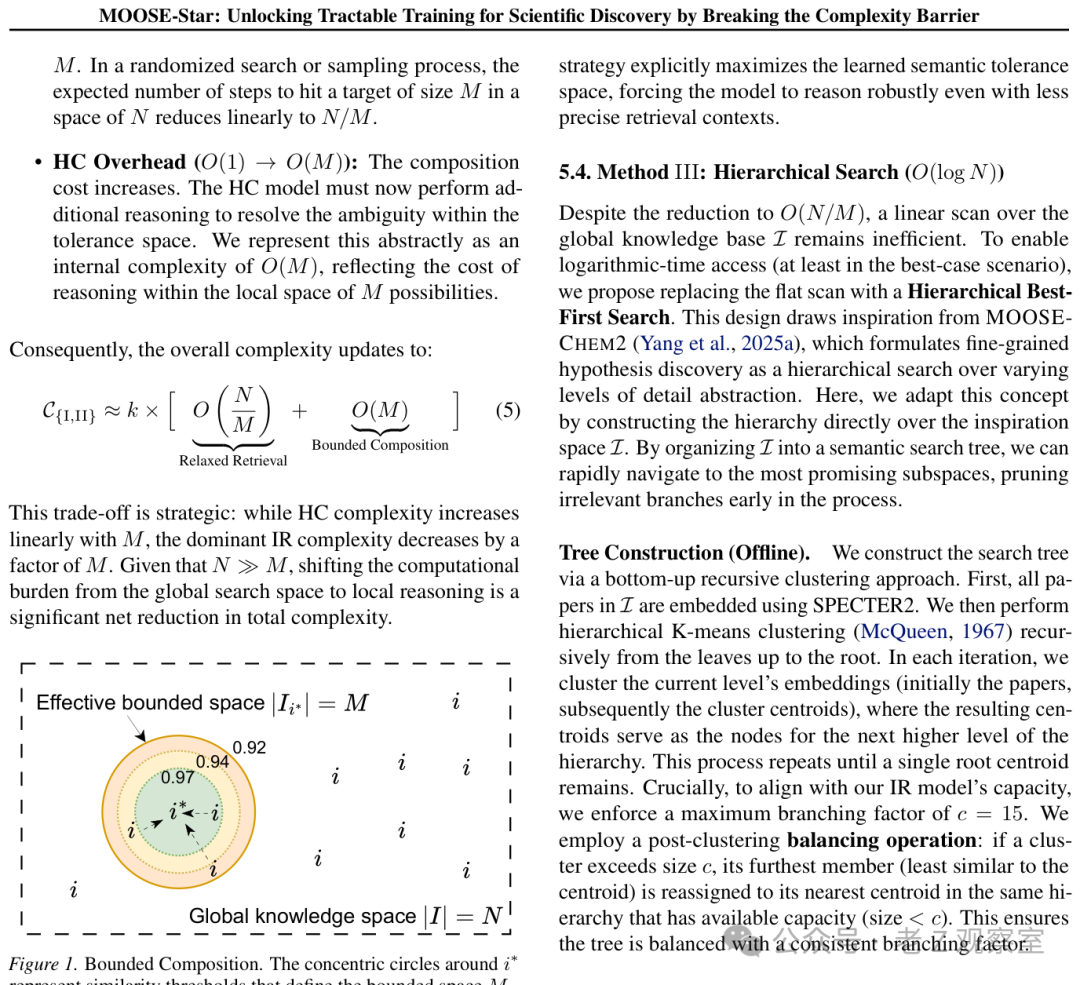

图:Bounded Composition(有界组合)机制示意图。通过在精确灵感周围定义一个语义“容差圈”,并在训练时引入圈内的近似灵感,以增强模型在检索不完美情况下的组合鲁棒性。

第三步:容错训练,以应对现实噪声。

基于树结构的搜索不可能每次都返回百分百精确的灵感,总会存在偏差。怎么办?MOOSE-Star 在训练阶段主动为模型提供一些“近似但不完全正确”的灵感,强制模型学会在不完美的检索结果下,依然能够进行有效的假设组合。这一技巧被称为“Bounded Composition”,思路非常务实。

此外,还有一个锦上添花的设计:在开始检索前,先让模型生成一个“研究动机”,相当于为后续的树状搜索提供方向性指引。就像你去图书馆查资料,如果先明确“我要找催化剂相关文献”,就不必从文学区开始漫无目的地翻找了。

整个框架基于 R1-Distilled-Qwen-7B 模型进行训练,使用了自建的 TOMATO-Star 数据集。该数据集将108,717篇论文分解为结构化的训练样本,仅数据处理就耗费了38,400个GPU小时,这背后离不开强大的计算资源支持。

实验结果中的关键洞察

在基础性能上,经过微调的模型在假设组合任务上显著超越了基线模型。引入容错训练数据后,模型在面对带有噪声的灵感输入时表现出了更强的稳定性。层级搜索在包含3,035个目标灵感的检索测试中,效率远超暴力搜索。这些都在预期之内。

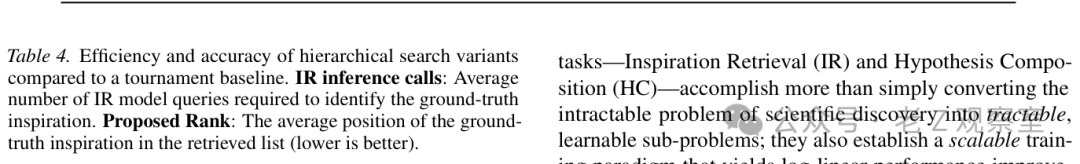

表:层级搜索变体与锦标赛基线在效率和准确度上的对比。层级搜索能以更少的模型调用次数定位到目标灵感。

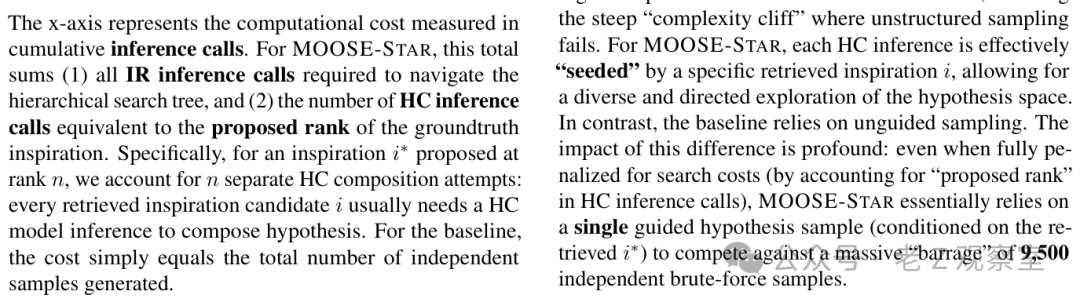

真正引人深思的是“测试时缩放”行为的对比。基于暴力采样的方法很快遇到了瓶颈:增加采样次数,生成假设的质量却不再提升。而 MOOSE-Star 则展现出了持续的缩放能力——采样越多,生成的假设质量越高,且未观察到明显的性能天花板。

图:暴力搜索与MOOSE-Star在测试时计算量增加下的表现对比。暴力搜索迅速饱和,而MOOSE-Star的性能持续攀升。

这表明 MOOSE-Star 不仅仅是一种“更高效的搜索策略”,其框架结构本身就更适合于利用额外的计算资源进行扩展。这与当前人工智能领域对“测试时计算”价值的追求是一致的。

观点与展望

这篇论文最宝贵的价值,或许不在于某个具体的技巧,而在于它成功地将“训练模型进行科学发现”这件事,从“理论上不可行”转变为“工程上可尝试”。从指数级复杂度到对数级复杂度,这是一个质的飞跃。

当然,挑战依然存在。目前的工作仅在生物、化学和认知科学三个领域得到验证,这些领域的“灵感组合”模式相对具象。对于理论物理或数学这类高度抽象的领域,该框架是否依然适用?数据集构建成本极高,38,400 GPU小时不是一个小数目,抬高了复现门槛。此外,评估主要依赖LLM打分,缺乏真实科学家的评判——毕竟,一个假设的最终价值必须通过实验来检验。

长远来看,如果 MOOSE-Star 这类框架能够与自动化实验平台对接,形成“生成假设 -> 实验验证 -> 反馈改进”的完整闭环,那才是真正迈向“AI科学家”的关键一步。虽然目前尚缺这关键一环,但至少,通往可训练的科学发现模型的道路,已经从理论上被铺平了。

对于关注前沿AI研究动态的开发者而言,这篇论文无疑是一个值得深入研读的开源实战案例。你可以在云栈社区找到更多类似的深度技术解析与讨论。

相关资源